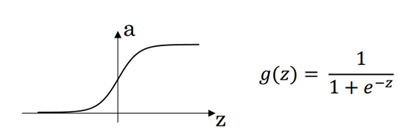

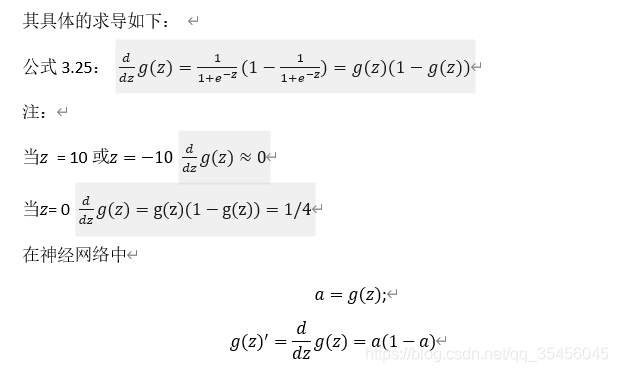

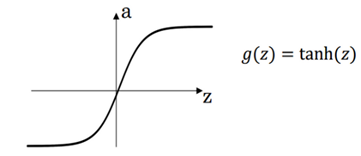

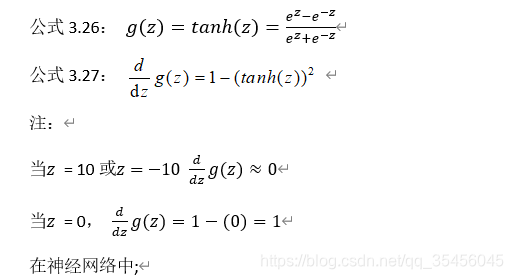

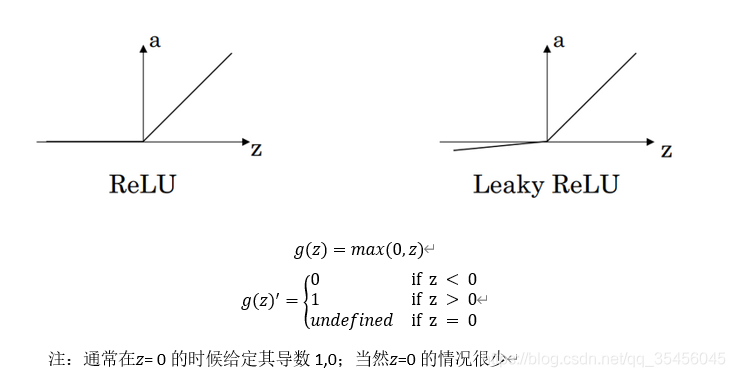

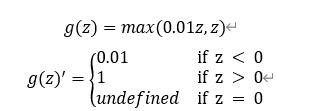

【吴恩达深度学习专栏】浅层神经网络(Shallow neural networks)——激活函数的导数(Derivatives of activation functions)

猜你喜欢

转载自blog.csdn.net/qq_35456045/article/details/105084502

今日推荐

周排行