免费开源使用的几款红黑网络流量工具,自动化的多功能网络侦查工具、超级关键词URL采集工具、Burpsuite被动扫描流量转发插件。

####################

免责声明:工具本身并无好坏,希望大家以遵守《网络安全法》相关法律为前提来使用该工具,支持研究学习,切勿用于非法犯罪活动,对于恶意使用该工具造成的损失,和本人及开发者无关。

####################

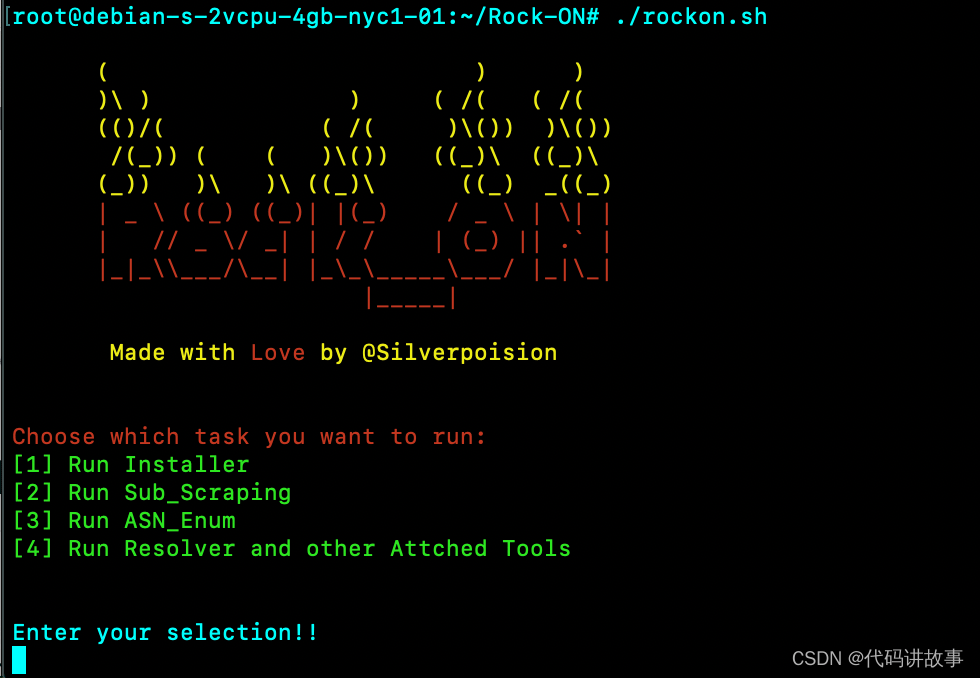

Rock-On是一款一体化网络侦察工具。它主要用于自动化整个网络侦察过程,找到敏感信息,节省手动完成众多工作所浪费的时间。最近这类全家桶套装渗透测试工具程上升趋势。

功能特点

子域名搜索

寻找 A.S.N-Netblocks-IP's

解决方案

寻找端口

寻找 VHost

查找目录

寻找次级域

实时监控资产并跟踪

推送通知到 Slack

找到 JS 链接,爬取相关链接,敏感文件

主动和被动爬虫

项目模块引用

Rock-ON网络侦查工具包集成参照了以下项目:

Sublist3r

Knock

Subfinder

Censys

Amass

CT Logs

CTFR

Wayback

San Domains

AltDns

NMAP

Masscan

MassDNS

Sublert

Aquatone

Vhost

Rapid7 FDNS DB

AWS-CLI

Dirsearch

更多

Rock-ON安装

依赖

项目依赖于GO语言环境

wget https://dl.google.com/go/go1.12.5.linux-amd64.tar.gz

tar -C /usr/local -xzf go1.12.5.linux-amd64.tar.gz

rm -f go1.12.5.linux-amd64.tar.gz

nano ~/.profile

添加这一行

export PATH=$PATH:/usr/local/go/bin

export GOROOT=/usr/local/go

安装

注意:对于新的Fresh VPS,首先运行此命令:

sudo apt-get upgrade && sudo apt-get update && sudo apt-get install git

代码库克隆至本地

git clone https://github.com/SilverPoision/Rock-ON.git

cd Rock-ON

chmod +x rockon.sh

./rockon.sh

1

另外,请不要忘记通过运行来配置AWS凭据

aws configure

Rock-ON使用

./rockon.sh

注意:首次运行第4个选项时运行以下命令。

gem install colorize

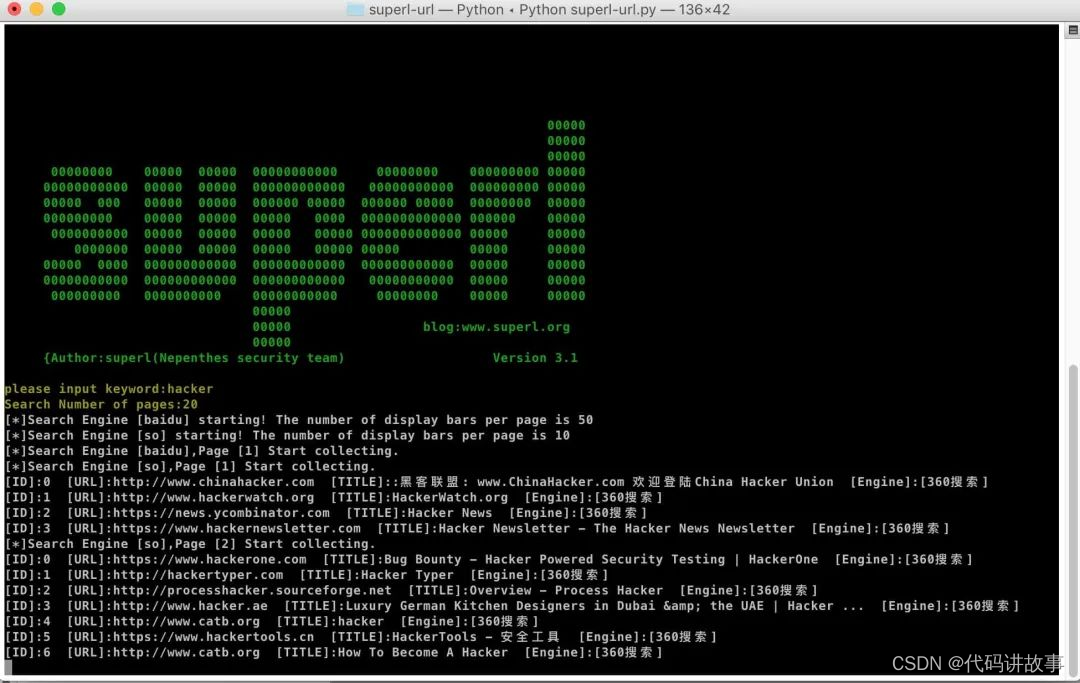

superl-url 关键词URL采集,一款基于Python的开源免费关键词URL采集工具。

根据关键词,对搜索引擎内容检索结果的网址内容进行采集的一款轻量级软程序。

程序主要运用于安全渗透测试项目,以及批量评估各类CMS系统0DAY的影响程度,同时也是批量采集自己获取感兴趣的网站的一个小程序~~

可自动从搜索引擎采集相关网站的真实地址与标题等信息,可保存为文件,自动去除重复URL。同时,也可以自定义忽略多条域名。

程序特色

支持同时采集多个搜索引擎(已内置了百度,搜狗,360),结构模块化,很方便进行扩展,可以无限添加。

获取到的是搜索引擎的搜索结果的真实URL地址

跨平台,采用Python开发,所有代码完整开源.并且无捆绑后门风险,更新方便。网上大部分URL采集软件为WINDOWS下的可执行文件,并且很多都在搜索引擎更新后无法正常使用。

强大的过滤功能。可过滤多种顶级域名,可过滤指定标题中包含某关键子的URL,比如搜索结果中过滤属于youku.com的子域名URL。支持TXT配置过滤。

可自动去除重复URL

可灵活的通过配置文件自定义要保存的结果格式。比如只输出带参数的原始真实URL,或者只输出域名,或者同时输出标题,搜索引擎名称。

可灵活的开启与关闭参与采集的搜索引擎,比如只想使用百度,就把其他搜索引擎参数设置为False即可。

同时兼容python3和python2版本运行!良心开源小产品啊~~~

可分别自定义不同搜索引擎每页显示数量(如果搜索引擎自身支持的话)

支持多进程同时采集,每个搜索引擎一个进程

可自定义每页采集时间间隔,防止被屏蔽

实时显示采集到的网页的【真实URL】以及【标题】。前面的【ID】对应的是当前页搜索引擎结果的第X条数据

保存类型可自定义,目前支持保存为本地txt,以及写入远程MYSQL数据库!

superl-url安装与使用

git clone https://github.com/super-l/superl-url.git

安装依赖

python3:pip install ConfigParserpip install tldextract

Python2:pip install tldextractpip install -i https://pypi.tuna.tsinghua.edu.cn/simple configparser

如果提示模块不存在,则根据提示进行安装!

使用说明

如果要采集关键词为“hacker”的相关网站,采集搜索结果的前3页,则输入如下:

please input keyword:hacker

Search Number of pages:3

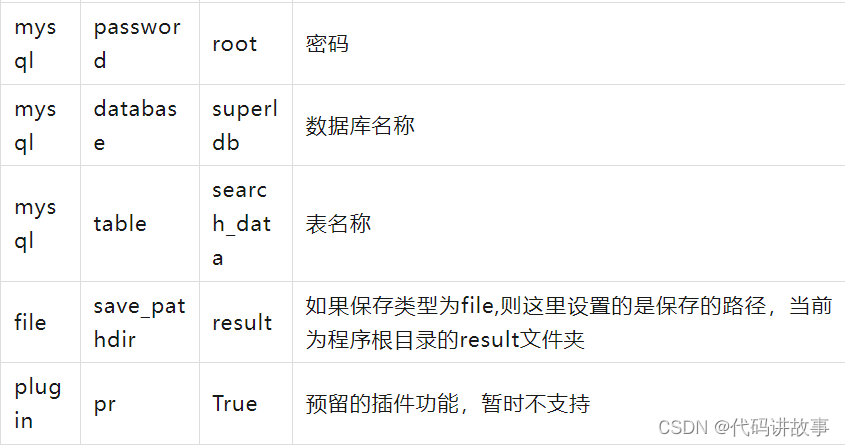

配置文件说明 config.cfg

数据库创建表sql语句:

CREATE TABLE `search_data` (

`id` int(11) unsigned NOT NULL AUTO_INCREMENT,

`engine` varchar(20) NOT NULL DEFAULT '',

`keyword` varchar(100) NOT NULL DEFAULT '',

`baseurl` varchar(255) NOT NULL DEFAULT '',

`realurl` varchar(255) NOT NULL DEFAULT '',

`urlparam` varchar(255) NOT NULL DEFAULT '',

`webtitle` varchar(255) NOT NULL DEFAULT '',

`create_time` int(10) NOT NULL,

PRIMARY KEY (`id`)

) ENGINE=MyISAM AUTO_INCREMENT=395 DEFAULT CHARSET=utf8;

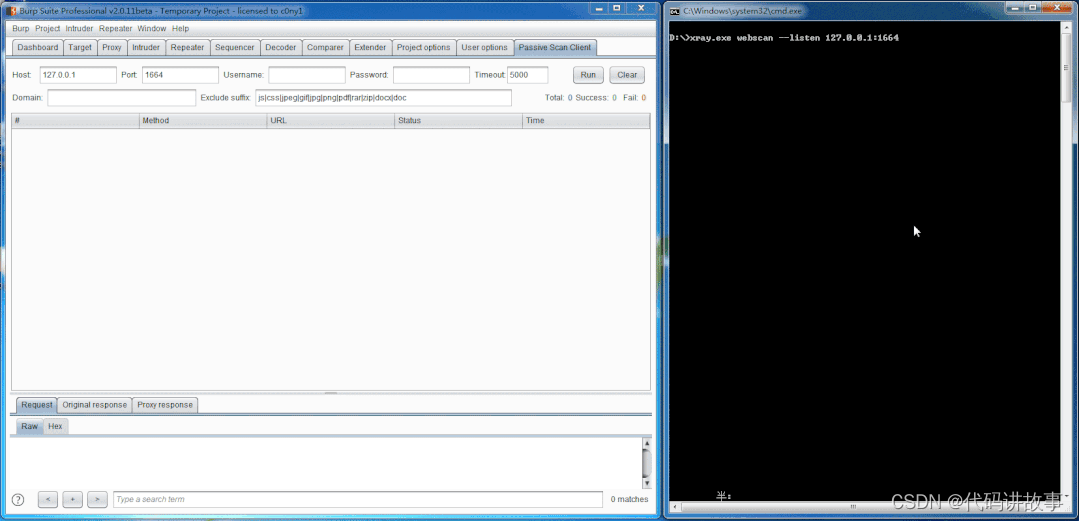

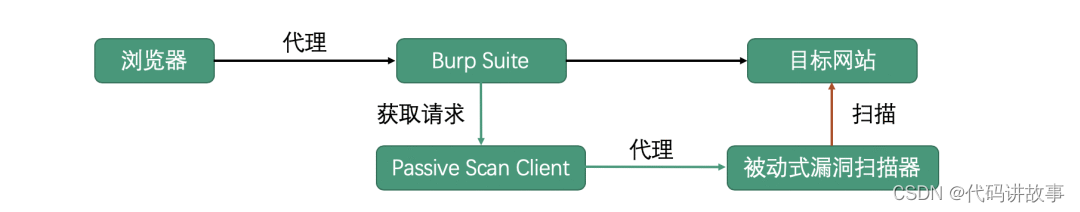

Passive Scan Client,Burpsuite被动扫描流量转发插件。

插件简介

将浏览器代理到被动扫描器上,访问网站变慢,甚至有时被封ip,这该怎么办?

需要人工渗透的同时后台进行被动扫描,到底是代理到burp还是被动扫描器?

该插件正是为了解决该问题,将正常访问网站的流量与提交给被动扫描器的流量分开,互不影响。

插件编译

git clone https://github.com/c0ny1/passive-scan-client.git

mvn package

插件演示

可以通过插件将流量转发到各种被动式扫描器中,这里我选xray来演示。