在之前的博客里已经介绍过NAT模式,这里再部署一下DR模式。TUN模式不做阐述,因为应用到的环境比较大,但是往往一般大环境又不用TUN模式来做,所以TUN就直接放弃。

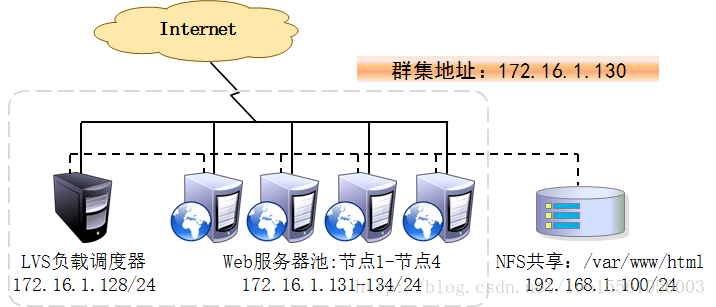

在DR模式的群集中,LVS负载调度器作为群集的访问入口,但不作为网关使用;服务器池中的所有节点都各自接入Internet,发送给客户端的Web响应数据包不需要经过LVS负载调度器。这种方式入站、出站访问数据被分别处理,因此LVS负载调度器和所有节点服务器都需要配置有VIP地址、以便响应对整个群集的访问。考虑到数据存储的安全性,共享存储设备会放在内部的专用网络中

1. 配置负载调度器

a. 配置虚拟IP地址(VIP)

采用虚拟接口的方式(eth0:0),为网卡eth0绑定VIP地址,以便响应群集访问。

配置结果为eth0=>172.16.1.128/24,eth0:0=>172.16.1.130/24

cd /etc/sysconfig/network-scripts/

cp ifcfg-eth0 ifcfg-eth0:0

vim ifcfg-eth0:0

......//省略部分

ONBOOT=yes

IPADDR=172.16.1.130

NETMASK=255.255.255.0

ifup eth0:0b. 调整/proc响应参数

对于DR群集模式来说,由于LVS负载调度器和各节点需要共有VIP地址,应该关闭Linux内核的重定向参数响应

vim /etc/sysctl.conf

....../省略部分信息

net.ipv4.conf.all.send_redirects = 0

net.ipv4.conf.default.send_redirects = 0

net.ipv4.conf.eth0.send_redirects = 0c. 配置负载分配策略

service ipvsadm stop //清楚原有策略

ipvsadm -A -t 172.16.1.130:80 -s rr

ipvsadm -a -t 172.16.1.130:80 -r 172.16.1.131:80 -m -w 1

ipvsadm -a -t 172.16.1.130:80 -r 172.16.1.132:80 -m -w 1

ipvsadm -a -t 172.16.1.130:80 -r 172.16.1.133:80 -m -w 1

ipvsadm -a -t 172.16.1.130:80 -r 172.16.1.134:80 -m -w 1

service ipvsadm save //保存策略2.配置节点服务器

使用DR模式时,节点服务器也需要配置VIP地址,并调整内核的ARP响应参数以阻止更新VIP的MAC地址,避免发生冲突。

a. 配置虚拟IP地址(VIP)

各节点的VI品低值仅用作发送Web响应数据包的源地址,并不需要监听客户机的访问请求(实际的需求是又调度器来做)。因此需要使用虚拟接口lo:0来承载VIP地址,并为本机添加一条路由记录,将访问VIP的数据限制在本地,以避免通信紊乱

cd /etc/sysconfig/network-scripts/

cp ifcfg-lo ifcfg-lo:0

vim ifcfg-lo:0

......//省略部分

ONBOOT=yes

IPADDR=172.16.1.130NETMASK=255.255.255.255 //这里子网掩码必须全为255

ifup lo:0

vim /etc/rc.local

.....//省略部分

/sbin/route add -host 172.16.1.130 dev lo:0 //保证每次开机运行

route add -host 172.16.1.130 dev lo:0 //确保在当前生效b.调整/proc响应参数

为所有节点服务器对访问的回应和宣告做设置

.....//省略部分

net.ipv4.conf.all.arp_ignore = 1

net.ipv4.conf.all.arp_announce = 2

net.ipv4.conf.default.arp_ignore = 1

net.ipv4.conf.default.arp_announce = 2

net.ipv4.conf.lo.arp_ignore = 1

net.ipv4.conf.lo.arp_announce = 2

sysctl -pc. 把各节点的网页跟目录挂载到NFS上,并开启服务,接下来要做的就是测试了(略)

通过下面命令查看群集节点状态

ipvsadm -ln