文章目录

摘要

图神经网络(GNNs)通过聚合邻近节点的属性来学习有效的节点/图表示,这些邻近节点通常派生出一个混合了图结构和节点属性信息的单一表示。然而,这两种信息在语义上可能不一致,并且可能对不同的任务有用。在本文中,我们的目标是学习节点/图表示与结构属性解缠(GraphSAD)。我们建议将图结构和节点属性分解成两组不同的表示,这种分解可以在输入空间或嵌入空间中完成。我们进一步设计了一个度量标准来量化这种解脱的程度。在多个数据集上的大量实验表明,我们的方法确实能够理清图结构和节点属性的语义,并且在节点和图分类任务中都取得了优异的性能。

一、Introduction

在许多现实世界的应用和领域中,用信息丰富的低维特征向量表示节点或整个图形扮演着至关重要的角色,例如社交网络中的用户分析(Tan et al., 2011;Y an et al., 2013),知识图中的关系推理(Bordes et al., 2013;Trouillon et al.,2016;Sun et al.,2019),药物/材料发现中的分子性质预测(Gilmer et al., 2017;Wu et al.,2018)和电路设计中的电路响应预测(Zhang et al.,2019)。最近,图神经网络(GNNs) (Kipf & Welling, 2017;V elickovic等人,2018;Xu et al., 2019)在许多不同的任务中都表现出了它们的优越性。通常,这些方法的基本思想是通过以迭代和非线性的方式聚合每个节点及其邻居的属性来学习有效的节点表示(或带有附加图池化的图表示)。

对于属性图,GNNs通常将其图结构和节点属性的信息编码为单个表示。这可能会有问题,因为图结构和节点属性的语义空间可能没有很好地对齐,而且这两种类型的信息可能对不同的任务有用。例如,预测用户的健康状况主要依靠用户的个人资料信息,而社交网络并没有提供太多有意义的信息;在另一种情况下,对用户社会阶层的预测主要依赖于用户的社会网络结构。因此,一个更合理的解决方案是将这两种类型的信息分解成两种不同的表示集合,其重要性可以由下游任务进一步确定。这种解纠缠表示已被证明有利于模型的泛化能力和可解释性(Chen et al., 2016;Higgins等人,2017;Alemi等,2017)。

最近,DisenGNN (Ma et al., 2019)研究了解纠缠节点表示学习,将每个节点的邻居分组到不同的通道,每个通道对应不同的潜在因子。换句话说,DisenGNN专注于解开图结构的各种潜在因素。相比之下,我们的工作打算解开图结构和节点属性的表示,这是正交于他们的工作,也更一般。

在这篇论文中,我们的目标是学习具有结构属性解缠(GraphSAD)的节点/图表示。作为一种初始的尝试,我们首先尝试在输入空间中进行解缠,命名为input - SAD,将一个图分离为一个结构和一个属性组件,然后分别对这两个组件进行编码。但是,由于图结构和节点属性并不是完全独立的,所以最好抑制这两个因素在嵌入空间中的依赖性,而不是直接分离输入图。受此启发,我们建议提出一个将图的结构和属性信息嵌入到嵌入向量的不同通道中,称为embedded - sad。具体来说,对于每个嵌入节点,一半的元素通过边缘重构来捕获图结构,另一半元素通过最小化与结构对等体的互信息来提取属性信息,同时保持语义可判别性。此外,我们设计了一个量化评估图表示的结构-属性解纠缠的度量,称为SAD-Metric,衡量模型在改变输入图的图结构或节点属性时的灵敏度。

我们将我们的贡献总结如下:

(1)通过在输入空间或嵌入空间中分离图结构和节点属性,研究了结构-属性解缠的节点/图表示学习。

(2)我们设计了一种量化的度量方法来度量结构属性解纠缠的程度,这是一种新颖的图形化数据处理方案。

(3)通过将所提出的解纠缠技术与各种gnn相结合,我们在节点和图分类基准数据集上验证了我们的方法的优越性能。同时,我们通过提出的度量和定性可视化来分析解纠缠图表示。

二、问题的定义和初步

2.1 问题定义

我们研究属性图的学习节点表示(如社会网络)或全图表示(如分子图)。形式化地,我们表示一个属性图为G = (V,E,A)。V为节点集合。E = {(u, v, tuv)}是边的集合,tuv是连接节点u和v的边的类型(例如分子图中不同类型的键)。A = {Av|v∈v}表示节点属性的集合。

我们的目标是学习每个节点或整个图的有意义的表示。现有的gnn通常通过神经消息传递将图结构和节点属性混合成统一的表示形式。然而,在实践中,这两种类型的信息可能编码不同的语义,并适用于不同的任务。以社交网络的预测为例。在预测用户的社会阶层时,图结构比用户属性起着更重要的作用,而在预测用户的健康状况时,用户属性无疑比图结构更具信息量。因此,我们希望将图结构和节点属性的信息分解成不同的表示集合,并使用下游任务来确定它们的重要性。具体来说,我们将问题定义如下:

基于结构-属性解缠的节点/图表示学习。给定一个属性图G= (V,E,A),我们的目标是通过将图结构S = {V,E}和节点属性A的语义解为两个不同的表示集,即zv= [zv,S, zv,A](或zG= [zG,S, zG,A])来学习节点(或全图)表示。这两种表示形式的重要性由下游任务(如节点或图分类)进一步确定。

2.1 初步

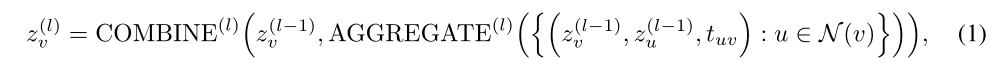

图神经网络。GNN将每个节点v∈v映射到嵌入向量zv,并将整个图G编码为向量zG。对于l层GNN,围绕每个节点的L-hop信息是通过邻居聚合机制捕获的。形式上,第l阶GNN层可以定义为:

其中N(v)为节点v的邻居集合,tuv表示边缘属性,z(l) v表示v在第l层的表示,z(0) v由节点属性Av进行初始化。利用图中所有节点的嵌入,可以通过排列不变读出函数推导出整个图的嵌入:

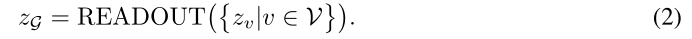

交互信息估计。互信息(MI)量化两个随机变量之间的相互依赖性。近期研究(Belghazi et al., 2018;Hjelm等人,2019)研究了基于神经网络的MI估计器。其中,噪声对比估计(NCE) (Gutmann & Hyvärinen, 2010;van den Oord et al.(2018)首先将该估计量作为MI的下界,由于其有效性和简捷性,我们在我们的方法中也采用了该估计量。在实践中,对于两个随机变量x1和x2,给定一对正的(x+ 1,x+ 2)∼p(x1,x2)和K个分心物(x+ 1,x2,j)∼p(x1)p(x2) (j = 1,2,···,K), MI的NCE估计定义为:

其中T(·,·)是一个参数化的判别器函数,它为一对输入样本输出一个标量值,其结构在第5.1节中详细介绍。

三、使用结构-属性解缠学习图表示

3.1 INPUT-SAD:输入的结构-属性解纠缠

作为初步尝试,我们试图学习结构-属性解纠缠的节点/图表示,方法是将一个图分解为一个结构组件和一个属性组件,然后将它们分别编码,如图1(a)所示。具体来说,给定一个属性图G = (V,E,A),这两个分量的构造和编码如下。

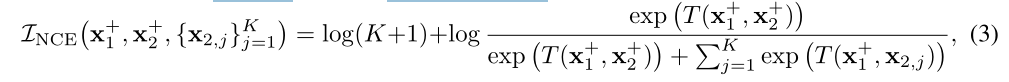

结构组件提取图结构,形成另一个图GS= (VS,ES,AS),其中节点集和边集不变,即VS= V, ES= E,每个节点的出度作为其属性,即AS= {d(V)| V∈VS} (d(·)表示出度函数)。GNN将这个分量映射到δ维嵌入空间:

其中zV,S= {zV,S |v∈v}∈R| v |×δ表示仅由图结构导出的节点嵌入,zG,S∈Rδ是整个结构构件的嵌入。

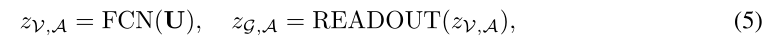

属性构成为特征矩阵U∈R|V|×D,其中特征向量Uv∈RDis是节点属性Av的d维嵌入,该分量使用全连接网络和readout函数(如本文使用的mean pooling)进行编码:

其中zV,A= {zV,A |v∈v}∈R| v |×δ表示图G中节点的属性嵌入,zG,A∈Rδ嵌入整个属性分量。

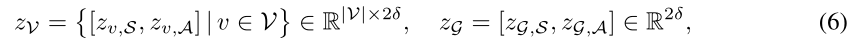

通过对每个节点和整个图的结构和属性嵌入进行连接,恢复图G的完整信息:

其中[·,·]为拼接操作。基于这些连接的节点/图嵌入,预测任务(例如节点/图分类)由任务特定的网络C执行,该网络定义了监督损失Lsupr模型优化:

3.2 embedded - SAD:嵌入式的结构-属性解缠

将输入图显式地分离为结构和属性组件,强制对图结构和节点属性进行独立编码。然而,这两个因素并不是完全独立的。例如,在社交网络中,一个人的社会关系可以提供关于他/她的性格的有用信息,反之亦然。因此,由输入sad派生的表示可能不能完全捕获图的结构和属性信息。为了解决这一缺点,我们试图对原始图进行编码,并将其结构和属性信息提取为嵌入向量的不同通道,如图1(b)所示。

对于属性图G = (V,E,A),利用GNN将图映射到一个2δ维的嵌入空间:

其中zV= {zV |v∈v}∈R| v| ×2δ表示节点嵌入,zG∈r2 δ为整个图的嵌入。我们进一步将这些嵌入分为两个通道:

其中zv,S, zv,A(zG,S, zG,A)∈r δ是节点v(整个图G)的结构和属性嵌入。为了将结构和属性信息提取到对应的通道中,我们提出了两种学习方案。

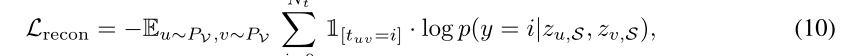

通过边缘重建学习嵌入结构。假设充分捕捉图结构的节点嵌入能够重构图的边缘。具体来说,利用一对节点的结构嵌入,我们期望预测它们之间的边缘的存在和类型,这定义了学习结构嵌入的重构约束:

PV表示均匀分布/ V, 1[]是指标函数判断是否边缘(u, V)属于i型(i = 0表示没有边缘),Ntis不同边缘类型的数量,和p (y |祖茂堂,年代,zv, S)是由一个神经网络建模的F在秒。详细讨论了b这个目标函数与提议的VGAE (Kipf &威林,2016)和GraphSAGE(汉密尔顿et al ., 2017),虽然另外约束边缘类型的重建,这使得结构嵌入能够充分捕获图结构的信息。

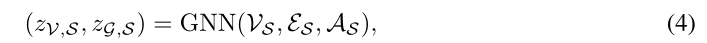

学习属性嵌入互信息最小化。在得到了结构嵌套之后,我们想推导出抽取节点属性信息而抑制图结构信息的属性嵌套。为了实现这一目标,我们使用了一个基于神经网络的MI估计器(即第2.2节中的NCE估计器)来估计并同时最小化结构和属性嵌入之间的依赖性。

在特定的,我们表示的结构和属性潜在因素两个随机变量,zSand咱,并认为每个节点的结构和属性嵌入样本对应的边际分布,即zv、S∼p (z), zv,∼p (zA) (v∈)。计算MI的指标估计,我们定义的结构和属性嵌入相同的节点作为一个积极的一对,即(zv, S, zv)∼p (z,咱)∈(v),由两个不同节点构成的嵌入对作为干扰物,即(zv,S, zw, a) green - p(zS)p(zA) (v 6= w, v, w∈v),利用这些概念,定义两个潜在因素之间的估计MI为

其中PV与 PV{v}表示有节点v和没有节点v的节点集上的均匀分布,INCE(·,·,·)为式3中定义的NCE估计函数。

通过最小化估计的MI,可以抑制结构和属性嵌入之间的线性和非线性依赖,从而促进结构-属性解缠的节点/图表示。需要注意的是,这种学习机制与信息瓶颈(IB)原则有关(Tishby et al., 2000;Tishby & Zaslavsky, 2015;Alemi等人,2017),而与IB相比,提出的方法打算分离两个不同的信息源,而不是追求对输入的最大压缩。

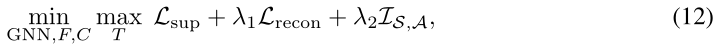

模型优化。我们通过在未纠缠的节点/图嵌入(即zVor zG)上附加一个任务特定的网络C来执行预测任务(例如节点/图分类),该嵌入定义了一个期望最小化的监督损失。这个监督任务还保证了语义信息不会被MI最小化方案消除。在结构属性解缠方面,一方面最小化重构损失,将图的结构信息提取到结构嵌入中。另一方面,MI的最小化是以一种对抗的方式进行的,在这种方式中,鉴别器T(定义在Eq. 3中)被训练为最大化is,A,而GNN编码器寻求最小化该项。总体目标是:

其中,λ1和λ2为不同目标之间的取舍参数平衡。

3.3 SAD-METRIC:结构-属性解缠度量

为了量化不同模型实现的结构属性解缠程度,我们设计了一个基于分类器的度量来度量学习到的图表示。受先前工作的启发(Higgins et al., 2017),我们关注解纠缠表示的两个期望性质:(1)独立性:表示向量被期望分成几个相互依赖性尽可能低的通道;(2)可解释性:这些渠道中的每一个都对应着数据的单个潜在因素。

为了得到这样一个度量,对于一个给定的图G,我们首先从{0,1}上的均匀分布中采样一个二进制标号yg。根据这个标签,在另一个因素固定的情况下,对图形的结构或属性进行修改(yG= 0:固定G的结构;yG= 1:修复G的属性),形成对应的图形G0。在实践中,我们通过随机修改图的结构下降的边缘(荣et al ., 2019),和图形的属性修改通过随机改变节点的属性(实现细节所秒。B),使用模型来评估图G的嵌入和G0(即。推导出zGand zG0),将这两种嵌入量的绝对值表示为∆zG(即。∆zG = | zG−zG0 |)。当结构和属性信息在图嵌入中被分解(即独立性和可解释性保持),fixedfactorshouldposesslowervaluesin∆zG对应的元素,这使得使用∆zG上的低容量分类器(例如线性分类器)更容易预测yg。基于这一事实,我们利用yGon a组图的预测精度作为结构-属性解缠度(SAD-Metric)。算法1总结了整个评价过程。

为了测量节点嵌入中结构属性解纠缠的程度,我们进一步设计了一个以节点为中心的度量,称为节点悲哀度量。E节给出了这个度量的详细定义和实验结果。

3.4理论分析

在本节中,我们从理论上说明了结构和属性表示的解纠缠能够通过缩小解空间来减轻模型优化的负担。

对于一个属性图G = (V,E,A),我们可以将每种类型的节点属性看作是一个属性节点,将图G转换成另一种形式G = (V,VA,E,EA) (VA:所有属性节点的集合,EA:连接normal节点和属性节点的边),如图2(A)所示。该图可分为两部分:(1)反映属性信息的二部图GA= (V,VA,EA)(图2(b))和(2)描述图结构的未归属图GS= (V,E)(图2©)。

首先给出了图的拓扑空间和图的空间的定义。

总结

在输入空间和嵌入空间中,我们研究了具有结构属性解缠的节点/图表示学习。我们进一步设计了一个量化的度量来测量这种解缠。在节点和图分类基准数据集上,我们通过经验验证了我们的方法优于现有技术的性能。

我们未来的探索将包括改进结构-属性解缠表示的学习方式,在更多的任务(例如基于回归的任务)上评估提出的模型,并以其他方式解缠图。