Autor: Yu Fan

fundo

Olhando para trás, para a história do desenvolvimento da arquitetura de redes neurais, podemos descobrir que a simetria sempre desempenhou um papel oculto e central, e o aprendizado geométrico profundo destaca a importância da simetria. Por um lado, nas áreas de visão computacional tradicional e processamento de linguagem natural, vimos que a arquitetura de rede baseada no Transformer alcançou resultados surpreendentes nos últimos anos. Por outro lado, como primeiro princípio, a simetria desempenha um papel importante nas ciências naturais. Portanto, temos razões para acreditar que, do ponto de vista da simetria, a aprendizagem geométrica profunda desempenhará um papel importante na combinação da inteligência artificial e da ciência.

Figura 1: A combinação de aprendizagem geométrica profunda nas áreas de inteligência artificial e ciência

Na verdade, a aprendizagem de geometria profunda alcançou resultados impressionantes no campo da IA para a Ciência e desempenhará um papel cada vez mais importante. Alphafold2, baseado em redes neurais gráficas e Transformer, mostra uma precisão muito alta na previsão de estruturas de proteínas. Na previsão e geração de estruturas de moléculas pequenas, adicionar simetria adicional de transformação de corpo rígido (grupo de simetria E(3)) no espaço euclidiano à rede neural gráfica pode melhorar significativamente a precisão do cálculo e reduzir a complexidade do treinamento. Na previsão do tempo global, uma vez que a superfície da Terra é uma esfera bidimensional, envolve questões como a convolução na variedade e a transformação da especificação de coordenadas geométricas, fornecendo uma estrutura teórica sistemática para o projeto de redes neurais. Na cosmologia, o espaço e o tempo são curvos devido à gravidade, e o aprendizado geométrico profundo fornece uma base teórica para a combinação dessa estrutura múltipla curva Riemanniana e da IA.

Por outro lado, em campos científicos básicos, como a física da matéria condensada e a física quântica, o grau de integração com a IA ainda não é profundo. Isto porque nestas áreas o conhecimento teórico sistemático humano está relativamente bem desenvolvido, mas é muito difícil obter dados de alta qualidade. Portanto, como “injetar” conhecimento conhecido nas redes neurais e melhorar a utilização dos dados é particularmente crítico.

Redes neurais equivariantes de grupo mostraram vantagens surpreendentes na melhoria da utilização de dados. Por exemplo, na tarefa de classificação do Tetris tridimensional, há um total de 8 configurações. A abordagem tradicional requer uma grande rotação espacial de cada configuração de dados para aprimoramento dos dados, o que sem dúvida aumenta muito a quantidade de dados e a complexidade do treinamento, e não pode garantir sua precisão de previsão. Na rede neural equivariante E(3), cada configuração requer apenas um dado, ou ainda menos se as duas configurações puderem ser conectadas por meio de uma transformação E(3). Embora reduza bastante a quantidade de dados necessários , sua precisão de previsão é garantida em um nível teórico. Ao mesmo tempo, essa rede neural possui melhor interpretabilidade e capacidade expressiva .

Entre todos os conhecimentos conhecidos, a simetria é um tipo de conhecimento profundo e básico, e também é a chave para explicar as leis da natureza. Por exemplo, o espaço-tempo de partículas de alta energia tem simetria de grupo de Lorentz (grupo SO (1, 3)), e as redes neurais equivariantes do grupo de Lorentz podem desempenhar um papel importante na física de alta energia no futuro. A física moderna é descrita usando a teoria de campo, e a linguagem matemática por trás dela também é a geometria diferencial e os feixes de fibras. É previsível que o aprendizado da geometria profunda desempenhe um papel de liderança na combinação da física moderna e da inteligência artificial.

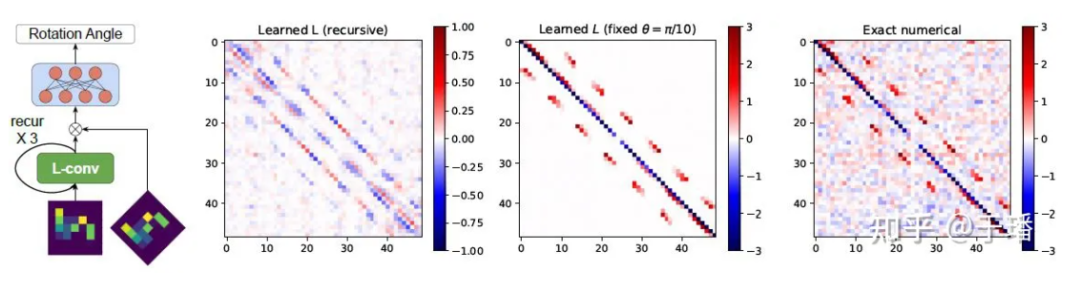

Para o grande modelo AI for Science, baseado em aprendizado geométrico profundo, podemos ter uma ideia simples e ousada: primeiro aprender a simetria do sistema de entrada por meio de algum tipo de rede neural, como aprender o método de álgebra de Lie do grupo de simetria [ 3]; então, através de um determinado mecanismo, controla a força de várias simetrias, permitindo que a rede escolha qual grupo de simetria da rede equivariante usar, para que a rede possa satisfazer a simetria aproximada do sistema de entrada. É claro que existe uma grande probabilidade de que os futuros modelos de grande escala não sejam tão simples, e também estão cheios de problemas que ainda não foram resolvidos.

Figura 2: Álgebra de Lie do grupo SO(2) de dados de aprendizagem L-conv

referências

[1] Bronstein, Michael M., et al. "Aprendizagem geométrica profunda: grades, grupos, gráficos, geodésicas e medidores." Pré-impressão arXiv arXiv:2104.13478 (2021).

[2] Weiler, Maurício, et al. "Coordenar Redes Convolucionais Independentes - Isometria e Medir Convoluções Equivariantes em Variedades Riemannianas." Pré-impressão arXiv arXiv:2106.06020 (2021).

[3] Dehmamy N, Walters R, Liu Y, et al. Descoberta automática de simetria com rede convolucional de álgebra de mentiras[J]. Avanços em Sistemas de Processamento de Informação Neural, 2021, 34: 2503-2515.

Um programador nascido na década de 1990 desenvolveu um software de portabilidade de vídeo e faturou mais de 7 milhões em menos de um ano. O final foi muito punitivo! Google confirmou demissões, envolvendo a "maldição de 35 anos" dos programadores chineses nas equipes Flutter, Dart e . Python Arc Browser para Windows 1.0 em 3 meses oficialmente GA A participação de mercado do Windows 10 atinge 70%, Windows 11 GitHub continua a diminuir a ferramenta de desenvolvimento nativa de IA GitHub Copilot Workspace JAVA. é a única consulta de tipo forte que pode lidar com OLTP + OLAP. Este é o melhor ORM. Nos encontramos tarde demais.