吴恩达DeepLearning.ai系列笔记

干货|吴恩达 DeepLearning.ai 课程提炼笔记(1-2)神经网络和深度学习 --- 神经网络基础

干货|吴恩达 DeepLearning.ai 课程提炼笔记(1-3)神经网络和深度学习 --- 浅层神经网络

1

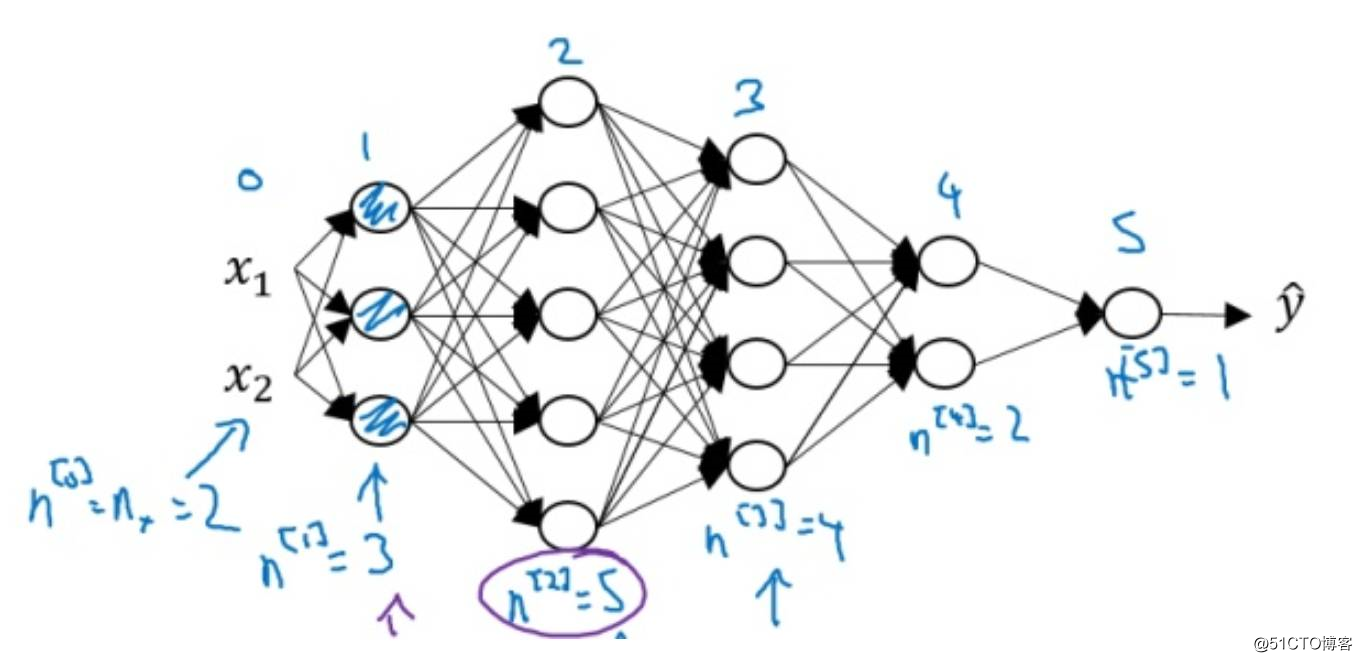

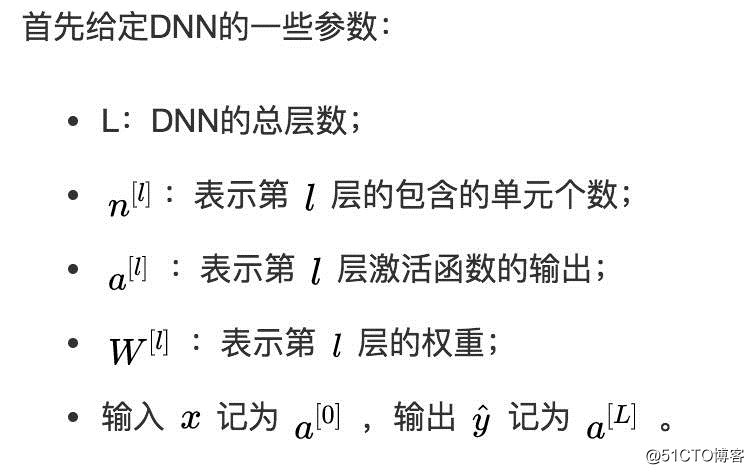

矩阵的维度

DNN结构示意图如图所示:

对于第l层神经网络,单个样本其各个参数的矩阵维度为:

2

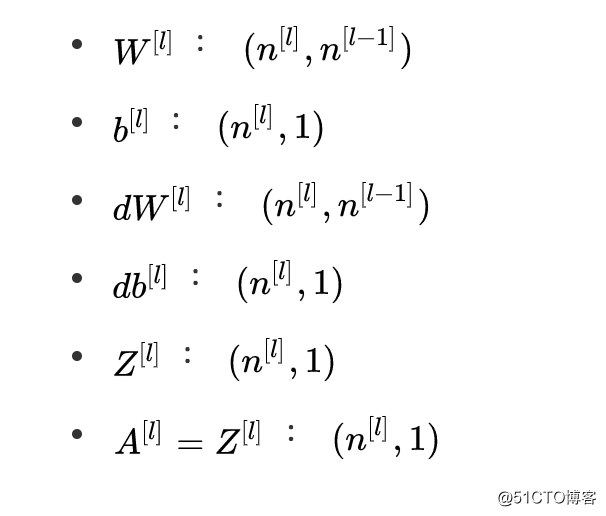

为什么使用深层表示

人脸识别和语音识别:

对于人脸识别,神经网络的第一层从原始图片中提取人脸的轮廓和边缘,每个神经元学习到不同边缘的信息;网络的第二层将第一层学得的边缘信息组合起来,形成人脸的一些局部的特征,例如眼睛、嘴巴等;后面的几层逐步将上一层的特征组合起来,形成人脸的模样。

随着神经网络层数的增加,特征也从原来的边缘逐步扩展为人脸的整体,由整体到局部,由简单到复杂。层数越多,那么模型学习的效果也就越精确。

对于语音识别,第一层神经网络可以学习到语言发音的一些音调,后面更深层次的网络可以检测到基本的音素,再到单词信息,逐渐加深可以学到短语、句子。

所以从上面的两个例子可以看出随着神经网络的深度加深,模型能学习到更加复杂的问题,功能也更加强大。

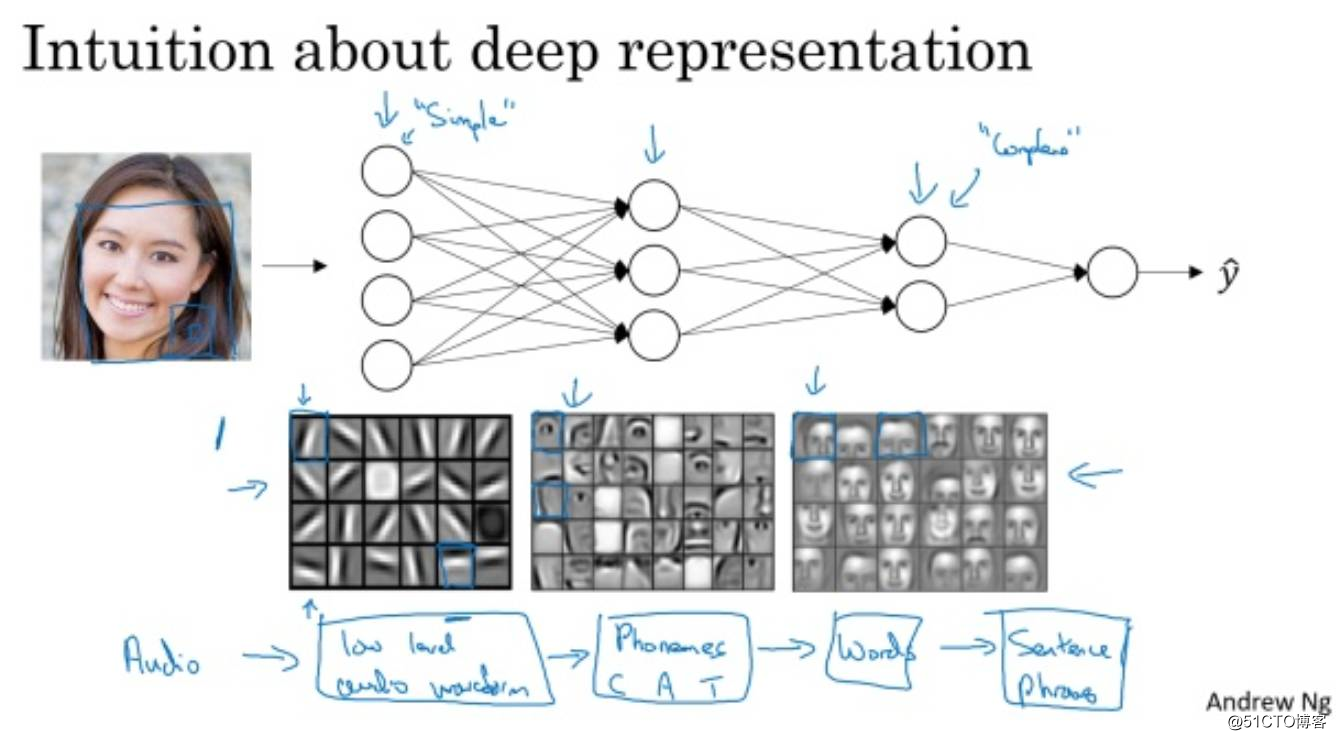

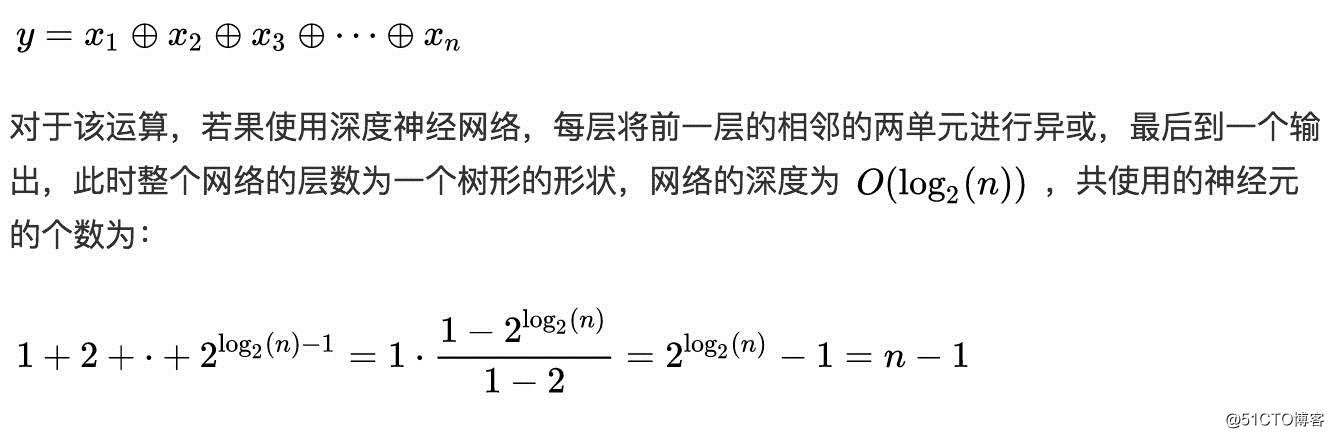

电路逻辑计算:

假定计算异或逻辑输出:

即输入个数为n,输出个数为n-1。

但是如果不适用深层网络,仅仅使用单隐层的网络(如右图所示),需要的神经元个数为2^(n-1)个 。同样的问题,但是深层网络要比浅层网络所需要的神经元个数要少得多。

3

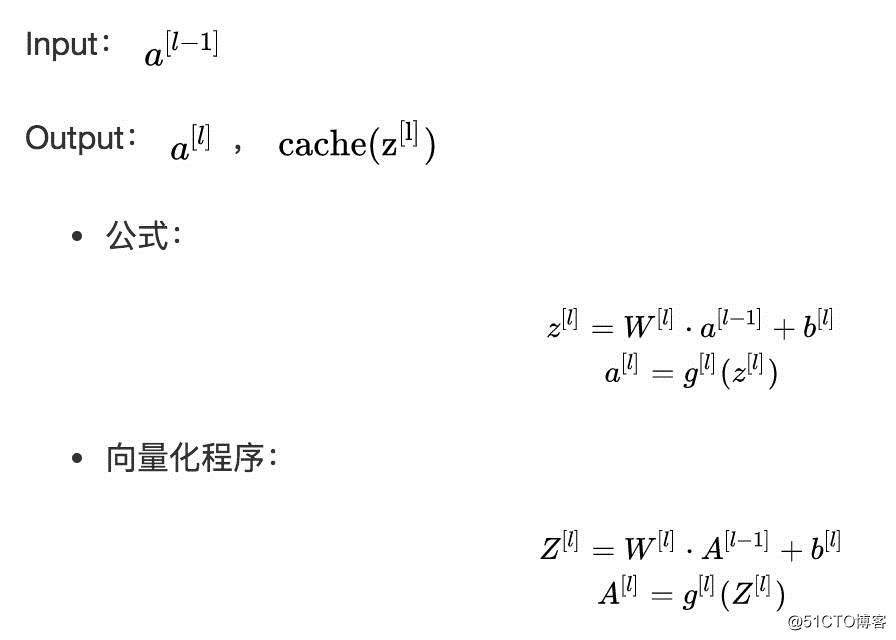

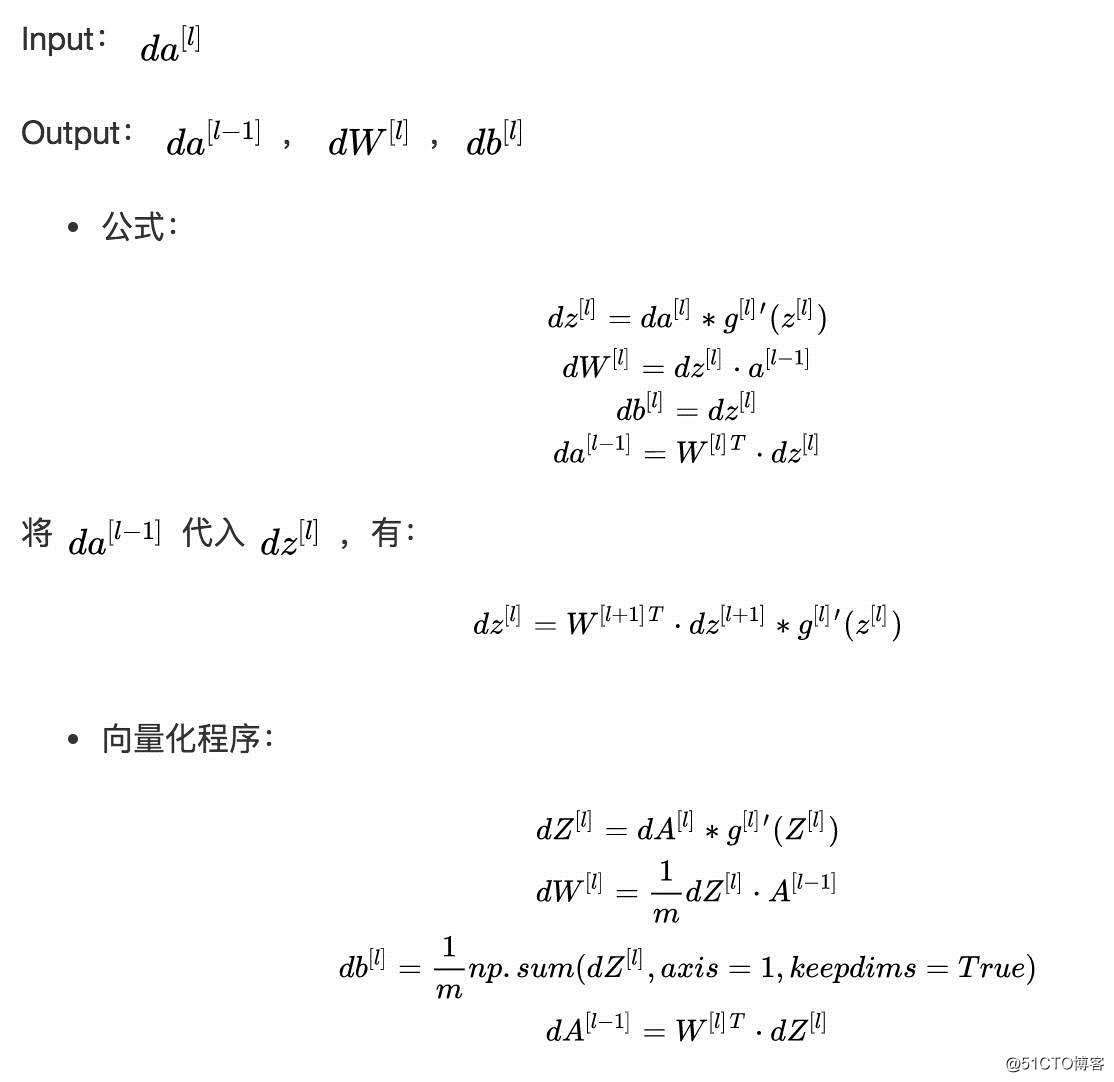

前向和反向传播

前向传播(Forward propagation)

反向传播(Backward propagation)

4

参数和超参数

参数:

参数即是我们在过程中想要模型学习到的信息,W,b

超参数:

更多超参数的调整和学习吴恩达老师将在下一个主题中介绍。

csdn博客:http://blog.csdn.net/koala_tree/article/details/78087711

专栏:https://zhuanlan.zhihu.com/p/29738823

推荐阅读:

精选干货|近半年干货目录汇总

干货|吴恩达 DeepLearning.ai 课程提炼笔记(1-2)神经网络和深度学习 --- 神经网络基础

干货|吴恩达 DeepLearning.ai 课程提炼笔记(1-3)神经网络和深度学习 --- 浅层神经网络

欢迎关注公众号学习交流~

欢迎加入交流群交流学习