总结一下关于文本相似性的几种方法

无监督,不使用额外的标注数据

词移距离

词移距离使用两文本间的词嵌入,测量其中一文本中的单词在语义空间中移动到另一文本单词所需要的最短距离。

average word vectors

简单的对句子中的所有词向量取平均,是一种简单有效的方法,

缺点:没有考虑到单词的顺序,只对15个字以内的短句子比较有效,丢掉了词与词间的相关意思,无法更精细的表达句子与句子之间的关系。

tfidf-weighting word vectors

指对句子中的所有词向量根据tfidf权重加权求和,是常用的一种计算sentence embedding的方法,在某些问题上表现很好,相比于简单的对所有词向量求平均,考虑到了tfidf权重,因此句子中更重要的词占得比重就更大。

缺点:没有考虑到单词的顺序

bag of words

这种方法对于短文本效果很差,对于长文本效果一般,通常在科研中用来做baseline。缺点:1.没有考虑到单词的顺序,2.忽略了单词的语义信息。

LDA

计算出一片文档或者句子的主题分布。也常常用于文本分类任务

smooth inverse frequency[1]

从语义上来讲,求一句话中词嵌入的平均值似乎给与不相关的单词太多权重了。而Smooth Inverse Frequency试着用两种方法解决这一问题:

1、加权:就像上文用的TF-IDF,SIF取句中词嵌入的平均权重。每个词嵌入都由a/(a + p(w))进行加权,其中a的值经常被设置为0.01,而p(w)是词语在语料中预计出现的频率。

2、常见元素删除:接下来,SIF计算了句子的嵌入中最重要的元素。然后它减去这些句子嵌入中的主要成分。这就可以删除与频率和句法有关的变量,他们和语义的联系不大。

最后,SIF使一些不重要的词语的权重下降,例如but、just等,同时保留对语义贡献较大的信息

LSI或LSA

LSI是处理相似度的,基于SVD分解,用于特征降维,LSI求解出来的相似度跟topic相关性很强,而句子结构等信息较少。顺便说下,句子中词的顺序是不会影响LSI相似度结果的。

BERT

像最近特别火的预训练语言模型,通过大规模的语料和复杂的模型去捕获句子之间的语义信息,可以用来评价文本之间的相似性。

有监督,需要额外的标注数据

分类任务

例如训练一个CNN的文本分类器[2],取最后一个hidden layer的输出作为sentence embedding,其实就是取分类器的前几层作为预训练的encoder

sentence pair的等价性/等义性判定[3]

这种方法的好处是不仅可以得到sentence embedding,还可以直接学习到距离度量函数里的参数

doc2vec(paragraph2vec, sentence embeddings)

一种非监督式算法,可以获得 sentences/paragraphs/documents 的向量表达,是 word2vec 的拓展。学出来的向量可以通过计算距离来找 sentences/paragraphs/documents 之间的相似性,可以用于文本聚类,对于有标签的数据,还可以用监督学习的方法进行文本分类,例如经典的情感分析问题。

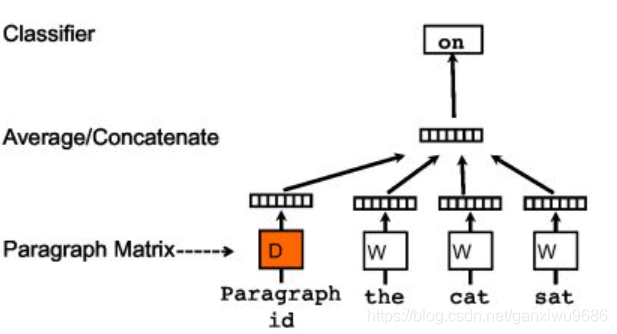

训练过程中新增了paragraph id,即训练语料中每个句子都有一个唯一的id。paragraph id 和普通的word一样,先是映射成一个向量,即paragraph vector。paragraph vector与word vector的维数虽一样,但是来自于两个不同的向量空间。在之后的计算里,paragraph vector与word vector累加或者连接起来,作为输出层softmax的输入。在一个句子或者文档的训练过程中,paragraph id保持不变,共享同一个paragraph vector,相当于每次在预测单词的概率时,都利用了整个句子的语义。

DM(Distributed Memory,分布式内存):DM试图在给定前面部分的词和paragraph向量来预测后面单独的单词,即使文本中的语境在变化,但paragraph向量不会变换,并且能保存词序信息。

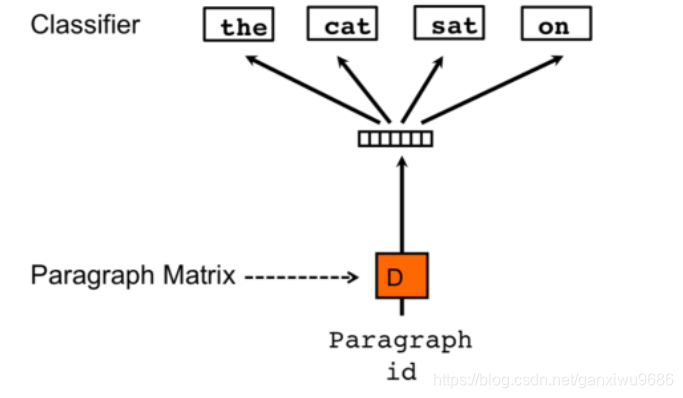

分布式词袋(DBOW):利用paragraph来预测段落中一组随机的词.

sentence2vec相对于word2vec的skip-gram模型,区别点为:在sentence2vec里,输入都是paragraph vector,输出是该paragraph中随机抽样的词。

参考文献

[1] Sanjeev Arora, et al. 2017. A Simple but Tough-to-Beat Baseline for Sentence Embeddings

[2] Yoon Kim. 2014. Convolutional Neural Networks for Sentence Classification

[3] Jonas Mueller, et al. 2016. Siamese Recurrent Architectures for Learning Sentence Similarity