1. DBSCAN概述

DBSCAN(Density-Based Spatial Clustering of Applications with Noise)是基于密度的聚类算法,本算法将具有足够高密度的区域划分为簇,并可以发现任何形状的聚类。

● ε邻域:给定对象半径ε内的区域成为该对象的ε邻域

● 核心对象:如果给定ε邻域内的样本点数大于等于Minpoints,则该对象为核心对象。

● 直接密度可达:给定一个对象集合D,如果p在q的ε邻域内,且q是一个核心对象,则我们说对象p从q触发是可以直接密度可达的(directly density-reachable)。

● 密度可达:集合D,存在一个对象链p1,p2…pn,p1=q,pn=p,pi+1是从pi关于ε和Minpoints直接密度可达,则称点p是从q关于ε和Minpoints密度可达的。

● 密度相连:集合D存在点o,使得点p、q是从o关于ε和Minpoints密度可达的,那么点p、q是关于ε和Minpoints密度相连的。

2. 算法流程

1)指定合适的ε和Minpoints。

2)计算所有样本点,如果点p的ε邻域里有超过Minpoints个点,则创建一个以p为核心的新簇。

3)反复寻找这些核心点直接密度可达(之后可能是密度可达)的点,将其加入到相应的簇,对于核心点发生“密度相连”状况的簇,给予合并。

4)当没有新的点可以被添加到任何簇时,算法结束。

3. 算法分析

● 缺点:

1)当数据量增大时,要求较大的内存支持I/O消耗也很大。

2) 当空间聚类的密度不均匀、聚类间距差相差很大时,聚类质量较差。

● 和K-Means算法比较:

1)DBSCAN不需要输入聚类个数。

2)聚类簇的形状没有要求。

3)可以在需要时输入过滤噪声的参数。

4. 代码实现

注:数据集在文章末尾

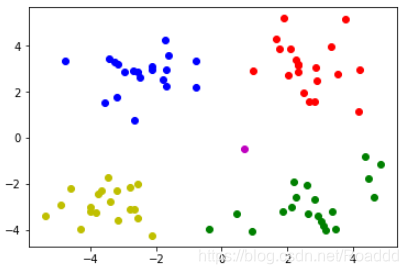

(1)DBSCAN① – sklearn

from sklearn.cluster import DBSCAN

import numpy as np

import matplotlib.pyplot as plt

# 载入数据

data = np.genfromtxt("kmeans.txt", delimiter=" ")

# 训练模型

# eps距离阈值,min_samples核心对象在eps领域的样本数阈值

model = DBSCAN(eps=1.5, min_samples=4)

model.fit(data)

result = model.fit_predict(data)

print(result)

输出:

# 画出各个数据点,用不同颜色表示分类

mark = ['or', 'ob', 'og', 'oy', 'ok', 'om']

for i,d in enumerate(data):

plt.plot(d[0], d[1], mark[result[i]])

plt.show()

输出:

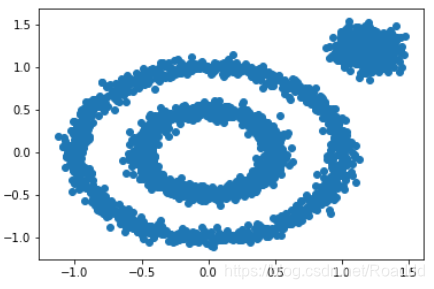

(2)DBSCAN② – sklearn

import numpy as np

import matplotlib.pyplot as plt

from sklearn import datasets

x1, y1 = datasets.make_circles(n_samples=2000, factor=0.5, noise=0.05)

x2, y2 = datasets.make_blobs(n_samples=1000, centers=[[1.2,1.2]], cluster_std=[[.1]])

x = np.concatenate((x1, x2))

plt.scatter(x[:, 0], x[:, 1], marker='o')

plt.show()

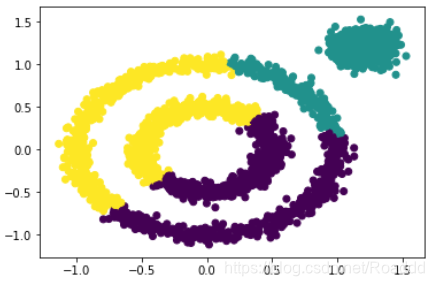

# 使用K-Means

from sklearn.cluster import KMeans

y_pred = KMeans(n_clusters=3).fit_predict(x)

plt.scatter(x[:, 0], x[:, 1], c=y_pred)

plt.show()

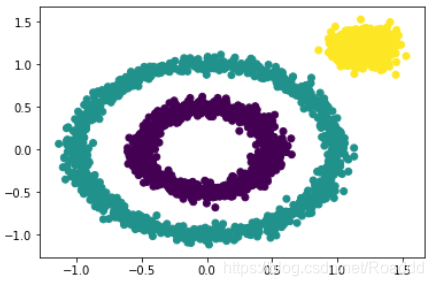

# 使用DBSCAN

from sklearn.cluster import DBSCAN

y_pred = DBSCAN(eps = 0.2, min_samples=50).fit_predict(x)

plt.scatter(x[:, 0], x[:, 1], c=y_pred)

plt.show()

数据集:“kmeans.txt”:

1.658985 4.285136

-3.453687 3.424321

4.838138 -1.151539

-5.379713 -3.362104

0.972564 2.924086

-3.567919 1.531611

0.450614 -3.302219

-3.487105 -1.724432

2.668759 1.594842

-3.156485 3.191137

3.165506 -3.999838

-2.786837 -3.099354

4.208187 2.984927

-2.123337 2.943366

0.704199 -0.479481

-0.392370 -3.963704

2.831667 1.574018

-0.790153 3.343144

2.943496 -3.357075

-3.195883 -2.283926

2.336445 2.875106

-1.786345 2.554248

2.190101 -1.906020

-3.403367 -2.778288

1.778124 3.880832

-1.688346 2.230267

2.592976 -2.054368

-4.007257 -3.207066

2.257734 3.387564

-2.679011 0.785119

0.939512 -4.023563

-3.674424 -2.261084

2.046259 2.735279

-3.189470 1.780269

4.372646 -0.822248

-2.579316 -3.497576

1.889034 5.190400

-0.798747 2.185588

2.836520 -2.658556

-3.837877 -3.253815

2.096701 3.886007

-2.709034 2.923887

3.367037 -3.184789

-2.121479 -4.232586

2.329546 3.179764

-3.284816 3.273099

3.091414 -3.815232

-3.762093 -2.432191

3.542056 2.778832

-1.736822 4.241041

2.127073 -2.983680

-4.323818 -3.938116

3.792121 5.135768

-4.786473 3.358547

2.624081 -3.260715

-4.009299 -2.978115

2.493525 1.963710

-2.513661 2.642162

1.864375 -3.176309

-3.171184 -3.572452

2.894220 2.489128

-2.562539 2.884438

3.491078 -3.947487

-2.565729 -2.012114

3.332948 3.983102

-1.616805 3.573188

2.280615 -2.559444

-2.651229 -3.103198

2.321395 3.154987

-1.685703 2.939697

3.031012 -3.620252

-4.599622 -2.185829

4.196223 1.126677

-2.133863 3.093686

4.668892 -2.562705

-2.793241 -2.149706

2.884105 3.043438

-2.967647 2.848696

4.479332 -1.764772

-4.905566 -2.911070