现有的3dBox的检测算法

大部分都是直接回归pose

a)将3D模型遍历姿态参数,投影到2D,进行HOG特征匹配;

b)将3D模型遍历姿态参数,投影到2D,进行shape匹配;

c)CNN直接回归pose参数

d)CNN关键点检测,然后pnp求解姿态

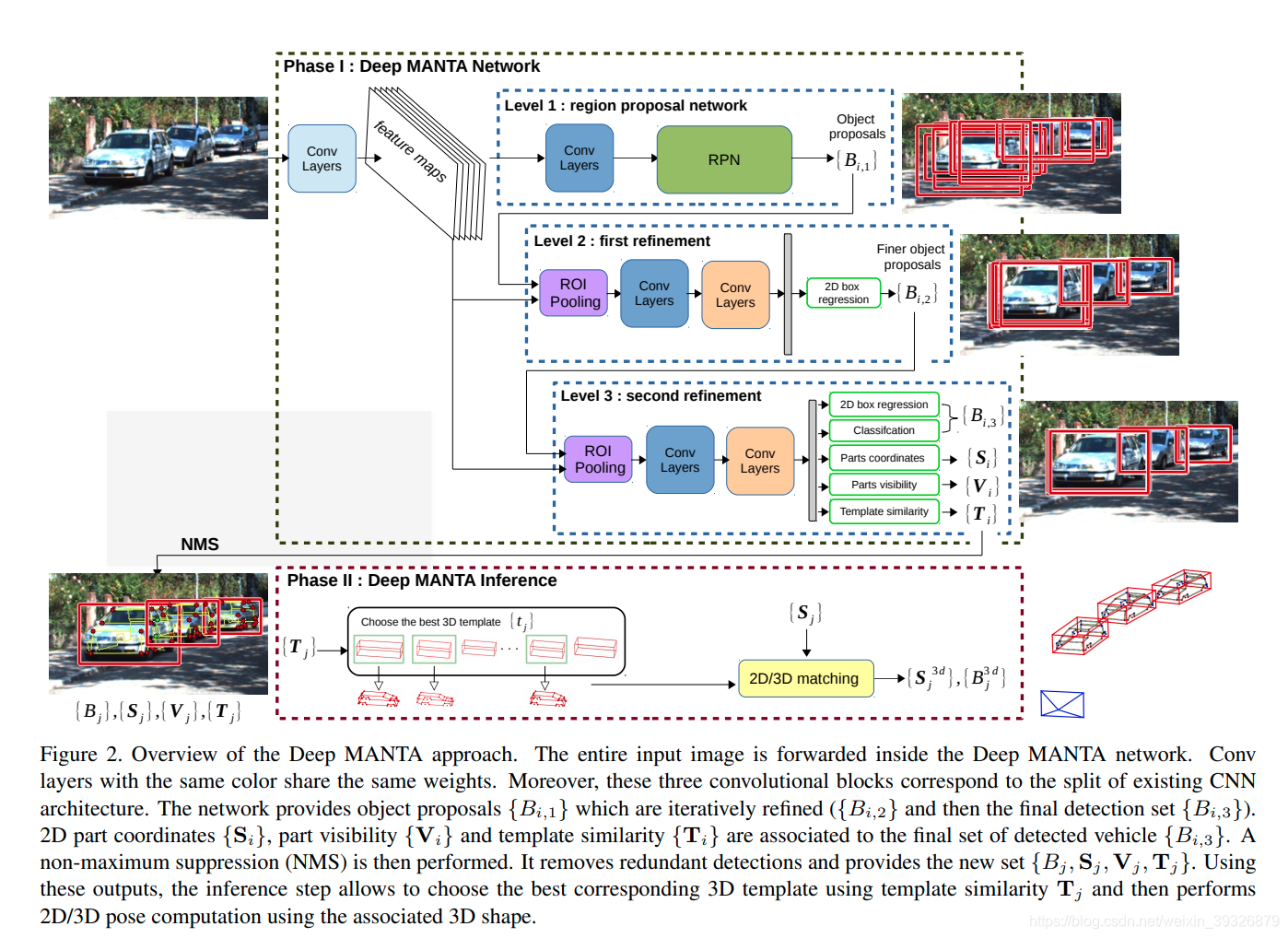

DeepManta

图文将文章的算法将的清清楚楚!

输入图片,经过三个共享参数的卷积模块获得关键点,可见性,2D框,模板相似度。接下来将以上这些几何送入NMS,去掉冗余的部分,然后选择用模板相似度选择最匹配的模板,通过关键点(2D/3D关键点pnp)求解3Dbox;

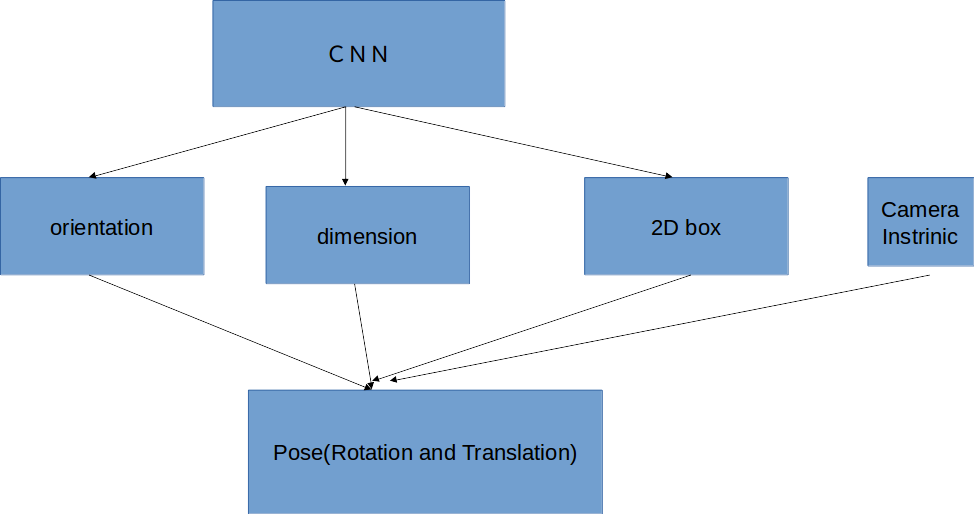

3D Bounding Box Estimation Using Deep Learning and Geometry,CVPR,2017

回归方向角及dimension、2Dbox

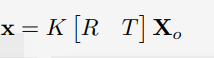

利用相机内参、3D-2D透视变换约束求解R、T(

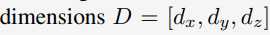

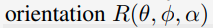

关于3Dbox,我们用以下的符号进行表示:

关于3Dbox,我们用以下的符号进行表示:

然后,我们有以下限制:

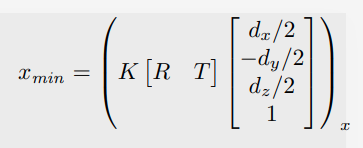

假设物体坐标系的原点位于3D边界框的中心并且物体尺寸D是已知的,则3D边界框顶点的坐标可以简单地通过X1 = [dx/2; dy/2; dz/2]T , X2 = [-dx/2; dy/2; dz/2]T , … ,X8 = [-dx/2; -dy/2; -dz/2]T 进行描述。3D边界框紧密地投影到2D检测窗口中的这种约束要求2D边界框的每一侧被至少一个3Dbox的corner的投影连接。举个例子,假设3D corner X0 = [dx/2; -dy/2; dz/2]T 用坐标xmin触摸2D边界框的左侧。这种点对边的对应约束导致了以下等式

其中(.)x是指透视投影的x坐标。可以为剩余的2Dbox side参数xmax ; ymin; ymax .导出类似的方程。总的来说,2D边界框的边在3D边界框上提供了四个约束。 这不足以约束九个自由度(DoF)(三个用于平移,三个用于旋转,三个用于盒子尺寸)。 我们可以从盒子的视觉外观估计出几种不同的几何属性,以进一步约束3Dbox。 主要标准是它们应与视觉外观紧密联系,并进一步限制最终的3D box。

这个3D限制有点复杂,太难讲清楚了

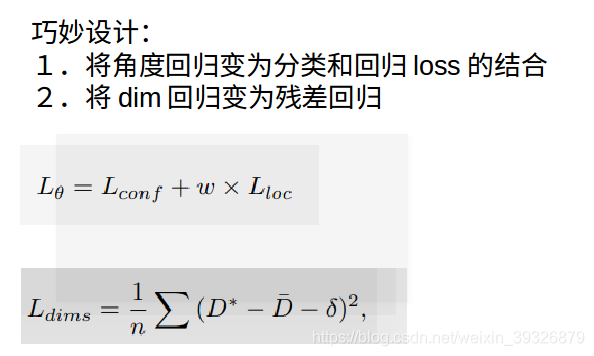

设计精巧之处: