目录

1--常量内存

CUDA C支持使用常量内存,其用于保存核函数执行期间不发生变化的数据;使用常量内存可以有效节省内存带宽,其原因在于:

对常量内存的单次读操作可以广播到其他临近的线程,节约临近线程的读取操作;

常量内存的数据将被缓存,对相同地址的连续读操作不会产生额外的内存通信量;

在CUDA架构中,线程束是指一个包含32个线程的集合;当处理常量内存时,NVIDIA硬件将单次内存读取操作广播到半线程束中(16个线程);当半线程束的每个线程都从常量内存相同地址读取数据时,GPU只会产生一次读取请求并将数据广播到每个线程中;因此,当从常量内存中读取大量数据时,产生的内存流量仅为使用全局变量的1/16;

// 在变量前面加上__constant__修饰符来声明常量内存

// 将常量内存从主机内存复制到 GPU 中,使用cudaMemcpyToSymbol()2--事件

CUDA事件的本质是一个 GPU 时间戳,其在用户指定的时间点上被记录;

扫描二维码关注公众号,回复:

14869921 查看本文章

// 使用 cudaEvent_t 声明事件

cudaEvent_t start;

// 使用 cudaEventCreate() 记录事件

cudaEventCreate(&start);

// 使用 cudaEventRecord() 记录事件

cudaEventRecord(start, 0)统计一段代码的执行时间,需要创建一个起始事件和一个结束事件:

cudaEvent_t start, stop;

cudaEventCreate(&start);

cudaEventCreate(&stop);

cudaEventRecord(start, 0);

// Code..

cudaEventRecord(stop, 0);

cudaEventSynchronize(stop);cudaEventSynchronize() 用于事件同步,其阻塞后面的语句直到事件结束;

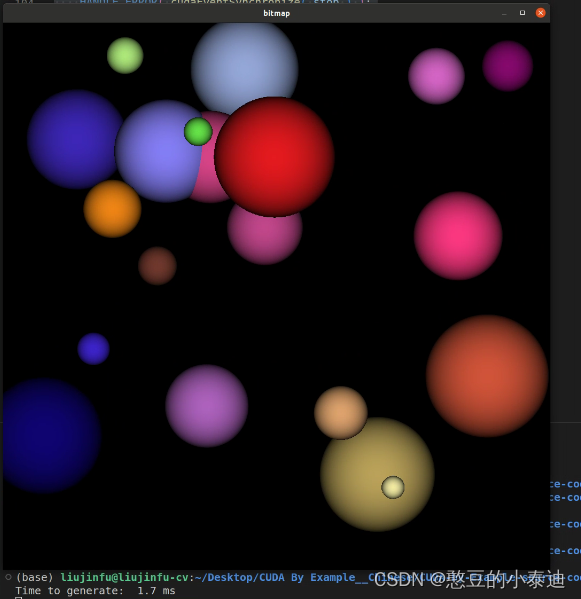

3--光线跟踪实例

#include "cuda.h"

#include "../common/book.h"

#include "../common/cpu_bitmap.h"

#define DIM 1024

#define rnd( x ) (x * rand() / RAND_MAX)

#define INF 2e10f

struct Sphere {

float r,b,g;

float radius;

float x,y,z;

__device__ float hit( float ox, float oy, float *n ) {

float dx = ox - x;

float dy = oy - y;

if (dx*dx + dy*dy < radius*radius) {

float dz = sqrtf( radius*radius - dx*dx - dy*dy );

*n = dz / sqrtf( radius * radius );

return dz + z;

}

return -INF;

}

};

#define SPHERES 20

__constant__ Sphere s[SPHERES];

__global__ void kernel( unsigned char *ptr ) {

// map from threadIdx/BlockIdx to pixel position

int x = threadIdx.x + blockIdx.x * blockDim.x;

int y = threadIdx.y + blockIdx.y * blockDim.y;

int offset = x + y * blockDim.x * gridDim.x;

float ox = (x - DIM/2);

float oy = (y - DIM/2);

float r=0, g=0, b=0;

float maxz = -INF;

for(int i=0; i<SPHERES; i++) {

float n;

float t = s[i].hit( ox, oy, &n );

if (t > maxz) {

float fscale = n;

r = s[i].r * fscale;

g = s[i].g * fscale;

b = s[i].b * fscale;

maxz = t;

}

}

ptr[offset*4 + 0] = (int)(r * 255);

ptr[offset*4 + 1] = (int)(g * 255);

ptr[offset*4 + 2] = (int)(b * 255);

ptr[offset*4 + 3] = 255;

}

// globals needed by the update routine

struct DataBlock {

unsigned char *dev_bitmap;

};

int main( void ) {

DataBlock data;

// capture the start time

cudaEvent_t start, stop;

HANDLE_ERROR( cudaEventCreate( &start ) );

HANDLE_ERROR( cudaEventCreate( &stop ) );

HANDLE_ERROR( cudaEventRecord( start, 0 ) );

CPUBitmap bitmap( DIM, DIM, &data );

unsigned char *dev_bitmap;

// allocate memory on the GPU for the output bitmap

HANDLE_ERROR( cudaMalloc( (void**)&dev_bitmap,

bitmap.image_size() ) );

// allocate temp memory, initialize it, copy to constant

// memory on the GPU, then free our temp memory

Sphere *temp_s = (Sphere*)malloc( sizeof(Sphere) * SPHERES );

for (int i=0; i<SPHERES; i++) {

temp_s[i].r = rnd( 1.0f );

temp_s[i].g = rnd( 1.0f );

temp_s[i].b = rnd( 1.0f );

temp_s[i].x = rnd( 1000.0f ) - 500;

temp_s[i].y = rnd( 1000.0f ) - 500;

temp_s[i].z = rnd( 1000.0f ) - 500;

temp_s[i].radius = rnd( 100.0f ) + 20;

}

HANDLE_ERROR( cudaMemcpyToSymbol( s, temp_s,

sizeof(Sphere) * SPHERES) );

free( temp_s );

// generate a bitmap from our sphere data

dim3 grids(DIM/16,DIM/16);

dim3 threads(16,16);

kernel<<<grids,threads>>>( dev_bitmap );

// copy our bitmap back from the GPU for display

HANDLE_ERROR( cudaMemcpy( bitmap.get_ptr(), dev_bitmap,

bitmap.image_size(),

cudaMemcpyDeviceToHost ) );

// get stop time, and display the timing results

HANDLE_ERROR( cudaEventRecord( stop, 0 ) );

HANDLE_ERROR( cudaEventSynchronize( stop ) );

float elapsedTime;

HANDLE_ERROR( cudaEventElapsedTime( &elapsedTime,

start, stop ) );

printf( "Time to generate: %3.1f ms\n", elapsedTime );

HANDLE_ERROR( cudaEventDestroy( start ) );

HANDLE_ERROR( cudaEventDestroy( stop ) );

HANDLE_ERROR( cudaFree( dev_bitmap ) );

// display

bitmap.display_and_exit();

}