基于encoder-decoder的非自回归Transformer时间序列预测Python程序

特色:1、单变量,多变量输入,自由切换

2、单步预测,多步预测,自动切换

3、基于Pytorch架构

4、多个评估指标(MAE,MSE,R2,MAPE等)

5、数据从excel文件中读取,更换简单

6、标准框架,数据分为训练集、验证集,测试集

全部完整的代码,保证可以运行的代码看这里。

http://t.csdn.cn/obJlC![]() http://t.csdn.cn/obJlC

http://t.csdn.cn/obJlC

!!!如果第一个链接打不开,请点击个人首页,查看我的个人介绍。

(搜索到的产品后,点头像,就能看到全部代码)

黑科技小土豆的博客_CSDN博客-深度学习,32单片机领域博主

1、基于encoder-decoder的非自回归Transformer模型背景简介

Transformer是近年来应用广泛的神经网络模型,其基于自注意力机制实现了非常优秀的性能,能够很好地应用于序列到序列的任务,如机器翻译,文本摘要等。

而在非自回归模型中,模型输出的每个时间步都不依赖于之前的输出,这与传统的自回归模型有所不同。这种模型结构的优点是推理速度快,在准确率与速度之间权衡的情况下,非自回归模型会更加适用。

同时,模型采用了encoder-decoder架构,encoder通过自注意力网络将输入中的每个信息进行编码,decoder负责根据encoder传递的信息对其进行解码,最终输出预测结果。这种结构适用于序列到序列的任务,如机器翻译、对话系统等。非自回归模型可以避免序列逐步生成每个元素的高计算复杂度,加速推理速度。

因此,基于encoder-decoder的非自回归Transformer模型结合了Transformer的自注意力机制和非自回归模型的快速推理,能够更好地解决序列到序列的任务,并加快推理速度。

2、基于encoder-decoder的非自回归Transformer模型优点总结

本模型的优点有:

- Transformer网络具有非常好的性能表现,能够很好地应用于序列到序列的任务,如机器翻译,文本摘要等;

- 非自回归模型能够更快地进行推理,在对速度有要求的任务中表现更优;

- encoder-decoder架构适用于序列到序列的任务,可以更好地处理输入和输出序列中的信息,提高模型的预测准确率。

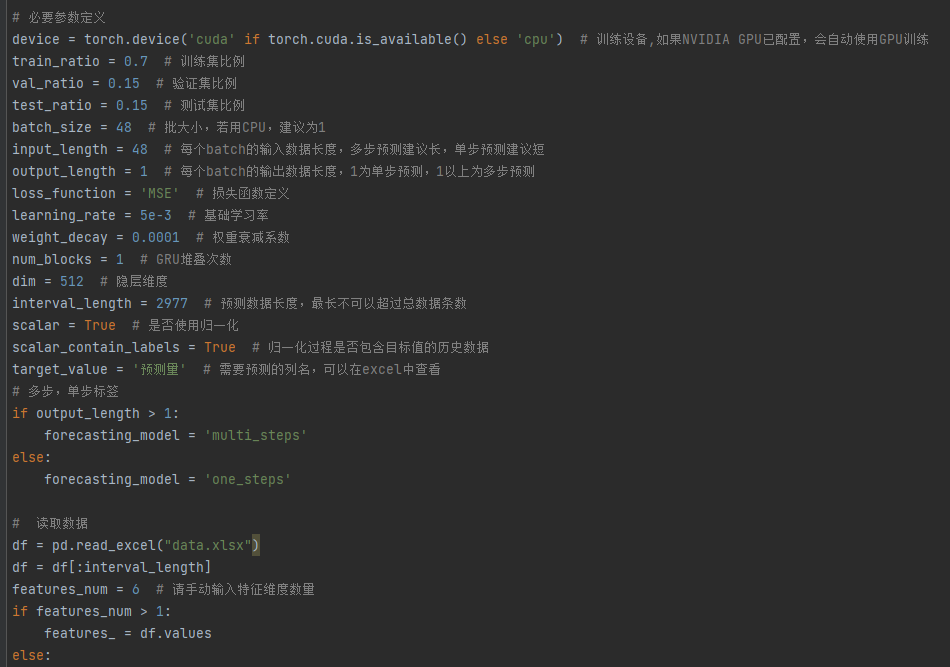

train_ratio = 0.7 # 训练集比例

val_ratio = 0.15 # 验证集比例

test_ratio = 0.15 # 测试集比例

input_length = 48 # 输入数据长度,多步预测建议长,单步预测建议短

output_length = 1 # 输出数据长度,1为单步预测,1以上为多步预测 请注意,随着输出长度的增长,模型训练时间呈指数级增长

learning_rate = 0.1 # 学习率

estimators = 100 # 迭代次数

max_depth = 5 # 树模型的最大深度

interval_length = 2000 # 预测数据长度,最长不可以超过总数据条数

scalar = True # 是否使用归一化

scalar_contain_labels = True # 归一化过程是否包含目标值的历史数据

target_value = 'load' # 需要预测的列名,可以在excel中查看