注意:贝叶斯是一个伟大的发明,给人工智能以及社会发展带来了巨大贡献**。

引言

随着对贝叶斯的不断应用,对贝叶斯有了从新的认识,以前认为贝叶斯知识用来解决二分类问题,是大错特错发现贝叶斯是一种很厉害的理论,对于现在的人工智能以至于整个统计学都有着巨大贡献,贝叶斯这个人是英国业余数学家,他提出的理论主要是用新产生的客观事物或观点来更新或修正旧的新年观点,比如你语言以后人工智能将会多牛逼(这就是你的先言 即先验概率),只说不行,需要根据客观事实来支撑你的观点,如经过调查的确大数据应用广泛了起来,那么你可以利用这一数据来更新你最初的断言,形成新的概率,即后验概率。

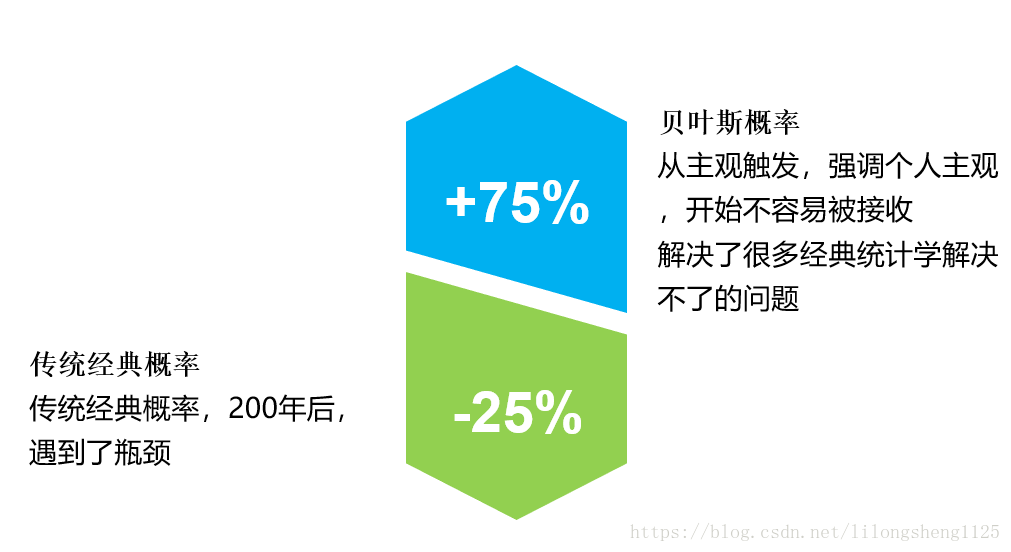

这一观点思路对后面统计学的发展起了决定性作用,因为传统的经典统计学有其自身的范围,例如明天是否下雨呢,天气预报现在经常报道40%可能性下雨,这个理解起来你是觉的会下雨还是不会下雨,结果只有下了才会知道,如果不深入挖掘你可能会想不下雨的可能性小,这个概率是不是只是给我们自己的一个感官认识,不能够量化。

传统统计学与贝叶斯统计学对比图,如下:

场景介绍

贝叶斯可以说在我们生活中无处不在,大到国家世界,小到粗茶淡饭,都能找到贝叶斯的身影,我们先抽取几个典型的实例说一下。

黑白求

- 正常

假如一个盒子里面已知有黑球6个,白球4个,先闭眼去拿取一个球,问你黑球和白球比例多少?相信大家都知道6/4 - 倒过来

现同样有一个盒子,不知道里面黑白求比例,每次随机拿一个球记录是黑球或白球,让你计算拿出来是黑球或白球概率?

疾病诊断

AlphaGo

这有没有像知道结果了,求原因的概率问题,也就是通常说的“逆概率问题”,并且随着每次新拿出来的球的结果会不断去更新这个概率值,相信结果会越来越接近真实值,可以迭代求解。

贝叶斯公式及发展历程

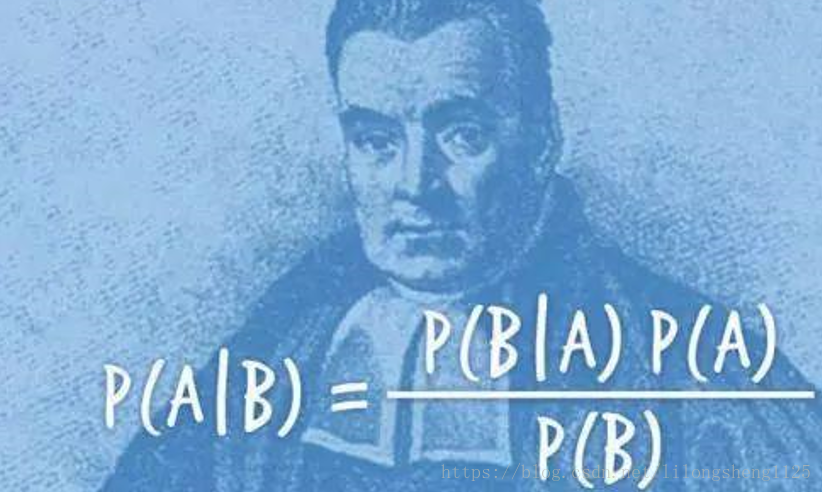

Thomas Bayes

贝叶斯本人以及公式,如下:

该公式中P(A) 表示先验概率,P(A|B) 叫后验概率 即在B事件发生的情况下,事件A发生的概率,P(B)叫标准化常量。

几何证明

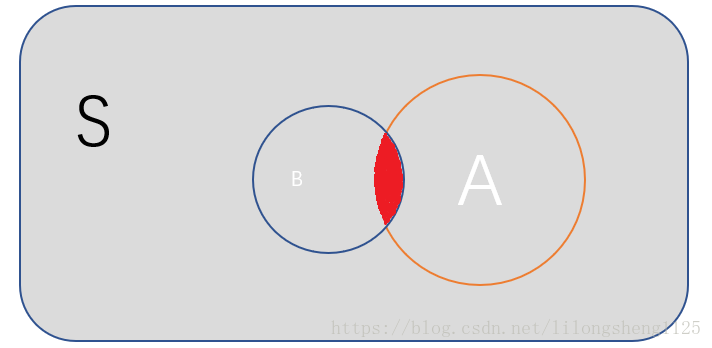

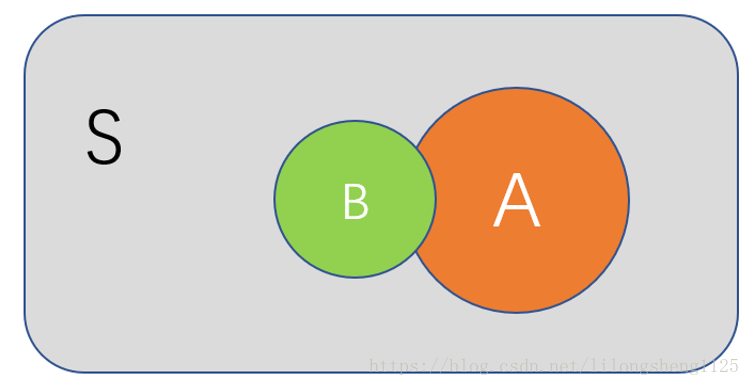

先解释几个概念,数学上的集合概念其实和某事件是一样的,例如一个集合有1、2、3、4、5、6六个数字,可以赋予他们含义表示扔一个骰子的点数,现在设S是整个样本空间集合,另外两个集合A 、B,AB都被包含在集合S中,可以利用图形来画一下,如下:

图中橘黄色的是代表事件A,绿色的代表事件B,中间红色即两件事情相交的部分设为C,三个事件的样本个数依次为s、a、b,转换思路利用样本个数或面积证明公式:

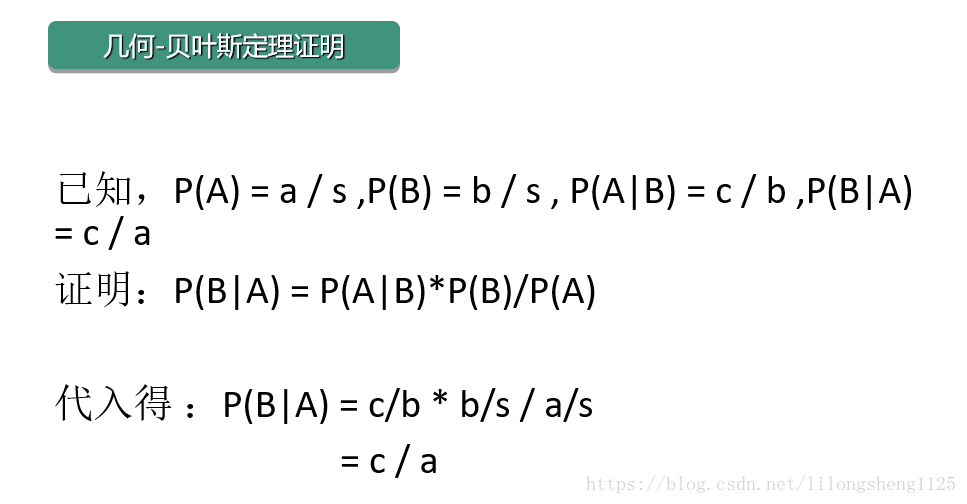

证明如下:

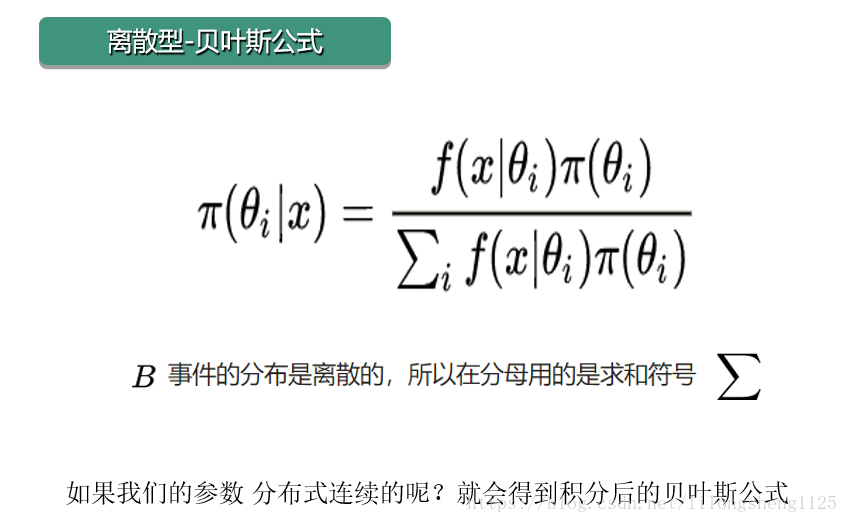

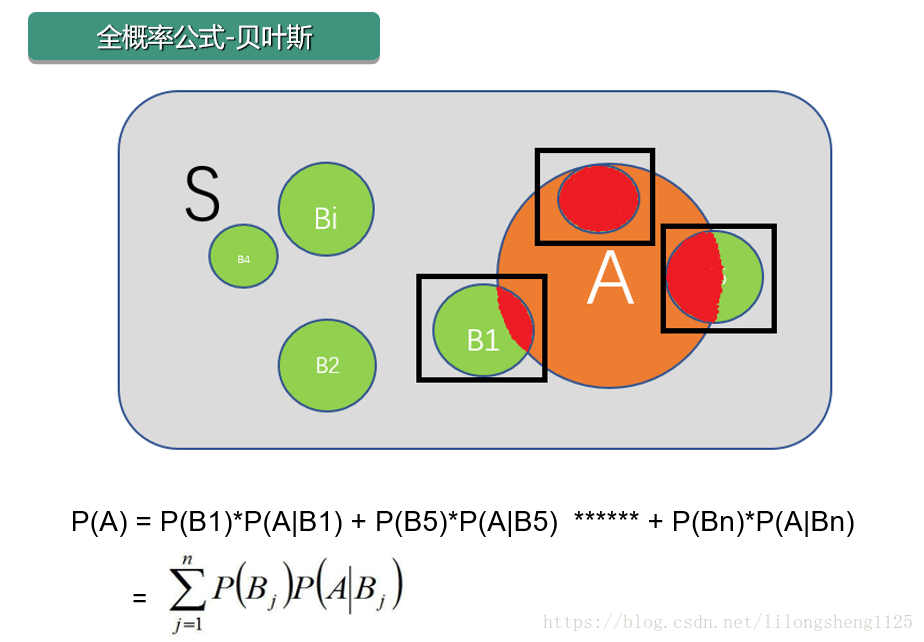

上面我们证明了,两个事件的条件关系概率,我们把两个事件A B之间的事件,推广到其它多个事件,如下:

在上面这张图中

其它应用

自然语言处理、计算机视频等领域也应用了贝叶斯概率,其它听懂别人说话我们可以理解为猜测的过程,如某人A说了话通过空气传播到机器计算机中,计算器接收到信号之后需要做解码工作,解码也就是猜测接收到信号的所要表达信息的最大可能性意思是啥,这里面会涉及到隐含马尔科夫模型,计算每一个词语的概率。

贝叶斯扩展可以延伸到贝叶斯网络,贝叶斯网络是更加复杂的结构可以处理更复杂的问题,在后面的文章中我们会详细介绍如何应用贝叶斯网络模型解决问题。

总结

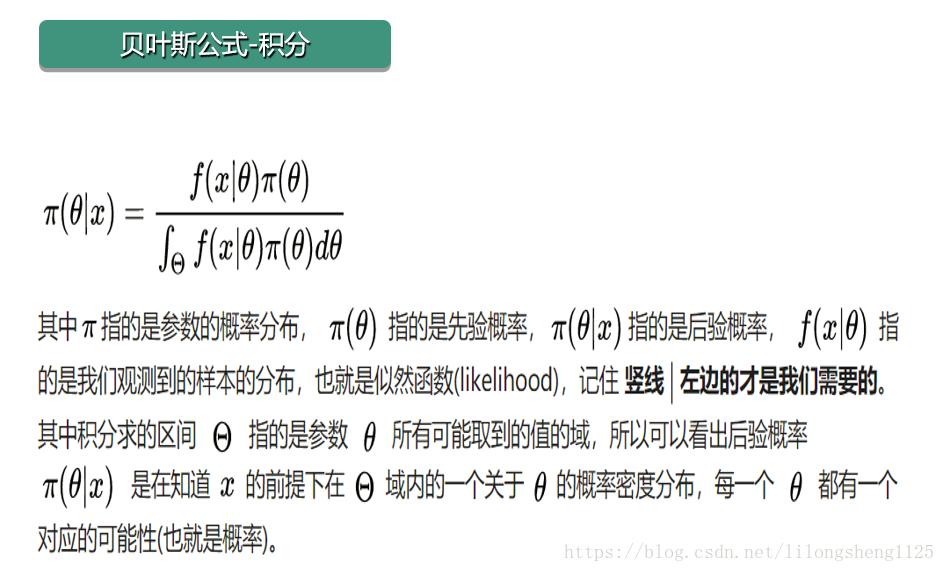

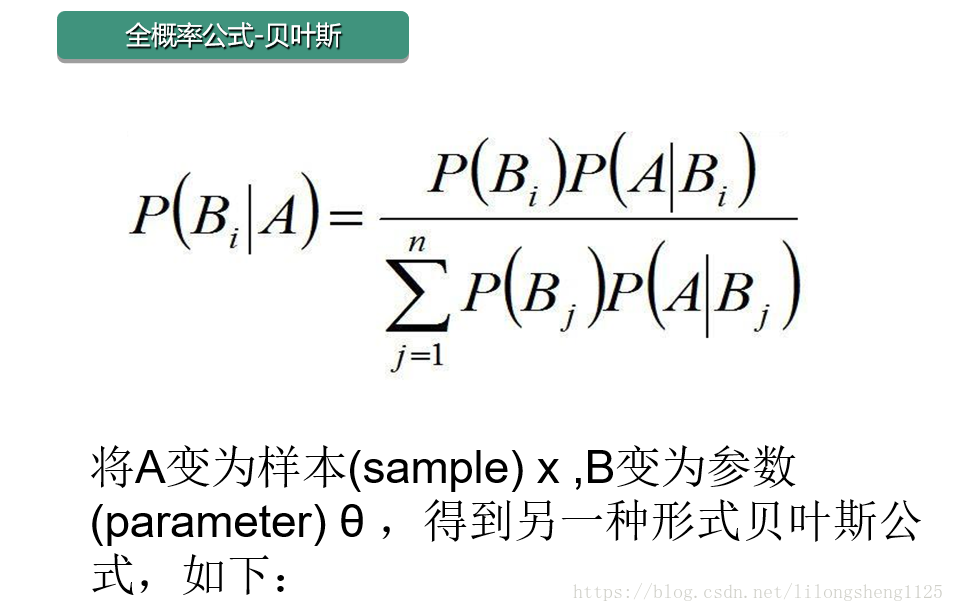

我们来谈一谈对贝叶斯积分公式的理解,在积分公式中有一个似然函数(likelihood),我们已经知道贝叶斯概率是对先验概率不断修正的过程,在想一想模型训练的过程式什么呢?往往是求最佳回归系数,我们的求解过程式先假设一组初始化的回归系数,继而通过贝叶斯来不断优化,不断计算后延概率,其实我们是用样本数据来不断更新我们的回归系数。

在已知训练集的情况下,样本x就不再变化,这个时候回归系数是动态变化的,如此一来回归系数有很多个值,如果变化很慢会形成曲线,这就是表示估计系数与样本之间的关系函数叫做似然估计函数或者似然函数。

换句话说借助于贝叶斯概率来预测样本与参数之间关系的映射关系,成为参数估计或似然函数。