1.概述:

QLearning基于值函数的方法,不同与policy gradient的方法,Qlearning是预测值函数,通过值函数来选择

值函数最大的action,而policy gradient直接预测出action。

2一些定义

2.1值函数

Given an actor π, it evaluates how good the actor is

有2种值函数,V(S) 、Q(s,a).

2.1.1 V(S)

有2种衡量的方法:

MC方法只能等玩完一个episode才能进行统计评价,效率比较低。

TD方法可以每玩一步就更新一次。

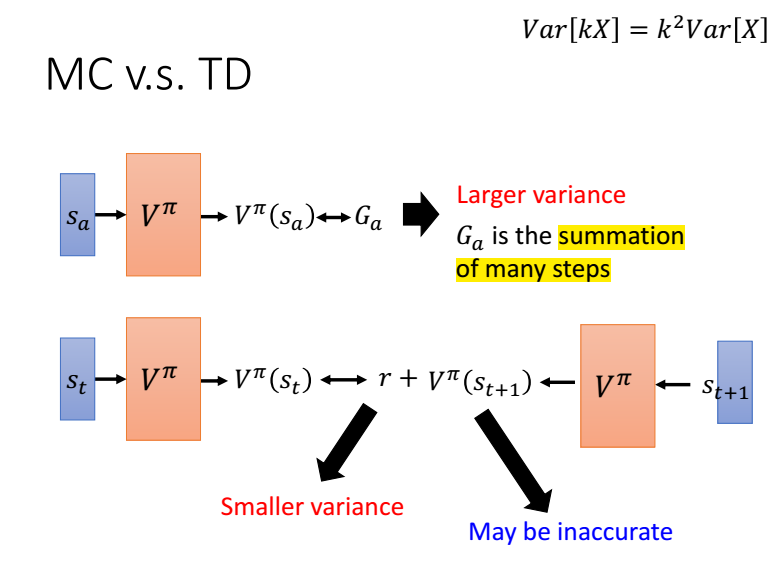

mc与td对比,mc需要估计的是一个episode的值函数,方差比较大,而td是与时间相关的,只有r是需要估计的,方差比较小。

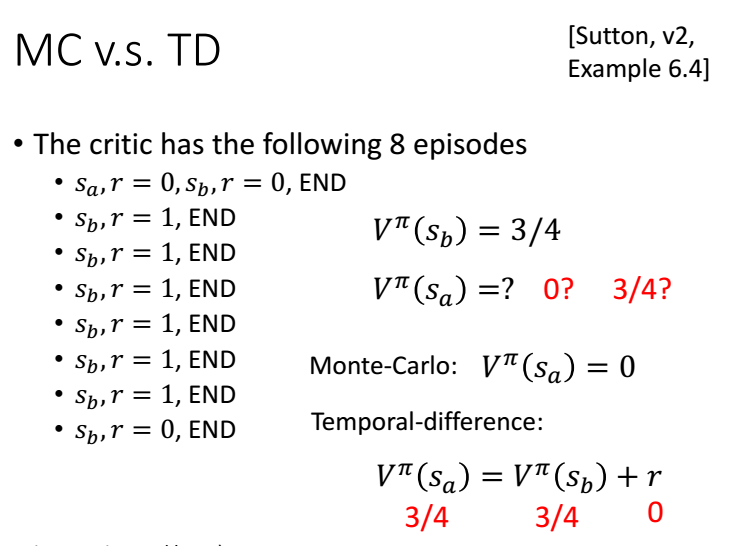

下面看一下例子:

V(Sb)=6/8=1

MC: V(Sa)=0/2=0

TD: V(Sa)=V(Sb)+0=3/4

2.1.2 Q(s,a)

我们可以评估,在当前状态s,采取行动a,在接下来的游戏中获得得奖励累计和的期望为Q(s,a)。但在接下来的游戏中,

不一定采取行动a,而是采取Q值最大的行动。

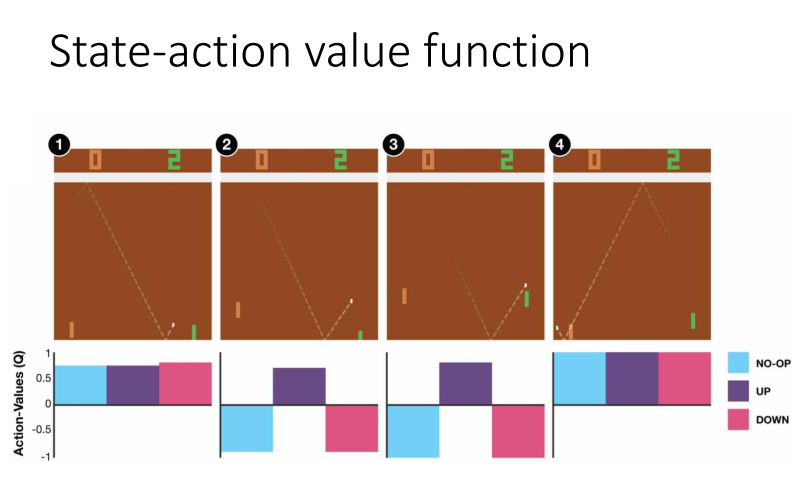

下图中1,无论采取那个行动都无所谓,因为离球还很远,而图2离球比较近了,我们需要向上接到球,接下来游戏才能获得奖励。