参考马春鹏 《模式识别与机器学习》翻译

分类的线性模型

前⼀章中,我们研究了⼀类回归模型,这些模型有相当简单的数学性质和计算性质。我们现在讨论⼀类与此相似的模型,⽤于解决分类问题。分类的⽬标是将输⼊变量x分到K个离散的类别

Ck中的某⼀类。

在本章中,我们考虑分类的线性模型。所谓分类线性模型,是指决策⾯是输⼊向量x的线性函数,因此被定义为D维输⼊空间中的(D − 1)维超平⾯。

有两种不同的⽅法确定条件概率分布

p(Ck∣x)

- 判别式模型:直接对条件概率分布建模,例如把条件概率分布表⽰为参数模型,然后使⽤训练集来最优化参数。

- 生成式模型:对类条件概率密度

p(x∣Ck)以及类的先验概率分布

p(Ck)建模

判别函数

二分类

定义线性判别函数为

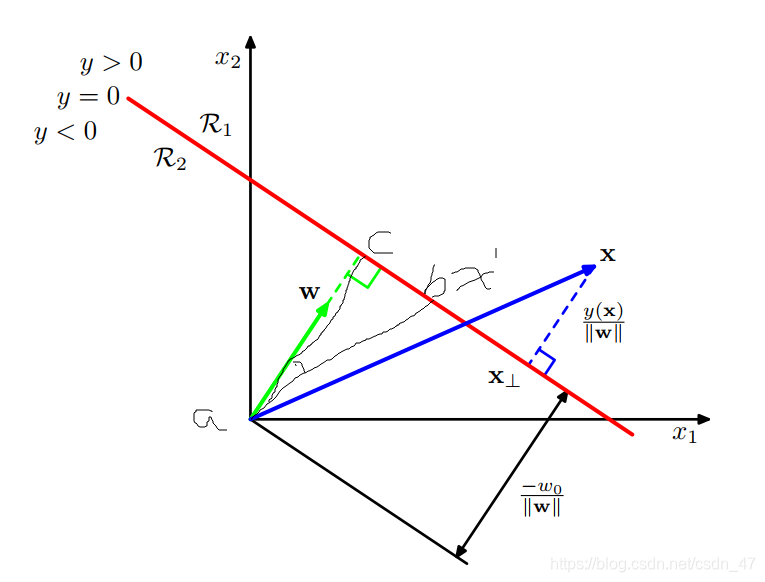

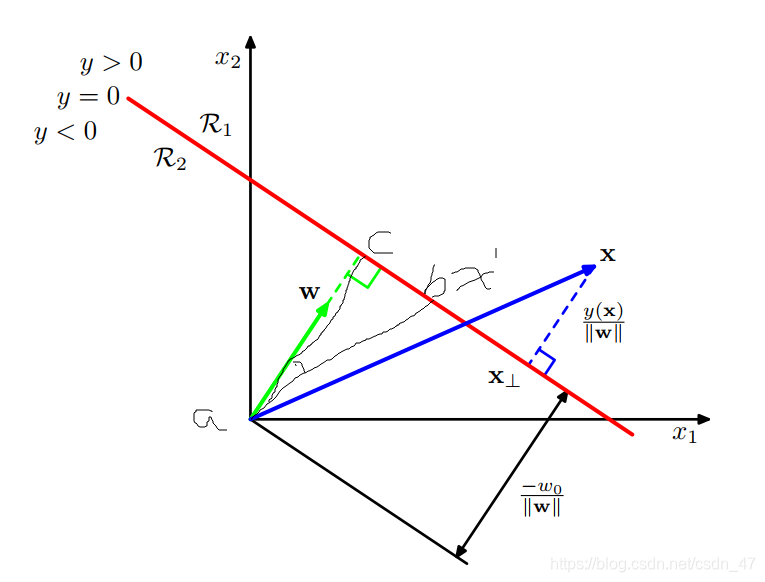

y(x)=wTx+w0(1)

对于⼀个输⼊向量x,如果y(x) ≥ 0,那么它被分到C1中,否则被分到C2中。

对于⼀个输⼊向量x,如果x是决策⾯内的⼀个点,那么y(x) = 0。从原点到决策面的垂直距离为

∥w∥wTx=−∥w∥w0(2)

其中

∥w∥wTx表示原点到平面的距离,因为

wTx等于上图中的||w|| * ab * sinΘ等于||w|| * ac,所以

∥w∥wTx等于ac。

定义点x到决策⾯的垂直距离r,考虑任意⼀点x和它在决策⾯上的投影x⊥,我们有

x=x⊥+r∥w∥w(3)

表示两个向量相加,通过代入化简得到

r=∥w∥y(x)(4)

多分类

多分类问题为将线性判别函数推⼴到K > 2个类别,可分为两种分类器。

- 1对其他:考虑使⽤K − 1个分类器,每个分类器⽤来解决⼀个⼆分类问题,把属于类别

Ck和不属于那个类别的点分开。这种⽅法产⽣了输⼊空间中⽆法分类的区域。

- 1对1:引⼊

2K(K−1)个⼆元判别函数,对每⼀对类别都设置⼀个判别函数。这也会造成输⼊空间中的⽆法分类的区域。

通过引⼊⼀个K类判别函数,我们可以避免这些问题。这个K类判别函数由K个线性函数组成,形式为

yk(x)=wkTx+wk0(5)

然对于点x, 如果对于所有的

j̸=k都有

yk(x)>yj(x),那么就把它分到

Ck,于 是 类别Ck和Cj之间的决策⾯为

yk(x)=yj(x),此时x代入决策面,若大于0(

yk(x)>yj(x))则为

Ck,并且对应于⼀个(D − 1)维超平⾯,形式为

(wk−wj)Tx+(wk0−wj0)=0(6)

下面介绍三种学习线性判别函数的参数的⽅法,即基于最⼩平⽅的⽅法、 Fisher线性判别函数,以及感知器算法。

⽤于分类的最⼩平⽅⽅法

对于k = 1, . . . , K。使⽤向量记号,我们可以很容易地把这些量聚集在⼀起表⽰,即

y(x)=W~Tx~(7)

其 中

W 是 ⼀ 个 矩阵, 第k列 由D + 1维 向量

w~k=(wk0,wkT)T组 成,

x是 对应的增 ⼴输⼊向量

(1,xT)T,考虑⼀个训练数据集{xn, tn},其中n = 1, . . . , N,然后定义⼀个矩阵T ,它的第n⾏是向量

tnT。平⽅和误差函数可以写成

ED(W~)=21Tr{(X~W~−T)T(X~W~−T)}(8)

令上式关于

W~ 的导数等于零,整理,可以得到

W~ 的解,为

W~=(X~TX~)−1X~TT=X~†T(9)

所以

y(x)=W~Tx~=TT(X~†)Tx~(10)

最⼩平⽅⽅法的问题:

- 对于离群点缺少鲁棒性,平⽅和误差函数惩罚了“过于正确”的预测,因为他们

在正确的⼀侧距离决策边界太远了。

- 回忆⼀下,最⼩平⽅⽅法对应于⾼斯条件分布假设下的最⼤似然法,⽽⼆值⽬标向量的概率分布显然不是⾼斯分布。

Fisher线性判别函数

从降维的⾓度考察线性分类模型。假设我们有⼀个D维输⼊向量x,然后使⽤下式投影到⼀维

y=wTx(11)

把

y≥−w0的样本分为

C1类,把其余的样本分为

C2类,在降维之后希望类别之间的距离尽量大,假设两类的均值向量为

m1=N11n∈C1∑xn,m2=N21n∈C2∑xn(12)

可以选择w使得下式取得最⼤值

m2−m1=wT(m2−m1)(13)

其中

mk=wTmk表示

Ck的均值,限制

∑iwi2=1

Fisher提出的思想是最⼤化⼀个函数,这个函数能够让类均值的投影分开得较⼤,同时让每个类别内部的⽅差较⼩,从⽽最⼩化了类别的重叠。

类内方差为

sk2=n∈Ck∑(yn−mk)2(14)

Fisher准则根据类间⽅差和类内⽅差的⽐值定义,即

J(w)=s12+s22(m2−m1)2(15)

改写为

J(w)=wTSWwwTSBw(16)

SB=(m2−m1)(m2−m1)T(17)

SW=n∈C1∑(xn−m1)(xn−m1)T+n∈C2∑(xn−m2)(xn−m2)T(18)

对式16求导,则

J(W)取最大值时

(wTSBw)SWw=(wTSWw)SBw

我们不关⼼w的⼤⼩,只关⼼它的⽅向,因此我们可以忽略标量因⼦

(wTSBw)和

(wTSWw),有

w∝SW−1(m2−m1)(19)

多分类的Fisher判别函数

考虑Fisher判别函数对于K > 2个类别的推⼴。引⼊D′ > 1个线性“特征”

yk=wkTx,

yk按照行排列,得到

y=WTx(20)

类内协⽅差矩阵公式推⼴到K类,有

SW=k=1∑KSk(21)

Sk=n∈Ck∑(xn−mk)(x−mk)T(22)

整体的协方差矩阵为:

ST=n=1∑N(xn−m)(xn−m)T(23)

m=N1n=1∑Nxn=N1k=1∑KNkmk(24)

整体的协⽅差矩阵可以分解为类内协⽅差矩阵,加上另⼀个矩阵SB,它可以看做类间协⽅差矩阵。(不是很懂)

ST=SW+SB(25)

SB=k=1∑KNk(mk−m)(mk−m)T(26)

因为是要在y的空间计算类内和类间方差,所以把x映射到D‘维空间上

SW=∑k=1K∑n∈Ck(yn−μk)(yn−μk)TSB=∑k=1KNk(μk−μ)(μk−μ)Tμk=Nk1∑n∈Ckyn,μ=N1∑k=1KNkμk(27)

优化函数定义为

J(W)=Tr{(WTSWW)−1(WTSBW)}(28)

感知器算法

它对应于⼀个⼆分类的模型,形式为

y(x)=f(wTϕ(x))(29)

⾮线性激活函数f(·)是⼀个阶梯函数,形式为

f(a)={+1,−1,a≥0a<0(30)

按照原来的误差函数求解w,会遇到函数不连续的情况,无法求解。感知机准则考虑到了另外一个误差函数,按照之前的表示方法所有的模式都应满⾜

wTϕ(xn)tn>0。正确分类时,误差为0,误分类时,它试着最⼩化

−wTϕ(xn)tn。感知器准则为

EP(w)=−n∈M∑wTϕntn(31)

利用随机梯度下降优化上述误差函数。

感知机学习的特点:

- 感知器学习规则并不保证在每个阶段都会减⼩整体的误差函数。

- 达到收敛状态所需的步骤数量可能⾮常⼤,并且在实际应⽤中,在达到收敛状态之前,我们不能够区分不可分问题与缓慢收敛问题。

- 数据集是线性可分的,也可能有多个解,并且最终哪个解会被找到依赖于参数的初始化以及数据点出现的顺序。

- 感知器算法⽆法提供概率形式的输出,也⽆法直接推⼴到K > 2个类别的情形。

概率⽣成式模型

这⾥我们会使⽤⽣成式(也就是贝叶斯方法)的⽅法。这种⽅法中,我们对类条件概率密度

p(x∣Ck)和类先验概率分布

p(Ck)建模,然后使⽤这两个概率密度通过贝叶斯定理计算后验概率密度

p(Ck∣x)。

考虑⼆分类的情形。类别

C1的后验概率可以写成

p(C1∣x)=p(x∣C1)p(C1)+p(x∣C2)p(C2)p(x∣C1)p(C1)=1+exp(−a)1=σ(a)(32)

a=lnp(x∣C2)p(C2)p(x∣C1)p(C1)(33)

在公式(34)中,我们只是把后验概率写成了⼀个等价的形式,因此logistic sigmoid函数的出现似乎相当没有意义。然⽽,假设

a(x)的函数形式相当简单,那么这种表⽰⽅法就很有⽤了。我们稍后会考虑

a(x)是

x的线性函数的情形。这种情况下,后验概率由⼀个通⽤的线性模型确定。

对于K > 2个类别的情形,我们有

p(Ck∣x)=∑jp(x∣Cj)p(Cj)p(x∣Ck)p(Ck)=∑jexp(aj)exp(ak)(34)

它被称为归⼀化指数(normalized exponential),可以被当做logistic sigmoid函数对于多类情况的推⼴。把属于每一类的概率归一化,归⼀化指数也被称为softmax函数,如果对于所有的

j̸=k都有

ak≫aj,那么

p(Ck∣x)≃1Hp(Cj∣x)≃0。

下面⾸先讨论连续输⼊变量x的情形,然后简短地讨论离散输⼊的情形。

连续输⼊

让我们假设类条件概率密度是⾼斯分布,然后求解后验概率的形式。⾸先,我们假定所有的类别的协⽅差矩阵相同。这样类别

Ck的类条件概率为

p(x∣Ck)=(2π)2D1∣Σ∣211exp{−21(x−μk)TΣ−1(x−μk)}(35)

考虑到只有两类的情况,根据式子32,33有

p(C1∣x)=σ(wTx+w0)(36)

其中

∣∣w=Σ−1(μ1−μ2)w0=−21μ1TΣ−1μ1+21μ2TΣ−1μ2+lnp(C2)p(C1)(37)

最终求得的决策边界对应于后验概率

p(Ck∣x)为常数的决策⾯,因此由x的线性函数给出,从⽽决策边界在输⼊空间是线性的。先验概率密度

p(Ck)只出现在偏置参数w0中,因此先验的改变的效果是平移决策边界。

对于K>2,有

ak(x)=wkTx+wk0(38)

wk=Σ−1μk(39)

wk0=−21μkTΣ−1μk+lnp(Ck)(40)

我们看到ak(x)与之前⼀样是x的线性函数,这是因为各个类别的协⽅差矩阵相同,使得⼆次项被消去。最终的决策边界,对应于最⼩错误分类率,会出现在后验概率最⼤的两个概率相等的位置,因此由x的线性函数定义,从⽽我们再次得到了⼀个⼀般的线性模型。

最⼤似然解

既然已经类条件概率密度p(x | Ck)的参数化的函数形式,那么下一步就是确定参数的值和先验概率了

p(Ck)。

对于二分类,令

p(C1)=π,有

p(xn,C1)=p(C1)p(xn∣C1)=πN(xn∣μ1,Σ)(41)

p(xn,C2)=p(C2)p(xn∣C2)=(1−π)N(xn∣μ2,Σ)(42)

于是似然函数

p(t,X∣π,μ1,μ2,Σ)=n=1∏N[πN(xn∣μ1,Σ)]tn[(1−π)N(xn∣μ2,Σ)]1−tn(43)

最⼤化似然函数的对数⽐较⽅便。⾸先考虑关于π的最⼤化。对数似然函数中与π相关的项为

n=1∑N{tnlnπ+(1−tn)ln(1−π)}(44)

令其关于π的导数等于零,整理,可得

π=N1n=1∑Ntn=NN1=N1+N2N1(45)

μ1=N11n=1∑Ntnxn(46)

μ2=N21n=1∑N(1−tn)xn(47)

- π的最⼤似然估计就是类别C1的点所占的⽐例

-

μ1为类别C1的输⼊向量xn的均值。

-

μ2为类别C2的输⼊向量xn的均值。

考虑协⽅差矩阵Σ的最⼤似然解。

−21∑n=1Ntnln∣Σ∣−21∑n=1Ntn(xn−μ1)TΣ−1(xn−μ1)−21∑n=1N(1−tn)ln∣Σ∣−21∑n=1N(1−tn)(xn−μ2)TΣ−1(xn−μ2)=−2Nln∣Σ∣−2NTr{Σ−1S}(48)

S=NN1S1+NN2S2S1=N11∑n∈C1(xn−μ1)(xn−μ1)TS2=N21∑n∈C2(xn−μ2)(xn−μ2)T(49)

离散特征

这⾥,我们做出朴素贝叶斯(naive Bayes的假设,这个假设中,特征值被看成相互独⽴的,以类别Ck为条件。因此我们得到类条件分布,形式为

p(x∣Ck)=i=1∏Dμkixi(1−μki)1−xi(50)

每一个维度即为一个特征值

xi,并且对应于每一个类别Ck,有均值

μki

代入

ak=lnp((x∣Ck)p(Ck))有

ak(x)=i=1∑D{xilnμki+(1−xi)ln(1−μki)}+lnp(Ck)(51)

概率判别式模型

在直接⽅法中,我们最⼤化由条件概率分布p(Ck | x)定义的似然函数。这种⽅法代表了判别式训练的⼀种形式。判别式⽅法的⼀个优点是通常有更少的可调节参数需要确定。

固定基函数

恰当地选择⾮线性变换能够让后验概率的建模过程更简单。

logistic回归

类别C1的后验概率可以写成作⽤在特征向量φ的线性函数上的logistic sigmoid函数的形式,即

p(C1∣ϕ)=y(ϕ)=σ(wTϕ)(52)

对于⼀个M维特征空间φ,这个模型有M个可调节参数。如果我们使⽤最⼤似然⽅法调节了⾼斯类条件概率密度,需要有2M个参数来描述均值,以及

2M(M+1)个参数来描述协⽅差矩阵。算上类先验p(C1),参数的总数为

2M(M+5)+1,这随着M的增长⽽以⼆次的⽅式增长。对于⼤的M值,直接使⽤logistic回归模型(判别式)有着很明显的优势。

我们现在使⽤最⼤似然⽅法来确定logistic回归模型的参数。为了完成这⼀点,我们要使⽤logistic sigmoid函数的导数,它可以很⽅便地使⽤sigmoid函数本⾝表⽰如下

dadσ=σ(1−σ)(53)

对于⼀个数据集φn, tn,其中tn ∈ {0, 1}且φn = φ(xn),并且n = 1, . . . , N,似然函数

p(t∣w)=n=1∏Nyntn{1−yn}1−tn(54)

其中i = (t1, . . . , tN)T 且yn = p(C1 | φn),我们可以通过取似然函数的负对数的⽅

式,定义⼀个误差函数。这种⽅式产⽣了交叉熵(cross-entropy)误差函数。

E(w)=−lnp(t∣w)=−n=1∑N{tnlnyn+(1−tn)ln(1−yn)}(55)

∇E(w)=n=1∑N(yn−tn)ϕn(56)

我们可以使⽤公式(4.91)的结果提出⼀个顺序算法,这种算法中,每次只出现⼀个模式,权向量使⽤梯度下降方法更新,其中∇En是公式(56)的第n项。

缺点:

- 过拟合:最⼤似然⽅法对于线性可分的数据集会产⽣严重的过拟合现象。

- 依赖参数初始值:最⼤似然⽅法⽆法区分某个解优于另⼀个解,并且在实际应⽤中哪个解被找到将会依赖于优化算法的选择和参数的初始化。

迭代重加权最⼩平⽅

对于logistic回归来说,不再有解析解了,因为logistic sigmoid函数是⼀个⾮线性函数。误差函数是凸函数,因此有⼀个唯⼀的最⼩值。此外,误差函数可以通过⼀种⾼效的迭代⽅法求出最⼩值,这种迭代⽅法基于Newton-Raphson迭代最优化框架,使⽤了对数似然函数的局部⼆次近似。

w(new)=w(old)−H−1∇E(w)(57)

其中H是⼀个Hessian矩阵,它的元素由E(w)关于w的⼆阶导数组成。

让我们把Newton-Raphson⽅法应⽤到现⾏回归模型,误差函数为平⽅和误差函数,这个误差函数的梯度和Hessian矩阵为

∇E(w)=∑n=1N(wTϕn−tn)ϕn=ΦTΦw−ΦTtH=∇∇E(w)=∑n=1NϕnϕnT=ΦTΦ(58)

其中Φ是N × M设计矩阵,第n⾏为φT, Newton-Raphson更新的形式为

w(new)=w(old)−(ΦTΦ)−1{ΦTΦw(old)−ΦTt}=(ΦTΦ)−1ΦTt(59)

其中x是⼀个N维向量,元素为

z=Φwold−R−1(y−t)(60)

我们看到更新公式(59)的形式为⼀组加权最⼩平⽅问题的规范⽅程, 由于权矩阵R不是常量,⽽是依赖于参数向量w,因此我们必须迭代地应⽤规范⽅程,这个算法被称为迭代重加权最⼩平⽅(iterative reweighted least squares)

多类logistic回归

在我们对于多分类的⽣成式模型的讨论中,我们已经看到对于⼀⼤类概率分布来说,后验概率由特征变量的线性函数的softmax变换给出,即

p(Ck∣ϕ)=yk(ϕ)=∑jexp(ak)exp(ak)(61)

ak=wkTϕ

生成式方法通过求类条件概率密度和类先验概率,使用贝叶斯求出后验概率。这⾥,我们考虑使⽤最⼤似然⽅法直接确定这个模型中的参数{wk}。首先求出yk关于所有激活aj的导数

∂aj∂yk=yk(Ikj−yj)(62)

使⽤“1-of-K”表达⽅式。似然函数为

p(T∣w1,…,wK)=n=1∏Nk=1∏Kp(Ck∣ϕn)tnk=n=1∏Nk=1∏Kynktnk(63)

取负对数,可得交叉熵(cross-entropy)误差函数

E(w1,…,wK)=−lnp(T∣w1,…,wK)=−n=1∑Nk=1∑Ktnklnynk(64)

取误差函数关于参数向量wj的梯度

∇wjE(w1,…,wK)=n=1∑N(ynj−tnj)ϕn(65)

我们已经看到,对于数据点n,线性回归模型的对数似然函数关于参数向量w的导数的形式为“误差”yn − tn乘以特征向量φn。

probit回归

对于由指数族分布描述的⼀⼤类的类条件概率分布,最终求出的后验类概率为作⽤在特征变量的线性函数上的logistic(或者softmax)变换。不是所有的类条件概率

密度都有这样简单的后验概率函数形式。

二分类模型:

p(t=1∣a)=f(a)(66)

其中

a=wTφ,且f(·)为激活函数。然后按照下⾯的⽅式设置⽬标值

{tn=1tn=0 if an⩾θ otherwise (67)

么对应的激活函数由累积分布函数给出

f(a)=∫−∞ap(θ)dθ(68)

假设概率密度p(θ)是零均值、单位⽅差的⾼斯概率密度。对应的累积分布函数为

Φ(a)=∫−∞aN(θ∣0,1)dθ(69)

这 被 称 为 逆probit(inverse probit) 函 数。 通过以下方法计算

erf(a)=π

2∫0aexp(−θ2)dθ(70)

Φ(a)=21{1+erf(2

a)}(71)

probit和logistic

- 对于x → ∞, logistic sigmoid函数像exp(−x)那样渐进地衰减

- ⽽probit激活函数像exp(−x2)那样衰减,因此probit模型对于离群点会更加敏感。

标准链接函数

对于⾼斯噪声分布的线性回归模型,logistic sigmoid激活函数与交叉熵误差函数(4.90)的组合,以及多类交叉熵误差函数(4.108)的softmax激活函数 误差的向量w求导数,那么导数的形式为“误差”yn − tn与特征向量φn的乘积,现在我们证明,如果假设⽬标变量的条件分布来⾃于指数族分布,对应的激活函数选为标准链接函数(canonical link function)

略

拉普拉斯近似

拉普拉斯近似。它的⽬标是找到定义在⼀组连续变量上的概率密度的⾼斯近似。⾸先考虑单⼀连续变量z的情形,假设分布p(z)的定义为

p(z)=Z1f(z)(72)

其中Z = 2 f(z) dz是归⼀化系数。们假定Z的值是未知的。在拉普拉斯⽅法中,⽬标是寻找⼀个⾼斯近似q(z),它的中⼼位于p(z)的众数的位置。第⼀步是寻找p(z)的众数,即寻找⼀个点z0使得p′(z0) = 0,或者等价地

dzdf(z)∣∣∣∣z=z0=0(73)

⾼斯分布有⼀个性质,即它的对数是变量的⼆次函数。于是我们考虑ln f(z)以众数z0为中⼼的泰勒展开,即

lnf(z)≃lnf(z0)−21A(z−z0)2A=−dz2d2lnf(z)∣z=z0(74)

两侧同时取指数

f(z)≃f(z0)exp{−2A(z−z0)2}(75)

使⽤归⼀化的⾼斯分布的标准形式,我们就可以得到归⼀化的概率分布q(z)

q(z)=(2πA)21exp{−2A(z−z0)2}(76)

近似定义在M维空间z上的概率分布

p(z)=Zf(z),在驻点处展开,我们有

lnf(z)≃lnf(z0)−21(z−z0)TA(z−z0)(77)

其中M × M的Hessian矩阵A的定义为

A=−∇∇lnf(z)∣z=z0,按照前述方法取指数,归一化

f(z)≃f(z0)exp{−21(z−z0)TA(z−z0)}(78)

q(z)=(2π)2M∣A∣21exp{−21(z−z0)TA(z−z0)}=N(z∣z0,A−1)(79)

前提是,精度矩阵A是正定的,这表明驻点z0⼀定是⼀个局部最⼤值,⽽不是⼀个最⼩值或者鞍点。缺点

- 以⾼斯分布为基础的,因此它只能直接应⽤于实值变量。

- 以⾼斯分布为基础的,因此它只能直接应⽤于实值变量。

贝叶斯logistic回归

这⾥我们考虑使⽤拉普拉斯近似来处理贝叶斯logistic回归的问题

拉普拉斯近似

步骤

- 找后验概率分布的众数

- 调节⼀个以众数为中⼼的⾼斯分布

- 计算对数后验概率的⼆阶导数

由于我们寻找后验概率分布的⼀个⾼斯表⽰,我们把⾼斯先验写成⼀般的形式

p(w)=N(w∣m0,S0)(80)

p(w∣t)∝p(w)p(t∣w)(81)

t=(t1,…,tN)T ,后验两侧取对数,然后代⼊先验分布

lnp(w∣t)=−21(w−m0)TS0−1(w−m0)+n=1∑N{tnlnyn+(1−tn)ln(1−yn)}+const(82)

yn=σ(wTϕn),为了获得后验概率的⾼斯近似,我们⾸先最⼤化后验概率分布,得

到MAP(最⼤后验)解wMAP ,它定义了⾼斯分布的均值,协⽅差就是负对数似然函数的⼆阶导数矩阵的逆矩阵

SN−1=−∇∇lnp(w∣t)=S0−1+n=1∑Nyn(1−yn)ϕnϕnT(83)

后验概率分布的⾼斯近似的形式为

q(w)=N(w∣wMAP,SN)(84)

预测分布

新的特征向量φ(x),类别C1的预测分布可以通过对后验概率p(w | t)积分

p(C1∣ϕ,t)=∫p(C1∣ϕ,w)p(w∣t)dw≃∫σ(wTϕ)q(w)dw(85)

σ(wTϕ)=∫δ(a−wTϕ)σ(a)da(86)

其中δ(·)是狄拉克Delta函数。