Spark学习 - 框架搭建

参考:https://blog.csdn.net/cymy001/article/details/78430892

1.下载anaconda软件

URL:https://repo.continuum.io/archive/.winzip(推荐3.5或者3.6版本)

![]()

清华大学开源软件镜像站:https://mirrors.tuna.tsinghua.edu.cn/anaconda/archive/(推荐3.5或者3.6版本)

安装路径:D:\python\anaconda

配置环境变量PATH:

D:\python\anaconda\software;D:\python\anaconda\software\Scripts;D:\python\anaconda\software\Library\bin

2.下载spark软件

URL:http://spark.apache.org/downloads.html

安装路径:D:\job\spark\spark2.4.1

配置环境变量

(1)新建系统变量:变量名SPARK_HOME+变量值D:\job\spark\spark2.4.1

添加PATH变量:%SPARK_HOME%\bin

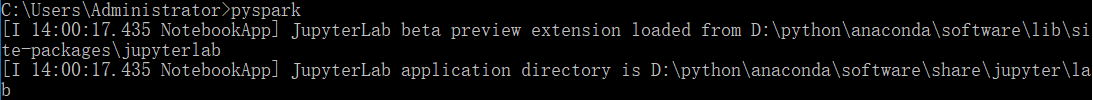

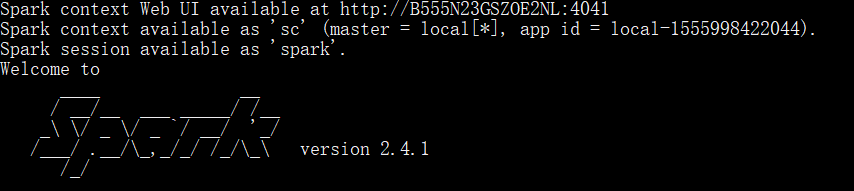

此时在终端输入pyspark(python)或者spark-shell(scala),结果如下:

(2)新建系统变量:

-变量名PYSPARK_DRIVER_PYTHON+变量值ipython

-变量名PYSPARK_DRIVER_PYTHON_OPTS+变量值notebook

-变量名PYSPARKPATH+变量值%SPARK_HOME%\python\lib\py4j;%SPARK_HOME%\python\lib\pyspark

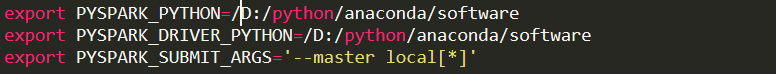

打开文件(D:\job\spark\spark2.4.1\conf\spark-env.sh.template),在末尾处添加以下语句:

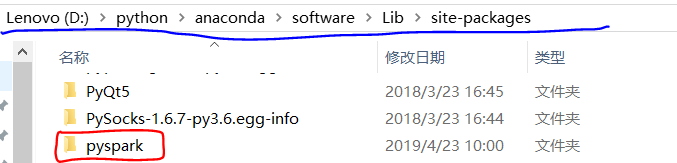

将文件夹(D:\job\spark\spark2.4.1\python\pyspark)复制到此处:D:\python\anaconda\software\Lib\site-packages

3.启动pyspark

上述配置完毕后,在终端输入pyspark,自动跳转至jupyter notebook,如下图: