系列博客链接:

(一)目标检测概述 https://www.cnblogs.com/kongweisi/p/10894415.html

(二)目标检测算法之R-CNN https://www.cnblogs.com/kongweisi/p/10895055.html

(三)目标检测算法之SPPNet https://www.cnblogs.com/kongweisi/p/10899771.html

(四)目标检测算法之Fast R-CNN https://www.cnblogs.com/kongweisi/p/10900021.html

写在最前面:https://zhuanlan.zhihu.com/p/31426458,这是某知乎大佬关于我今天所写的超级棒的文章,放在最前面,完全可以不看我的文章去看这位大佬的。

当然,大佬的文章深度和精度都很足,因此文章篇幅比较长,想简单一些了解(其实我的也不是特别简单,很想简单点。。囧~~)Faster R-CNN的,可以直接读我的文章。

本文概述:

1、Faster R-CNN:区域生成网络+Fast R-CNN

候选区域生成(Region Proposal Network),特征提取,分类,位置精修

2、RPN原理

2.1 anchors

2.2 候选区域的训练

3、Faster R-CNN的训练

4、效果对比

5、Faster R-CNN总结

引言:

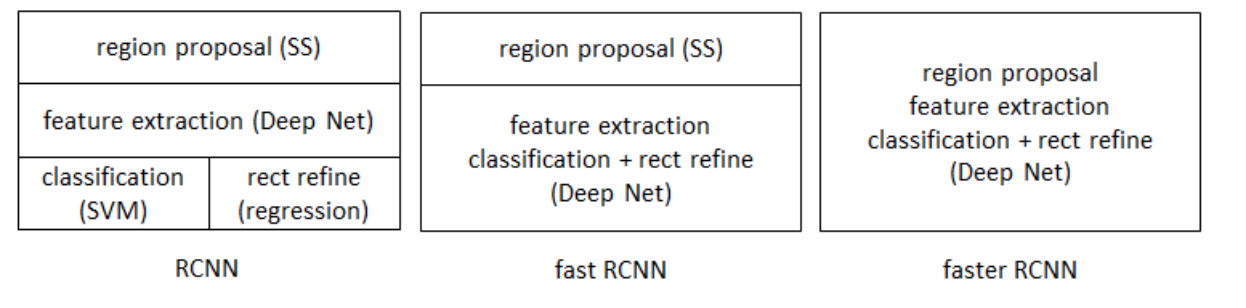

在Fast R-CNN还存在着瓶颈问题:Selective Search(选择性搜索)。要找出所有的候选框,这个也非常耗时。那我们有没有一个更加高效的方法来求出这些候选框呢?

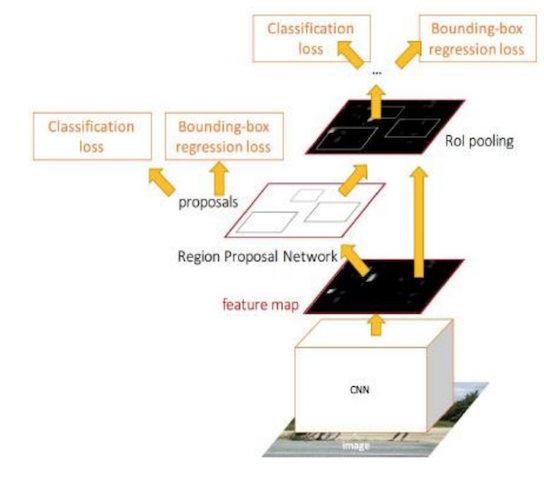

1、Faster R-CNN

在Faster R-CNN中加入一个提取边缘的神经网络,也就说找候选框的工作也交给神经网络来做了。这样,目标检测的四个基本步骤(候选区域生成,特征提取,分类,位置精修)终于被统一到一个深度网络框架之内。

Faster R-CNN可以简单地看成是区域生成网络+Fast R-CNN的模型,用区域生成网络(Region Proposal Network,简称RPN)来代替Fast R-CNN中的选择性搜索方法,结构如下:

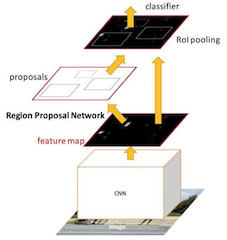

图1 Faster RCNN基本结构

- 1、首先向CNN网络(VGG-16)输入任意大小图片

- 2、Faster RCNN使用一组基础的conv+relu+pooling层提取feature map。该feature map被共享用于后续RPN层和全连接层。

- 3、Region Proposal Networks。RPN网络用于生成region proposals,该层通过softmax判断anchors属于foreground或者background,再利用bounding box regression修正anchors获得精确的proposals,输出其Top-N(默认为300)的区域给RoI pooling4、第2步得到的高维特征图和第3步输出的区域,合并(可以理解成候选区映射到特征图中,类似第(三)节SPPNet中1.1"映射")输入RoI池化层(类), 该输出到全连接层判定目标类别。

- 生成anchors -> softmax分类器提取fg anchors -> bbox reg回归fg anchors -> Proposal Layer生成proposals

- 4、第2步得到的高维特征图和第3步输出的区域建合并输入RoI池化层(类), 该输出到全连接层判定目标类别。

- 5、利用proposal feature maps计算每个proposal的不同类别概率,同时bounding box regression获得检测框最终的精确位置

图2 Faster RCNN基本结构

解释:

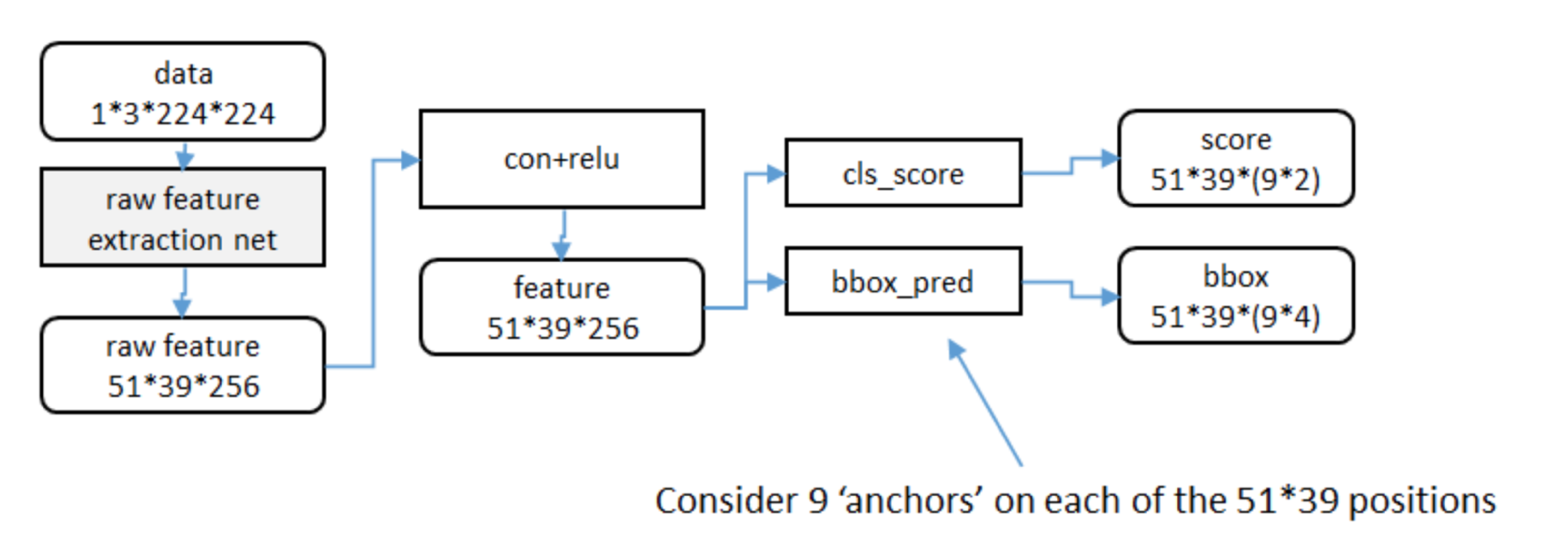

图2展示了python版本中的VGG16模型中的faster_rcnn_test.pt的网络结构,可以清晰的看到该网络对于一副任意大小PxQ的图像,首先缩放至固定大小MxN,然后将MxN图像送入网络;

而Conv layers中包含了13个conv层+13个relu层+4个pooling层;RPN网络首先经过3x3卷积,再分别生成foreground anchors与bounding box regression偏移量,然后计算出proposals;

而Roi Pooling层则利用proposals从feature maps中提取proposal feature送入后续全连接和softmax网络作classification(即分类proposal到底是什么object)。

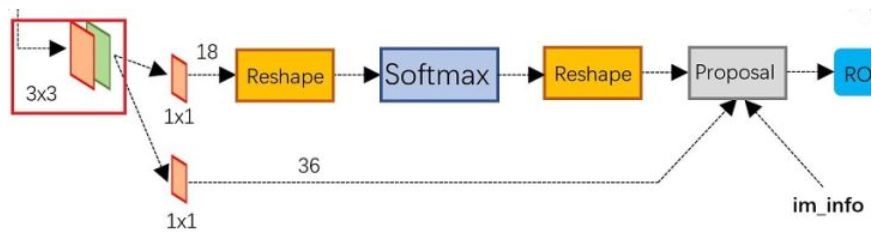

2、 RPN原理

RPN网络的主要作用是得出比较准确的候选区域。整个过程分为两步

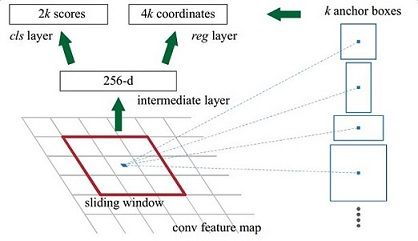

- 用n×n(默认3×3=9)的大小窗口去扫描特征图,每个滑窗位置映射到一个低维的向量(默认256维),并为每个滑窗位置考虑k种(在论文设计中k=9)可能的参考窗口(论文中称为anchors)

- 低维特征向量输入两个并行连接的1 x 1卷积层然后得出两个部分:reg窗口回归层(用于修正位置)和cls窗口分类层(是否为前景或背景概率)

图3 RPN层基本结构

上图3展示了RPN网络的具体结构。可以看到RPN网络实际分为2条线,上面一条通过softmax分类anchors获得foreground和background(检测目标是foreground),

下面一条用于计算对于anchors的bounding box regression偏移量,以获得精确的proposal。而最后的Proposal层则负责综合foreground anchors和bounding box regression偏移量获取proposals,

同时剔除太小和超出边界的proposals(有一些分类实在太烂的区域,我们直接丢掉,否则计算量会非常大)。其实整个网络到了Proposal Layer这里,就完成了相当于目标定位

(相当于完成了选择性搜索(SS)生成候选区)的功能。

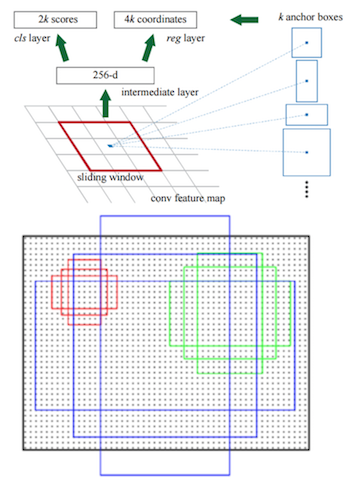

2.1 anchors

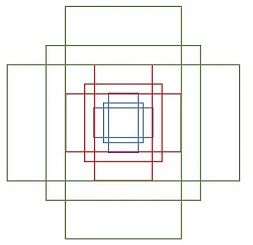

- 3*3卷积核的中心点对应原图上的位置,将该点作为anchor的中心点,在原图中框出多尺度、多种长宽比的anchors, 三种尺度{ 128,256,512 }, 三种长宽比{1:1,1:2,2:1}

举个例子:

解释:

所谓anchors,实际上就是一组的矩形。

[[ -84. -40. 99. 55.] [-176. -88. 191. 103.] [-360. -184. 375. 199.] [ -56. -56. 71. 71.] [-120. -120. 135. 135.] [-248. -248. 263. 263.] [ -36. -80. 51. 95.] [ -80. -168. 95. 183.] [-168. -344. 183. 359.]]

其中每行的4个值 表矩形左上和右下角点坐标。9个矩形共有3种形状,长宽比为大约为

三种,如图4。实际上通过anchors就引入了检测中常用到的多尺度方法。

图4 anchors示意图

注:关于上面的anchors size,其实是根据检测图像设置的。在python demo中,会把任意大小的输入图像reshape成800x600(即图2中的M=800,N=600)。再回头来看anchors的大小,anchors中长宽1:2中最大为352x704,长宽2:1中最大736x384,基本是cover了800x600的各个尺度和形状。

那么这9个anchors是做什么的呢?借用Faster RCNN论文中的原图,如图5,遍历Conv layers计算获得的feature maps,为每一个点(每一个像素的中心)都配备这9种anchors作为初始的检测框。这样做获得检测框很不准确,不用担心,后面还有2次bounding box regression可以修正检测框位置。

图7

其实RPN最终就是在原图尺度上,设置了密密麻麻的候选Anchor。然后用cnn去判断哪些Anchor是里面有目标的foreground anchor,哪些是没目标的backgroud。所以,仅仅是个二分类而已!

而anchor的个数也是我们关心的一个问题,如下图经过CNN后得到的特征是51 x 39(通道数忽略),那么对于9种形状的anchor,一共有51 x 39 x 9 = 17901个anchor从RPN层输出,对于更高维度的图像,输出的特征会更大,带来训练参数过大的问题。

2.2 候选区域的训练

- 训练样本anchor标记

- 1.每个ground-truth box有着最高的IoU的anchor标记为正样本

- 2.剩下的anchor/anchors与任何ground-truth box的IoU大于0.7记为正样本,IoU小于0.3,记为负样本

- 3.剩下的样本全部忽略

- 正负样本比例为1:3

- 训练损失

- RPN classification (anchor good / bad) ,二分类,是否有物体,是、否

- RPN regression (anchor -> proposal) ,回归

- 注:这里使用的损失函数和Fast R-CNN内的损失函数原理类似,同时最小化两种代价

候选区域的训练是为了让得出来的正确的候选区域, 并且候选区域经过了回归微调。

在这基础之上做Fast RCNN训练是得到特征向量做分类预测和回归预测。

3、Faster R-CNN的训练

Faster R-CNN的训练分为两部分,即两个网络的训练。前面已经说明了RPN的训练损失,这里输出结果部分的的损失(这两个网络的损失合并一起训练):

-

Fast R-CNN classification (over classes) ,所有类别分类N+1

-

Fast R-CNN regression (bbox regression)

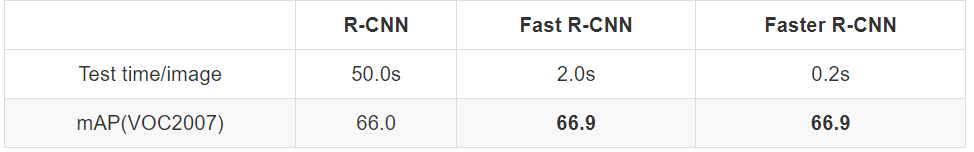

4、效果对比

5、Faster R-CNN总结

- 优点

- 提出RPN网络

- 端到端网络模型

- 缺点

- 训练参数过大

- 对于真实训练使用来说还是依然过于耗时

可以改进的需求:

- RPN(Region Proposal Networks) 改进 对于小目标选择利用多尺度特征信息进行RPN

- 速度提升 如YOLO系列算法,删去了RPN,直接对proposal进行分类回归,极大的提升了网络的速度