总的来说,这篇论文的主要做了两件事,第一,设计RIR,加深网络;第二,引入通道注意力机制(CA),说白了就是给通道加一个权重,表明不同通道提取出来的不同特征的重要性不同,这个权重是学习出来的,后文有详细介绍。

提出问题

(1)更深层次的图像SR网络更难训练,仅仅通过叠加剩余块来构建更深层次的网络很难得到更好的改善。

(2)低分辨率的输入和特征包含丰富的低频信息,而目前主流的基于cnn的方法对每个信道特征都一视同仁,缺乏跨特征信道的识别学习能力,阻碍了深度网络的表征能力。

解决方法

(1)文章提出了一种残差信道注意网络(RCAN)来获得非常深的可训练网络,同时自适应地学习更多有用的信道特征。

(2)为了简化超深网络(如400层以上)的训练,提出了残差(residual in residual, RIR)结构,其中残差组(residual group, RG)作为基本模块,长跳连接(long skip connection, LSC)允许粗级别的残差学习。在每个RG模块中,使用短跳连接(SSC)将几个简化的剩余块堆叠起来。长跳连接和短跳连接以及残差块的近路允许大量低频信息通过这些基于身份的跳连接,从而简化了信息的流动。

(3)提出了通道注意(CA)机制,通过对特征通道之间的相互依赖关系进行建模,自适应地调整每个通道的特征。这样的CA机制使我们所提出的网络能够专注于更有用的通道,提高识别学习能力。

网络架构

RCAN主要由四个部分组成:

RCAN主要由四个部分组成:

- 浅层特征提取

- 残差(RIR)深度特征提取

- 放大模块

- 重构部分

Channel Attention (CA)

以往基于cnn的SR方法对LR通道特征的处理是平等的,对于实际情况并不灵活。为了使网络关注更多的信息特性,我们利用特性通道之间的相互依赖关系,从而产生通道注意(CA)机制。

如何为每个通道产生不同的关注是关键的一步。这里我们主要关注两点:

如何为每个通道产生不同的关注是关键的一步。这里我们主要关注两点:

第一,LR空间中的信息含有丰富的低频和有价值的高频成分。低频部分似乎比较平坦。高频分量通常是区域,充满边缘、纹理和其他细节。

第二,Conv层中的每个滤波器都有一个局部接受域。因此,卷积后的输出无法利用局部区域以外的上下文信息。

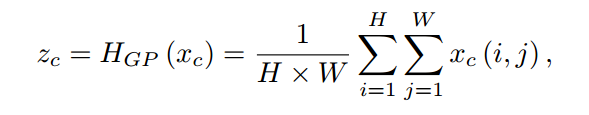

在此基础上,利用全局平均池将信道方向的全局空间信息转化为信道描述符。例如有C个通道的feature map,每个feature map的尺寸为(W,H),看公式可知,第c个通道的描述符Zc为这个通道上值的平均值(全局平均池化)

这种信道统计量可以看作是局部描述符的集合,这些局部描述符的统计量有助于表示整个图像。除了全局平均池之外,这里还可以引入更复杂的聚合技术。

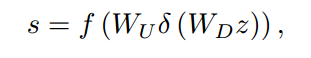

为了通过全局平均池从聚合的信息中完全捕获信道依赖关系,我们引入了一种门机制。门控机制应该满足两个条件:首先,它必须能够学习通道之间的非线性相互作用。其次,由于可以强调多个通道的特性,而不是一个one-hot activation,因此必须学习一种非相互排斥的关系。在这里,我们用简单的sigmoid函数来开发一种门控机制:

其中,f (·)代表sigmoid函数, δ (·)为relu函数,Wd为卷积层的过滤器,以r为尺度做下采样,经过relu函数后,乘以Wu(以r为尺度做上采样),然后得到最终的信道统计量s,该统计量用于重新调整输入xc:

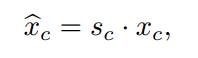

其中sc和xc为第c个通道的比例因子(权重)和特征图。在信道注意力机制的作用下,对RCAB中的剩余分量进行自适应重标。

残差块与CA相结合(RCAB)