算法适用问题

搜索给定单峰区间的极值问题,一般对凸优化问题比较适用。

python实现

# # ******************************** 无约束一维极值——二分法 ********************************

import pandas as pd

import numpy as np

from advance_retreat_method import advance_retreat_method

from scipy.misc import derivative

class Minimize_Dichotomy(object):

"""

func:为目标函数,必传参数

eps:迭代精度 默认1e-6

x0:初始区间。若不传这个参数,

则会调用进退法求取一个单峰区间。

from advance_retreat_method import advance_retreat_method

这个模块在本人博客优化版块的第一篇文章

"""

def __init__(self,**kargs):

self.func = kargs["func"]

if "x0" in kargs.keys():

self.x0 = np.array(kargs["x0"])

else:

self.x0 = np.array(advance_retreat_method(kargs["func"]).run())

if "eps" in kargs.keys():

self.eps = kargs["eps"]

else:

self.eps = 1e-6

def run(self):

x_mean = np.mean(self.x0)

y_mean = derivative(self.func,x_mean,dx = 1e-6)

if derivative(self.func,self.x0[0],dx = 1e-6)*y_mean < 0:

self.x0[1] = x_mean

else:

self.x0[0] = x_mean

if np.abs(self.x0[0]-self.x0[1]) < self.eps or y_mean == 0:

return ((x_mean,self.func((self.x0[0]+self.x0[1])/2)))

else:

return self.run()

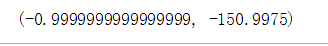

if __name__ == "__main__":

result = Minimize_Dichotomy(func = lambda x:x**2+2*x-150).run()

print(result)

示例运行结果

by CyrusMay 2020 05 01

幸福不是多而是遗忘

能遗忘生命的烦恼忧伤

——五月天(Enrich your life)——