一、K近邻(KNN)简介

-

最简单最初级的分类器,就是将全部的训练数据所对应的类别都记录下来,当测试对象的属性和某个训练对象的属性完全匹配时,便可以对其进行分类

- K近邻(k-nearest neighbour, KNN)是一种基本分类方法,通过测量不同特征值之间的距离进行分类。它的思路是:如果一个样本在特征空间中的k个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别,其中K通常是不大于20的整数

- KNN算法中,所选择的邻居都是已经正确分类的对象

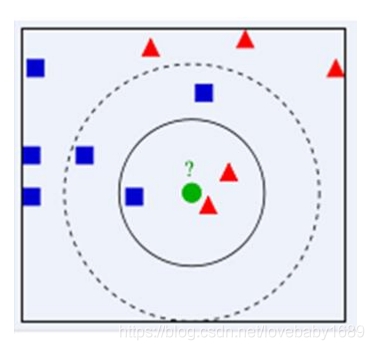

KNN示例

如下图所示,绿色圆要被决定赋予哪个类,是红色三角还是蓝色四方形?

当k=3时,由于红色三角形所占比例为2/3,绿色圆将被赋予红色三角那个类。当k=5时,由于蓝色四方形比例为3/5,因此绿色圆被赋予蓝色四方形类。

通过上面的例子可以看出,KNN算法的结果很大程度取决于K的选择。

二、KNN距离计算

KNN中,通常计算对象间距离来作为各个对象之间的非相似性指标,避免了对象之间的匹配问题,在这里距离一般使用欧式距离或曼哈顿距离:

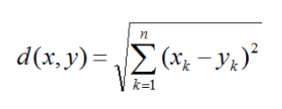

欧氏距离:

曼哈顿距离:

三、KNN算法描述

在训练集中数据和标签已知的情况下,输入测试数据,将测试数据的特征与训练集中对应的特征进行相互比较,找到训练集中与之最为相似的前K个数据,则该测试数据对应的类别就是K个数据中出现次数最多的那个分类,其算法的描述为:

a)计算测试数据与各个训练数据之间的距离;

b)按照距离的递增关系进行排序;

c)选取距离最小的K个点;

d)确定前K个点所在类别的出现频率;

e)返回前K个点中出现频率最高的类别作为测试数据的预测分类。

四、KNN算法实现

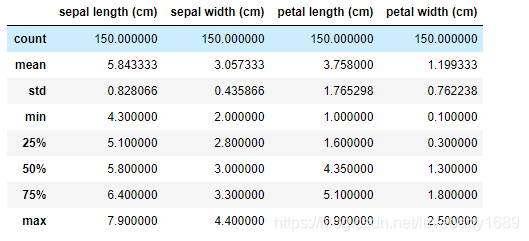

本例以 sklearn 中提供的鸢尾花数据为例,其包含了150个样本。在这个例子中,选择30%的数据作为测试数据,其余数据作为训练数据。

当然,sklearn中本身也自带又knn算法的分类器。下面的例子中初始化时传入参数 n_neighbors 为 6,即为上面的 k。fit() 方法根据训练数据集“训练”分类器,该方法会返回分类器本身。

from sklearn.neighbors import KNeighborsClassifier

kNN_classifier = KNeighborsClassifier(n_neighbors=6)

kNN_classifier.fit(X_train, y_train)1.引入依赖

import numpy as np

import pandas as pd

#这里直接引入sklearn里的数据集,iris 燕尾花

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split #切分数据集为训练集和测试集

from sklearn.metrics import accuracy_score #计算分类预测的准确率2.数据的加载和预处理

iris = load_iris()

df = pd.DataFrame(data=iris.data,columns=iris.feature_names)

df['class']=iris.target

df['class']=df['class'].map({0:iris.target_names[0],1:iris.target_names[1],2:iris.target_names[2]})

df.describe()

x = iris.data

y = iris.target.reshape(-1,1)

print(x.shape,y.shape)

#划分训练集和测试集

x_train,x_test,y_train,y_test=train_test_split(x,y,test_size=0.3,random_state=35,stratify=y)

print(x_train.shape,y_train.shape)3.定义距离函数

#曼哈顿距离

def l1_distance(a,b):

# 把每一行加起来

return np.sum(np.abs(a-b),axis=1)

#欧式距离

def l2_distance(a,b):

return np.sqrt(np.sum((a-b)**2,axis=1))4.分类器实现

#分类器实现

class kNN(object):

# 定义一个初始化方法,__init__ 是类的构造方法

def __init__(self, n_neighbors = 1,dist_func = l1_distance):

self.n_neighbors = n_neighbors

self.dist_func = dist_func

# 训练模型方法

def fit(self,x,y):

self.x_train = x

self.y_train = y

#模型预测方法

def predict(self,x):

# 初始化预测分类数组

y_pred = np.zeros((x.shape[0],1),dtype=self.y_train.dtype)

# 遍历输入的x数据点,取出每一个数据点的序号i和数据x_test

for i,x_test in enumerate(x):

# x_test 所有训练数据计算距离

distances = self.dist_func(self.x_train,x_test)

# 得到的距离按照由近到远排序

nn_index = np.argsort(distances)

# 选取最近的k个点,保存它们对应的分类类别

# nn_y = self.y_train[nn_index[:self.n_neighbors]].ravel()

nn_y = self.y_train[nn_index[:self.n_neighbors] ].ravel()

#统计类别出现频率最高的那个,赋给y_pre[i]

y_pred[i]=np.argmax(np.bincount(nn_y))

return y_pred5.测试结果

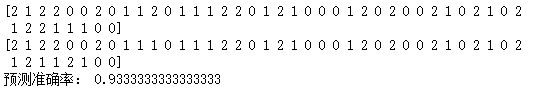

测试1

#定义一个knn实例

knn = kNN(n_neighbors = 3)

#训练模型

knn.fit(x_train,y_train)

#传入测试数据,做预测

y_pred = knn.predict(x_test)

print(y_test.ravel())

print(y_pred.ravel())

#求出预测准确率

accuracy = accuracy_score(y_test,y_pred)

print("预测准确率:",accuracy)

测试2:

#定义一个knn实例

knn = kNN()

#训练模型

knn.fit(x_train,y_train)

# 保存结果list

result_list = []

# 针对不同的参数选取,做预测

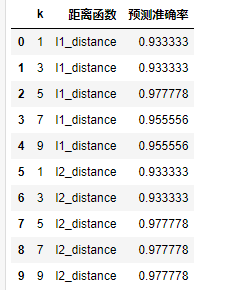

for p in [1,2]:

knn.dist_func = l1_distance if p==1 else l2_distance

# 考虑不同的k取值,步长为2

for k in range(1,10,2):

knn.n_neighbors = k

#传入测试数据,做预测

y_pred = knn.predict(x_test)

#求出预测准确率

accuracy = accuracy_score(y_test,y_pred)

result_list.append([k,'l1_distance' if p==1else 'l2_distance',accuracy] )

df=pd.DataFrame(result_list,columns=['k','距离函数','预测准确率'])

df

从测试2我们可以看出,当k=5,距离函数为l1_distance时,预测准确率最高。K值的选取不同,距离函数的选取,会影响准确率。