PU-learning算法

我们通常进行的分类学习,一般是有监督学习,即从确定的正负样本中学习规律,对新数据进行预测。在实际业务场景中,可能会因为数据积累不够、标注数据成本高等问题,使得数据样本不丰富。PU-learning是一种半监督学习算法,主要用来解决可以清晰确定正样本但不能确定负样本的问题。

建立PU分类器的基本思想是两步法:1、从未标注样本中找到可靠负例(RN)。2、用确定的正例和可靠负例训练分类器。

确定可靠负例(RN)

寻找可靠负例的方法有朴素贝叶斯、Spy、1-DNF等,下面选取Spy方法进行介绍并演示。

Spy算法流程

step1

P=标注的正样本;

U=未标注样本;

RN初始设为空集;

#RN用来存储可靠负例样本

step2

step3

step4

从P中选取一部分作为集合S;

PS=P-S,且label为1;

US=U+S,且label为-1;

用PS和US训练一个分类器g;

对U使用g,

得到每个样本d的分类概率pr(d);

用S确定阈值tr;

当pr(d)<tr,将d加入RN

其中,一般从P中选择15%样本作为S,tr指判断为正例的概率。阈值tr的选择上,应满足S中正例错误率低于1-r的条件下,最小化U中正例数目。

训练分类器

在得到RN后,用P和RN通过传统机器学习分类算法,训练分类器,预测新样本。

R语言实现

step1:导入数据,并划分P和U集合。

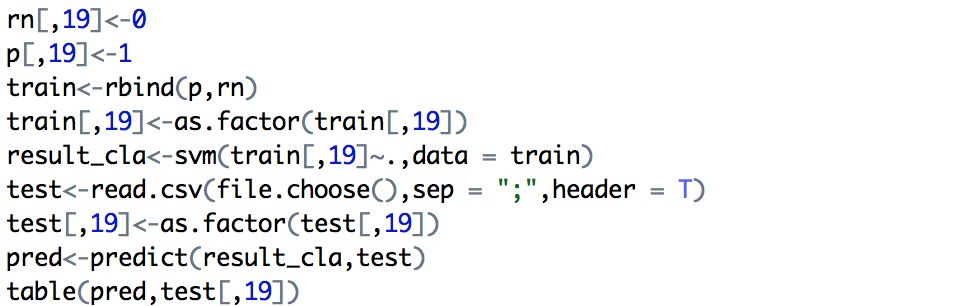

step2:随机抽取p中15%样本作为集合s,并建立ps和us集合。

step3:使用朴素贝叶斯分类,对ps和us训练分类器,并作用到u集合上,计算每个样本的分类概率。朴素贝叶斯分类可用e1071包中的naiveBays函数。

step4:使用s确定阈值tr,并将分类概率小于tr的u中样本加入rn。这里为了简化操作,选择s中所有样本分类概率的10%分位点作为tr。

step5:使用p和rn训练svm分类器,并对测试集test进行预测,通过混淆矩阵观察分类效果。svm分类器可用e1071包中对svm函数实现。

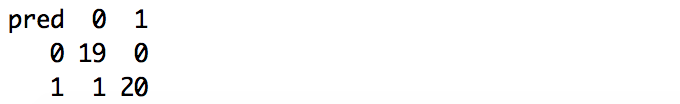

最终混淆矩阵效果为: