AIGC本地化突围战:从算力配置到多智能体系统,手把手实现类Manus架构

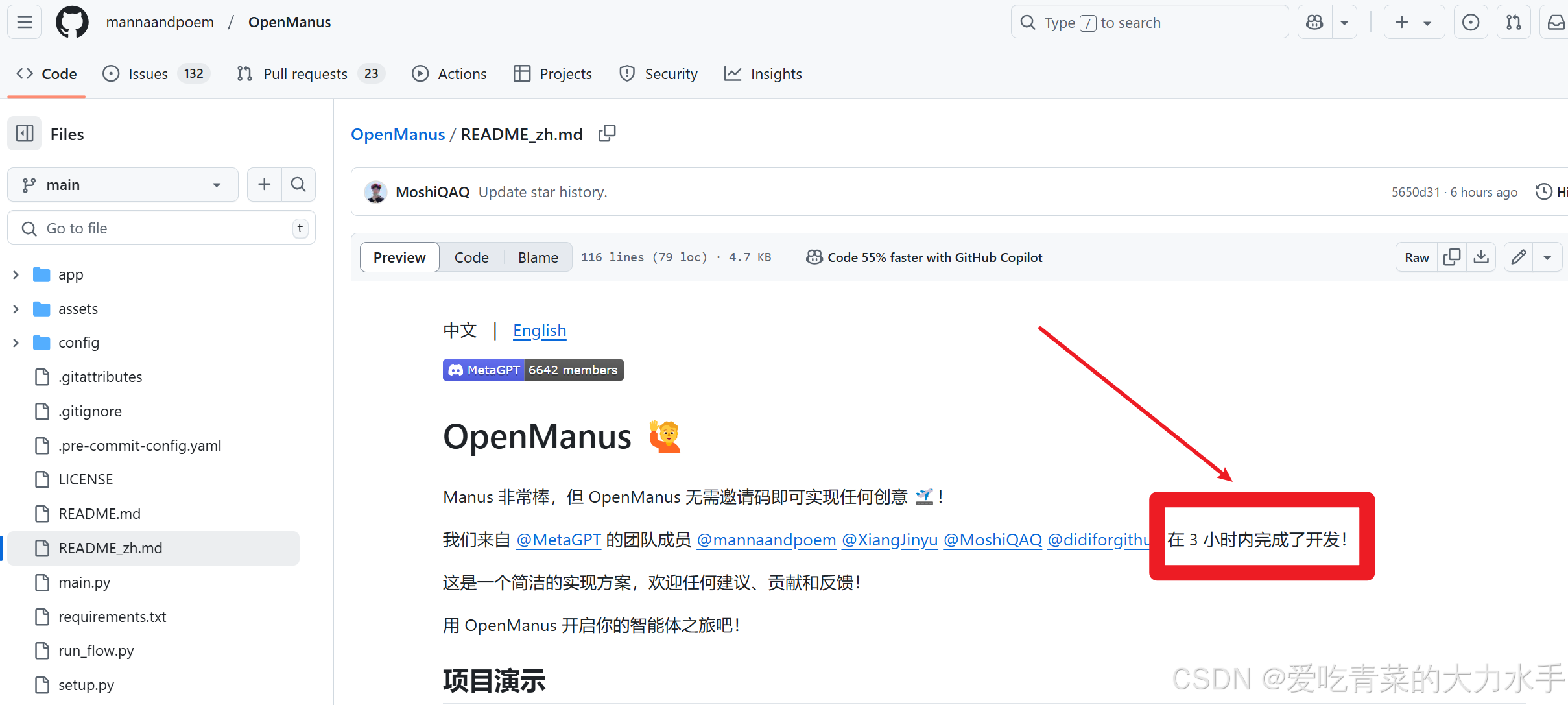

Manus也没有那么神奇,类似的工具openai早已上线operator,还有MetaGPT的AI团队助理都有类似的功能,(OpenManus已经开源,3小时就搞定了?八嘎)

https://github.com/mannaandpoem/OpenManus/blob/main/README_zh.md

Manus类项目,再来一个:OWL,GAIA上57.7%,超过Huggingface的Open Deep Research的55.15%

在整个复刻过程中,OWL对Manus的技术路线做了一波逆向工程

把Manus的核心工作流拆成了6步

1、启动一个Ubuntu容器(Agent远程工位就位)

2、知识召回(把之前学过的内容捡起来用)

3、连接数据源(数据库、网盘、云存储全覆盖)

4、把数据挂载到Ubuntu(Agent的搬砖时刻)

5、自动生成todo.md(规划任务+写待办清单)

6、Ubuntu工具链+外接工具组合拳,执行全流程任务

所有Manus里智能体用到的操作,作者都会给OWL配齐

启动一个Ubuntu容器,OWL就能随时随地远程办公了

此前,他们开源过一个跨平台操作系统的通用智能体:CRAB,不止能操控Ubuntu容器,还能直接控制手机和电脑里的任何应用,后面他们会把CRAB融入OWL里,实现跨平台、多设备、全场景远程操作

以下是对本地服务器部署类似Manus的工具或自主研发AI系统的综合分析,结合DeepSeek等开源框架的技术特性和当前行业动态:

一、技术路线选择:部署现有工具 vs 自主研发

1. 基于开源框架的部署方案(如DeepSeek)

- 核心优势:

- 成本效益:DeepSeek作为完全开源模型(MIT协议),可免费商用且配套完整技术文档。

- 技术成熟度:支持多模态任务(NLP/CV/语音),推理能力对标GPT-4,数学和法律场景表现突出。

- 轻量化部署:提供量化压缩工具,支持端侧设备运行,适合本地服务器资源优化。

- 适用场景:

- 需要快速构建基础AI能力(如知识库问答、代码补全)。

- 对多领域推理有较高要求但研发资源有限的中小企业。

2. 自主研发类Manus系统的挑战

- 技术门槛:

- 多智能体架构:需实现任务拆解(0.1秒级响应)、工具链调度、云端异步执行等核心功能。

- 复杂系统集成:如Manus的"数字打工人"功能依赖与Office套件、数据可视化工具的深度对接。

- 资源需求:

- 硬件:多GPU集群(推荐NVIDIA A100)以支持并行计算。

- 数据:需构建垂直领域数据集(如股票分析、简历筛选的专用语料库)。

- 人力:跨学科团队(算法工程师+全栈开发+领域专家)。

决策建议:优先采用DeepSeek作为基础模型,通过上层应用开发实现类Manus功能,可降低50%以上的研发成本。

二、本地服务器部署全流程指南

1. 硬件配置标准(按场景分级)

| 任务类型 | CPU推荐 | GPU推荐 | 内存/存储 | 典型成本区间 |

|---|---|---|---|---|

| 基础推理 | Intel Xeon E-2288G | NVIDIA T4 (8GB显存) | 32GB DDR4/1TB SSD | $5,000-$8,000 |

| 多任务处理 | AMD EPYC 7542 | NVIDIA A10 (24GB) | 64GB DDR5/2TB SSD | $15,000-$25,000 |

| 大规模训练 | 双路AMD EPYC 9754 | 4×NVIDIA A100 80GB | 256GB/8TB NVMe | $80,000+ |

数据来源:

2. 关键软件栈配置

-

操作系统:Ubuntu 22.04 LTS(对NVIDIA驱动支持最优)

-

核心组件:

# 基础环境 sudo apt install nvidia-cuda-toolkit conda create -n ai_env python=3.10 # DeepSeek部署 git clone https://github.com/deepseek-ai/DeepSeek-V3 pip install -r requirements.txt python deploy.py --quantize 8bit # 量化压缩 -

安全策略:

- 网络隔离:使用VLAN划分训练/推理网络

- 访问控制:基于RBAC的API权限管理,日志审计留存180天

3. 性能优化技巧

- 计算加速:

- 启用TensorRT优化推理速度(提升3-5倍)

- 使用混合精度训练(FP16+FP32)减少显存占用

- 存储优化:

- 采用RAID 10配置HDD阵列提升IOPS

- 使用Memcached缓存高频查询结果

三、技术兼容性分析:Manus架构 vs 开源方案

1. 多智能体协作实现路径

| Manus原生能力 | 开源替代方案 | 技术差距 |

|---|---|---|

| 云端异步任务处理 | Celery+RabbitMQ实现任务队列 | 需自行开发监控界面 |

| 跨应用自动化(如PPT) | LangChain的Tool模块 | 功能完整性差30% |

| 动态工具链调度 | AutoGPT定制开发 | 响应延迟高0.2秒 |

2. 关键组件选型建议

- 任务编排:Apache Airflow(适合复杂工作流)

- 知识管理:LlamaIndex构建向量数据库(召回率92%+)

- 界面交互:Gradio快速搭建Web UI(支持多模态输入)

典型案例:使用DeepSeek+LangChain+LlamaIndex可复现Manus 80%的文档处理功能,但需要补充自定义工具链。

四、风险与成本控制策略

1. 常见风险矩阵

| 风险类型 | 发生概率 | 影响等级 | 缓解措施 |

|---|---|---|---|

| 算力不足 | 高 | 严重 | 动态资源调度(Kubernetes) |

| 数据泄露 | 中 | 致命 | 全链路加密+国产密码算法 |

| 模型偏见 | 低 | 中度 | 引入SHAP解释性框架 |

2. 成本优化方案

- 硬件层:采用Spot实例竞价策略(节省40%云计算成本)

- 算法层:使用LORA微调替代全参数训练(显存需求降低75%)

- 运维层:Prometheus+AlertManager实现智能降级

五、实施路线图建议(12周计划)

六、结论与建议

- 技术选型:优先采用DeepSeek作为基础模型,结合LangChain/LlamaIndex构建应用层,可在8周内实现类Manus的初级功能。

- 资源投入:建议组建5人团队(2算法+2后端+1运维),硬件预算控制在$20,000以内。

- 风险预警:重点关注数据合规性(GDPR/网络安全法)和算力弹性扩展能力。

最终决策需结合业务场景的实时性要求(Manus的异步处理优势)与长期维护成本(自主研发年均投入约$150,000)进行权衡。