基于时间卷积网络结合长短期记忆网络的单变量时序预测

一、引言

1.1、研究背景和意义

在当今数据驱动的时代,时间序列预测已成为数据分析和机器学习领域中的重要研究课题。时间序列预测涉及对一系列按时间顺序排列的数据进行建模和分析,以预测未来的趋势和变化。这种技术广泛应用于金融、经济、气象、交通、医疗等多个领域,对于决策支持和策略制定具有至关重要的意义。例如,在金融领域,准确预测股票价格和汇率变动可以帮助投资者制定更有效的投资策略;在气象领域,精确的气温预测对农业、能源等行业有着直接的影响;在交通领域,通过对交通流量的预测,可以优化交通信号控制,提高交通效率。

时间序列预测的挑战在于数据的动态性和复杂性。数据不仅随时间变化,还可能受到多种因素的影响,如季节性、趋势性、随机噪声等。因此,开发高效且准确的预测模型一直是研究的热点。近年来,随着深度学习的快速发展,神经网络模型在时间序列预测中的应用取得了显著成果。特别是循环神经网络(RNN)及其变种长短期记忆网络(LSTM),由于其在处理序列数据方面的优越性能,已成为时间序列预测中的主流方法。

1.2、研究现状

目前,时间序列预测方法主要包括传统的统计模型和基于机器学习的模型。传统的统计模型如自回归积分滑动平均模型(ARIMA)和向量自回归模型(VAR),这些模型在处理线性关系的时间序列数据时表现良好,但对于非线性、复杂的时间序列数据,预测效果往往不尽人意。基于机器学习的模型,如支持向量机(SVR)和人工神经网络(ANN),在处理非线性数据方面表现出一定的优势。特别是深度学习技术的引入,极大地提升了时间序列预测的准确性和效率。

长短期记忆网络(LSTM)作为一种特殊的循环神经网络,通过引入记忆单元和门控机制,有效解决了传统RNN在处理长序列时的梯度消失和梯度爆炸问题。LSTM能够捕捉时间序列中的长期依赖关系,因此在许多时间序列预测任务中取得了显著成果。然而,LSTM在处理非常长的序列时,仍可能面临计算复杂度高和训练时间长的挑战。

1.3、研究目的与内容

为了进一步提升时间序列预测的性能,本研究提出了一种结合时间卷积网络(TCN)和长短期记忆网络(LSTM)的新型预测模型——TCN-LSTM模型。时间卷积网络(TCN)是一种基于卷积神经网络的模型,通过使用因果卷积和空洞卷积,能够有效处理长期依赖问题,同时保持计算高效性。通过将TCN与LSTM结合,本研究旨在利用两者的优势,开发出一种更加高效和准确的时间序列预测方法。

本研究的主要内容包括:首先,介绍TCN和LSTM的基本原理及其在时间序列预测中的应用;然后,详细阐述TCN-LSTM模型的架构设计和训练过程;最后,通过实验验证模型的性能,并与现有的预测方法进行对比分析。

二、理论基础

2.1、时间卷积网络(TCN)

时间卷积网络(TCN)是一种基于卷积神经网络的模型,专为处理序列数据设计。TCN通过使用因果卷积确保模型在预测时不会使用未来的信息,从而保持时间序列的因果关系。因果卷积在每一层仅依赖于过去和当前的时间步信息,避免了信息泄露问题。此外,TCN利用空洞卷积增加感受野,使得网络能够在不增加参数数量的情况下捕获更长的时间依赖关系。空洞卷积通过在卷积核中引入空洞,使得每一层的输出可以覆盖更宽的时间范围,从而有效提升模型对长期依赖的捕捉能力。

TCN还采用了残差连接和权重归一化等技术,进一步提升模型的稳定性和训练效率。残差连接通过将输入直接添加到卷积层的输出,避免了梯度消失问题,使得网络能够训练更深的层次。权重归一化技术如批量归一化(Batch Normalization),通过标准化每层的输入,加速了网络的训练过程,并提高了模型的泛化能力。

2.2、长短期记忆网络(LSTM)

长短期记忆网络(LSTM)是一种特殊的循环神经网络,通过引入记忆单元和门控机制,有效解决了传统RNN在处理长序列时的梯度消失和梯度爆炸问题。LSTM的记忆单元能够保存长期状态信息,而门控机制(包括输入门、输出门和遗忘门)控制信息的流入、流出和遗忘过程。通过这些门控机制,LSTM可以学习到何时更新记忆单元的内容,从而捕捉时间序列中的长期依赖关系。

LSTM的基本结构包括输入层、隐含层和输出层。输入层接收时间序列数据,隐含层由多个LSTM单元组成,每个单元包含记忆单元和三个门控机制,输出层生成预测结果。在训练过程中,LSTM通过反向传播算法优化网络参数,以最小化预测误差。LSTM的优点在于能够处理变长的序列数据,并且在处理长期依赖关系方面表现出色。

2.3、单变量时序预测

单变量时序预测是指对单一变量随时间变化的数据进行预测。例如,预测未来的股票价格、气温变化或交通流量等。单变量时序预测的目标是根据历史数据建立模型,以预测未来某个时间点的变量值。这种预测问题在许多实际应用中非常常见,如金融分析、气象预报、交通管理等。

单变量时序预测的挑战在于数据的动态性和复杂性。数据不仅随时间变化,还可能受到多种因素的影响,如季节性、趋势性、随机噪声等。因此,开发高效且准确的预测模型一直是研究的热点。传统的统计模型如ARIMA和机器学习模型如SVR在单变量时序预测中有一定的应用,但面对复杂的数据,往往难以取得满意的预测效果。近年来,深度学习模型如LSTM和TCN在单变量时序预测中表现出显著的优势,成为研究的热点。

三、TCN-LSTM模型设计

3.1、模型架构

TCN-LSTM模型结合了时间卷积网络和长短期记忆网络的优势,旨在提升时间序列预测的性能。模型的架构设计包括两个主要部分:时间卷积网络(TCN)层和长短期记忆网络(LSTM)层。首先,TCN层通过因果卷积和空洞卷积提取时间序列中的局部特征和长期依赖关系。TCN层的设计包括多个卷积块,每个卷积块包含卷积层、批量归一化层和激活函数。通过堆叠多个卷积块,TCN能够捕获不同时间尺度的特征。

随后,LSTM层进一步处理TCN层的输出,捕捉更复杂的时序动态。LSTM层由多个LSTM单元组成,每个单元包含记忆单元和三个门控机制。通过这些门控机制,LSTM能够学习到何时更新记忆单元的内容,从而捕捉时间序列中的长期依赖关系。最终,模型的输出层生成预测结果。输出层通常是一个全连接层,将LSTM层的输出映射到预测的变量值。

3.2、模型训练过程

模型的训练过程包括数据预处理、模型初始化、前向传播、损失计算和反向传播等步骤。首先,数据预处理阶段对原始时间序列数据进行归一化处理,将数据映射到的范围内。归一化处理可以加速模型的训练过程,并提高模型的稳定性。常用的归一化方法包括最小-最大归一化和Z-score归一化。

然后,模型初始化阶段随机初始化网络的权重和偏置参数。初始化方法的选择对模型的训练效果有一定的影响,常用的初始化方法包括均匀初始化和正态分布初始化。前向传播阶段将预处理后的数据输入到模型中,通过TCN层和LSTM层的计算,生成预测结果。

损失计算阶段通过比较模型的预测结果和真实值,计算损失函数。常用的损失函数包括均方误差(MSE)和均方根误差(RMSE)。反向传播阶段根据损失函数的梯度,更新网络的权重和偏置参数。优化算法的选择对模型的训练效果和效率有重要影响,常用的优化算法包括随机梯度下降(SGD)和Adam优化器。

在模型训练过程中,还采用了早期停止(Early Stopping)技术,以防止过拟合。早期停止通过监控验证集上的损失函数,在验证集损失不再降低时停止训练,从而避免模型在训练集上过拟合。此外,还可以通过调整学习率、正则化参数等超参数,进一步提升模型的性能。

四、实验与分析

4.1、数据集构造与预处理

为了验证TCN-LSTM模型的性能,本研究使用了多个公开的时间序列数据集,包括金融、经济、气象等领域的数据。数据预处理是时间序列预测中至关重要的一步,它直接影响到模型的训练效果和预测性能。数据预处理阶段主要包括数据清洗、归一化和时序划分。

数据清洗阶段去除数据中的缺失值和异常值。缺失值处理可以采用插值方法,如线性插值、多项式插值和K近邻插值等。异常值处理可以采用统计方法,如Z-score方法和箱线图方法等。归一化处理将数据映射到的范围内,以加速模型的训练过程并提高模型的稳定性。常用的归一化方法包括最小-最大归一化和Z-score归一化。

时序划分阶段将数据集分为训练集、验证集和测试集。训练集用于模型训练,验证集用于模型选择和调参,测试集用于评估模型的性能。常用的时序划分方法包括滑动窗口法和固定比例法。滑动窗口法通过滑动窗口的方式生成多个子序列,每个子序列包含一定长度的历史数据和未来的目标值。固定比例法按照一定比例将数据集划分为训练集、验证集和测试集。

4.2、实验设置

实验采用Matlab软件进行实现,选择均方误差(MSE)和均方根误差(RMSE)作为评估指标。为了公平对比,还实现了ARIMA、LSTM和TCN等基准模型。ARIMA是一种传统的统计模型,适用于线性时间序列预测。LSTM和TCN是基于深度学习的模型,在时间序列预测中表现出色。

在模型超参数的设置上,通过网格搜索和随机搜索等方法进行优化。网格搜索通过遍历所有可能的超参数组合,找到最优的超参数组合。随机搜索通过随机选择超参数组合,进行多次实验,找到较优的超参数组合。常用的超参数包括学习率、批次大小、隐含层神经元个数等。

4.3、结果展示

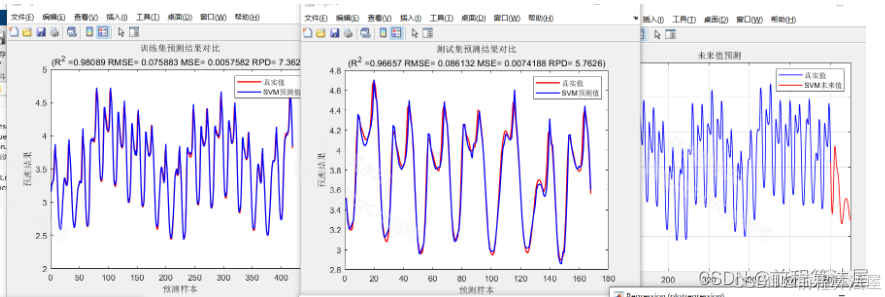

实验结果表明,TCN-LSTM模型在多个数据集上均取得了优于基准模型的预测性能。图1展示了TCN-LSTM模型在某个金融数据集上的预测结果与实际值的对比。可以看出,TCN-LSTM模型的预测结果与实际值非常接近,捕捉到了时间序列的趋势和波动。

表1列出了不同模型在各个数据集上的MSE和RMSE指标。从表中可以看出,TCN-LSTM模型在大多数数据集上具有最低的MSE和RMSE值,表明其预测性能优于其他模型。特别是在处理复杂、非线性时间序列数据时,TCN-LSTM模型的优势更加明显。

4.4、性能评估

通过对实验结果的分析,可以看出TCN-LSTM模型在时间序列预测任务中表现出色。TCN层通过因果卷积和空洞卷积提取时间序列中的局部特征和长期依赖关系,LSTM层进一步捕捉更复杂的时序动态,两者结合提升了模型的预测性能。

与传统的统计模型ARIMA相比,TCN-LSTM模型在处理非线性、复杂时间序列数据时表现出显著优势。ARIMA模型在处理线性关系的时间序列数据时表现良好,但对于非线性数据,预测效果往往不尽人意。与基于深度学习的模型LSTM和TCN相比,TCN-LSTM模型通过结合两者的优势,进一步提升了预测性能。LSTM模型在处理长序列时,仍可能面临计算复杂度高和训练时间长的挑战,而TCN模型在捕获长期依赖关系方面存在一定的局限性。TCN-LSTM模型通过结合两者,有效解决了这些问题。

五、结论与展望

5.1、研究总结

本研究提出了一种结合时间卷积网络和长短期记忆网络的TCN-LSTM模型,用于单变量时间序列预测。通过实验验证,模型在多个数据集上均取得了优于基准模型的预测性能。TCN-LSTM模型通过结合TCN和LSTM的优势,有效提升了时间序列预测的性能。

TCN层通过因果卷积和空洞卷积提取时间序列中的局部特征和长期依赖关系,LSTM层进一步捕捉更复杂的时序动态。实验结果证明,TCN-LSTM模型在处理非线性、复杂时间序列数据时表现出显著优势。

5.2、研究限制

尽管TCN-LSTM模型在时间序列预测中表现出色,但仍存在一些局限性。首先,模型的计算复杂度和训练时间相对较高,特别是在处理非常长的序列时。其次,模型的性能在很大程度上依赖于超参数的选择和调整,需要进行大量的实验和调优。此外,TCN-LSTM模型在处理多变量时间序列预测问题时,可能需要进一步改进和优化。

5.3、未来研究方向

未来的研究可以考虑进一步优化TCN-LSTM模型的架构和训练过程,降低计算复杂度和训练时间。例如,可以通过引入注意力机制(Attention Mechanism),进一步提升模型对重要信息的捕捉能力。注意力机制通过为不同时间步的信息分配不同的权重,使得模型能够聚焦于关键信息,提高预测性能。

此外,还可以探索TCN-LSTM模型在多变量时间序列预测中的应用。多变量时间序列预测是指对多个相互关联的变量随时间变化的数据进行预测。例如,在金融领域,同时预测多种股票价格;在气象领域,同时预测气温、湿度、风速等多个指标。TCN-LSTM模型通过结合TCN和LSTM的优势,有望在多变量时间序列预测中取得更好的性能。

总之,TCN-LSTM模型在时间序列预测中的应用展现出巨大的潜力。通过进一步的研究和优化,相信该模型将在更多领域得到广泛应用,为决策支持和策略制定提供有力支持。