论文:REASONING ON GRAPHS: FAITHFUL AND INTERPRETABLE LARGE LANGUAGE MODEL REASONING

代码:https://github.com/RManLuo/reasoning-on-graphs

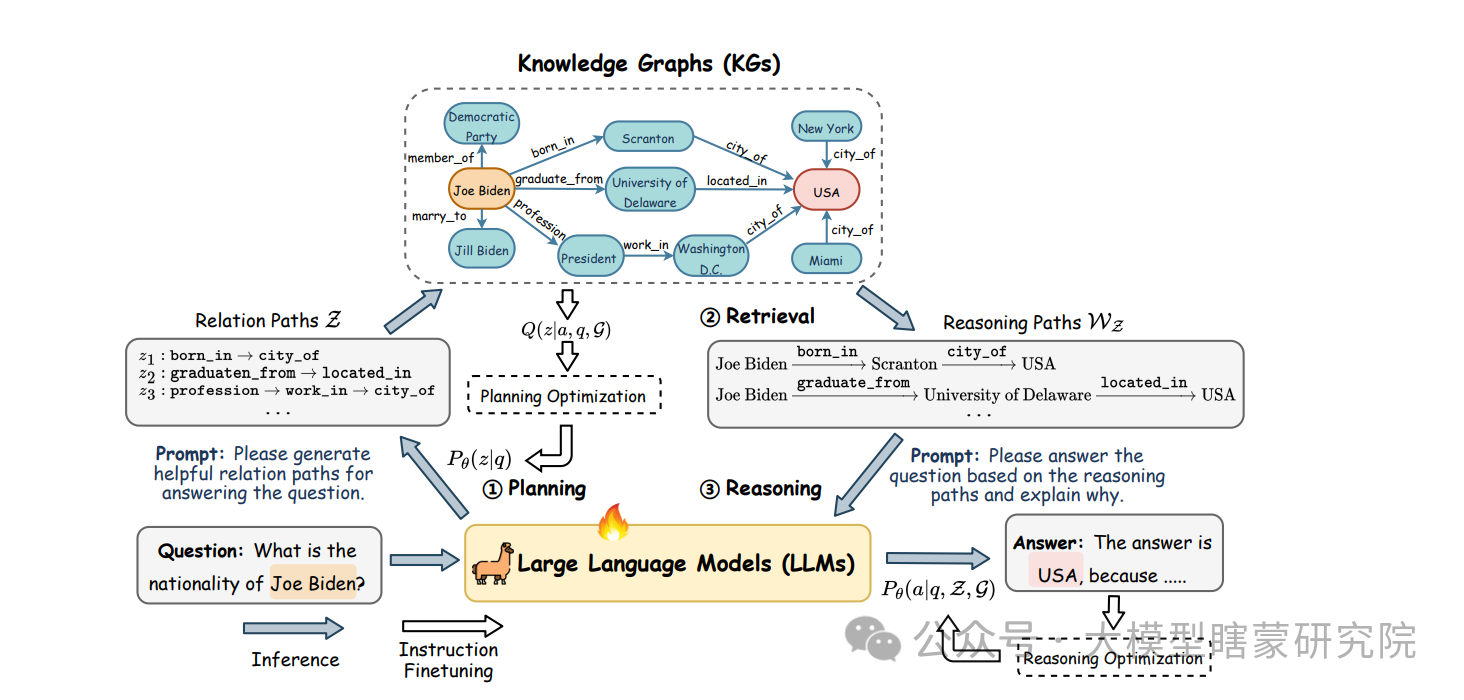

问:RoG中提到的“planning-retrieval-reasoning框架”指的是什么?

RoG 的三步法: “先规划(LLM 分析回答问题,要走哪些关系)→ 再检索(KG 按关系路径找实体)→ 后推理(LLM 综合拿到的证据输出答案)”。

- Planning(规划)

:先让模型生成一个“关系路径”,也就是一个潜在的推理路线图,例如“人物 A -> 父亲 -> 人物 B -> 居住城市 -> 城市 C”这类关系序列,用来表示思路或计划。

- Retrieval(检索)

:根据上一步的“关系路径”,到知识图谱里找出具体的三元组链条(真正的实体和关系),得到一条或多条“推理路径”(reasoning path)。

- Reasoning(推理)

:最后让LLM基于检索到的路径,再结合问题本身,生成最终答案,并给出可解释的推理过程。

为什么是“让 LLM 先输出一条关系路径 (planning)”,再去执行检索?换种方法行不行?

-

如果由模型先“显式生成关系路径”,能够保证“推理链”是大语言模型与知识图谱彼此协作而非相互割裂;

-

让模型先说出它要用到的关系序列,可以减少“盲搜”或“手动写 SPARQL 不一定能执行”的尴尬;

-

这就意味着检索过程更有指向性。我们在 KG 里只需按这条路径做有限的 BFS/DFS,就能大幅减少无关三元组的干扰,提升检索质量。

-

也能让后续在推理时(reasoning module)输出的解释更加清晰。

问:一旦路径错误,后续不都白搭?

规划-检索-推理三阶段看似优雅,可万一第一阶段就生成了错误路径,后面步骤能否“自救”?还有救吗?

-

如果只生成一条路径,确实可能导致“全盘皆输”。

-

为此,RoG 通常让 LLM 生成多条候选路径(Top-K),再通过检索得到多组结果,在“Reasoning”阶段交给大模型综合决策,从而降低单一路径出错的影响。

-

也可以在检索到的内容为空或明显冲突时,触发 LLM 回溯,生成新的路径。

为什么不直接将所有知识图谱 (KG) 的三元组拿来作为上下文,让 LLM 自由阅读?

因为如果只做“全文检索式”地把大段三元组堆给 LLM,会导致两大问题:

-

-

噪声过大,信息过载,LLM 无法有效聚焦;

-

缺少“图结构”这一关键特征,LLM 依然不知道多跳路径该怎么走。

-

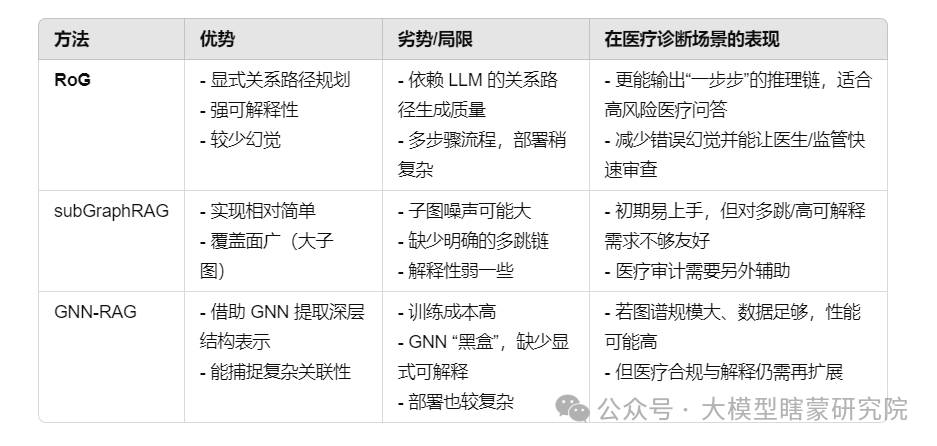

问:RoG与这三类方法相比,有何优势?

- 嵌入式方法:把KG中的实体、关系以及问题文本映射到某个向量空间,通过一些神经网络(比如记忆网络、图神经网络等)去进行多跳推理。但它往往不直接输出可解释的“路径”。与嵌入式方法相比:RoG直接输出关系路径,并在KG中执行,使得推理过程更透明。

- 检索增强方法:先设计某种检索策略,从KG中拿出与问题较相关的子图或三元组,然后再由模型做最后的答案生成。它注重把KG当做“事实数据库”用,但可能忽略了KG的结构特性。与检索增强方法相比:RoG不仅是检索三元组,还明确利用“关系路径”来约束检索,这就充分利用了KG的结构信息

- 语义解析方法:把自然语言问题转换成结构化查询语言(如SPARQL),再去KG里执行。但要生成正确的SPARQL往往不易,如果生成的SPARQL不合法,就无法得到答案。

与语义解析方法相比:RoG生成的“关系路径”更灵活,万一路径里某段检索无结果,还可以用LLM的语言理解能力去纠正或综合,而不是一下子就“执行失败”。

对比 SubGraphRAG、GNN-RAG 等方案,RoG 的最大特征在于“显式关系路径规划 + 可解释性 + 多跳过程受控”,这在医疗诊断这种高风险、高审核需求的场景下具备较大优势。

问:这种方法的主要意义是什么?

-

它证明了将LLM与KG结合,既能弥补LLM知识不足,又能减少幻觉,并且用“关系路径”的方式让推理过程更加可解释。

-

这些特性对于高风险或严谨场景(如法律、医疗)尤其有价值。

全流程分析

├── 1 输入【问题与知识图谱】

│ ├── 问题:自然语言问题 q【输入】

│ └── 知识图谱:包含实体、关系的知识图谱 G【输入】

│

├── 2 处理过程【Plan-Retrieve-Reason三阶段】

│ ├── 2.1 规划阶段(Planning)【技术:指令微调】

│ │ ├── 输入:问题 q【从上一级输入】

│ │ └── 处理过程:通过微调的 LLM 生成关系路径 z【方法:生成与问题相关的可执行路径】

│ │ └── 关系路径:由一系列关系组成,反映知识图谱中实体间的关联【模型生成】

│ ├── 2.2 检索阶段(Retrieval)【技术:宽度优先搜索(BFS)】

│ │ ├── 输入:关系路径 z 和知识图谱 G【从规划阶段输出】

│ │ └── 处理过程:基于关系路径 z 从知识图谱 G 中检索推理路径 w【方法:子图检索】

│ │ ├── 检索到的推理路径:实体间的路径实例【路径实例】

│ │ └── 推理路径:沿着关系路径扩展的实体路径【推理支持】

│ ├── 2.3 推理阶段(Reasoning)【技术:FiD框架】

│ │ ├── 输入:推理路径 w【从检索阶段输出】

│ │ └── 处理过程:LLM 基于检索到的推理路径生成答案 a【方法:整合多个路径的推理】

│ │ ├── LLM:基于生成的推理路径,进行逻辑推理并给出答案【输出】

│ │ └── 可解释性:生成的答案包含明确的推理路径和解释【可解释推理】

│

├── 3 输出【最终答案与解释】

│ ├── 答案:根据推理路径生成的最终答案 a【输出】

│ └── 解释:基于推理路径的逻辑推理过程【输出】

│

└── 4 各阶段技术和方法的衔接与互相作用

├── 规划阶段与检索阶段衔接【关系:规划生成关系路径,作为检索依据】

│ ├── 规划阶段通过生成与问题相关的关系路径,保证了检索到的路径在语义上与问题相关【技术衔接】

│ └── 检索阶段的推理路径基于规划路径,减少了信息缺失和幻觉问题【避免错误推理】

├── 检索阶段与推理阶段衔接【关系:检索到的推理路径是推理的依据】

│ ├── 检索的推理路径为推理阶段提供了具体的逻辑步骤【推理支持】

│ └── 推理阶段综合多个推理路径得出最终答案,提升了准确性【多证据整合】

└── 三个阶段的整体目标【最终目标:生成可信且可解释的推理结果】

└── 最终实现通过关系路径生成、检索和推理的全过程,提高 LLM 在 KGQA 任务中的表现【结果优化】