DeepSeek,作为国内领先的AI大模型,凭借其强大的推理能力、高效的模型架构以及开源的生态理念,正在为个人开发者、企业和科研机构带来前所未有的机遇。

为了让更多人深入了解并充分利用DeepSeek的技术优势,北京大学AI肖睿团队精心策划了本次研讨活动,旨在系统梳理DeepSeek的私有化部署路径,从模型选型到落地实践,为不同需求的用户量身定制解决方案。

01、人工智能与DeepSeek

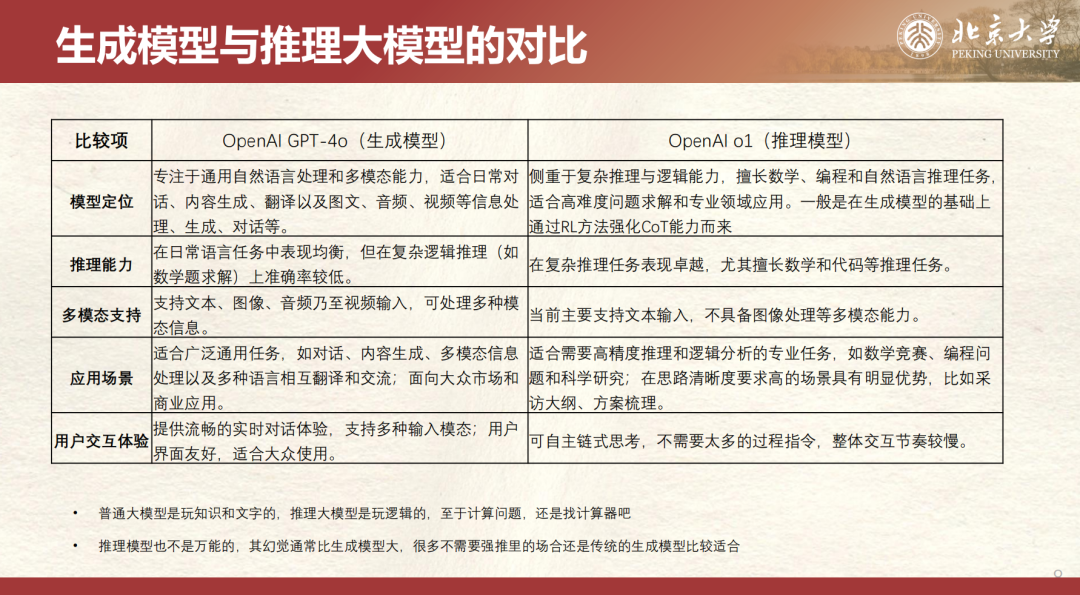

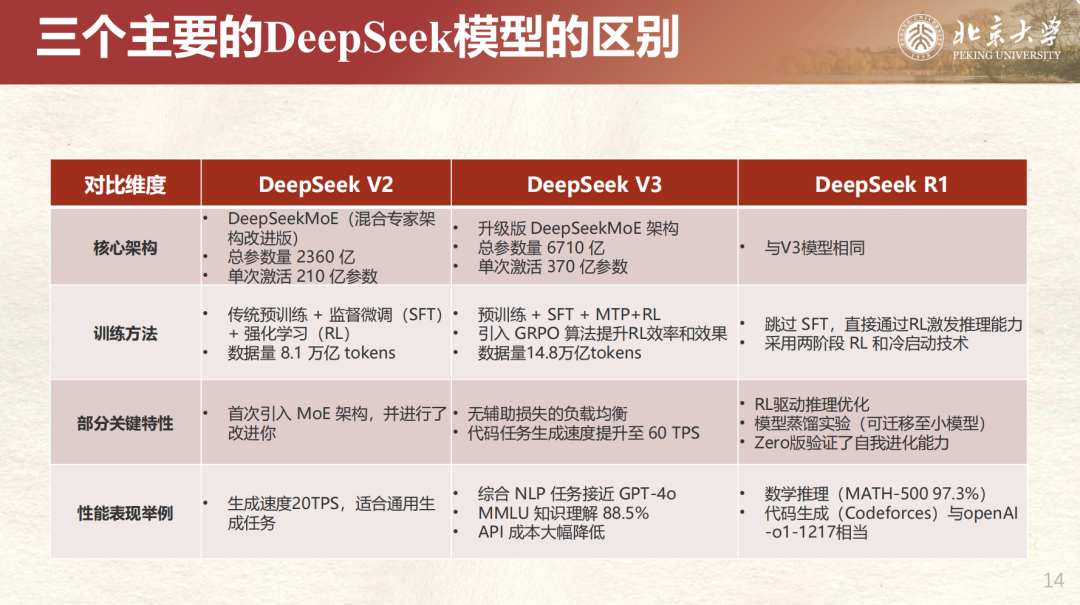

本章节介绍了大模型的基本概念和相关术语,包括多模态、通用模型、行业模型等,并回顾了大模型的发展历程,从传统人工智能到深度学习和Transformer架构的演变。

对比了生成模型与推理模型的特点和应用场景,并重点介绍了DeepSeek的发展历程、技术特点以及其在推理能力上的优势。总结了DeepSeek模型的多种版本(如蒸馏模型和满血版)及其适用场景。

02、个人部署DeepSeek

本章节聚焦于个人用户如何在本地设备上部署DeepSeek模型。介绍了模型参数量对硬件配置的影响,并提供了不同参数量模型的最低和推荐硬件配置。

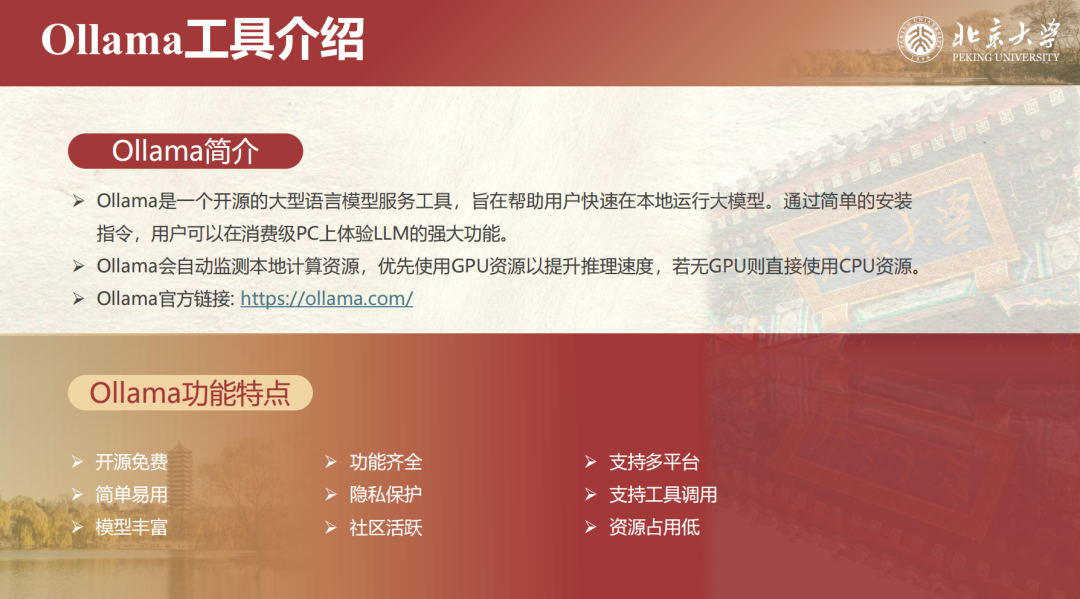

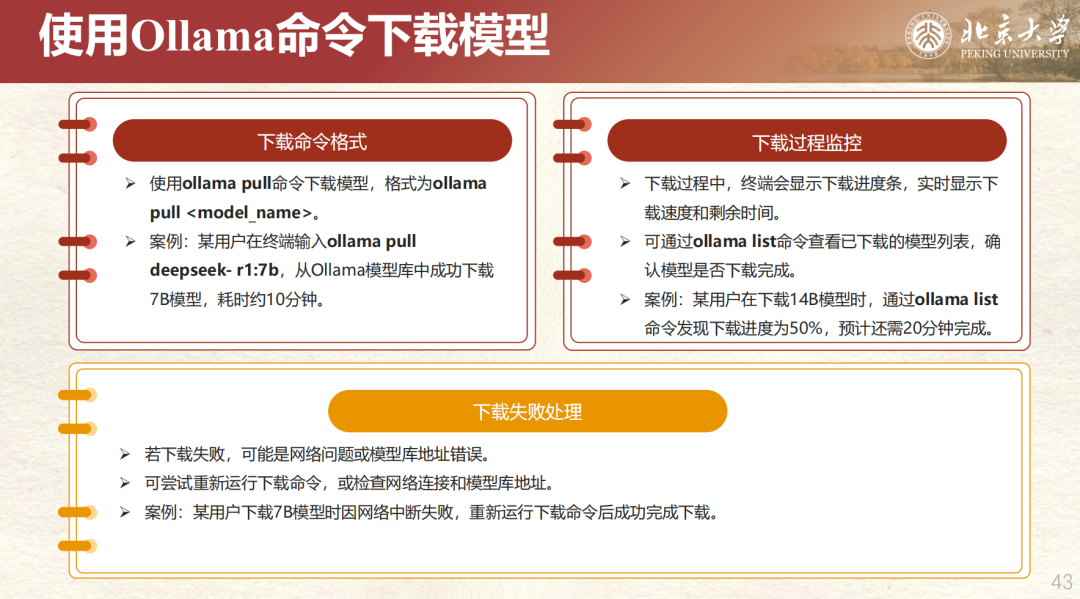

详细说明了使用Ollama框架进行模型部署的步骤,包括环境准备、模型下载、运行和前端展示工具的配置(如PageAssist、Chatbox和OpenWebUI),探讨了Ollama的安装、配置和使用方法,并分享了一些常见问题及解决方案。

03、企业部署DeepSeek

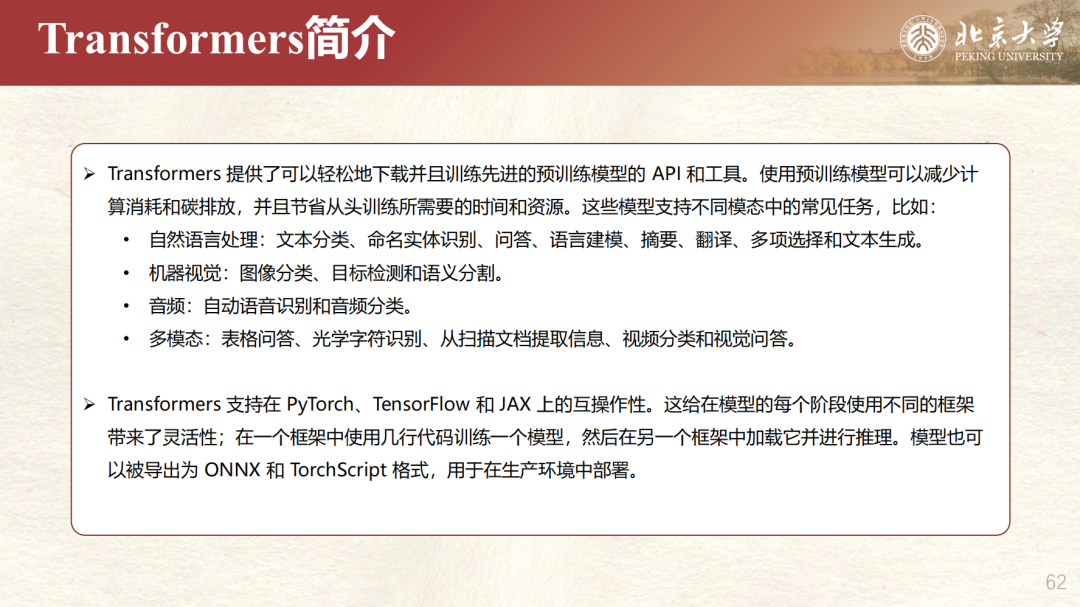

本章节针对企业级用户,介绍了DeepSeek在企业环境中的部署方法。介绍了使用Transformers进行模型快速验证的方法,重点探讨了vLLM框架及其高性能推理能力,包括部署步骤、参数配置和实际性能测试。

分享了一个企业级70B模型的部署案例,并对低成本部署方案(如llama.cpp、KTransformers和Unsloth动态量化)进行了介绍和性能评估,总结了这些方案的优缺点及适用场景。

04、DeepSeek一体机

本章节介绍了DeepSeek一体机的概念和优势,强调其融合了算力、大模型和应用,能够为企业和个人用户提供高效、安全的AI解决方案。

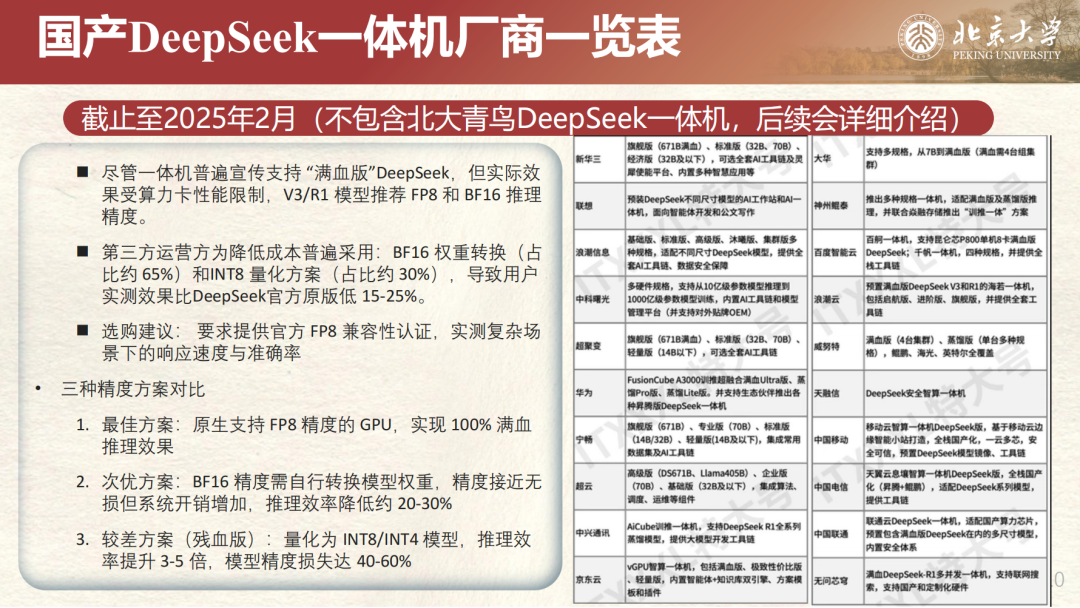

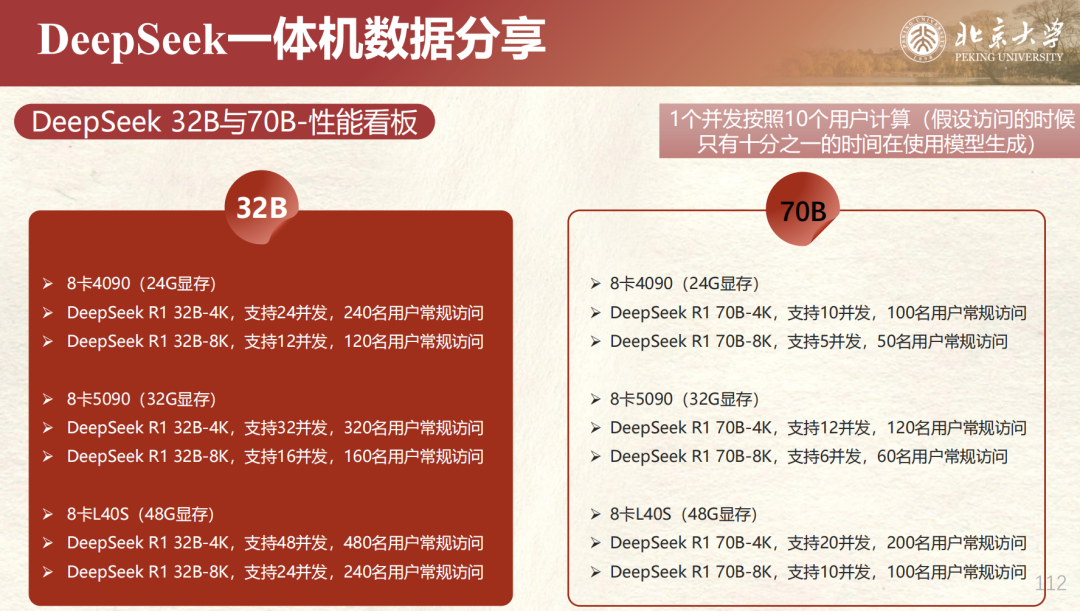

提供了国产DeepSeek一体机的厂商信息、推荐配置和性能数据,并以北大青鸟AI实验室为例,展示了DeepSeek一体机在高校AI教育中的应用。最后,对比了不同配置和精度方案下的性能和成本,为企业和机构选购DeepSeek一体机提供了参考建议。

全文总共121页,这里就不一一展示了。

现在这份资料已经打包好了,话不多说,长按 vx扫码发送 314 即可获取

获取这份PDF:长按扫码发送「 314 」获取