为了避免“王婆卖瓜”的情况,我将从使用费用、硬件要求、安装部署、应用范畴、出图效果、工作效率、学习成本、可控性和使用场景等多个维度对这两款软件进行全面对比。相信看完这篇文章后,你会找到答案。

在找到答案之前,想做个简单的小调查:你选择Midjourney又或者是Stable Diffusion最大的原因是什么呢?

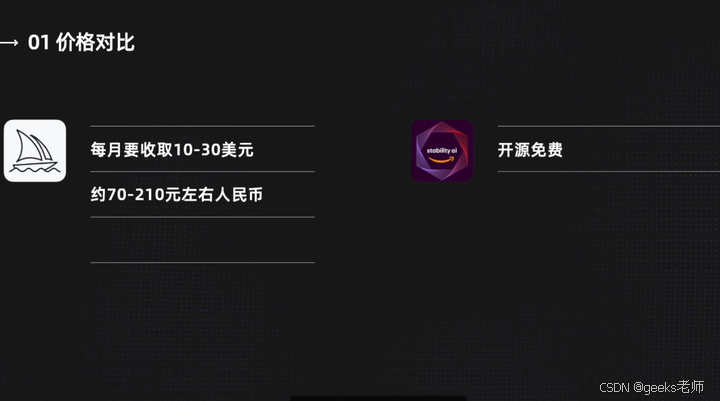

一、使用费用

首先,两款软件最直观的区别就是一个收费,一个免费。

- Midjourney每月要收取10到30美元的费用,大约是70到210元左右的人民币价格。

- Stable Diffusion则是开源免费。

这里或许有人会说,这个环节的对比毫无疑问是Stable diffusion胜出。但我对这个观点持保留的意见。开源免费固然是最好的,但我们不能忽视,并不是每个人都拥有一台能够驾驭Stable diffusion 的高性能电脑的。当我们购买了Midjourney会员的时候,相当于也是购买了Midjourney 的电脑配置服务。他们后台强大的算力可以帮助我们生成优质的图片,这样就可以变相省掉一笔高昂的电脑开销了。

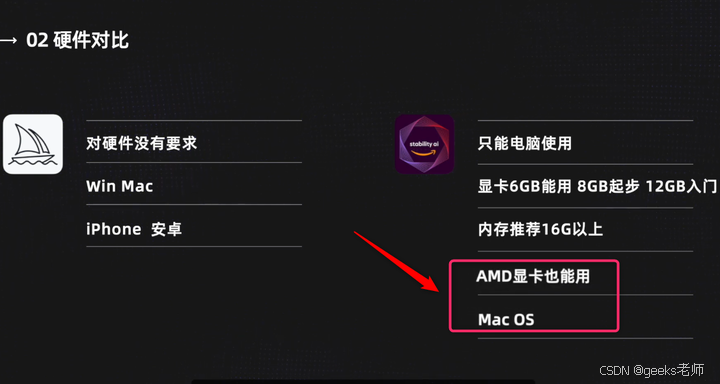

二、硬件要求

刚刚说到硬件,Midjourney对硬件几乎是没有要求的。不管是Windows还是Mac系统,甚至是iPhone和安卓手机上都可以随时随地地工作。而Stable Diffusion只能在电脑上使用,对显卡、内存、硬盘都有较高的要求。

特别是显卡,当你深入研究和使用后,8G显存的显卡也经常会出现显存不足的提示。像最近推出的大模型Stable Diffusion 3.0就要求显卡的显存是12GB以上。到了后面深入的学习,涉及到模型的训练,那么就需要升级到16GB甚至是24GB的高端显卡了。

好消息是,在过往使用AMD显卡的电脑或者是Mac苹果电脑要安装Stable Diffusion是非常困难的,现在市面上也有对AMD显卡支持的整合包了,苹果电脑安装Stable Diffusion也是简单了不少。这就很大程度上拓宽了Stable Diffusion的使用限制,能让更多人可以去体验和感受一下SPA的魅力。

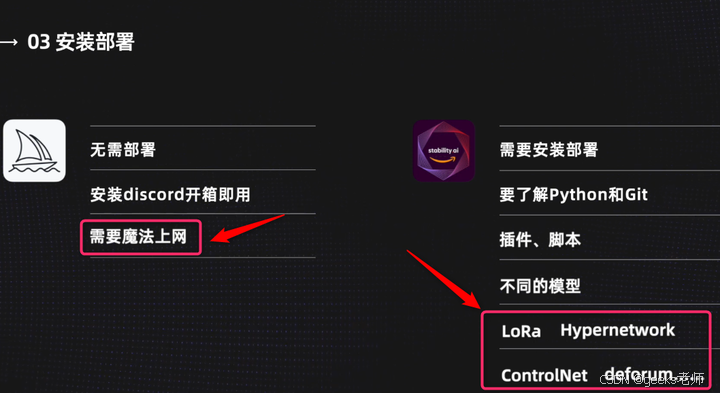

三、安装部署

安装部署Midjourney它不需要复杂的部署和设置,下载好Discord客户端就可以开箱即用了。不过需要注意的是,需要魔法才能使用的。

而Stable Diffusion起手复杂的安装步骤就已经劝退不少人了。由于Stable Diffusion是基于Python语言搭建的,所以部署Stable Diffusion需要对Python和Git都要有一定的基本了解。简单来说就是你需要安装Python和Git,然后通过各种命令把Stable Diffusion Web UI客户端移植到自己的电脑。那么安装部署就搞定了。

但当你高兴地打开Stable Diffusion界面的时候,其实这才是真正的痛苦开始。现在你打开的仅仅是一个毛坯房。接下来你需要安装各种各样的插件脚本,不同的模型LoRa、Hypernetwork、ControlNet、Deforum等等,并且每个插件脚本都有可能出现各种各样的问题,导致不能打开或者是报错。只有当你配置好上述各种各样的东西之后,那么恭喜你,精装房终于装修好了。这时候你甚至不需要联网,直接就可以在本地运行Stable Diffusion,并且生成出来的图片只有你自己可以看到,私密性是非常好的。

而Midjourney生成的图片是大家都可以看到的,除非你购买最贵一档60美元的账号。

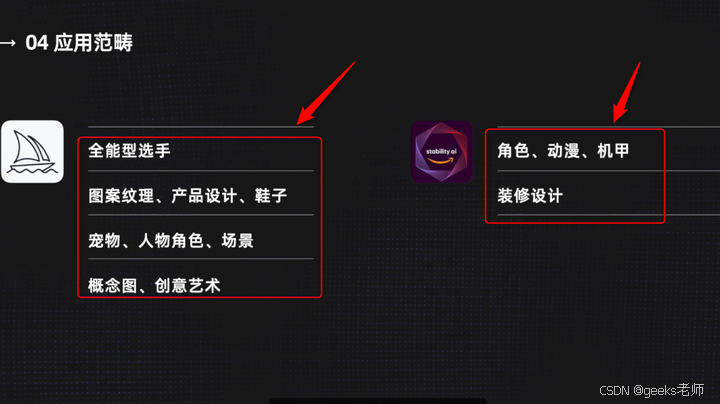

四、应用范畴

你可以把Midjourney看作是一个全能型选手,细致到图案纹理,再到产品设计、鞋子、宠物、人物角色、场景概念图、创意艺术等等无所不能。在Midjourney首页你可以看到形形色色各种各样的优秀图片。

而Stable Diffusion主攻的是角色、动漫、机甲、装修设计领域。在图片分享社区,你可以看到绝大部分的都是角色图片。为了对标Midjourney,最近也是开发了能生成各种风格和概念的大模型Stable DiffusionXL 3.0,并且上架Discord。不过从目前生成效果来看,还有不少的提升空间。

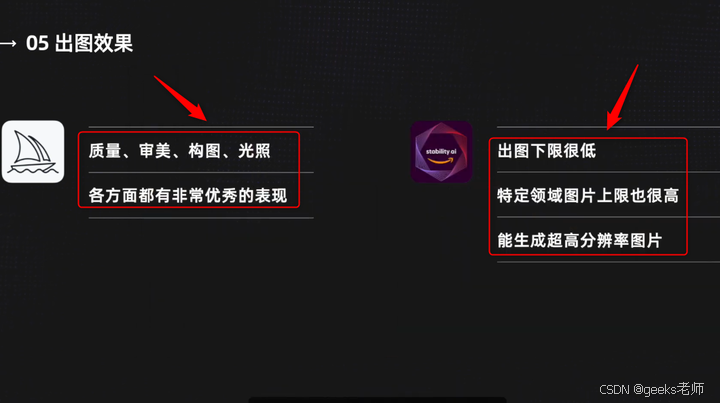

五、出图效果

Midjourney生成的图片在质量、审美、构图、光照各方面都有非常优异的表现。你可以把Midjourney当做是升级大厨调配好的菜品,即便你不会做菜,只需要把菜品随便组合拼凑在一起,也是一顿丰盛的大餐。

而Stable Diffusion出图的下限非常低。从原材料开始就要自己准备炒一盘菜。你是要挑选哪个品种的蔬菜、需要加多少糖、多少盐、烹饪时间要多久都要自己调控。如果不会煮的话,煮出来的东西会非常难吃。但是针对特定领域的图片的上限也非常高。你可以通过对人物的训练Upscale放大局部金条,生成出非常高质量的图片。

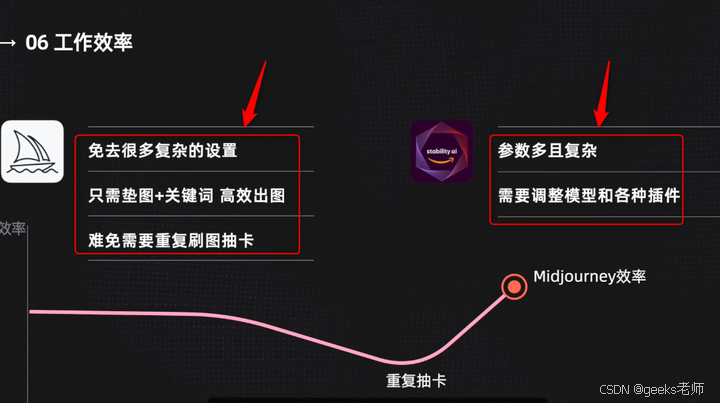

六、工作效率

Midjourney里免去很多复杂的设置,只需要通过关键词的描述和垫图的方式就能生成图片。我们要做的其实就是调整关键词和后缀参数来修改出图效果,这个效率是非常高的。但调好关键词依然达不到想要的效果的时候,我们就要进入抽卡环节了,需要大量的重复刷图刷出希望想要的效果。所以Midjourney的效率曲线在通常的情况下都是比较高的,个别情况要进入抽卡环节,就大幅度降低了工作效率。

而Stable Diffusion的关键词更为复杂,有正向关键词,还要调整各种参数,引入合适的模型,调整Ctrl等插件。所以Stable Diffusion前期的调整测试阶段会占用较多的时间,工作效率并不高。但当测试调整好后,就可以用这一套配置来高效生成一系列的图片了。所以Stable Diffusion的效率曲线是先慢后快。

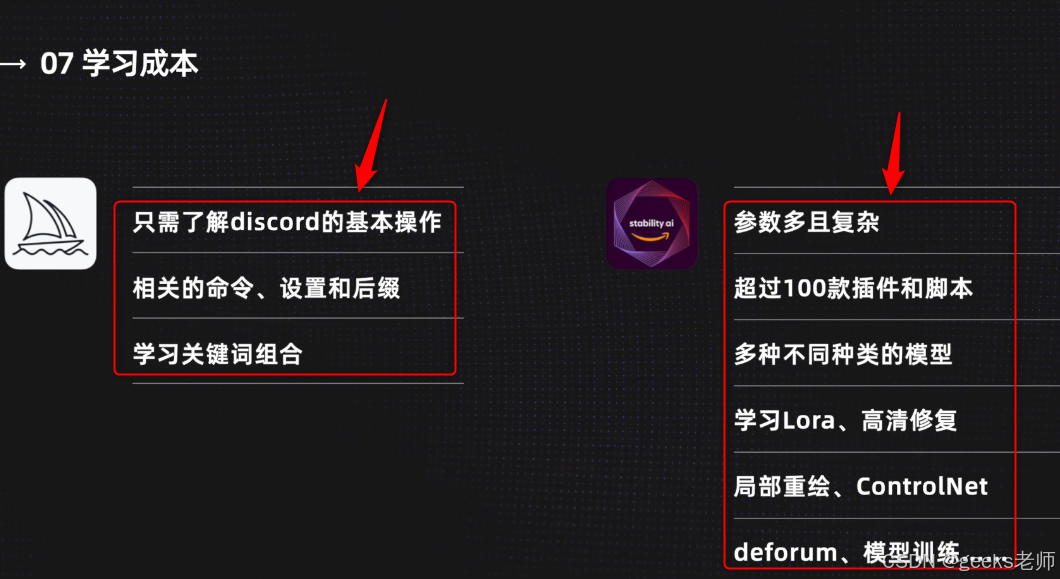

七、学习成本

Midjourney只需要了解Discord的基本操作,还有相关的命令设置和后缀,然后学习关键词的组合基本就没有问题了,整个学习过程并不需要太久。

而Stable Diffusion可以调整的参数要比Midjourney多出很多,并且有超过100款的插件和脚本可以安装。每款插件和脚本都有不同的参数需要了解,还有一大堆不同类型的模型需要下载和安装。还要学习LoRA高清修复、局部重绘ControlNet、Deforum模型训练等。这些都需要花费很多时间去研究学习的,学习成本要比Midjourney高出很多。

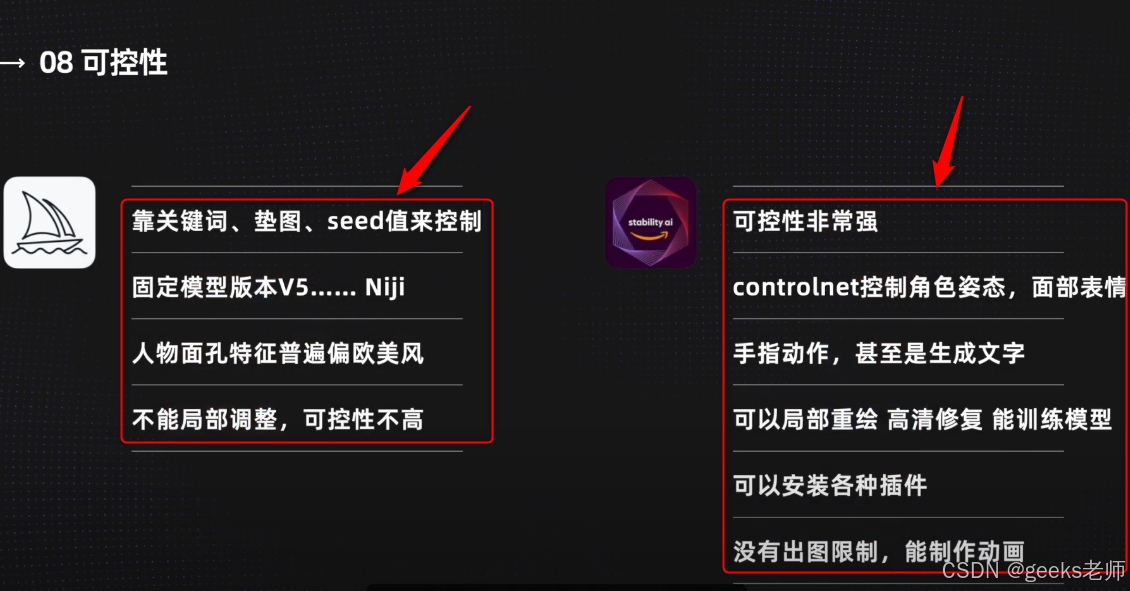

八、可控性

Midjourney只能靠关键词的描述、垫图还有Seed值的方式来控制图像。模型只有固定的几个版本,例如是5.1、5.2、Niji等。生成的人物面孔特征普遍偏欧美风,不能局部调整细节,可控性并不高。

而Stable Diffusion可控性简直强到离谱。你可以通过大名鼎鼎的ControlNet来控制角色的姿态、面部表情、手指动作甚至是生成文字,可以通过局部重绘Inpaint来修改细节、替换衣服。可以训练自己专属的模型,通过高清重绘来让老图翻新,可以安装各种各样的插件来帮助你输入关键词,并且没有出图限制,你可以生成各种各样在这里不能讨论的图片。你甚至可以通过Stable Diffusion来制作不闪的动画,怎么样,心动了吗?

总结

最后总结一下,Midjourney是一款开箱即用的软件,简单直接高效。如果你已经在从事设计相关领域的工作,平时涉及的涉及面比较广,那么Midjourney可以给你生成大量优质无版权的素材,并且可以给你提供很多创意灵感思路,极大地提高工作效率。现在有很多商业落地案例,都是通过Midjourney来制作完成的。

如果你的工作是涉及AI模特、AI写真、相片转卡通手绘、游戏动漫、室内设计这些方面,并且你有着较好的学习能力和愿意花更多的时间进行学习的话,那么有着强大的可控性和开源结构的Stable Diffusion将是你最好的选择。当然,有能力的友友还可以直接进行双修——用Midjourney生成创意图片,再导入到Stable Diffusion进行微调精修,这样就可以很好地结合两者的长处了。

Midjourney和Stable Diffusion,你更喜欢哪一款呢? 不妨在评论区里面说一下。