前言

今天,通义千问Qwen2.5-Omni-7B正式开源。

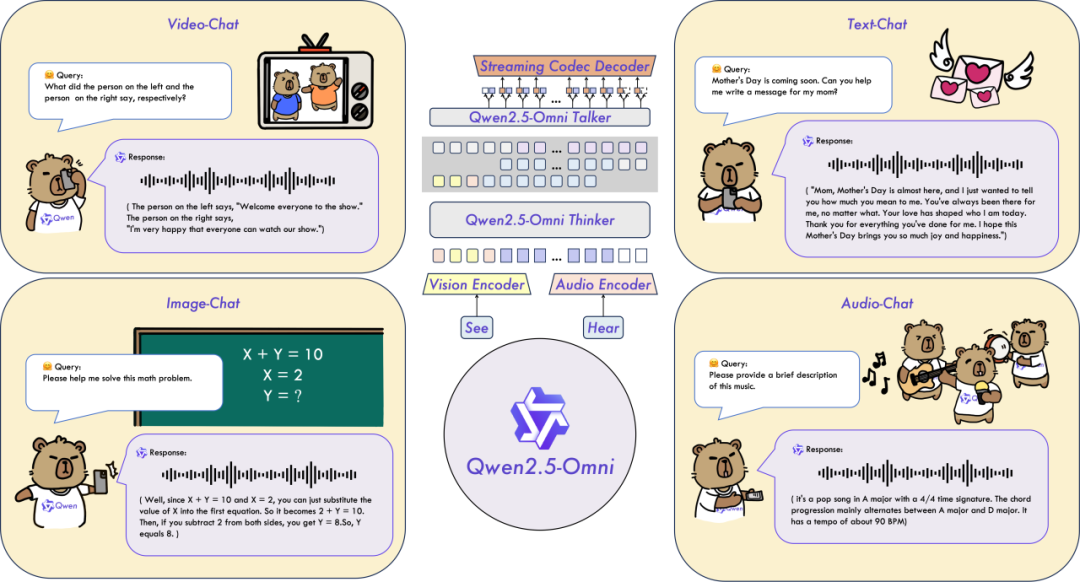

作为通义系列模型中首个端到端全模态大模型,可同时处理文本、图像、音频和视频等多种输入,并实时生成文本与自然语音合成输出。

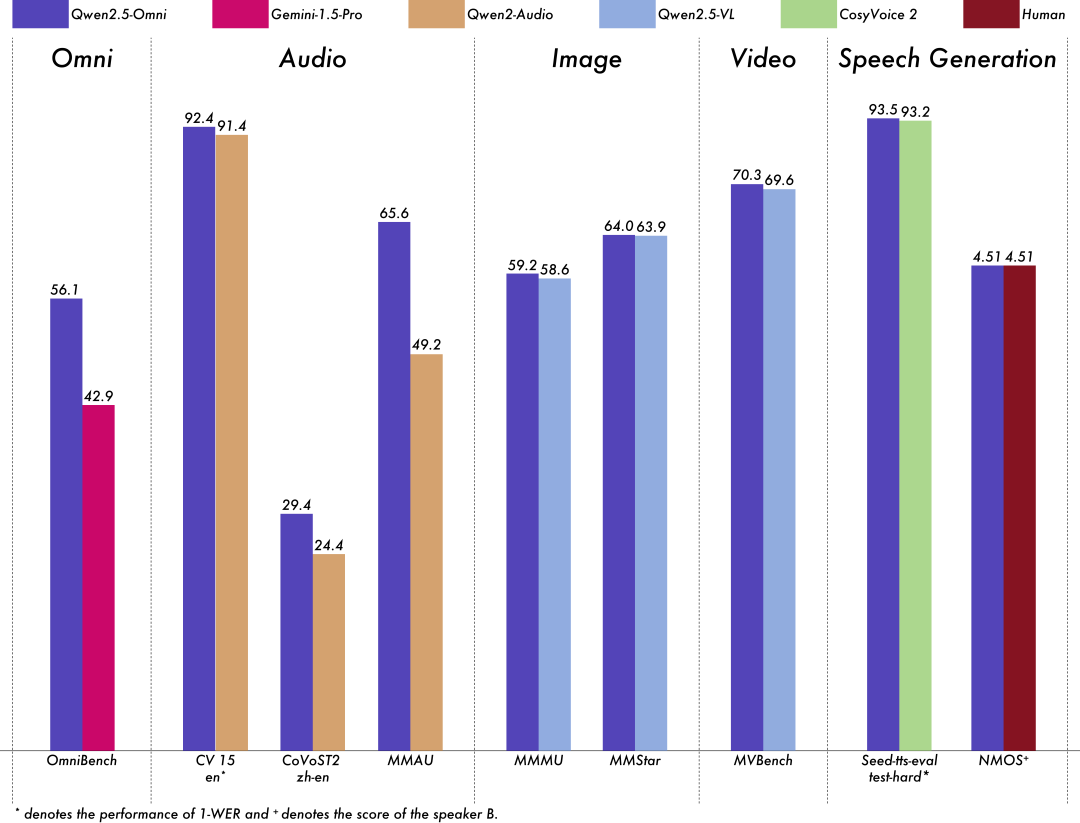

在权威的多模态融合任务OmniBench等测评中,Qwen2.5-Omni刷新业界纪录,全维度远超Google的Gemini-1.5-Pro等同类模型。

Qwen2.5-Omni以接近人类的多感官方式「立体」认知世界并与之实时交互,还能通过音视频识别情绪,在复杂任务中进行更智能、更自然的反馈与决策。目前,开发者和企业可免费下载商用Qwen2.5-Omni,手机等终端智能硬件也可轻松部署运行。

Qwen2.5-Omni采用了通义团队全新首创的Thinker-Talker双核架构、Position Embedding (位置嵌入)融合音视频技术、位置编码算法TMRoPE(Time-aligned Multimodal RoPE)。双核架构Thinker-Talker让Qwen2.5-Omni拥有了人类的“大脑”和“发声器”,形成了端到端的统一模型架构,实现了实时语义理解与语音生成的高效协同。具体而言,Qwen2.5-Omni支持文本、图像、音频和视频等多种输入形式,可同时感知所有模态输入,并以流式处理方式实时生成文本与自然语音响应。

得益于上述突破性创新技术,Qwen2.5-Omni在一系列同等规模的单模态模型权威基准测试中,展现出了全球最强的全模态优异性能,其在语音理解、图片理解、视频理解、语音生成等领域的测评分数,均领先于专门的Audio或VL模型,且语音生成测评分数(4.51)达到了与人类持平的能力。

相较于动辄数千亿参数的闭源大模型,Qwen2.5-Omni以7B的小尺寸让全模态大模型在产业上的广泛应用成为可能。即便在手机上,也能轻松部署和应用Qwen2.5-Omni模型。当前,Qwen2.5-Omni已在魔搭社区和Hugging Face 同步开源,用户也可在Qwen Chat上直接体验。

从2023年起,通义团队就陆续开发了覆盖0.5B、1.5B、3B、7B、14B、32B、72B、110B等参数的200多款「全尺寸」大模型,囊括文本生成模型、视觉理解/生成模型、语音理解/生成模型、文生图及视频模型等「全模态」,真正实现了让普通用户和企业都用得上、用得起AI大模型。截至目前,海内外AI开源社区中千问Qwen的衍生模型数量突破10万,是公认的全球第一开源模型。

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】