【0踩坑、一步到位】手把手教你搭建企业级个人知识库——ollama+dify+docker环境配置及安装(windows版)

为什么要搭建本地个人知识库

很多人有这样的需求:网上爆火的deepseek、chatgpt、QWen等AI大模型属于通用AI模型,但是想将AI应用到自己所在的行业,也就是训练一个行业专业的AI专家,模型微调操作复杂、需要大量数据支撑、需要好的硬件配置进行长时间的训练,因此搭建本地的个人知识库是一个很好的选择,适用于小规模数据集并且不需要额外的资源消耗,本地搭建知识库更符合企业安全可靠的需求。

知识库是一种 “检索 + 生成” 的方式,主要用于增强大模型的知识范围,但不会修改模型本身。

大致流程如下:

- 存储数据:使用embeding嵌入模型,将文本数据(如文档、网页、数据库)等离散数据,转换成连续的向量表示,并存储进一个向量数据库(如 FAISS、Weaviate)。

- 查询数据:当用户提问时,先在知识库中检索出相关内容。

- 生成答案:将检索到的内容作为上下文传递给 LLM,让模型基于这些信息生成回答。

优点

✅ 即时更新:添加/修改知识库内容后,AI 可立即使用最新信息,无需重新训练模型。

✅ 数据安全:数据可控,不需要把敏感信息交给大模型训练。

✅ 成本低:不需要大量计算资源,只需搭建一个向量数据库即可。

✅ 适合小数据集:适用于 FAQ、企业文档查询、法律法规等场景。

在探索了多个如AnythingLLM、ragflow等知识库集成模型,最后发现Dify最好用,效果好、精确度高且不吃硬件配置,官方显示2核4G的配置即可使用,因此本文先从环境配置说起,配置好搭建个人知识库的环境。

1、安装OLLAMA

进入ollama官网下载:https://ollama.com/

-

在下载文件夹打开cmd,设置安装路径,否则会下载到C盘:

OllamaSetup.exe /DIR="D:\Ollama",然后一路点next -

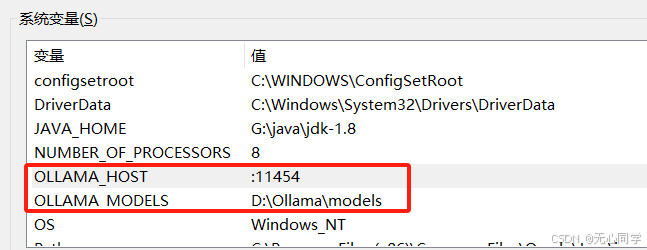

在高级系统设置-环境变量-系统变量那里,新建一个OLLAMA_MODELS的变量,值为存放LLM模型的文件路径,否则会下载到C盘,新建一个OLLAMA_HOST的变量,值设为:11454,表示监听所有ip的11454端口,否则docker容器内无法访问到ollama

-

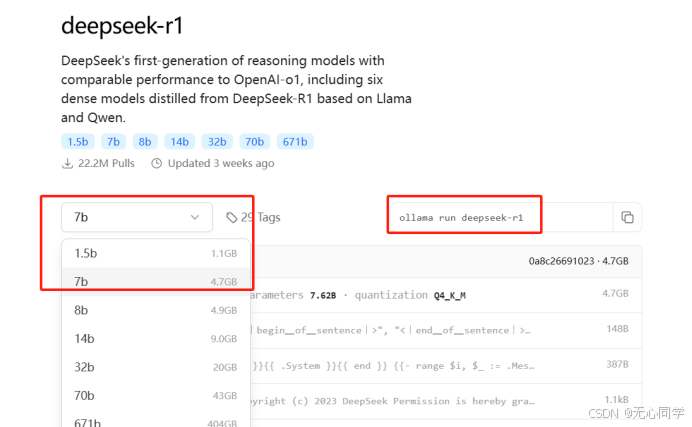

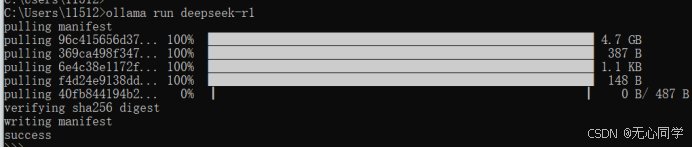

下载模型,输入命令:

ollama run deepseek-r1下载7b大小的模型

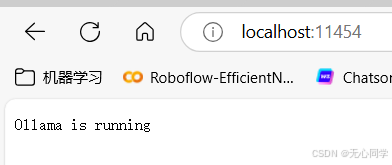

模型下载完,系统变量配置完,在浏览器输入:localhostt:11454查看ollama是否在运行

2、安装docker desktop

进入docker官网下载windows桌面版: https://www.docker.com/

-如果要安装docker到其他盘,输入命令,如果C盘够大就直接运行安装程序一路安装即可:

start /w "" "Docker Desktop Installer.exe" install -accept-license --installation-dir="D:\Docker" --wsl-default-data-root="D:\\Docker\\data" --windows-containers-default-data-root="D:\Docker"

–installation-dir表示安装的docker存储路径

–wsl-default-data-root表示存储WLS的镜像、容器、卷等数据的目录

–windows-containers-default-data-root表示程序的默认路径

-

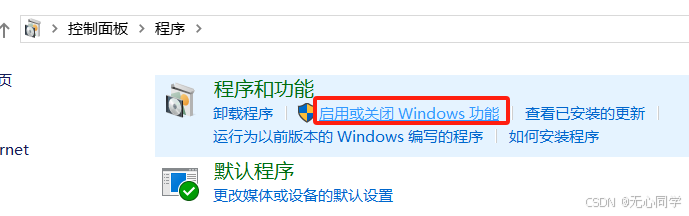

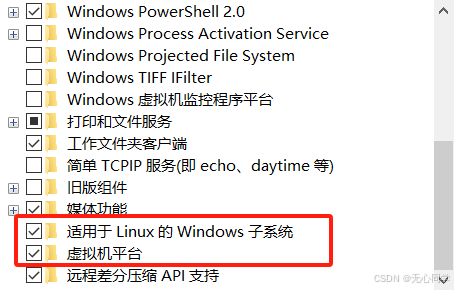

如果是window,那就下载docker desktop,并且需要开启电脑的虚拟化,在控制面板-程序-启用或关闭windows功能这里,点击启用这两个选项,然后按照提示重启电脑

-

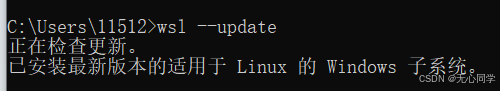

打开cmd,输入:wsl --update把wsl2更新到最新版本,这个过程可能会很慢,有梯子的挂梯子,否则可能很慢而且会报错

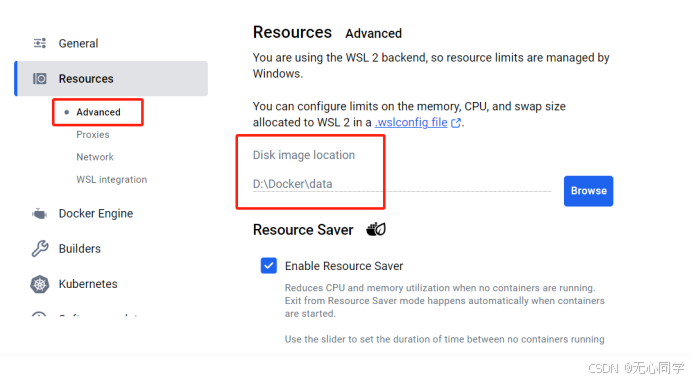

全部配置好后,就可以打开docker desktop界面,查看镜像保存位置是否是自己设置的:

3、下载Dify

前往Dify的github官网:https://github.com/langgenius/dify

选择使用git下载或者直接下载源码

接着按照官网的指引,进入docker文件夹,复制.env文件,使用compose命令进行编译:

cd dify

cd docker

cp .env.example .env

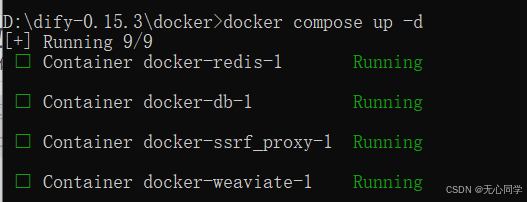

docker compose up -d

运行过程出错,可选择更换加速镜像、搭梯子等方式加速下载。

- 运行完成后,在浏览器输入:localhost:80打开dify界面,输入邮箱密码用户名,第一次输入的为管理员

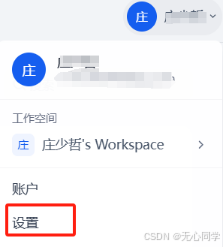

- 点击右上角头像,打开设置,配置下载的deepseek模型

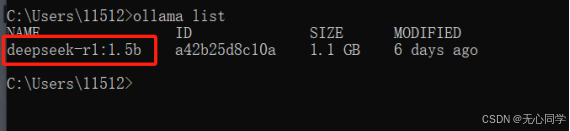

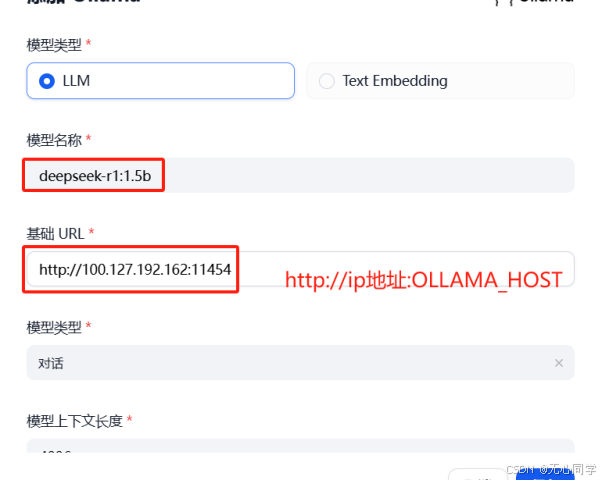

点击添加模型配置模型,输入ollama list查看下载的模型,把模型信息和url信息填入,

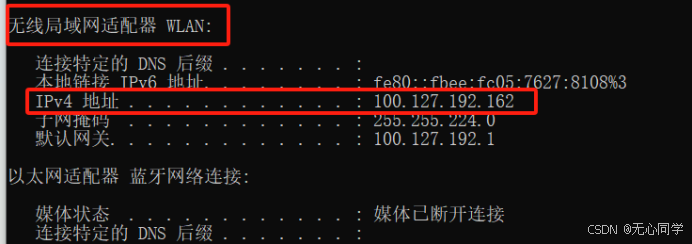

输入ipconfig查看当前网络的ip,需要注意的是,如果连的是wifi并且选择DHCP动态获取ip的话,每次ip可能会改变,需要重新修改模型配置

至此,流程配置结束,选择创建一个应用,使用本地部署的模型进行对话

如遇到安装问题,可以在评论区提问呀!安装配置这些已经踩了太多坑