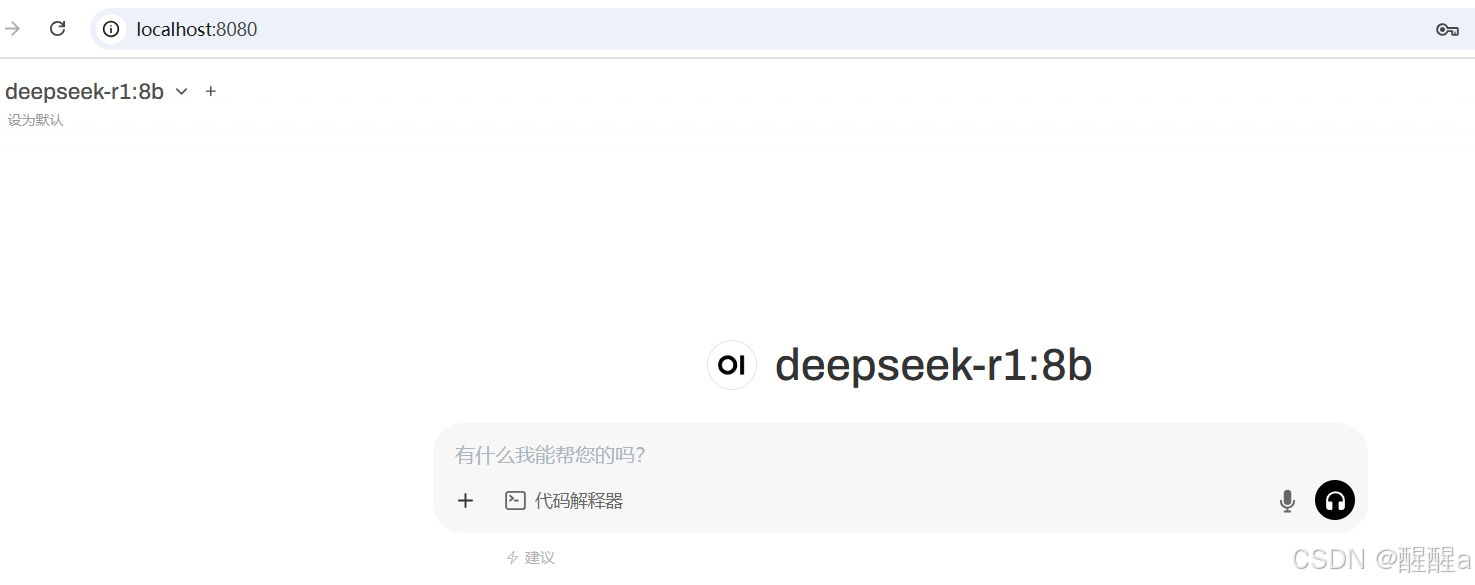

我是使用ollama下载deepseek-r1:8b,使用openwebUI做页面交互,没有做量化直接运行的,配置是16GB内存+8GB显存.

但如果配置较低想要量化处理,建议不要使用ollama,ollama默认下载格式是类似docker的分层镜像格式,想要转成pytorch做处理不太方便,建议用huggingface下载后处理.

一、环境准备

硬件需求

最低配置:CPU(支持AVX2指令集)+ 16GB内存 + 30GB存储。

推荐配置:NVIDIA GPU(RTX 3090或更高)+ 32GB内存 + 50GB存储。

软件依赖

操作系统:Windows、macOS或Linux。

Docker:如果使用Open Web UI,建议安装Docker。

二、安装Ollama

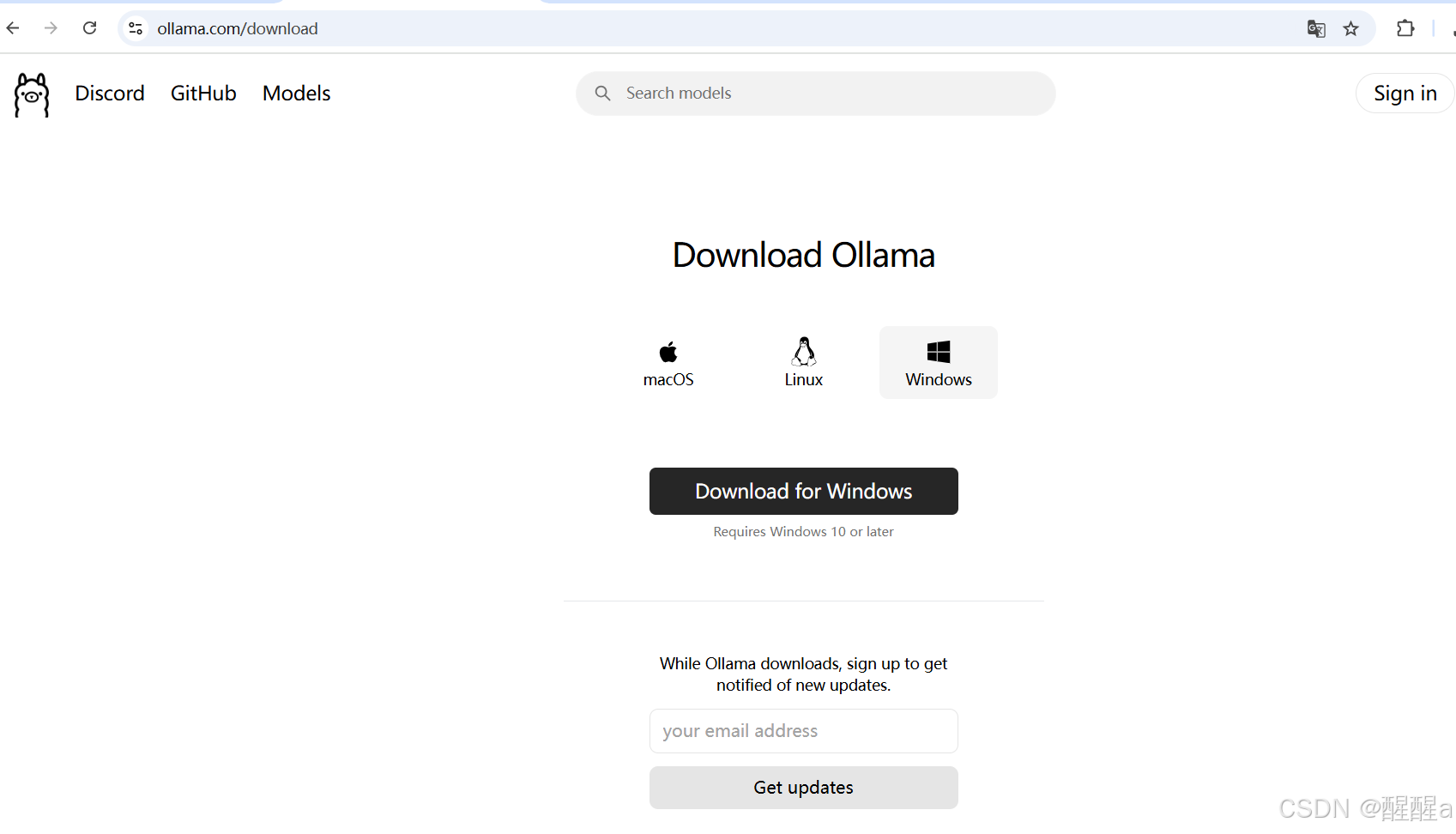

Ollama是一个开源工具,用于在本地运行和部署大型语言模型。以下是安装Ollama的步骤:

访问Ollama官网:Download Ollama on macOS,点击“Download”按钮。

下载安装包:根据你的操作系统选择对应的安装包。下载完成后,直接双击安装文件并按照提示完成安装。

验证安装:安装完成后,在终端输入以下命令,检查Ollama版本:

ollama --version如果输出版本号(例如 ollama version is 0.5.6),则说明安装成功。

如果需要安装在d盘:

迁移安装目录:将Ollama的安装目录从默认的C盘移动到D盘。例如,将C:\Users\XX\AppData\Local\Programs\Ollama移动到D:\Ollama。

迁移模型文件:将模型文件所在的目录(如C:\Users\XX\.ollama)移动到D盘,例如改为D:\Ollama.ollama。

修改用户变量:在用户变量的PATH中,将原来的C:\Users\XX\AppData\Local\Programs\Ollama路径更新为D:\Ollama。

新建系统变量:在系统变量中新建一个名为OLLAMA_MODELS的变量,设置其值为模型文件的新位置,例如D:\Ollama.ollama\models。

验证安装

通过运行Ollama命令行工具来验证安装是否成功。例如,输入ollama -v打印Ollama的版本号,或者使用ollama list列出已下载的模型。

三、下载并部署DeepSeek模型

选择模型版本

入门级:1.5B版本,适合初步测试。

中端:7B或8B版本,适合大多数消费级GPU。

高性能:14B、32B或70B版本,适合高端GPU。

下载模型: 打开终端,输入以下命令下载并运行DeepSeek模型。例如,下载7B版本的命令为:

ollama run deepseek-r1:7b如果需要下载其他版本,可以参考以下命令:

ollama run deepseek-r1:8b # 8B版本

ollama run deepseek-r1:14b # 14B版本

ollama run deepseek-r1:32b # 32B版本windows ollama 单独下载deepseek模型的命令:

ollama pull deepseek-r1

需要指定特定版本(如7B或8B),可以使用以下命令:

ollama pull deepseek-r1:7b # 下载7B版本[^282^]

ollama pull deepseek-r1:8b # 下载8B版本[^283^]启动DeepSeek模型:

ollama run deepseek-r1:7b # 启动7B版本[^282^]

ollama run deepseek-r1:8b # 启动8B版本[^283^]启动Ollama服务

在终端运行以下命令启动Ollama服务:

ollama serve

服务启动后,可以通过访问 http://localhost:11434 来与模型进行交互。

四、使用Open Web UI(可选)

如果想要在windows上安装openwebui: