前言

随着人工智能技术的飞速发展,手势识别作为一种直观且高效的交互方式,已经被广泛应用于多种场景,如虚拟现实、人机交互、游戏控制等。本文将记录一个基于MediaPipe库的手势识别项目的实践过程,从环境准备、底层原理、代码实现、代码解释到总结,帮助巩固相关知识要点,并分享一些职场感悟心得。

环境准备

为了实现手势识别功能,首先需要安装相应的库。

-

安装OpenCV:

- 使用pip命令安装:

pip install opencv-python

- 使用pip命令安装:

-

安装MediaPipe:

- 使用pip命令安装:

pip install mediapipe

- 使用pip命令安装:

-

安装Numpy:

- 使用pip命令安装:

pip install numpy

- 使用pip命令安装:

介绍

MediaPipe是由Google开发的一个跨平台框架,用于构建多模态(如视频、音频等)的机器学习管道。它提供了大量的预训练模型,其中包括手势识别模型。MediaPipe的手势识别模型基于深度学习技术,能够在实时视频流中检测手部关键点并进行手势分类。

代码实现

以下是使用MediaPipe库实现手势识别的完整代码:

import cv2

import mediapipe as mp

import numpy as np

# 初始化MediaPipe手势识别模型

mp_hands = mp.solutions.hands

mp_drawing = mp.solutions.drawing_utils

# 设置摄像头

cap = cv2.VideoCapture(0) # 默认的摄像头设备编号为0

def main():

with mp_hands.Hands(max_num_hands=2, min_detection_confidence=0.5, min_tracking_confidence=0.5) as hands:

while cap.isOpened():

success, image = cap.read()

if not success:

print("忽略空帧,继续")

continue

# 将BGR图像转换为RGB

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

# 处理手势检测

results = hands.process(image)

# 将RGB图像转换回BGR

image = cv2.cvtColor(image, cv2.COLOR_RGB2BGR)

# 检测到手时,绘制手的标记

if results.multi_hand_landmarks:

for hand_landmarks in results.multi_hand_landmarks:

mp_drawing.draw_landmarks(image, hand_landmarks, mp_hands.HAND_CONNECTIONS)

# 显示图像

cv2.imshow('MediaPipe Hands', image)

# 按下'q'键退出

if cv2.waitKey(10) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()

if __name__ == "__main__":

main()

代码解释

接下来,我们详细解释代码中的关键部分:

-

导入库:

import cv2 import mediapipe as mp import numpy as np这里我们导入了OpenCV库用于图像处理和视频读取,导入了MediaPipe库用于手势识别,以及Numpy库用于数值操作。

-

初始化MediaPipe手势识别模型:

mp_hands = mp.solutions.hands mp_drawing = mp.solutions.drawing_utils初始化MediaPipe的手势识别模型和绘图工具。

-

设置摄像头:

cap = cv2.VideoCapture(0) # 默认的摄像头设备编号为0使用OpenCV的

VideoCapture类来打开摄像头设备。 -

主函数:

def main(): with mp_hands.Hands(max_num_hands=2, min_detection_confidence=0.5, min_tracking_confidence=0.5) as hands: while cap.isOpened(): success, image = cap.read() if not success: print("忽略空帧,继续") continue主函数中,我们使用

mp_hands.Hands来实例化手势识别模型,并设置最大检测手的数量为2,检测置信度和跟踪置信度都设置为0.5,然后在一个无限循环中读取摄像头的帧。 -

图像格式转换:

# 将BGR图像转换为RGB image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)OpenCV默认使用BGR颜色空间,而MediaPipe需要RGB颜色空间。因此需要进行颜色空间转换。

-

手势检测:

# 处理手势检测 results = hands.process(image)调用MediaPipe的手势识别模型对每一帧图像进行处理,得到手势检测结果。

-

结果格式转换:

# 将RGB图像转换回BGR image = cv2.cvtColor(image, cv2.COLOR_RGB2BGR)处理完手势检测后,将图像颜色空间转换回BGR,以便使用OpenCV的显示函数。

-

绘制手势标记:

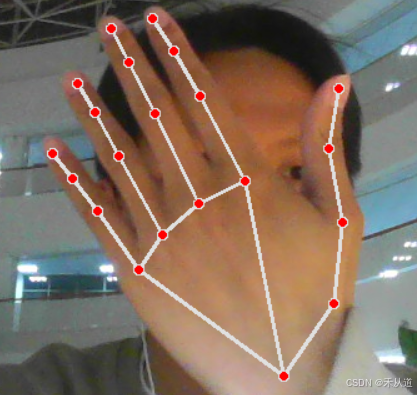

# 检测到手时,绘制手的标记 if results.multi_hand_landmarks: for hand_landmarks in results.multi_hand_landmarks: mp_drawing.draw_landmarks(image, hand_landmarks, mp_hands.HAND_CONNECTIONS)如果检测到手,使用MediaPipe的绘图工具在图像上绘制手部关键点及其连接。

-

显示图像:

# 显示图像 cv2.imshow('MediaPipe Hands', image)使用OpenCV的

imshow函数来显示处理后的图像。 -

退出机制:

# 按下'q'键退出 if cv2.waitKey(10) & 0xFF == ord('q'): break按下Q键时,程序停止运行。

总结

通过以上步骤,我们成功实现了一个简单的手势识别系统。当然,这只是一个简单的展示,在实际工作和生活中,我们可以根据具体需求,对手势识别系统进行进一步的拓展,优化算法,以达到更快、更精准的识别。