저자: 리 루이펑

논문 제목

StreamE: 스트리밍 시나리오의 시간적 지식 그래프에 대한 표현의 경량 업데이트

용지 공급

소 2023

종이 링크

https://dl.acm.org/doi/10.1145/3539618.3591772

코드 링크

https://github.com/zjs123/StreamE_MindSpore

오픈 소스 AI 프레임워크인 MindSpore는 산학연-연구 및 개발자에게 전체 시나리오 장치-에지-클라우드 협업, 미니멀리스트 개발, 최고의 성능, 초대형 AI 사전 훈련, 미니멀리스트 개발 및 안전하고 신뢰할 수 있는 솔루션을 제공합니다. 경험, 2020.3.28 오픈 소스는 500만 회 이상의 다운로드를 보유하고 있습니다. MindSpore는 수백 개의 AI 최고 컨퍼런스 논문을 지원하고 상위 100개 이상의 대학에서 강의했으며 HMS를 통해 5000개 이상의 앱에서 상업적으로 사용 가능합니다. AI 컴퓨팅 분야에서는 센터, 금융, 지능형 제조, 금융, 클라우드, 무선, 데이터 통신, 에너지, 소비자 1+8+N, 스마트 자동차 및 기타 엔드 에지 클라우드 자동차 시나리오가 점차 널리 사용되고 있습니다. Gitee 지수가 가장 높은 오픈 소스 소프트웨어입니다. 누구나 오픈 소스 기여, 키트, 모델 크라우드 인텔리전스, 산업 혁신 및 응용, 알고리즘 혁신, 학술 협력, AI 도서 협력 등에 참여하고 클라우드 측, 장치 측, 엣지 측 및 애플리케이션 사례에 기여할 수 있습니다. 보안 분야.

과학기술계, 학계, 산업계의 SunSilicon MindSpore의 광범위한 지원으로 SunSilicon MindSpore를 기반으로 한 AI 논문은 2023년 전체 AI 프레임워크의 7%를 차지하여 2년 연속 세계 2위를 차지했습니다. 모든 대학은 교사들의 지원을 받아 AI 연구와 혁신을 위해 계속 함께 열심히 노력할 것입니다. MindSpore 커뮤니티는 최고의 컨퍼런스 논문 연구를 지원하고 독창적인 AI 결과를 지속적으로 구축합니다. 나는 때때로 우수한 논문을 선택하여 추진하고 해석할 것입니다. 업계, 학계 및 연구 분야의 더 많은 전문가가 Shengsi MindSpore와 협력하여 독창적인 AI 연구를 촉진하기를 바랍니다. MindSpore AI 최고 컨퍼런스 논문 시리즈의 15번째 기사에서는 중국 전자 과학 기술 대학 컴퓨터 과학부 Shao Jie 선생님 팀의 논문을 해석하기로 했습니다. 모든 전문가, 교수 및 동급생의 기여에 감사드립니다. 이 글은 Zhihu에 업로드되었습니다. 클릭하시면 원문을 보실 수 있습니다.

MindSpore는 손쉬운 개발, 효율적인 실행, 전체 시나리오 적용이라는 세 가지 주요 목표를 달성하는 것을 목표로 합니다. 사용 경험을 통해 딥러닝 프레임워크인 MindSpore는 빠르게 발전하고 있으며 다양한 API의 디자인은 보다 합리적이고 완전하며 강력한 방향으로 지속적으로 최적화되고 있습니다. 또한 Shengsi에서 지속적으로 등장하는 다양한 개발 도구도 이 생태계를 지원하여 모델 아키텍처를 다이어그램 형식으로 제시하고 다양한 측면을 동적으로 모니터링할 수 있는 MindSpore Insight와 같이 보다 편리하고 강력한 개발 방법을 만들 수 있습니다. 런타임 중 모델의 표시기와 매개변수가 변경되면 개발 프로세스가 더욱 편리해집니다.

01

연구배경

시간적 지식 그래프 임베딩 방법은 시간적 지식 그래프의 시간성을 유지하면서 시간적 지식 그래프의 요소에 대한 벡터 표현을 학습하는 것을 목표로 합니다. 기존 작업은 시간적 지식 그래프를 저차원 벡터로 표현할 수 있지만, 이러한 작업에서는 시간적 지식 그래프에 새로운 지식이 추가되지 않을 것이라고 가정하고 있는데 이는 명백히 불합리합니다. 현실 세계의 지식은 지속적으로 업데이트되므로 지식 그래프에는 새로운 지식이 지속적으로 추가됩니다. 이 시나리오를 흐름 시나리오라고 합니다. 기존 작업을 스트리밍 시나리오에 적용하면 주로 다음 세 가지 문제에 직면합니다.

(1) 첫째, 지식이 업데이트됨에 따라 새로운 엔터티가 지식 그래프에 계속 축적됩니다. 기존 작업은 각 엔터티의 고정된 임베딩 표현을 직접 학습하므로 새로운 엔터티에 대한 임베딩 표현을 생성할 수 없습니다.

(2) 현실 세계의 다양한 사건은 항상 발생하므로 지식의 업데이트가 매우 빈번합니다. 기존 작업에서는 매 순간 현재 순간에 내재된 표현을 처음부터 다시 생성해야 하므로 실제 적용이 어렵습니다. - 위기조기경보시스템 등 신속한 대응이 필요한 생활영역.

(3) 기존 작업은 관련 지식 타임스탬프가 포함된 엔터티 임베딩 표현만 얻을 수 있습니다. 그러나 실제 세계의 요구 사항은 언제든지 생성되며 기존 작업은 다음 지식 업데이트가 발생할 때까지 항상 동일한 임베딩 표현을 반환하므로 모델이 이 기간 동안 동일한 응답을 하게 되는데 이는 분명히 옳지 않습니다.

따라서 기존 작업이 어느 정도 성공을 거두었음에도 불구하고 현실 세계에서 매우 일반적인 스트리밍 시나리오(예: 추천 시스템, 위기 경고 시스템 등)에는 적용할 수 없습니다.

02

팀 소개

논문의 첫 번째 저자인 Zhang Jiasheng은 중국 전자 과학 기술 대학 컴퓨터 과학부 박사 과정 2년차 학생입니다. 그의 연구 관심 분야는 동적 그래프 표현 학습, 순차 지식 그래프 및 시공간 데이터 마이닝입니다. . 지금까지 CCF 카테고리 A 컨퍼런스 논문 2편, CCF 카테고리 B 및 C 컨퍼런스 논문 1편, 중국과학원 제1지역 저널 논문 1편 등 총 5편의 논문도 게재됐다. 국가발명특허 및 2개의 소프트웨어 저작권을 보유하고 있습니다. 그는 쓰촨성 과학기술부 혁신 및 기업가 정신 묘목 프로젝트의 핵심 프로젝트인 "순차적 지식을 기반으로 한 지식 그래프 표현 학습 모델 연구 및 응용"의 완료를 주재했으며 DiDi-Future에 선정되었습니다. 엘리트학교-기업합동인재양성사업. 그는 중국 전자 과학 기술 대학에서 많은 장학금을 받았으며 "우수 대학원생" 및 "과학 기술 혁신 분야의 고급 개인"이라는 칭호를 받았습니다.

논문 지도교수인 Shao Jie는 중국 전자과학기술대학교의 교수이자 박사 과정 지도교수입니다. 그는 IEEE TKDE, IEEE TNNLS, IEEE TCYB, IEEE TMM, IEEE TGRS, IEEE를 포함하여 100개 이상의 고급 학술 논문을 발표했습니다. THMS, IEEE TCSVT, ACM TOIS 및 TOMM과 같은 ACM 저널과 ACM MM, IEEE ICDE, VLDB, IJCAI 및 AAAI와 같은 컨퍼런스. 그는 중국 국가 자연 과학 재단 일반 프로젝트 2개와 쓰촨성 핵심 R&D 프로젝트 1개를 주재했으며, 협력 단위 책임자로서 중국 국가 자연 과학 재단 핵심 프로젝트 1개를 수행했습니다. 또한 APWeb의 추천인이기도 합니다. -WAIM 2019, 중국컴퓨터학회 프로그램위원회 위원장이 추천한 빅데이터 분야 국제회의. 2021년 쓰촨성 과학기술 발전상 2등상을 수상했습니다.

논문의 저자가 소재한 중국 전자과기대학 미래미디어연구센터에서는 다중 모드 지식 그래프, 시간적 지식 그래프, 지식 그래프 구축, 추론 및 애플리케이션. 연구 중인 관련 지방, 장관 및 국가 프로젝트가 많이 있습니다.

03

논문 소개

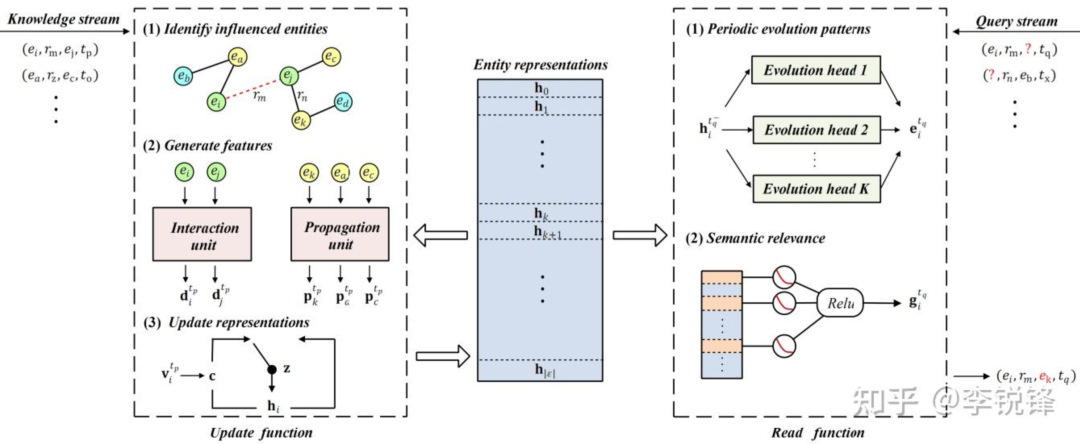

본 논문에서는 기존의 시간적 지식 그래프 임베딩 방법을 스트리밍 시나리오에 적용할 수 없는 문제를 해결하기 위해 경량 임베딩 표현 프레임워크(StreamE)를 제안합니다. 기존 작업이 스트리밍 시나리오에 적응하기 어려운 주된 이유는 임베딩 생성 프로세스와 예측 프로세스가 밀접하게 결합되어 언제든지 임베딩 표현을 효율적으로 생성하기 어렵기 때문이라고 생각합니다. 따라서 위의 두 프로세스를 분리하여 스트리밍 시나리오에 포함된 표현의 경량 업데이트를 달성합니다.

구체적으로, 우리는 과거 의미론을 보존하기 위해 엔터티 임베딩 표현을 외부 저장 모듈로 사용하고 임베딩 표현을 생성하는 프로세스를 업데이트 기능과 읽기 기능으로 분리합니다. 업데이트 기능에서 프레임워크는 들어오는 지식을 듣고 읽기 기능에서 들어오는 지식을 기반으로 저장된 임베딩 표현을 점진적으로 업데이트합니다. 프레임워크는 사용자의 쿼리 요구 사항을 듣고 들어오는 지식을 기반으로 저장된 임베딩 표현을 업데이트합니다. 궤적 예측은 쿼리 요구 사항에 응답하기 위해 쿼리 시간에 임베딩 표현을 생성하는 데 사용됩니다.

엔터티 표현을 정확하게 업데이트하기 위해 우리는 참여 엔터티 간의 새로운 지식에 대한 직접적인 영향과 과거 관련 지식과 관련된 엔터티에 대한 새로운 지식의 전파 영향을 모두 고려합니다. 메시지 전달 메커니즘에서 영감을 얻은 직접적인 영향을 위해 우리는 지식을 생성하는 개체가 서로에게 정보를 전파하는 동시에 관계의 의미가 개체 간의 상관 관계를 반영하므로 개체와 관계를 사용하기를 희망합니다. 직접적인 효과를 모델링하는 메커니즘을 동시에 전달합니다. 전파 효과의 경우 경로는 개체 간의 고차 상관 관계를 모델링하는 데 널리 사용되므로 새로운 지식과 과거 관련 개체로 구성된 경로가 이들 간의 상관 관계를 반영할 수 있다고 믿습니다. 따라서 우리는 경로를 기반으로 전파 효과를 모델링합니다. 마지막으로 게이팅 메커니즘은 업데이트할 정보를 적응적으로 선택할 수 있으므로 이를 사용하여 엔터티의 내장된 표현을 업데이트하기 위해 직접적인 영향과 전파 영향의 정보를 적응적으로 선택합니다.

엔터티 의미론의 진화 궤적을 정확하게 시뮬레이션하기 위해 두 가지 측면을 고려했습니다. 첫째, 대부분의 엔터티의 의미는 순환적인 특성을 가지고 있습니다. 예를 들어 올림픽 게임은 4년마다 개최되고, 유럽 컵은 2년마다 개최됩니다. 엔터티의 순환적인 의미 변화를 고려하면 앞으로 발생할 수 있는 지식을 더 잘 예측하는 데 도움이 됩니다. 미래. 둘째, 우리는 엔터티가 전체 엔터티 컬렉션의 엔터티 중 일부로만 지식을 생성하며 이러한 엔터티는 자연스럽게 강한 상관 관계를 갖는다는 것을 발견했습니다. 엔터티의 미래 의미론적 궤적은 이러한 상관관계를 유지하기 위해 관련 엔터티의 의미론적 변화에 적응해야 합니다.

04

실험 결과

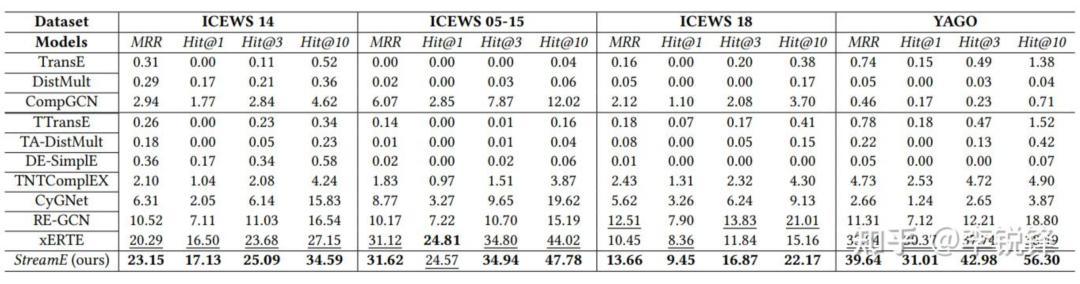

우리는 4개의 벤치마크 데이터세트에 대한 유도적 미래 링크 예측 작업에서 Shengsi MindSpore를 기반으로 구현된 StreamE 프레임워크의 효율성을 검증했습니다. 아래 그림에서 볼 수 있듯이 우리의 프레임워크는 모든 데이터세트에서 최신 기술보다 더 나은 성능을 보였습니다. 성능이 더 좋은 모델입니다.

동시에 기존 모델과 비교하여 임베딩 표현 생성 효율성 측면에서 제안된 프레임워크의 장점을 검증했습니다. 아래 그림에서 볼 수 있듯이 우리 프레임워크는 쿼리 수가 증가할 때 소비 시간의 하위 선형 증가를 유지할 수 있으며 이는 기존 모델보다 훨씬 효율적입니다.

05

요약 및 전망

이 기사에서는 처음으로 스트리밍 시나리오에서 시간적 지식 그래프의 기술적 과제를 연구하고 스트리밍 시나리오에서 임베딩 표현을 업데이트하기 위한 경량 프레임워크 StreamE를 제안합니다. 우리는 Shengsi MindSpore 프레임워크를 사용하여 StreamE 프레임워크를 구현했으며 광범위한 실험을 통해 효율성과 정확성의 장점을 입증했습니다. 국내 딥러닝 프레임워크인 MindSpore는 매우 유용한 연산자를 다수 제공하여 프레임워크 구현 프로세스를 크게 단순화하는 동시에 추론 효율성에도 큰 이점을 보여줍니다. Shengsi MindSpore 커뮤니티는 매우 활발하며 다른 사용자와 Huawei 개발자의 제안은 프레임워크를 구현하는 데 큰 도움이 되었습니다. 우리는 이러한 활동적이고 전문적인 커뮤니티의 지도 하에 Shengsi MindSpore가 점점 더 완벽해질 것이라고 믿습니다.

1990년대에 태어난 프로그래머가 비디오 포팅 소프트웨어를 개발하여 1년도 안 되어 700만 개 이상의 수익을 올렸습니다. 결말은 매우 처참했습니다! Google은 Flutter, Dart 및 Python 팀의 중국 코더의 "35세 저주"와 관련된 정리해고를 확인했습니다 . | Daily Windows 1.0용 Arc Browser가 3개월 만에 공식적으로 GA Windows 10 시장 점유율이 70%에 도달했으며 Windows 11 GitHub는 AI 기본 개발 도구 GitHub Copilot Workspace JAVA를 계속해서 출시했습니다 . OLTP+OLAP을 처리할 수 있는 유일한 강력한 유형의 쿼리입니다. 우리는 너무 늦게 만났습니다 .