先参考文章安装好 hadoop,CentOS 7.6 安装 Hadoop2.6.0

一、安装环境

CentOS 7.6

Hadoop 2.6.0

jdk 1.7.0_75

Scala 2.10.7

Spark 1.6.1

二、下载配置 Scala

2.1 下载 Scala

Scala 所有版本下载网址:https://www.scala-lang.org/download/all.html

本次实验下载版本为 Scala 2.10.7 ,文件下载在页面最底部

mkdir /home/scala

cd /home/scala

wget https://downloads.lightbend.com/scala/2.10.7/scala-2.10.7.tgz

tar -zxvf scala-2.10.7.tgz

2.2 配置 Scala 路径

vi ~/.bash_profile

# 添加以下内容

export SCALA_HOME=/home/scala/scala-2.10.7

export PATH=$PATH:$SCALA_HOME/bin

export PATH=$PATH:$SCALA_HOME/lib

source ~/.bash_profile

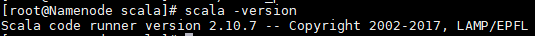

2.3 测试 Scala

scala -version

三、下载配置 Spark

3.1 下载 Spark

Spark 所有版本下载网址:https://archive.apache.org/dist/spark/

本次实验下载版本为 spark-1.6.1-bin-hadoop2.6.tgz

mkdir /home/spark

cd /home/spark

wget https://archive.apache.org/dist/spark/spark-1.6.1/spark-1.6.1-bin-hadoop2.6.tgz

tar -zvxf spark-1.6.1-bin-hadoop2.6.tgz

mv spark-1.6.1-bin-hadoop2.6.tgz spark-1.6

3.2 配置 Spark 相关路径

# 修改配置文件

vi ~/.bash_profile

# 添加以下内容

export SPARK_HOME=/home/spark/spark-1.6

export PATH=$PATH:$SPARK_HOME/bin

# 更新配置

source ~/.bash_profile

3.3 修改 Spark 配置文件

cd $SPARK_HOME

cd conf/

mv slaves.template slaves

vi slaves

# 修改默认的 localhost 为数据节点名称

Datanode1

mv spark-env.sh.template spark-env.sh

vi spark-env.sh

# 添加以下内容

export JAVA_HOME=/home/jdk/jdk1.7.0_75

export SCALA_HOME=/home/scala/scala-2.10.7

# Namenode 的 ip

export SPARK_MASTER_IP=192.168.164.xx1

export SPARK_WORKER_MEMORY=2g

export HADOOP_CONF_DIR=/home/hadoop/hadoop-2.6.0/etc/hadoop

四、复制文件到Datanode节点

scp -r /home/spark/spark-1.6 root@Datanode1:/home/spark/

scp -r /home/scala/scala-2.11.8 root@Datanode1:/home/scala/

scp ~/.bash_profile root@Datanode1:~/.bash_profile

五、启动 Spark

/home/spark/spark-1.6/sbin/start-all.sh

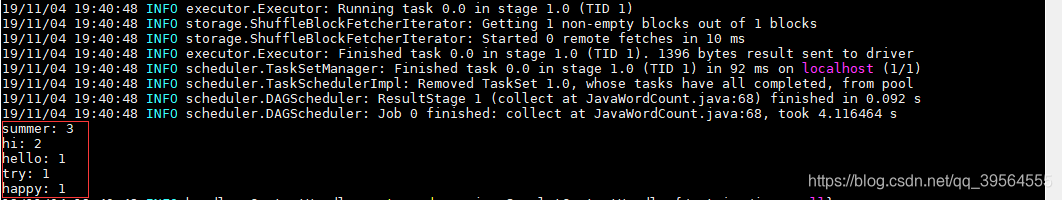

六、测试 Spark

运行 Spark 自带的 WordCount 程序进行测试

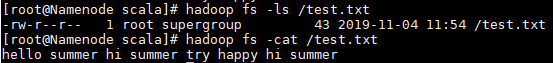

6.1 创建测试文件

vi test.txt

# 添加以下内容

hello summer hi summer try happy hi summer

# 将测试文件复制到 hadoop 文件系统下

hadoop fs -put test.txt /test.txt

hadoop fs -ls /test.txt

hadoop fs -cat /test.txt

6.2 运行程序

/home/spark/spark-1.6/bin/run-example org.apache.spark.examples.JavaWordCount hdfs://Namenode:9000/test.txt