经典算法

逻辑回归

question:逻辑回归相比于线性回归,有何异同?

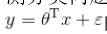

answer:逻辑回归处理的是分类问题,线性回归处理的是回归问题,这是两者的最本质的区别。逻辑回归中,因变量取值是一个二元分布,模型学习得出的是 ,即给定自变量和超参数后,得到因变量的期望,并基于此期望来处理预测分类问题。而线性回归中实际上求解的是

,即给定自变量和超参数后,得到因变量的期望,并基于此期望来处理预测分类问题。而线性回归中实际上求解的是 ,是对我们假设的真实关系

,是对我们假设的真实关系 的一个近似,其中

的一个近似,其中 代表误差项,我们使用这个近似项来处理回归问题。

代表误差项,我们使用这个近似项来处理回归问题。

当然逻辑回归和线性回归也不乏相同之处,首先我们可以认为二者都使用了 极大似然估计来对训练样本进行建模。线性回归使用最小二乘法,实际上就是在自变量x与超参数θ确定,因变量y服从正态分布的假设下,使用极大似然估计的一 个化简;而逻辑回归中通过对似然函数 的学习,得到最佳参数θ。另外,二者在求解超参数的过程中,都可以使用梯度下降的方法,这也是 监督学习中一个常见的相似之处。

的学习,得到最佳参数θ。另外,二者在求解超参数的过程中,都可以使用梯度下降的方法,这也是 监督学习中一个常见的相似之处。

question:当使用逻辑回归处理多标签的分类问题时,有哪些常见做法,分别应用于哪 些场景,它们之间又有怎样的关系?

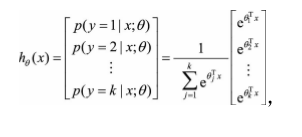

answer:使用哪一种办法来处理多分类的问题取决于具体问题的定义。首先,如果一 个样本只对应于一个标签,我们可以假设每个样本属于不同标签的概率服从于几 何分布,使用多项逻辑回归(Softmax Regression)来进行分类

其中 为模型的参数,而

为模型的参数,而 可以看作是对概率的归一化。为了方便 起见,我们将

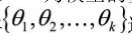

可以看作是对概率的归一化。为了方便 起见,我们将 这k个列向量按顺序排列形成n×k维矩阵,写作θ,表示整个参数集。一般来说,多项逻辑回归具有参数冗余的特点,即将

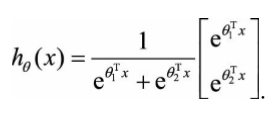

这k个列向量按顺序排列形成n×k维矩阵,写作θ,表示整个参数集。一般来说,多项逻辑回归具有参数冗余的特点,即将  同时 加减一个向量后预测结果不变。特别地,当类别数为2时,

同时 加减一个向量后预测结果不变。特别地,当类别数为2时,

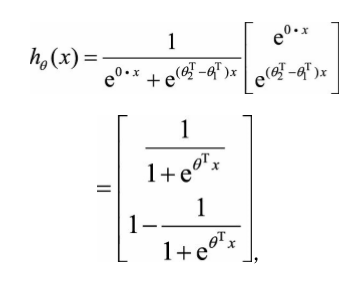

利用参数冗余的特点,我们将所有参数减去θ1,上式变为

其中 。而整理后的式子与逻辑回归一致。因此,多项逻辑回归实际上是 二分类逻辑回归在多标签分类下的一种拓展。

。而整理后的式子与逻辑回归一致。因此,多项逻辑回归实际上是 二分类逻辑回归在多标签分类下的一种拓展。

当存在样本可能属于多个标签的情况时,我们可以训练k个二分类的逻辑回归 分类器。第i个分类器用以区分每个样本是否可以归为第i类,训练该分类器时,需 要把标签重新整理为“第i类标签”与“非第i类标签”两类。通过这样的办法,我们就 解决了每个样本可能拥有多个标签的情况。