摘要:本次实验中的代码基于python,用pytorch识别手势所代表的数字。首先利用opencv打开摄像头采集分辨率为64*48的手势灰度图像,接着使用pytorch建立卷积神经网络来对图片进行训练,得到训练模型,最后调用模型,用opencv打开摄像头实时采集人的手势照片,最后在pycharm终端显示检测结果。

github代码地址:https://github.com/1240117300/pytorch-opencv-Gesture-Recognition

一、方法和材料:

1.首先撰写用于采集手势训练集的opencv代码,如下图所示。代码中按下s键对图片进行保存,保存地址为与项目相同根目录下

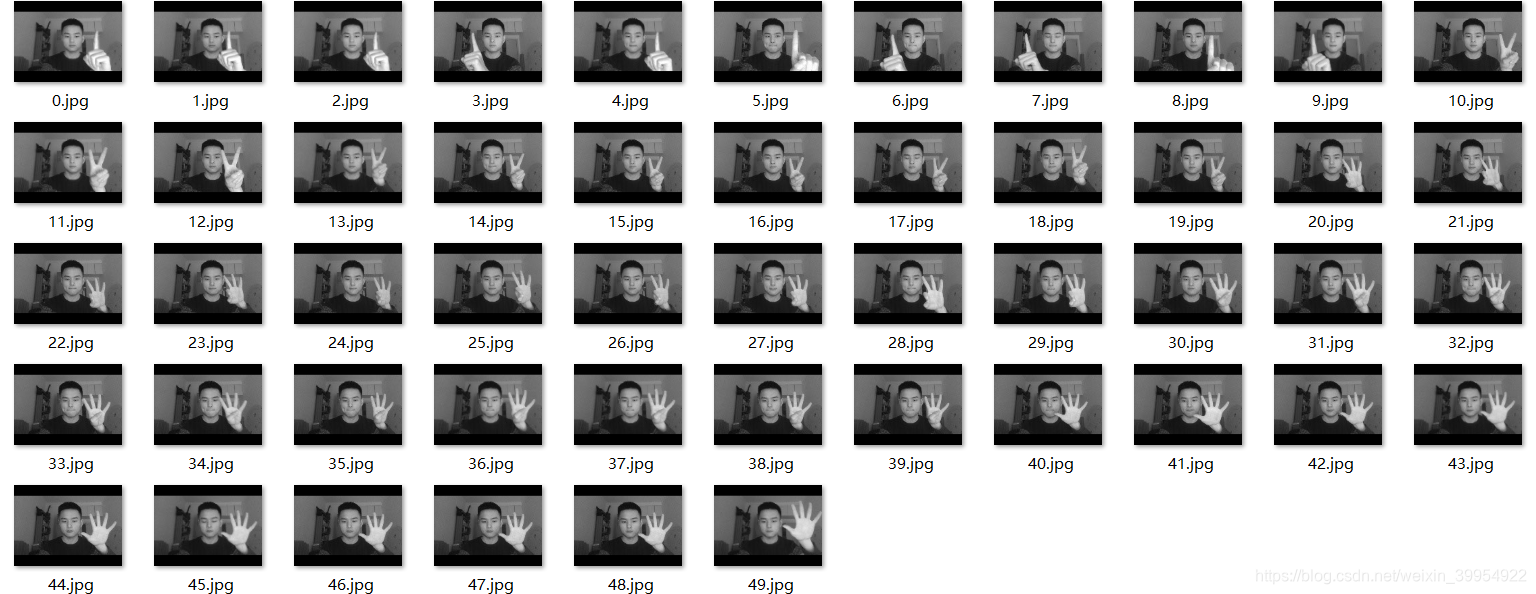

得到数据集,如下图所示,这里的数据集为作者本人的手势照片,只是为了验证算法的逻辑性和合理性,因此采集的数据集比较少。理论上,后期想要得到比较完美的训练模型,需要大量的训练模型。

2.导入数据集,转换图片格式为Tensor,并建立卷积神经网络对数据集进行训练。本次实验中,我建立了三层网络(如下图所示),建立神经网络后,开始训练模型,之后将模型保存

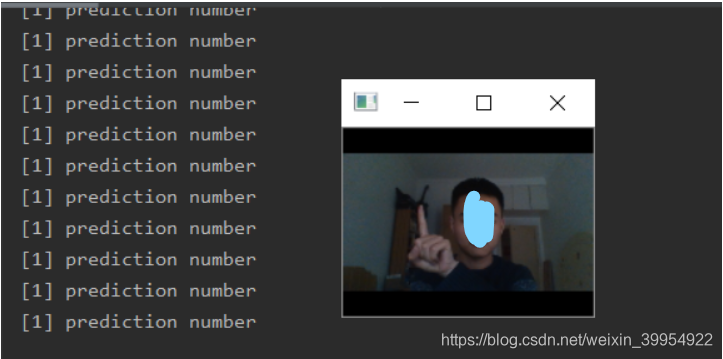

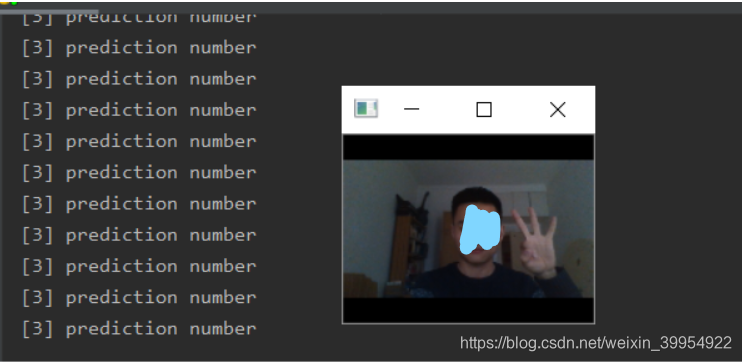

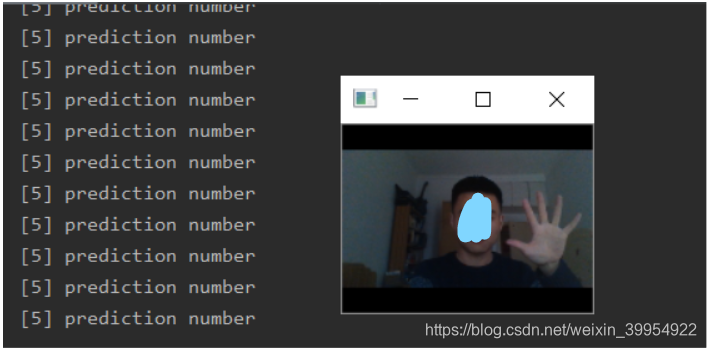

3.导入模型,打开摄像头采集实时手势照片,并在终端显示检测结果。检测结果如下图所示。左边为检测到的数字,右边的图像为展示的手势

总结:还是要好好学习一下卷积神经网络的理论知识,这样才能知道如何调参数,以达到更好的训练模型