读取数据

赛题数据虽然是文本数据,每个新闻是不定长的,但任然使用csv格式进行存储。因此可以直接用Pandas完成数据读取的操作。

import pandas as pd

train_df = pd.read_csv('train_set.csv', sep='\t', nrows=100)

#这里的read_csv由三部分组成,第一个为路径,第二个为分割符,第三个为读取行数(这里训练集比较大,因此就先读取少部分)。

在用Pandas读取数据之后,我们往往想要观察一下数据读取是否准确,这就要用到Pandas里面的head( )函数。

这里说明为啥只显示5行数据,这里与head函数有关。

DataFrame.head(n=5)

Return the first n rows.

Parameters: n : int, default 5

Number of rows to select.

Returns: obj_head : type of caller

The first n rows of the caller object.

可以看出head函数默认读取5行。

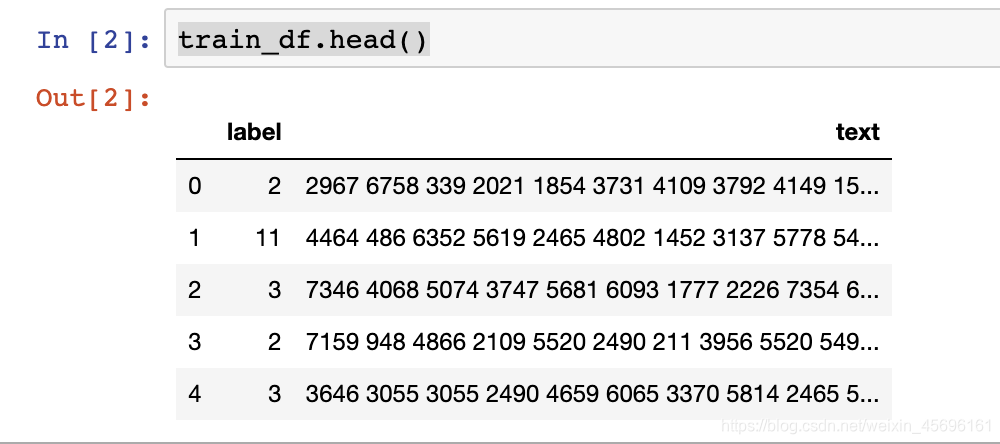

上述数据中,由表格可知第一列为新闻种类,第二列为新闻的字符。

数据分析

在读取完成数据集后,我们还可以对数据集进行数据分析的操作。虽然对于非结构数据并不需要做很多的数据分析,但通过数据分析还是可以找出一些规律的。

此步骤我们读取了所有的训练集数据,在此我们通过数据分析希望得出以下结论:

- 数据中,新闻文本的长度是多少?

- 数据的类别分布是怎么样的,哪些类别比较多?

- 数据中,字符分布是怎么样的?

这里,我们先对句子长度进行分析。

句子长度分析

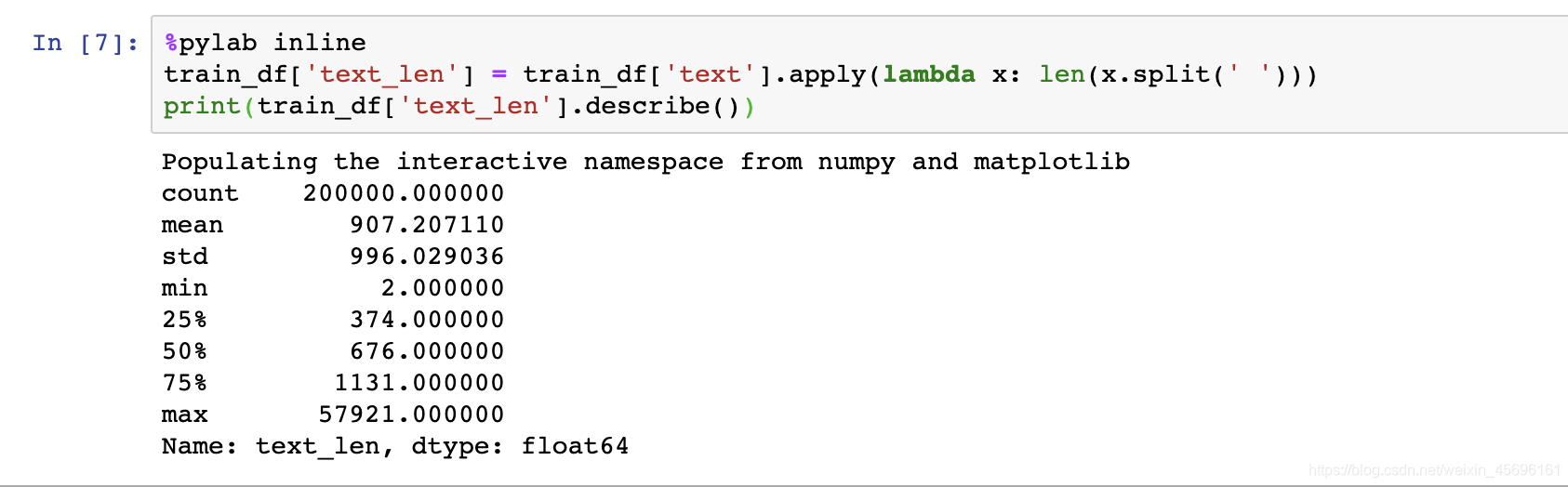

在赛题数据中每行句子的字符使用空格进行隔开,所以可以直接统计单词的个数来得到每个句子的长度。统计并如下:

%pylab inline

train_df['text_len'] = train_df['text'].apply(lambda x: len(x.split(' ')))

print(train_df['text_len'].describe())

对新闻句子的统计可以得出,本次赛题给定的文本比较长,每个句子平均由907个字符构成,最短的句子长度为2,最长的句子长度为57921。

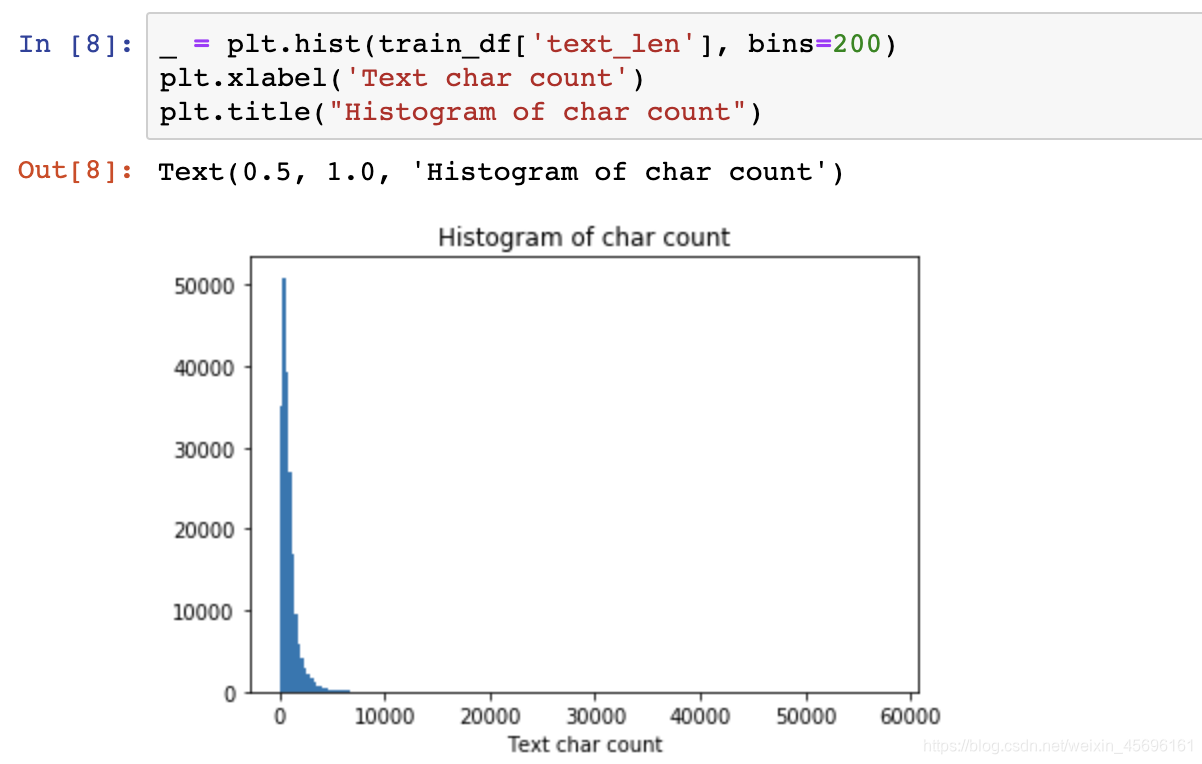

下图将句子长度绘制了直方图,可见大部分句子的长度都几种在2000以内。

_ = plt.hist(train_df['text_len'], bins=200)

plt.xlabel('Text char count')

plt.title("Histogram of char count")

新闻类别分类

接下来可以对数据集的类别进行分布统计,具体统计每类新闻的样本个数。

train_df['label'].value_counts().plot(kind='bar')

plt.title('News class count')

plt.xlabel("category")

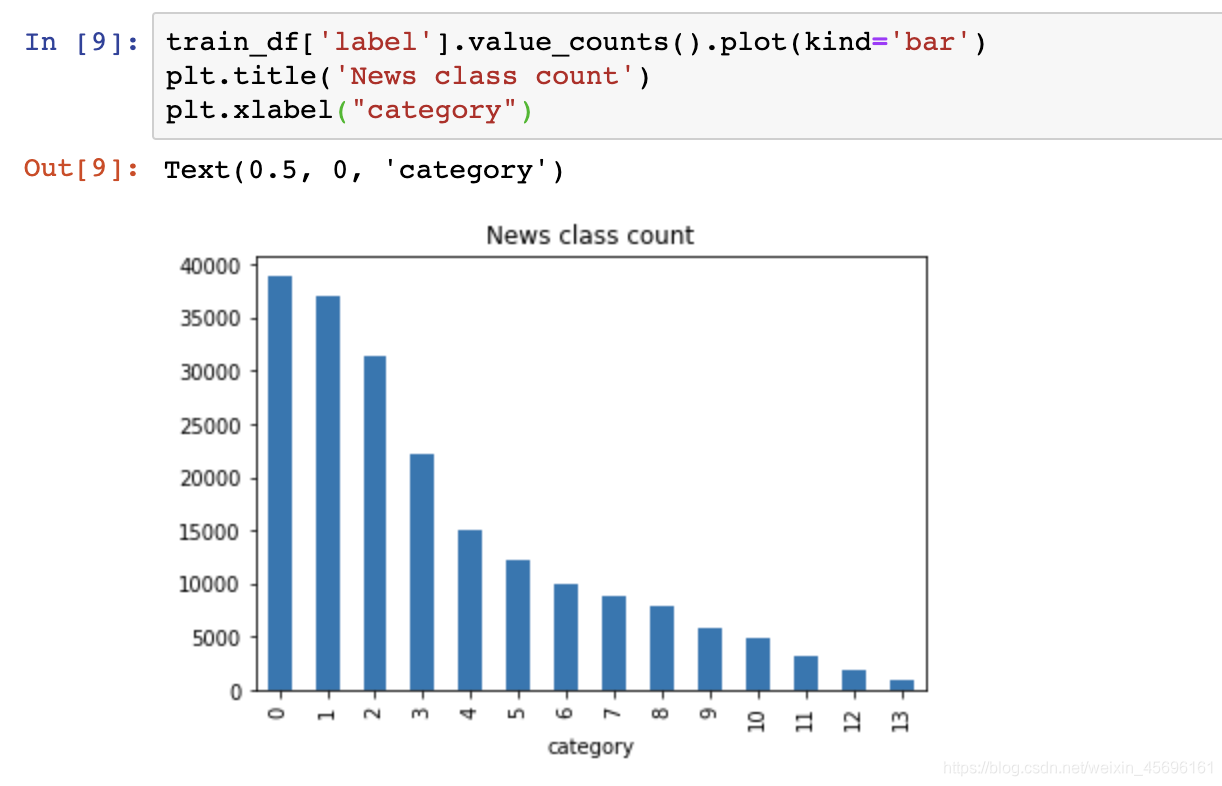

在数据集中标签的对应的关系如下:{‘科技’: 0, ‘股票’: 1, ‘体育’: 2, ‘娱乐’: 3, ‘时政’: 4, ‘社会’: 5, ‘教育’: 6, ‘财经’: 7, ‘家居’: 8, ‘游戏’: 9, ‘房产’: 10, ‘时尚’: 11, ‘彩票’: 12, ‘星座’: 13}

从统计结果可以看出,赛题的数据集类别分布存在较为不均匀的情况。在训练集中科技类新闻最多,其次是股票类新闻,最少的新闻是星座新闻。

字符分布统计

接下来可以统计每个字符出现的次数,首先可以将训练集中所有的句子进行拼接进而划分为字符,并统计每个字符的个数。

from collections import Counter

all_lines = ' '.join(list(train_df['text']))

word_count = Counter(all_lines.split(" "))

word_count = sorted(word_count.items(), key=lambda d:d[1], reverse = True)

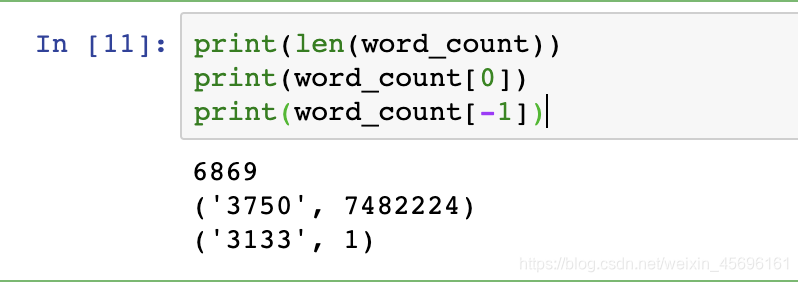

从统计结果中可以看出,在训练集中总共包括6869个字,其中编号3750的字出现的次数最多,编号3133的字出现的次数最少。

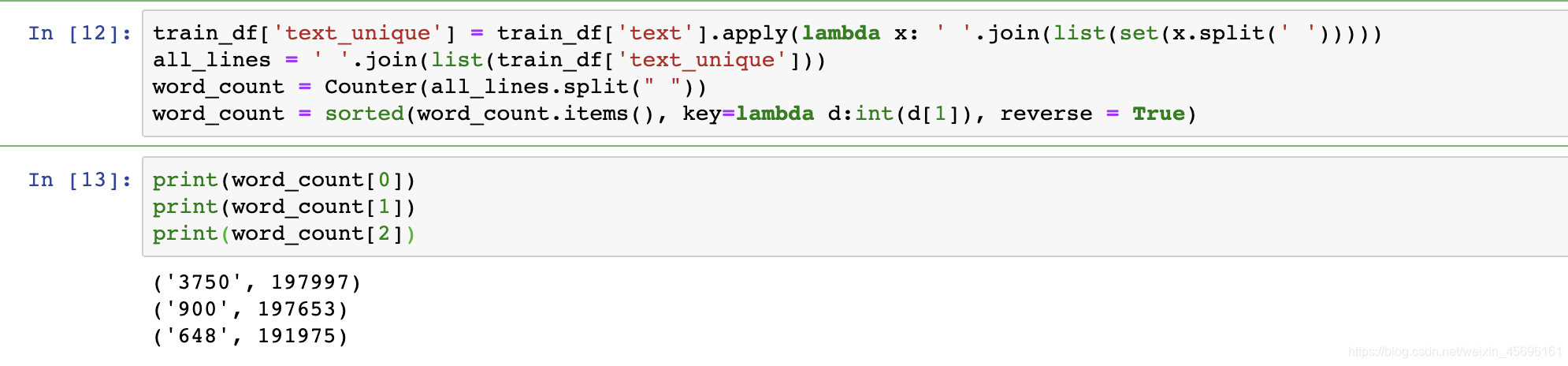

这里还可以根据字在每个句子的出现情况,反推出标点符号。下面代码统计了不同字符在句子中出现的次数,其中字符3750,字符900和字符648在20w新闻的覆盖率接近99%,很有可能是标点符号。

train_df['text_unique'] = train_df['text'].apply(lambda x: ' '.join(list(set(x.split(' ')))))

all_lines = ' '.join(list(train_df['text_unique']))

word_count = Counter(all_lines.split(" "))

word_count = sorted(word_count.items(), key=lambda d:int(d[1]), reverse = True)

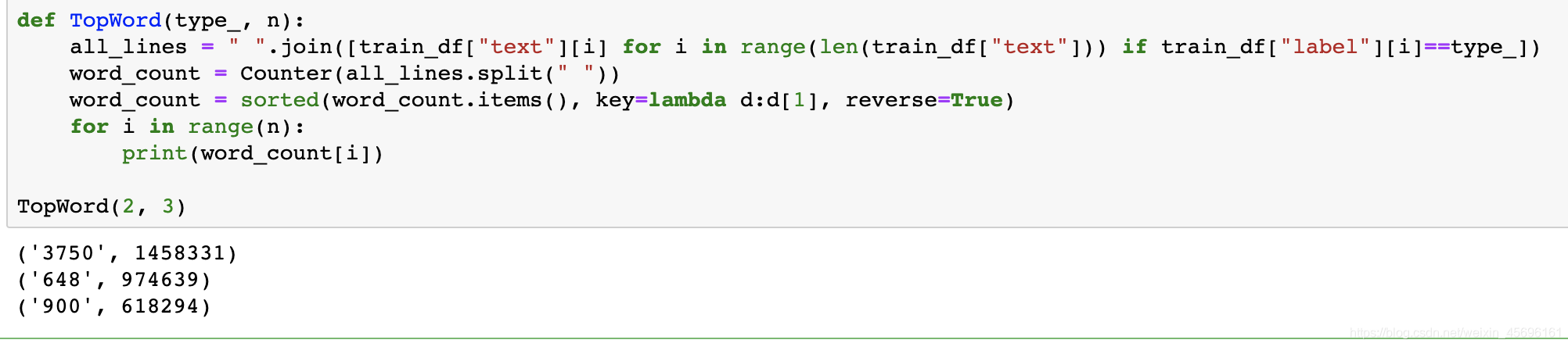

统计出现频率最多的字符

这里我们写一个函数来统计出现频率前3的字符

def TopWord(type_, n):

all_lines = " ".join([train_df["text"][i] for i in range(len(train_df["text"])) if train_df["label"][i]==type_])

word_count = Counter(all_lines.split(" "))

word_count = sorted(word_count.items(), key=lambda d:d[1], reverse=True)

for i in range(n):

print(word_count[i])

TopWord(2, 3)

数据分析结论

通过上述分析我们可以得出以下结论:

- 赛题中每个新闻包含的字符个数平均为1000个,还有一些新闻字符较长;

- 赛题中新闻类别分布不均匀,科技类新闻样本量接近4w,星座类新闻样本量不到1k;

- 赛题总共包括7000-8000个字符;

通过数据分析,我们还可以得出以下结论:

- 每个新闻平均字符个数较多,可能需要截断;

- 由于类别不均衡,会严重影响模型的精度;

总结

主要内容为数据读取和数据分析,具体使用Pandas库完成数据读取操作,并对赛题数据进行分析构成,并新闻句子长度、类别和字符进行了可视化分析。