filebeat的原理

Filebeat的工作方式如下:启动Filebeat时,它将启动一个或多个输入,这些输入将在为日志数据指定的位置中查找。对于Filebeat所找到的每个日志,Filebeat都会启动收集器。每个收集器都读取单个日志以获取新内容,并将新日志数据发送到libbeat,libbeat将聚集事件,并将聚集的数据发送到为Filebeat配置的输出

Filebeat结构:由两个组件构成,分别是inputs(输入)和harvesters(收集器),这些组件一起工作来跟踪文件并将事件数据发送到您指定的输出,harvester负责读取单个文件的内容。harvester逐行读取每个文件,并将内容发送到输出。为每个文件启动一个harvester。harvester负责打开和关闭文件,这意味着文件描述符在harvester运行时保持打开状态。如果在收集文件时删除或重命名文件,Filebeat将继续读取该文件。这样做的副作用是,磁盘上的空间一直保留到harvester关闭。默认情况下,Filebeat保持文件打开,直到达到close_inactive

Kafka简介

Kafka是一种消息队列,主要用来处理大量数据状态下的消息队列,一般用来做日志的处理。既然是消息队列,那么Kafka也就拥有消息队列的相应的特性了

kafka消息队列的好处

应用解耦

缓冲

流量削峰

异步处理

zookeeper简介

它是一个分布式服务框架,是Apache Hadoop 的一个子项目,它主要是用来解决分布式应用中经常遇到的一些数据管理问题,如:统一命名服务、状态同步服务、集群管理、分布式应用配置项的管理等。

相当于 文件系统+通知机制

搭建Filebeat+zookeeper+kafka+ELK

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-mZ6j6dkT-1646744485306)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\1.bmp)]](https://img-blog.csdnimg.cn/6d9ea1fab4bf4a738d95a5fd97865975.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

| 主机名 | ip | 系统 | 组件 |

|---|---|---|---|

| node1 | 192.168.100.142 | centos7 | Elasticsearch,Elasticsearch-head, Kiabana |

| node2 | 192.168.100.140 | centos7 | Elasticsearch,Elasticsearch-head |

| apache | 192.168.100.141 | centos7 | httpd ,logstash, |

| filebeat1 | 192.168.100.145 | centos7 | zookeeper,kafka |

| filebeat2 | 192.168.100.134 | centos7 | zookeeper,kafka |

| filebeat3 | 192.168.100.144 | centos7 | zookeeper,kafka |

这次实验是延着在上一次 ELK实验做下去的,所以部署ELK我就不演示了,有需要的可以去看我上一篇博客,里面详细介绍ELK以及部署步骤

言归正传,让我们开始本次实验

1.安装zookeeper kafka(在fiebeat1 - 3都要操作)

(1)解压安装zookeeper软甲包

[root@bogon opt]# tar zxvf apache-zookeeper-3.5.7-bin.tar.gz

[root@bogon opt]# mv apache-zookeeper-3.5.7-bin /usr/local/zookeeper-3.5.7

[root@bogon opt]# cd /usr/local/zookeeper-3.5.7/

[root@bogon conf]# cp zoo_sample.cfg zoo.cfg

[root@bogon conf]# vim zoo.cfg

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-H834TMbN-1646744485308)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\2.bmp)]](https://img-blog.csdnimg.cn/484b6c7f9be447d28be5fa110ff0e2fa.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-apt6FqPr-1646744485309)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\3.bmp)]](https://img-blog.csdnimg.cn/d1b58b0bf24947fe8190da27013a2d13.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

[root@bogon conf]# cd ..

[root@bogon zookeeper-3.5.7]# mkdir data logs

[root@bogon zookeeper-3.5.7]# echo 1 > data/myid

## 给每个机器指定对应的节点号

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-F3ppSyS1-1646744485310)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\4.bmp)]](https://img-blog.csdnimg.cn/ab52688066474180b5a53f262fc66ad7.bmp)

(2)启动zookeeper

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-qWS4Bs2h-1646744485311)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\5.bmp)]](https://img-blog.csdnimg.cn/5826850c85db4e3a8f49a8dcce804536.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

查看三个节点zookeeper状态

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-SuNV7Inf-1646744485312)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\6.bmp)]](https://img-blog.csdnimg.cn/a7e5a5df02184e5497df2f391dae7d9c.bmp)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-0rPrdXQe-1646744485313)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\7.bmp)]](https://img-blog.csdnimg.cn/f40e1e25eddc4421ae6079b9708d922d.bmp)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-DJ2A3Up9-1646744485313)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\8.bmp)]](https://img-blog.csdnimg.cn/a094bfa7f2ee4fa0be937e8639c55bd4.bmp)

(2).安装 kafka(在fiebeat1 - 3都要操作)

[root@bogon bin]# cd /opt/

[root@bogon opt]# tar zxvf kafka_2.13-2.7.1.tgz

[root@bogon opt]# mv kafka_2.13-2.7.1 /usr/local/kafka

(3)修改配置文件

[root@bogon opt]# cd /usr/local/kafka/

[root@bogon kafka]# cd config/

[root@bogon config]# vim server.properties

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-dbcHrWzq-1646744485314)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\9.bmp)]](https://img-blog.csdnimg.cn/dfb82efcedd54b2a84d76f2eb32444ea.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-PnuQyrCb-1646744485315)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\10.bmp)]](https://img-blog.csdnimg.cn/e9f5095f879e4d04928320f99ca60938.bmp)

(4)将相关命令加入到系统环境当中

[root@bogon kafka]# vim /etc/profile

[root@bogon kafka]# source /etc/profile

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-kaRWjcwb-1646744485315)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\11.bmp)]](https://img-blog.csdnimg.cn/339562cd587c4d0a87f9cf6fdfd31cbe.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

(5)启用kafka

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-7FvpQyRp-1646744485316)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\12.bmp)]](https://img-blog.csdnimg.cn/bb53f5acac4245a7a3e26ac20e112560.bmp)

创建topic

(192.168.100.145)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-jSCpgJyn-1646744485317)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\13.bmp)]](https://img-blog.csdnimg.cn/661acbde2dcd4d68975b3bbfdbeddbaa.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

测试topic

发布消息(192.168.100.145)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-i1cwdlmF-1646744485317)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\14.bmp)]](https://img-blog.csdnimg.cn/d8bb498a713f4cf390bcd97fe9ec5273.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-4UW6S2ux-1646744485318)(C:\Users\zhuquanhao\Desktop\截图命令集合\linux\filebeat+ELK\15.bmp)]](https://img-blog.csdnimg.cn/301f2394efd54fc1af74471a878e4664.bmp)

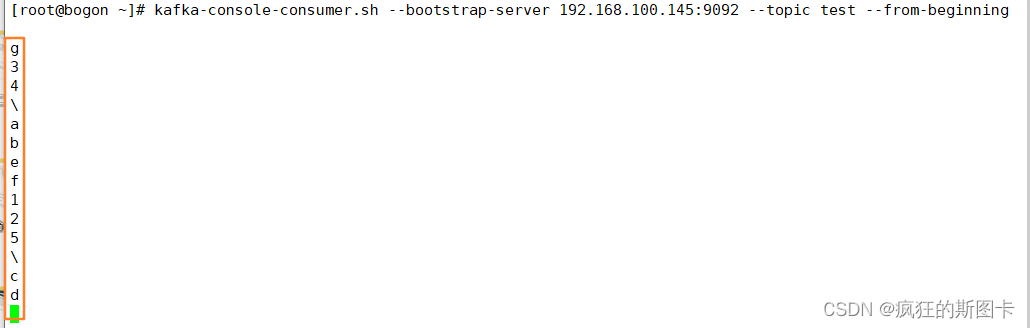

消费消息(192.168.100.145)