内容简介

该论文提出了一个基于量子神经网络分类大图像的框架。此框架中的图像编码采用FRQI方法,并基于此提出了一种压缩方式。论文中还提出了两种量子神经网络层CRADL和CRAML。原文作者在MNIST中的3和6上验证算法的有效性,并在笔记本电脑上实现对8x8和16x16图像的模拟。

相关论文

标题:Image Compression and Classification Using Qubits and Quantum Deep Learning

作者:Ali Mohsen, Mo Tiwari

arXiv: 2110.05476(2021年10月8日)

论文复现代码

代码链接:https://gitee.com/mindspore/mindquantum/tree/research/paper_recurrence/2023/47_richybai

点击下方链接观看视频:

【直播】量子计算组会一起开 | 基于昇思MindSpore Quantum实现FRQI及其压缩形式并用于图像分类任务

01 FRQI编码与图像压缩

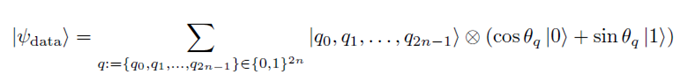

FRQI(Flexible Representation of Quantum Image)[1]编码方式把图像中的颜色与对应的位置联系起来,其编码方式为:

(式1)

其中q代表像素点的位置, 表示该点的颜色。

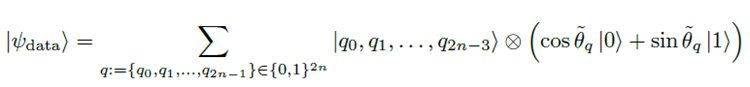

论文中对FRQI进行了改进,进一步压缩了编码图像所使用的量子比特。其编码方式如下:

(式2)

对比式1和式2可以发现,作者将编码位置的最后两个量子比特的信息压缩到了编码颜色的量子比特中

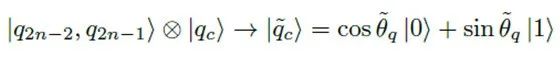

(式3)

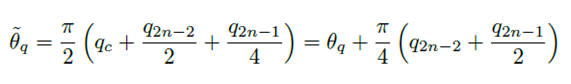

压缩后新的角度表达式为:

(式4)

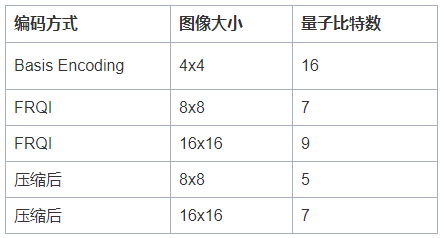

通过式4的映射,每一个新的角度都在【0,】的范围中。不同方法编码图像所使用的量子比特如下表所示:

02 量子神经网络

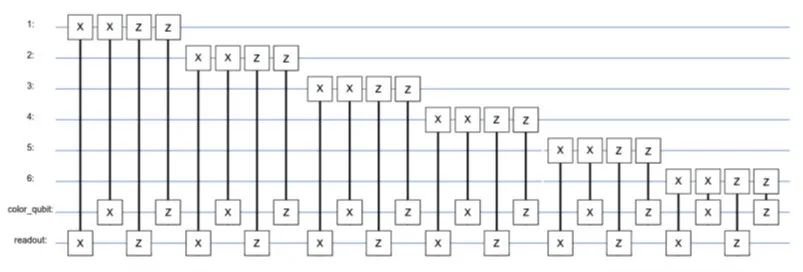

论文中提出了两种量子神经网络的层结构:CRADL(Color-Readout-Alternating-Double-Layer)和CRAML(Color-Readout-Alternating-Mixed-Layer)。线路中共有三种作用不同的量子比特,分别编码像素点位置(pixel),像素点颜色(color),还有一个量子比特专门用于输出结果(readout)的测量。两种量子线路都是由XX门或ZZ门组成,每一个门都是双量子比特门,第一个量子比特为编码像素位置的比特,第二个量子比特为编码像素颜色的量子比特或者用于读取输出结果的量子比特。两种层结构区别在于XX门和ZZ门的作用顺序。两种结构如图1和图2所示:

图1. 六个量子比特编码位置的CRADL层。先作用连续的pixel-readout,pixel-color XX门,再作用类似结构的ZZ门。(来源:论文原文)

图2. 六个量子比特编码位置的CRAML层。pixel-readout,pixel-color XX门和ZZ门交替作用。(来源:论文原文)

量子神经网络层作用在初态上后,作者在读取比特上进行Z测量,得到经典的结果,并使用hinge loss作为损失函数,使用随机梯度下降法优化层中的参数。

03 实验结果

作者对MNIST中的3和6共进行了五组实验,包含经典和量子两大类。首先图像分别被下采样,并二值化,其结果如图3所示:

图3. 数字在不同的下采样分辨率下图像。顶部一行是灰度图像,颜色范围在0 ≤ color ≤ 1,与原始数据集相同。底部一行是通过对上面相应图像的像素颜色进行阈值处理得到的黑白图像。(来源:论文原文)

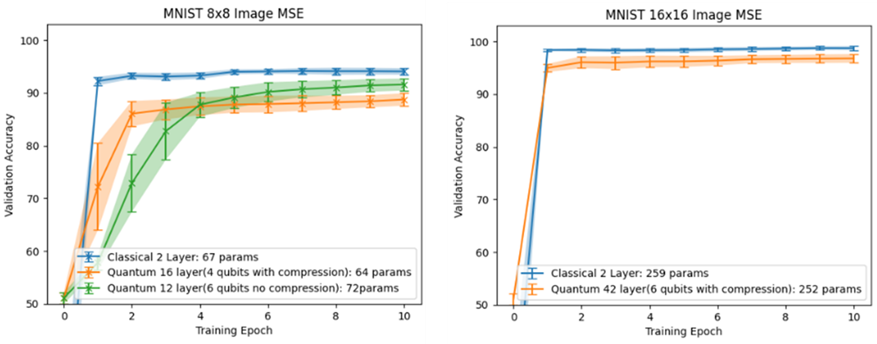

实验中,作者采用了经典的神经网络对8x8和16x16的图像进行分类,经典网络由双隐层组成,激活函数为ReLu。量子神经网络中,作者全部采用CRADL层,并在未压缩的FRQI编码下对8x8的图像分类;在压缩的FRQI编码下,对8x8和16x16进行分类。

我们在昇思MindSpore Quantum复现上述论文结果,并使用MSE作为损失函数以提升结果。分类准确率见下表:

训练过程中测试集上准确率变化对比见图4和图5。

图4. 论文结果(来源:论文原文)

图5. 复现结果

复现分类准确率与论文中基本一致,对于16x16图像下的量子神经网络,MSE的使用对准确率提升了约7%,复现的训练过程走势与论文中基本相同。

引用:

[1]Le, P. Q., Dong, F. and Hirota, K. (2011). A flexible representation of quantum images for polynomial preparation, image compression, and processing operations. Quantum Inf. Process.10 63–84.