loss = y_true * log(y_true / y_pred)

情况一:算两个一维数组

参考:tf.keras.losses.KLDivergence

k = tf.keras.losses.KLDivergence()

loss = k([.4, .9, .2], [.5, .8, .12])

print('Loss: ', loss.numpy()) # Loss: 0.11891246

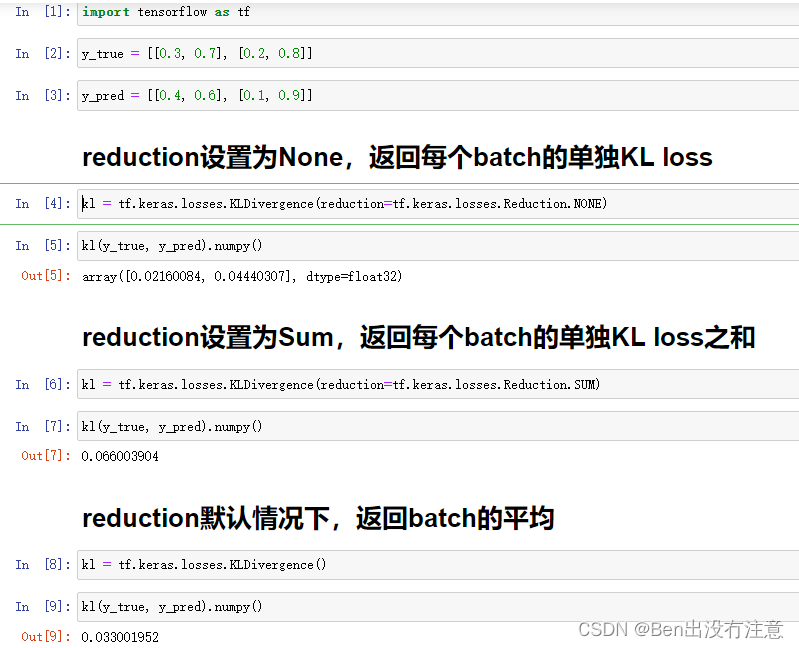

情况二:按batch来算

参考:TensorFlow->API->TensorFlow Core v2.2.0->Python

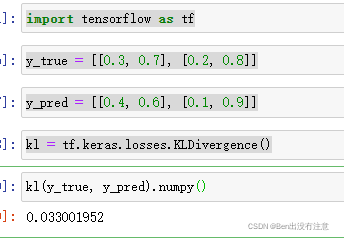

import tensorflow as tf

y_true = [[0.3, 0.7], [0.2, 0.8]]

y_pred = [[0.4, 0.6], [0.1, 0.9]]

kl = tf.keras.losses.KLDivergence()

kl(y_true, y_pred).numpy()

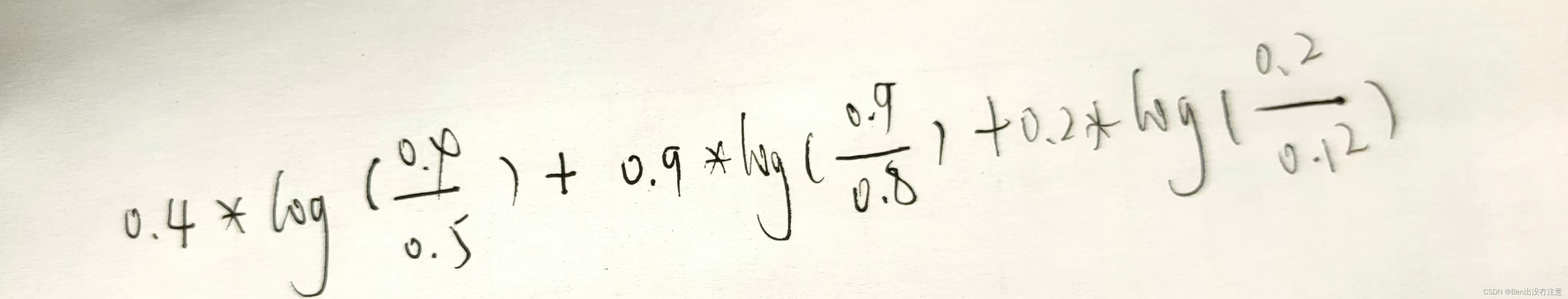

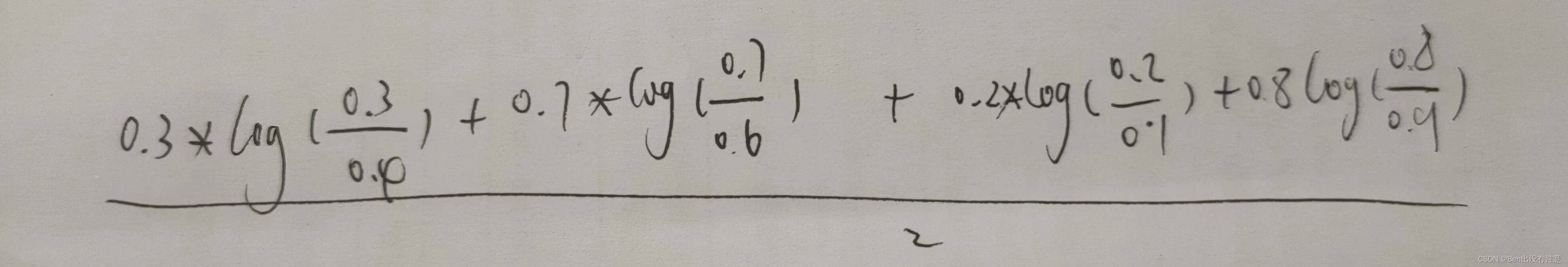

实际运算为:

因为这里batch_size=2,所有要求batch维度上的平均。

完整示例: