一、卷积层

卷积层是卷积神经网络(CNN)中的核心组成部分之一,用于提取输入数据中的特征。卷积层通过应用卷积操作来在输入数据上滑动卷积核,从而获取不同位置的特征信息。以下是卷积层的一些关键特点和作用:

-

特征提取: 卷积层的主要作用是从输入数据中提取有用的特征。卷积核内的权重与输入数据进行卷积操作,以捕捉局部的特征,如边缘、纹理等。

-

参数共享: 在卷积层中,同一卷积核的权重在不同位置共享。这种参数共享可以大大减少模型的参数数量,从而减小过拟合的风险。

-

局部感知: 卷积层的卷积操作使网络对输入数据的局部区域产生响应,有助于保留输入数据的空间结构。

-

平移不变性: 卷积操作具有平移不变性,即输入数据的平移不会改变输出特征图的性质。这使得模型对于不同位置的特征具有更好的泛化能力。

-

池化操作: 卷积层通常与池化层配合使用,池化操作可以减小特征图的尺寸,提取更高层次的特征,同时降低计算量。

-

多通道输入: 在RGB图像等多通道输入数据中,卷积核的每个通道都与输入数据的相应通道进行卷积操作,从而提取多通道特征。

-

激活函数: 卷积层的输出通常会经过一个激活函数,如ReLU,以引入非线性变换,增加模型的表达能力。

卷积层通常由多个卷积核组成,每个卷积核用于提取不同的特征。卷积层的设计和设置,如卷积核的数量、大小以及步幅等,会影响模型的特征提取能力和计算效率。在卷积神经网络中,卷积层被广泛应用于图像处理、自然语言处理等领域,发挥着关键的作用。

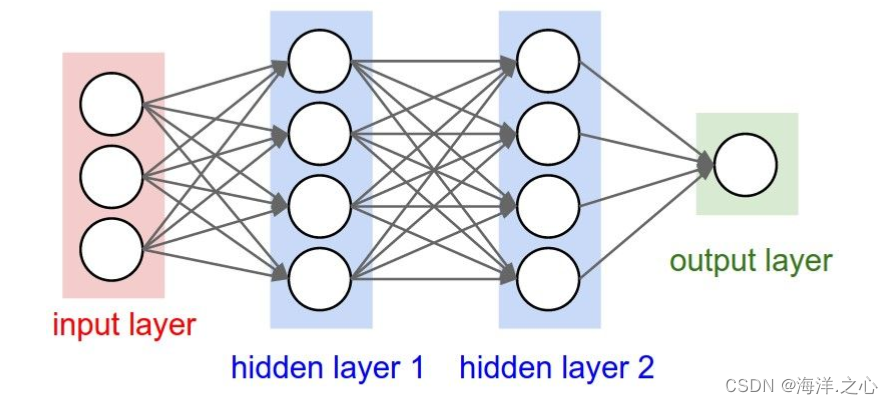

二、全连接层

全连接层(Fully Connected Layer),也称为密集连接层(Dense Layer),是神经网络中的一种基本层结构。在全连接层中,每个神经元都与上一层的所有神经元相连接,形成一个完全连接的结构。全连接层通常用于将前一层的特征映射到最终的输出类别或数值。

全连接层的主要特点和作用包括:

-

特征变换: 全连接层将前一层的特征映射到新的表示,可以对特征进行线性组合和非线性变换。

-

参数数量: 全连接层的参数数量与前一层神经元数量和当前层神经元数量相关,参数较多。

-

灵活性: 全连接层可以将前一层的特征与权重进行加权组合,产生多样的特征表示。

-

分类和回归: 在分类问题中,全连接层通常作为输出层,将前一层的特征映射到各个类别的得分。在回归问题中,全连接层可以输出预测的数值。

-

过拟合风险: 全连接层的参数较多,容易导致过拟合问题。因此,在使用全连接层时需要进行适当的正则化和调参。

然而,全连接层也存在一些问题:

-

参数过多: 大量的全连接层会导致模型的参数数量增加,增加过拟合的风险。

-

计算复杂度: 参数较多会导致计算复杂度增加,不利于训练和推理的效率。

-

位置信息丢失: 全连接层不会保留输入的位置信息,适用性较差于需要保留空间结构的任务,如图像分割。

为了解决全连接层的问题,一些新的网络结构,如卷积神经网络(CNN)和注意力机制等,引入了局部连接、权值共享等概念,从而更好地处理图像、序列等具有结构性的数据。

三、区别

在神经网络中,全连接层(Fully Connected Layer)和卷积层(Convolutional Layer)是两种不同的层结构,它们在连接方式、参数共享、适用场景等方面存在明显的区别。

-

连接方式:

- 全连接层: 每个神经元与上一层的所有神经元相连接,形成一个完全连接的结构。全连接层将前一层的所有特征都作为输入,输出一个综合的结果。

- 卷积层: 卷积层使用卷积核(也称为过滤器)在输入数据上滑动进行卷积操作。每个卷积核只与输入的局部区域相连接,从而捕捉输入数据的局部特征。

-

参数共享:

- 全连接层: 每个神经元的参数独立学习,没有参数共享。这导致参数数量较多,容易出现过拟合。

- 卷积层: 卷积操作可以实现参数共享,即在不同位置使用相同的卷积核权重。这减少了参数数量,提高了模型的效率,并有助于提取平移不变的特征。

-

适用场景:

- 全连接层: 主要用于对特征进行组合、映射和转换,通常用于网络的最后一层进行分类或回归任务。

- 卷积层: 主要用于提取输入数据的局部特征,特别适用于图像、语音等具有空间结构的数据。在卷积神经网络(CNN)中,卷积层常用于前几层进行特征提取。

-

计算复杂度:

- 全连接层: 参数较多,计算复杂度较高。

- 卷积层: 参数共享和局部连接使得卷积层的计算复杂度较低,适合处理大规模数据。

综上所述,全连接层和卷积层在神经网络中有不同的作用和特点。全连接层适用于特征的组合和转换,卷积层适用于提取局部特征,并具有参数共享和平移不变性的优势。在设计神经网络时,需要根据任务需求和数据结构选择适当的层结构。