一、编译环境说明

(1)python

(2)pycharm

二、程序分析,对程序中的四个函数做简要说明

(1)读文件到缓冲区(process_file(dst))

def process_file(dst):

try:

f = open(dst, "r") #打开文件

except IOError as s:

print(s)

return None

try:

bvffer = f.read() #读文件到缓冲区

except:

print('Read File Error!')

return None

f.close()

return bvffer

(2)处理缓冲区,返回存放每个单词频率的字典word_freq(process_buffer(bvffer))

def process_buffer(bvffer):

if bvffer:

word_freq = {}

# 下面添加处理缓冲区 bvffer代码,统计每个单词的频率,存放在字典word_freq

bvffer = bvffer.lower()

# 去除文本中的中英文标点符号

for ch in '“‘!;,.?”':

bvffer = bvffer.replace(ch, " ")

words = bvffer.strip().split()

for word in words:

word_freq[word] = word_freq.get(word, 0) + 1 #给单词计数

return word_freq

(3)输出频率的单词的频率(output_result(word_freq))

if __name__ == "__main__":

cProfile.run("main()", "result")

p = pstats.Stats("result")

p.strip_dirs().sort_stats("call").print_stats(10)

p.strip_dirs().sort_stats("cumulative").print_stats()

p.print_callees("process_buffer")

(4)main()函数

def main():

dst = "E:\Gone_with_the_wind.txt"

bvffer = process_file(dst)

word_freq = process_buffer(bvffer)

output_result(word_freq)

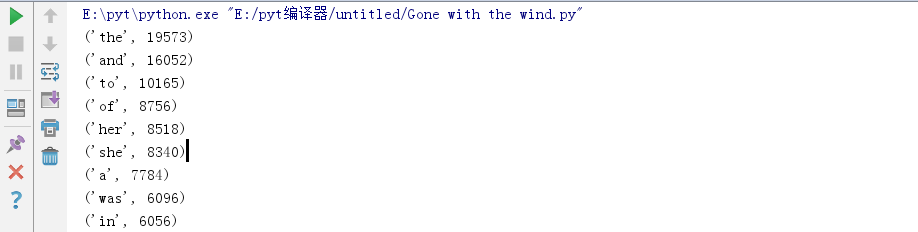

三、程序运行命令、运行结果截图

对文件《A_Tale_of_Two_Cities》进行词频统计

①在pycharm2018中运行的结果截图

四、性能分析结果及改进

(1)代码

if __name__ == "__main__":

import cProfile

import pstats

cProfile.run("main()", filename="result.out")

# 创建Stats对象

p = pstats.Stats('result.out')

# 输出调用此处排前十的函数

# sort_stats(): 排序

# print_stats(): 打印分析结果,指定打印前几行

p.sort_stats('calls').print_stats(10)

# 输出按照运行时间排名前十的函数

# strip_dirs(): 去掉无关的路径信息

p.strip_dirs().sort_stats("cumulative", "name").print_stats(10)

# 根据上面的运行结果发现函数process_buffer()最耗时间

# 查看process_buffer()函数中调用了哪些函数

p.print_callees("process_buffer")

五、代码

import cProfile

import pstats

def process_file(dst):

try:

f = open(dst, "r") #打开文件

except IOError as s:

print(s)

return None

try:

bvffer = f.read() #读文件到缓冲区

except:

print('Read File Error!')

return None

f.close()

return bvffer

def process_buffer(bvffer):

if bvffer:

word_freq = {}

# 下面添加处理缓冲区 bvffer代码,统计每个单词的频率,存放在字典word_freq

bvffer = bvffer.lower()

# 去除文本中的中英文标点符号

for ch in '“‘!;,.?”':

bvffer = bvffer.replace(ch, " ")

words = bvffer.strip().split()

for word in words:

word_freq[word] = word_freq.get(word, 0) + 1 #给单词计数

return word_freq

def output_result(word_freq):

if word_freq:

sorted_word_freq = sorted(word_freq.items(), key=lambda v: v[1],reverse=True)

for item in sorted_word_freq[:10]: # 输出 Top 10 的单词

print(item)

def main():

dst = "E:\Gone_with_the_wind.txt"

bvffer = process_file(dst)

word_freq = process_buffer(bvffer)

output_result(word_freq)

if __name__ == "__main__":

cProfile.run("main()", "result")

p = pstats.Stats("result")

p.strip_dirs().sort_stats("call").print_stats(10)

p.strip_dirs().sort_stats("cumulative").print_stats()

p.print_callees("process_buffer")