卷积神经网络(CNN)在图像处理方面有很多出色的表现,在ImageNet上有很多成功的模型都是基于CNN的。AlexNet是具有历史意义的一个网络,2012年提出来当年获得了当年的ImageNet LSVRC比赛的冠军,此后ImageNet LSVRC的冠军都是都是用CNN做的,并且层数越来越深。可以说AlexNet的提出是具有里程碑式的意义的,它使得CNN成为图像识别分类领域的核心算法,引来了深度学习的大爆发。

另一个有名的CNN模型是2015年何凯明团队提出来的深度残差网络ResNet,他引入了残差模块,一定程度改善了网络的退化现象,为网络加深一定程度后网络分类精度随着深度加深反而降低的现象提供了解决思路。

1.AlexNet

AlexNet主要特点:

- 修正线性单元:ReLU。ReLU函数的导数始终为1,使得计算量大大减小,收敛速度比sigmoid,tanh快很多。

- 防止过拟合方法:Dropout:通过定义的概率将神经元置为0,这个神经元如同被删除;

数据扩充:当训练数据有限时,将训练数据变换进行扩充(eg.水平翻转、裁剪、颜色、光照) - 重叠池化:一种避免过拟合的手段

- 增加局部响应归一化层 (LRN):有助于增加泛化能力

2.ResNet

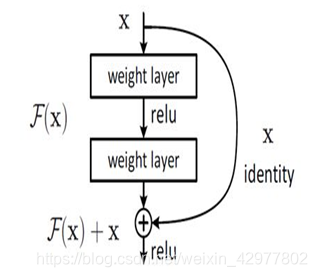

ResNet最显著的特征就是引入了残差模块。

关于残差为什么能够增加改善网络退化的问题,我比较赞同下面的说法:残差模块的shortcut connection这种残差跳跃式的结构使得ResNet打破了传统神经网络只能逐层传递参数的方法,使得深度残差网络可以越过中间的某几层直接将参数传递给后面的层,起到了一种丢层的作用。随机丢层网络和Dropout的提出都说明了忽略一些不那么重要的网络层或神经元对于网络性能的提升是有促进作用的。残差网络的这种结构使得每次工作的网络其实并没有那么深,某种意义上,可以看做是一些不同的浅层神经网络的组合。

3.选用数据集

NWPU-RESISC45 dataset:图像像素大小为256256,总包含45个场景图像,每一类有700张,共31,500张;

UCMerced Land-Use dataset: 图像像素大小为256256,总包含21类场景图像,每一类有100张,共2100张

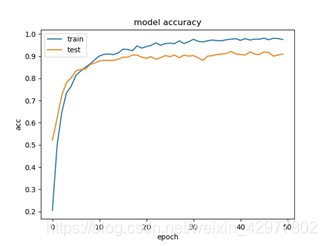

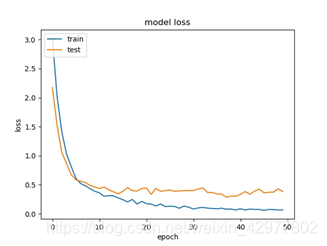

4.实验结果

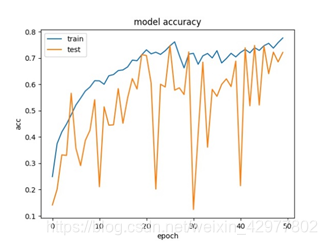

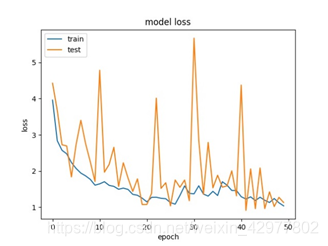

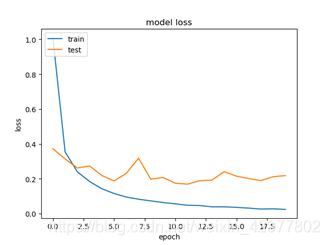

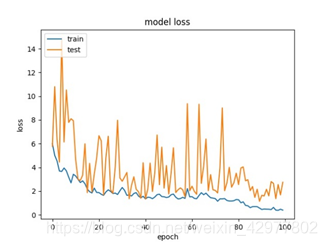

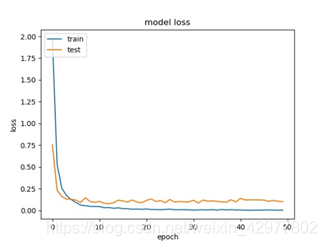

AlexNet在NWPU上分类结果

ResNet在NWPU上分类结果

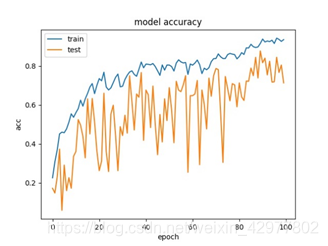

AlexNet在UCM上分类结果

ResNet在UCM上分类结果

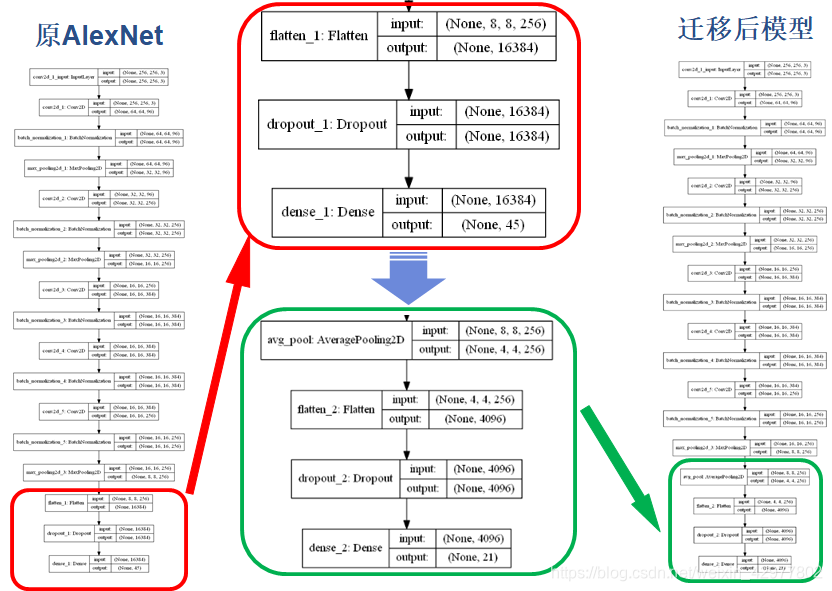

5.迁移学习

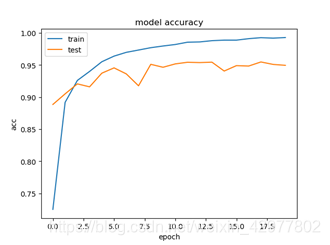

首先在NWPU上训练一个AlexNet模型,将最后三层45类的分类器替换成针对UCM的21类分类器,然后对UCM进行分类。

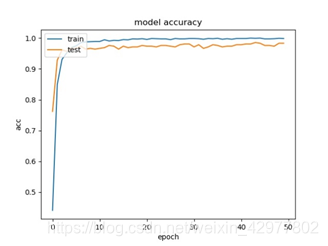

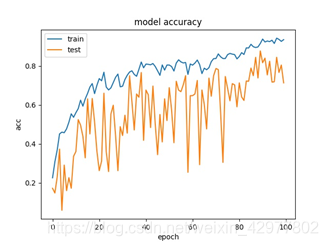

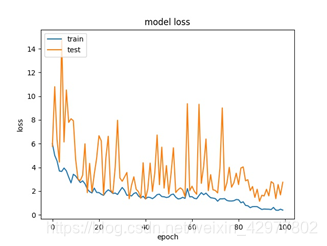

迁移前后分类结果对比

迁移前

迁移后

可以看到,迁移后分类准确率提升了,而且收敛的更快了。