一、此文档安装spark在以下节点上:

zgl-1:192.168.127.121

zgl-2:192.168.127.122

zgl-3:192.168.127.123

二、安装部署

1、上传安装包( spark-2.0.2-bin-hadoop2.7.tgz)到/usr/local目录下

如图:

2、解压安装包

指令:

tar -zxvf spark-2.0.2-bin-hadoop2.7.tgz

# 为了使用方便,此处为spark安装文件重命名

如图:

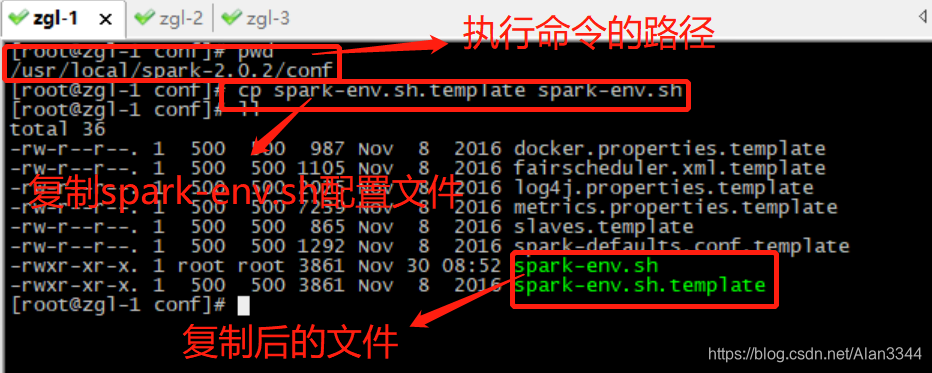

3、配置

# 进入conf目录

cd /usr/local/spark-2.0.2/conf/

3.1、 复制配置文件

cp spark-env.sh.template spark-env.sh

如图:

vim spark-env.sh

# 将以下内容添加到spark-env.sh文件中

export JAVA_HOME=/usr/local/jdk1.8.0_141

export SPARK_MASTER_IP=zgl-1

export SPARK_MASTER_PORT=7077

export HADOOP_CONF_DIR=/usr/local/hadoop-2.7.4/etc/hadoop

如图:

3.2、配置slaves文件

cp slaves.template slaves

vim slaves

# 将以下内容添加进slaves文件中

zgl-2

zgl-3

如图:

4、将spark的安装包从zgl-1节点上下发到其余节点

scp -r /usr/local/spark-2.0.2/ @zgl-2:/usr/local/

scp -r /usr/local/spark-2.0.2/ @zgl-3:/usr/local/

5、配置spark的环境变量

vim /etc/profile

# 添加以下内容到profile文件中

export SPARK_HOME=/usr/local/spark-2.0.2

export PATH=$PATH:$SPARK_HOME/bin:$SPARK_HOME/sbin

如图:

# 将配置文件下发到其余节点

scp /etc/profile @zgl-2:/etc/

scp /etc/profile @zgl-3:/etc/

# 加载环境变量(每个节点均需要执行以下指令)

指令:

source /etc/profile

6、启动验证spark是否配置成功

cd /usr/local/spark-2.0.2/sbin/

sh start-all.sh

如图:

#验证是否启动成功

jps

如图:

# 或者访问http://192.168.127.121:8080/

注(以上192.168.127.121是主节点ip)

如图:

小结:如上图验证,spark安装部署成功!!!