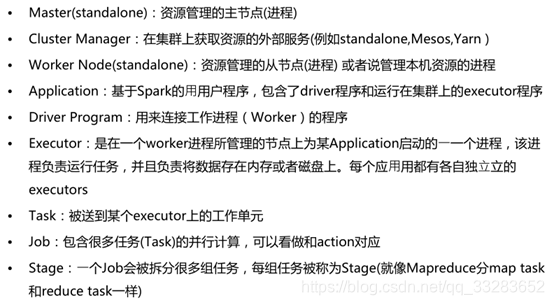

1.术语解释

2.SparkCore和SparkSQL知识点思维导图整理

https://download.csdn.net/download/qq_33283652/10890863

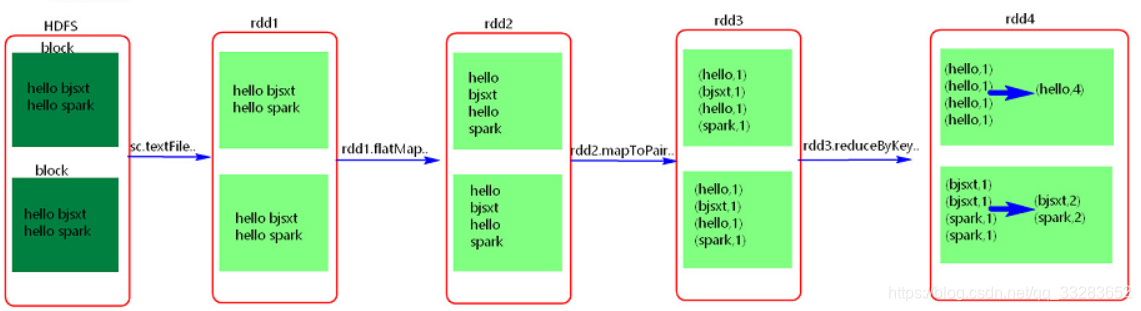

3.RDD的宽窄依赖

相同的key去同一个分区,但一个分区可以用不同的key

RDD窄依赖:

父RDD与子 RDD partition之间的关系是一对一或多对一,例如rdd1与rdd2,rdd2与rdd3

RDD宽依赖(shuffle):

父RDD与子 RDD partition之间的关系是一对多,例如rdd3与rdd4

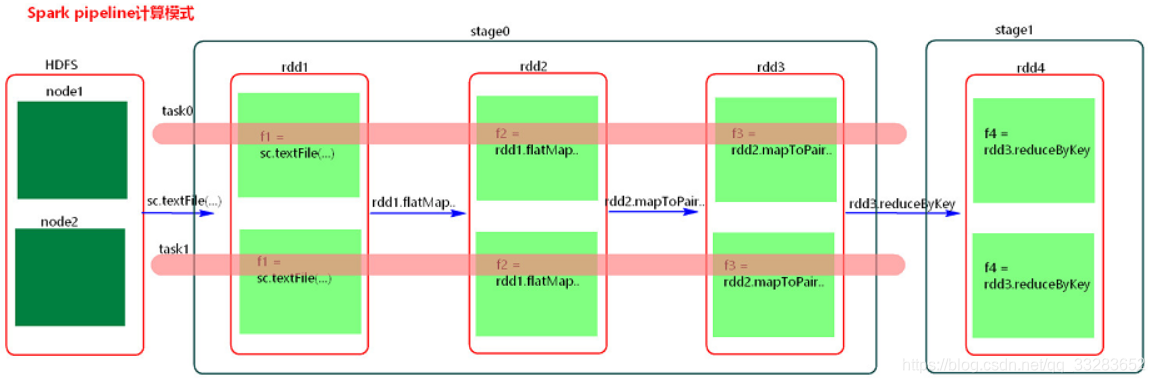

4.stage

partition中存储的是处理逻辑,不存数据

spark处理数据模式(pipeline计算模式):

rdd1取出一条数据处理,将结果传给rdd2,rdd2处理后传给rdd3,rdd3处理后存入磁盘中,然后rdd1再取出一条数据处理,直到处理完所有数据。

扩展:

- Stage的并行度由finalRDD的partition个数决定。

- 管道中的数据在shuffle write和RDD持久化时写入磁盘中

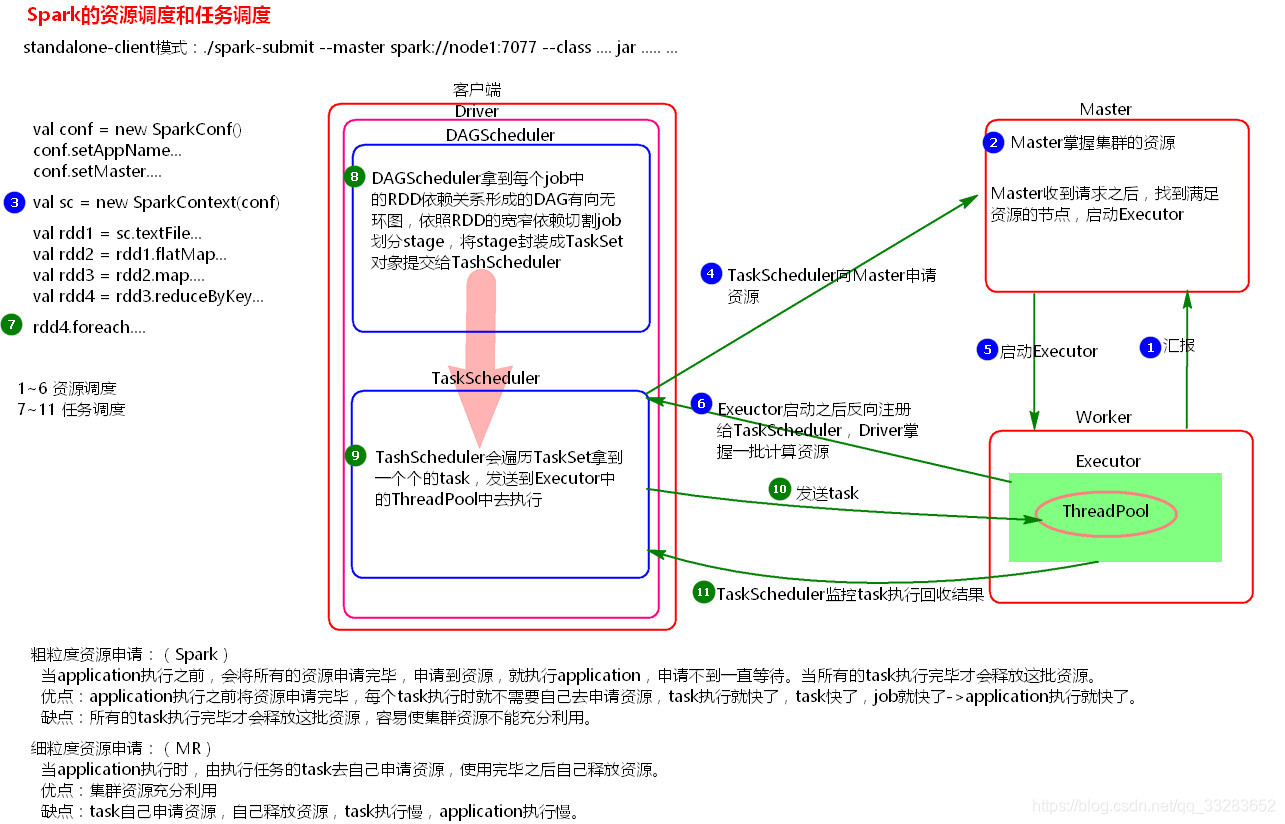

5.Spark资源调度和任务调度的流程

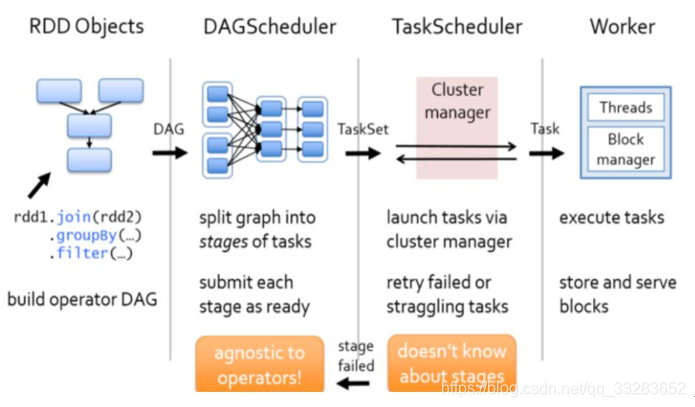

启动集群后,Worker节点会向Master节点汇报资源情况,Master掌握了集群资源情况。当Spark提交一个Application后,根据RDD之间的依赖关系将Application形成一个DAG有向无环图。任务提交后,Spark会在Driver端创建两个对象:DAGScheduler和TaskScheduler,DAGScheduler是任务调度的高层调度器,是一个对象。DAGScheduler的主要作用就是将DAG根据RDD之间的宽窄依赖关系划分为一个个的Stage,然后将这些Stage以TaskSet的形式提交给TaskScheduler(TaskScheduler是任务调度的低层调度器,这里TaskSet其实就是一个集合,里面封装的就是一个个的task任务,也就是stage中的并行度task任务),TaskSchedule会遍历TaskSet集合,拿到每个task后会将task发送到计算节点Executor中去执行(其实就是发送到Executor中的线程池ThreadPool去执行)。task在Executor线程池中的运行情况会向TaskScheduler反馈,当task执行失败时,则由TaskScheduler负责重试,将task重新发送给Executor去执行,默认重试3次。如果重试3次依然失败,那么这个task所在的stage就失败了。stage失败了则由DAGScheduler来负责重试,重新发送TaskSet到TaskSchdeuler,Stage默认重试4次。如果重试4次以后依然失败,那么这个job就失败了。job失败了,Application就失败了。

TaskScheduler不仅能重试失败的task,还会重试straggling(落后,缓慢)task(也就是执行速度比其他task慢太多的task)。如果有运行缓慢的task那么TaskScheduler会启动一个新的task来与这个运行缓慢的task执行相同的处理逻辑。两个task哪个先执行完,就以哪个task的执行结果为准。这就是Spark的推测执行机制。在Spark中推测执行默认是关闭的。推测执行可以通过spark.speculation属性来配置。

注意:

- 对于ETL类型要入数据库的业务要关闭推测执行机制,这样就不会有重复的数据入库。

- 如果遇到数据倾斜的情况,开启推测执行则有可能导致一直会有task重新启动处理相同的逻辑,任务可能一直处于处理不完的状态。