信息,消息和信号:

获得信息就将消除一部分不确定性。

信息量就是事件发生后消除的不确定性的量,每消除一部分不确定性,我们就认为收到了一部分信息量。

信息描述的就是不确定性。信息是概率的函数

香农信息定义:信息是事物运动状态或存在方式不确定性的描述

信息的特征:

1. 不确定性,接受者在收到信息之前,对它的内容是不知道的;

事物出现某状态不确定性的大小,与该状态出现的概率大小有关

不确定性完全可以有概率来度量。我们根据概率变化的大小就可以得到消除的不确定性的大小。

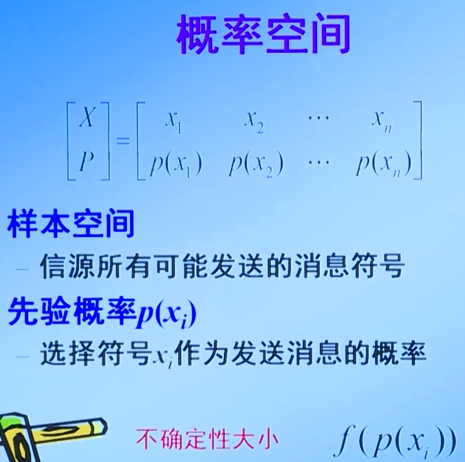

不确定性的大小和概率的大小有关,并且呈现递减$f(p(x_i))$

不确定性大小函数f应该满足以下的条件:

1. f(1)=0;

2. f(p(x))是单调递减函数,也就是说概率越大,不确定性越小

3. 独立可加性

$f(p(x)p(y)) = f(p(x))+f(p(y))$

香农信息定义:信息是事物运动状态或存在方式不确定性的描述,

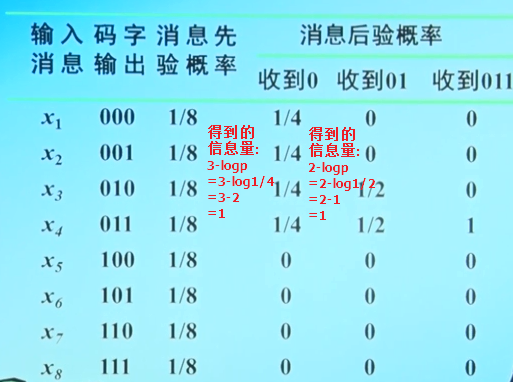

自信息:$I(x_i) = -log P(x_i)$,这里$P(x_i)$就是选择符号值$x_i$作为发送消息的概率,而$I(x_i)$就是选择符号值$x_i$作为发送消息的不确定性。

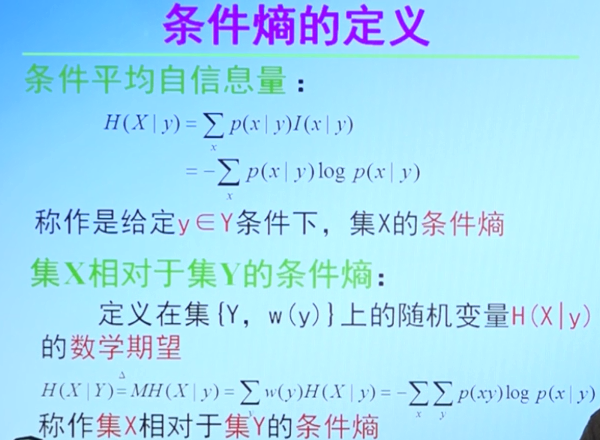

条件自信息:$I(x_i|y_j) = - log p(x_i|y_j)$,当我收到$y_j$后,我确定发送端发送的是$x_i$的不确定性, 后验概率$p(x_i|y_j)$表示接收端收到消息$y_j$后而发送端发的是$x_i$的概率

2. 信息能使主题对某一事物的未执行或不确定性减少

3. 信息是可以度量的

消息:是包含有信息的语言文字或者图像等

信号:是消息的物理体现

熵的定义:

集$\{X, P(x)\}$上定义的随机变量$I(x)$的数学期望:$H(x) = - \sum P(x)log P(x) = \sum I(x) P(x)$

称为集X的平均自信息量,又称为是集X的信息熵,简称熵

熵的含义:

表示为了确定集X中一个事件出现平均所需的信息量(观测前),或集X中每出现一事件平均给出的信息量(观测后)