Python爬虫开发——urllib的使用

urllib库简介:它是Python内置的HTTP请求库,也就是说不需要额外安装即可使用。它包含如下4个模块:

- request:它是最基本的HTTP请求模块,可以用来模拟发送请求。就像在浏览器中输入网址然后回车一样,只需要给库方法传入URL以及额外的参数,就可以模拟实现这个过程。

- error:它是异常处理模块,如果出现请求错误,我们可以捕获这些异常,然后进行重试或其他操作以保证程序不会意外终止。

- parse:它是一个工具模块,提供了许多URL方法,比如拆分、解析、合并等。

- robotparse:它主要是用来识别网站的robots.txt文件,然后判断哪些网站可以爬,哪些网站不可以爬(它用的较少)

发送请求

urlopen()

我们可以使用urllib的request模块来实现发送请求以及得到响应。下面我们进行其具体用法的描述。

urllib.request模块提供了最基本的构造HTTP请求的方法,利用它可以模拟浏览器的一个请求发起过程,同时它还带有处理授权验证(authentication)、重定向(redirection)、浏览器Cookies以及其它内容。下面我们举一个例子,爬下来csdn的主页并保存至csdn.txt:

import urllib.request

response = urllib.request.urlopen('https://www.csdn.net/')

with open('csdn.txt','w')as file:

file.write(response.read().decode())

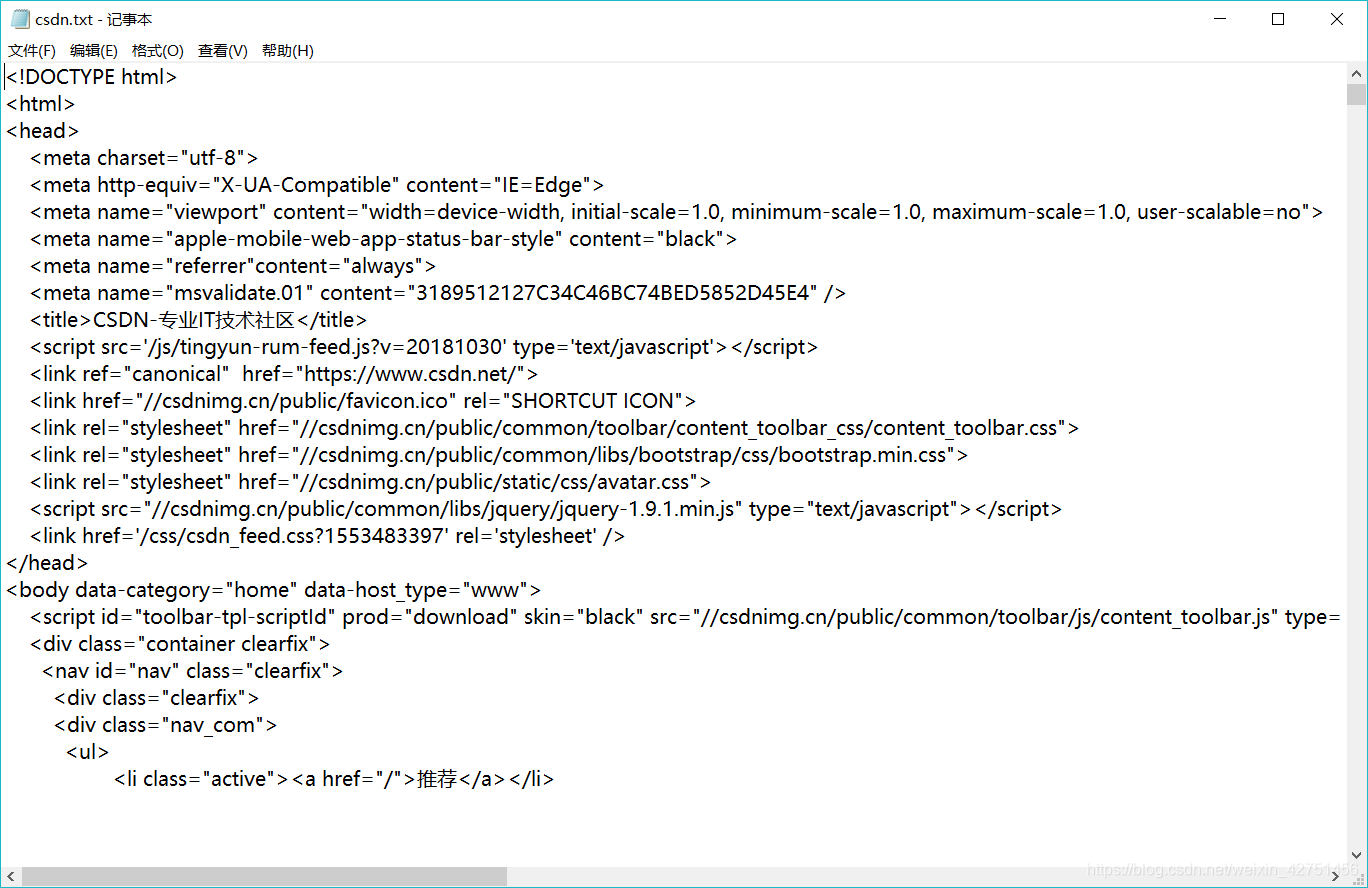

我们查看一下csdn.txt:

这里我们只用了几行代码就爬取了csdn主页的源代码,得到源代码之后,我们想要的链接、图片等就可以提取出来了。接下来我们用type()看看它返回的是什么:

import urllib.request

response = urllib.request.urlopen('https://www.csdn.net/')

print(type(response))

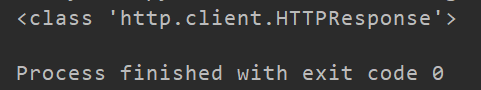

结果:

这里我们可以看出他是一个HTTPResponse类型的对象,主要包含read()、readinto()、getheader(name)、getheaders()、fileno()等方法,以及msg、status、version、reason、debuglevel、closed等属性。接下来我们把它赋值为response变量,就可以调用这些方法和属性,得到返回结果的一系列信息。比如调用read()方法得到返回的网页内容,调用status属性可以得到返回结果的状态码。

用一个例子来演示:

import urllib.request

response = urllib.request.urlopen('https://www.csdn.net/')

print(response.status)

print(response.version)

print(response.getheaders())

print(response.getheader('Server'))

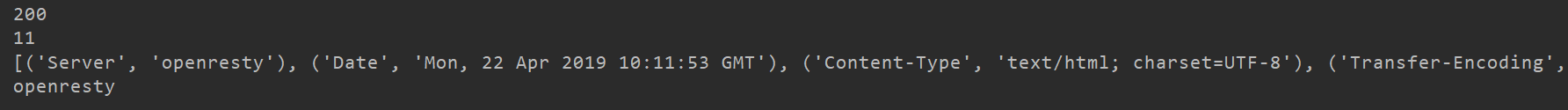

运行结果如下:

说到这里,urlopen()方法的基本使用我们已经掌握,接下来看一下如何更充分的利用urlopen()方法

说到这里,urlopen()方法的基本使用我们已经掌握,接下来看一下如何更充分的利用urlopen()方法

urllib.request.urlopen(url,data=None,[timeout,]*,cafile=None,capath=None,cadefault=False,context=None)

从urlopen()方法的API可以发现除了第一个参数可以传递URL之外,我们还可以传递其它内容,比如data(附加数据)、timeout(超时时间)等等。下面对其中几个参数进行说明:

-

data参数

data参数是可选参数。若要添加该参数,并且如果它是字节流编码格式的内容,即bytes类型,则需要通过bytes()方法转化。另外,如果传递了这个参数,则它的请求方式就不再是GET方式,而是POST方式,下面用一个实例来解读(说明:进行请求的站点是httpbin.org,它可以提供HTTP请求测试):import urllib.parse import urllib.request data = bytes(urllib.parse.urlencode({'name':'vergilben'}),encoding='utf-8') response = urllib.request.urlopen('http://httpbin.org/post',data=data) print(response.read())

这里我们传递了一个参数name,值是vergilben。它需要被转码成bytes(字节流)类型,其中使用的bytes()方法,第一个参数需要是str类型,需要用urllib.parse模块里的urlencode()方法来将参数字典转化为字符串;第二个参数指定编码格式。

运行结果如下:

上图可以发现我们传递的参数出现在了form字段中,这表明是模拟了表单提交的方式,以POST方式提交数据。

上图可以发现我们传递的参数出现在了form字段中,这表明是模拟了表单提交的方式,以POST方式提交数据。

- timeout参数

timeout参数用于设置超时时间,单位为秒,即如果请求超出了设置的这个时间还没有得到响应就会抛出异常。若不指定该参数,就会使用全局默认时间。它支持HTTP、HTTPS、FTP请求。

再用一个实例来解读:

import urllib.request

response = urllib.request.urlopen('http://httpbin.org/get',timeout=0.1)

print(response.read())

在这里我们设置超时时间为0.1秒。程序过0.1秒之后,服务器依然没有响应,于是抛出了URLError异常,这个异常属于urllib.error模块,错误原因是超时,运行结果如下:

Traceback (most recent call last):

File "F:\Python\lib\urllib\request.py", line 1317, in do_open

....

During handling of the above exception, another exception occurred:

Traceback (most recent call last):

File "C:/Users/wangx/Desktop/PythonWebSpider/timeout参数.py", line 9, in <module>

response = urllib.request.urlopen('http://httpbin.org/get',timeout=0.1)

....

urllib.error.URLError: <urlopen error timed out>

因此,我们可以通过设置这个超时时间来控制一个网页如果长时间未响应,就跳过它的抓取,这可以用try except语句来实现,实例如下:

import urllib.request

import socket

import urllib.error

try:

response = urllib.request.urlopen('http://httpbin.org/get',timeout=0.1)

except urllib.error.URLError as e:

if isinstance(e.reason,socket.timeout):

print('TIME OUT')

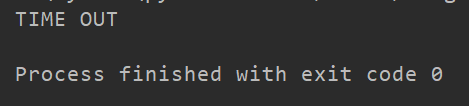

运行结果如下:

通过设置timeout这个参数来实现超时处理,有时还是很有用的。

- 其它参数

除了data参数和timeout参数外,还有context参数,它必须是ssl.SSLContext类型,用来指定SSL设置。此外,cafile和capath这两个参数分别指定CA证书和它的路径,这个在请求HTTPS链接时会有用。

cadefualt参数现在已经弃用了,其默认值为False。

Request

前面已经讲过利用urlopen()方法可以实现最基本请求的发起,但这几个简单的参数并不足以构建一个完整的请求。若请求中需要假如Headers等信息,就可以利用更强大的Request类来构建。

先用一个实例来介绍一下Request的用法:

import urllib.request

request = urllib.request.Request('https://www.csdn.net/')

response = urllib.request.urlopen(request)

print(response.read().decode())

可以发现,我们依然使用urlopen()方法来发送这个请求,只不过这次该方法的参数不再是URL,而是一个Request类型的对象。通过构造这个数据结构,一方面我们可以将请求独立成一个对象,另一方面可以更加丰富和灵活地配置参数。

其构造方法如下:

class urllib.request.Request(url,data=None,headers={},origin_req_host=None,unverifiable=False,method=None)

-

第一个参数url用于请求URL,这是必传参数,其它都是可选参数。

-

第二个参数data如果要传,必须传bytes(字节流)类型的,如果它是字典,可以先用urllib.parse 模块里的urlencode()编码。

-

第三个参数headers是一个字典,它就是请求头,我们可以在构造请求时通过headers参数直接构造,也可以通过调用请求实例的add_header()方法添加。添加请求头最常用的用法就是通过修改User-Agent来伪装浏览器,默认的User-Agent是Python-urllib,我们可以通过修改它来伪装浏览器。比如要伪装火狐浏览器,可以把它设为:

Mozilla/5.0 (X11; U; Linux i686) Gecko/20071127 Firefox/2.0.0.11 -

第四个参数origin_req_host指的是请求方的host名称或者IP地址。

-

第五个参数unverifiable表示这个请求是否是无法验证的,默认是False,意思就是说用户没有足够权限来选择接收这个请求的结果。例如,我们请求一个HTML文档中的图片,但是我们没有自动抓取图像的权限,这时unverifiable的值就是True。

-

第六个参数method是一个字符串,用来指示请求使用的方法,比如GET、POST和PUT等。

接下来我们传入多个参数构建请求来看一下:

from urllib import request,parse

url = 'http://httpbin.org/post'

headers = {'User-Agent':'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)','Host':'httpbin.org'}

dict = {'name':'vergilben'}

data = bytes(parse.urlencode(dict),encoding='utf8')

req = request.Request(url=url,data=data,headers=headers,method='POST')

response = request.urlopen(req)

print(response.read().decode('utf-8'))

这里我们通过4个参数构造了一个请求,其中url即请求URL,headers中指定了User-Agent和Host,参数data用urlencode()和bytes()方法转成字节流。另外,指定了请求方式为POST。

运行结果如下:

{

"args": {},

"data": "",

"files": {},

"form": {

"name": "vergilben"

},

"headers": {

"Accept-Encoding": "identity",

"Content-Length": "14",

"Content-Type": "application/x-www-form-urlencoded",

"Host": "httpbin.org",

"User-Agent": "Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)"

},

"json": null,

"origin": "222.88.152.96, 222.88.152.96",

"url": "https://httpbin.org/post"

}

通过观察结果可以发现,我们成功设置了data、headers和method。

另外,headers也可以用add_header()方法来添加:

req = request.Request(url=url,data=data,method='Post')

req.add_header('User-Agent':'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)')

高级用法

在上面的过程中,我们虽然可以构造请求,但是对于一些更高级的操作(比如Cookies处理、代理设置等),就需要更强大的工具Handler了。简而言之,我们可以把它理解为各种处理器,有专门处理登陆验证的,有处理Cookies的,有处理代理设置的。利用它们,我们几乎可以做到HTTP请求中的所有事情。

先介绍一下urllib.requset模块里的BaseHandler类,它是所有其他Handler的父类,它提供了最基本的方法,例如default_open()、protocol_request()等。接下来,就有各种Handler子类继承这个BaseHandler类,举例如下:

- HTTPDefaultErrorHandler:用于处理HTTP响应错误,错误都会抛出HTTPError类型的异常。

- HTTPRedirectionHandler:用于处理重定向。

- HTTPCookieProcessor:用于处理Cookies。

- ProxyHandler:用于设置代理,默认代理为空。

- HTTPPasswordMgr:用于管理密码,它维护了用户名和密码的表。

- HTTPBasicAuthHandler:用于管理认证,如果一个链接打开时需要认证,那么可以用它来解决。

- 。。。。