分类问题

在分类问题中,例如之前提到过的肿瘤良性恶性分类问题,可以将我们要预测的变量Y分为0 和 1 。 被标记为0 的也叫做负类, 标记为1的也叫做正类。 对于正类和负类的定义其实是任意的,没有硬性要求,主要看我们的需要。通常,负类表示某些缺少某样东西的东西,正类表示拥有某些我们需要的东西。接下来首先讨论的是0 1 分类问题。

线性回归方程在解决分类问题中的弊端

首先用线性回归方程拟合分类问题数据集,可以预测出远大于1或远小于0的值。因为在分类问题中,Y的值只有0或1,而线性回归方程的取值范围一般为**-∞到+∞**,而且特征量的取值范围是连续的,且变化较大。当数据集中的数据比较多,变化比较大时可能出现预测值远大于1或远小于0的情况。

在分类问题中我们要做的就是找到一种算法,求出的假设函数的取值范围在0~1之间,而不会出现比1大或比1小的情况。 其中一种算法就是接下来讨论的逻辑回归算法

其次线性回归方程对数据集的分类可能并不理想,可能会将正类划入负类。

二元分类问题

二元分类问题中分类器的输出阈值通常设为0.5 。 如果假设函数输出的值大于等于0.5,则判断预测y值等于1,如果输出值小于等于0.5,则判断预测y值为0.

找到一个函数预测值在0~1之间。

逻辑回归问题

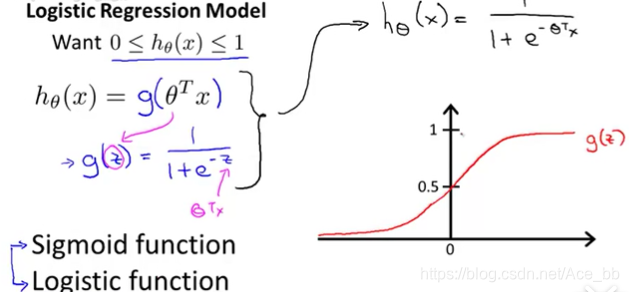

吴恩达老师在视频中给出的逻辑函数表达式及其图像如图:

逻辑函数又称为S型函数。 取值范围为0~1. 而z的取值范围是(-∞,+∞)。

我们要做的就是用参数θ拟合数据

假设函数的输出解释

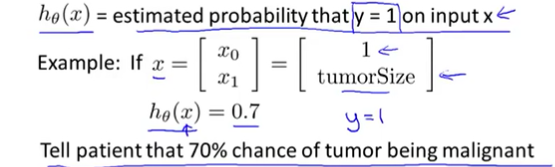

假设函数的作用是得出当输入一个特征量时预测y=1的可能性大小。以吴恩达老师课程中的肿瘤预测例子为例:

当一个病人将肿瘤的size输入到假设函数中时,得到0.7,表示肿瘤是恶性肿瘤的概率是0.7,即y=1的概率是0.7. 用这个式子表示:hθ(x)=P(y=1|x;θ)。 在给定x的条件下,得出y=1的概率,这里的x就是特征量x,而这个概率的参数就是θ。

因此 P(y=0|x;θ) + P(y=1|x;θ) = 1 即同样条件下y为0的概率加上y为1的概率之和等于1.

————————————————————————