论文:https://ydwen.github.io/papers/WenECCV16.pdf

A Discriminative Feature Learning Approach for Deep Face Recognition

和contrastive loss的作用类似,就是和softmax loss一起,一个减少类间差距,一个减少类内差距

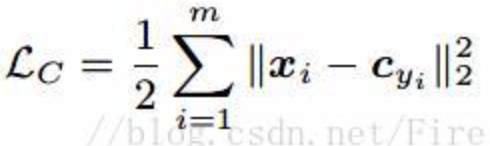

Cyi表示属于yi类的特征的的中心

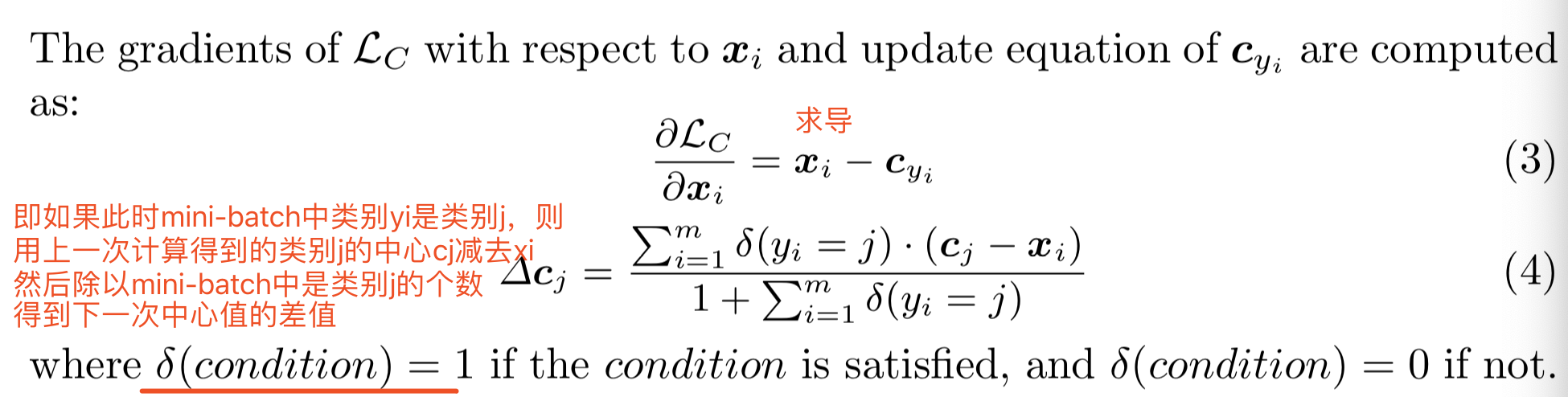

理想情况下,我们每次更新权值都要遍历全部的训练集去获得每个类的中心,这是低效甚至不实际的

为了解决这个问题,作者使用了minbatch中的每个类的中心来更新,(虽然这样可能有些类的中心在一次迭代中无法更新到,因为有些时候在一个mini-batch中不一定包含所有的类别):

分母加1是为了防止分母为0的情况

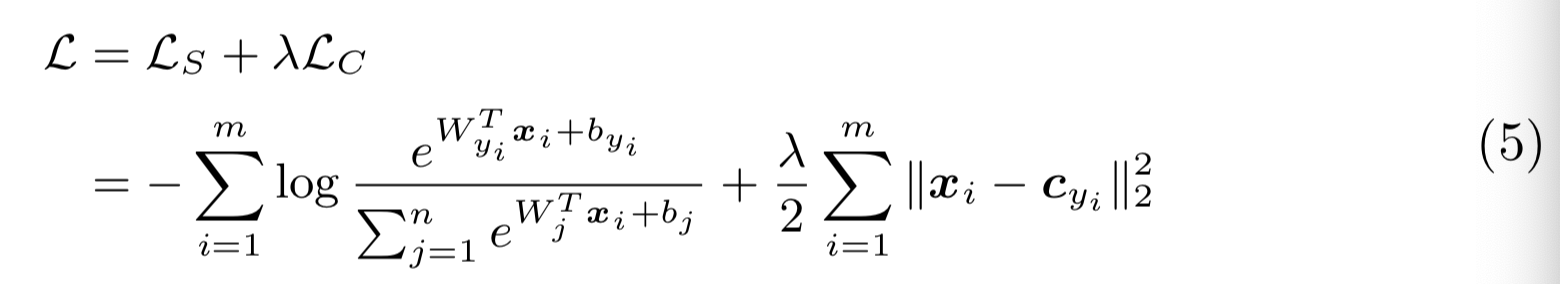

总损失函数使用的是Softmax+center Loss联合损失:

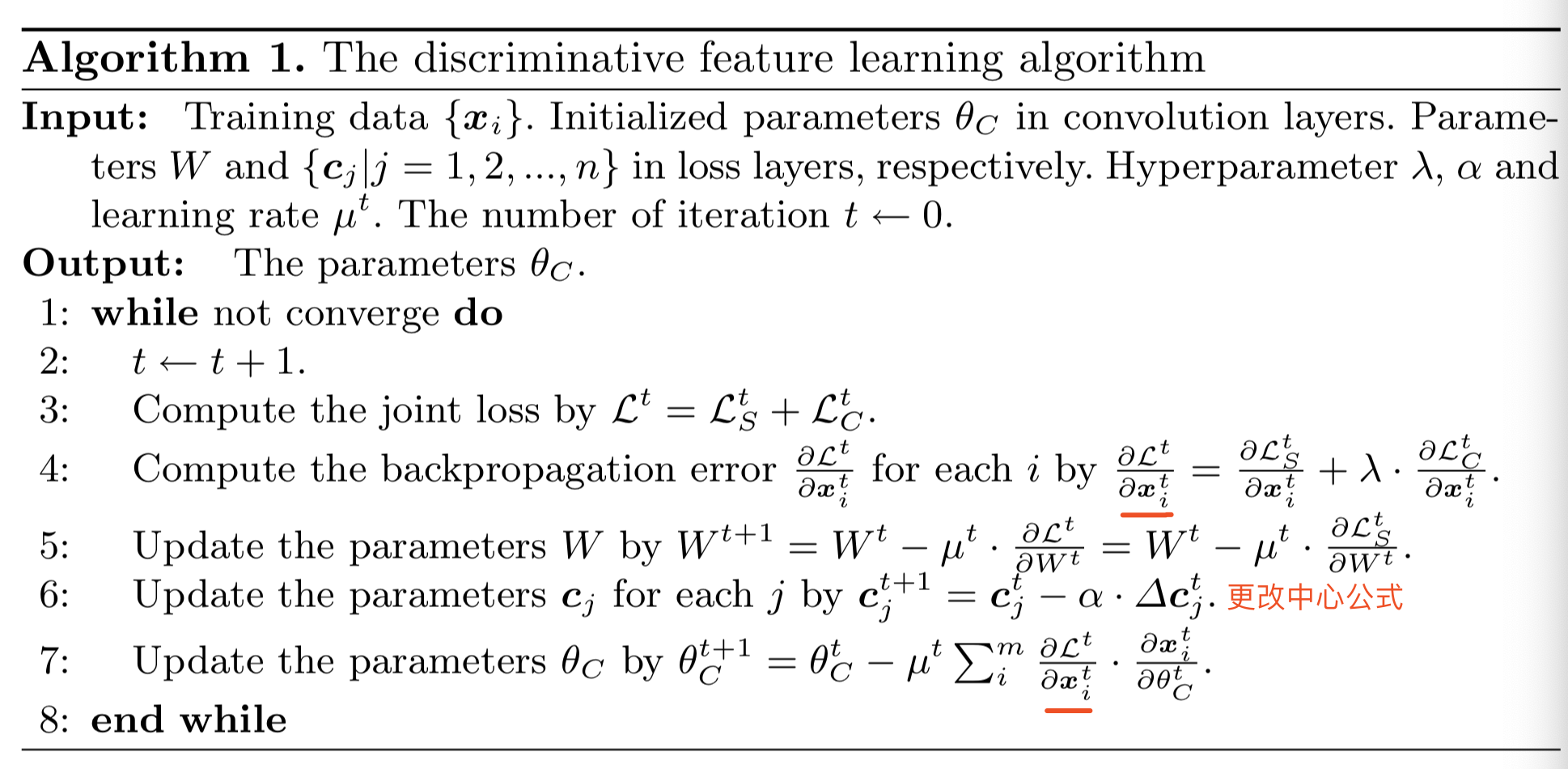

算法流程类似一般的卷积神经网络,就是多了一个更新中心点的流程:

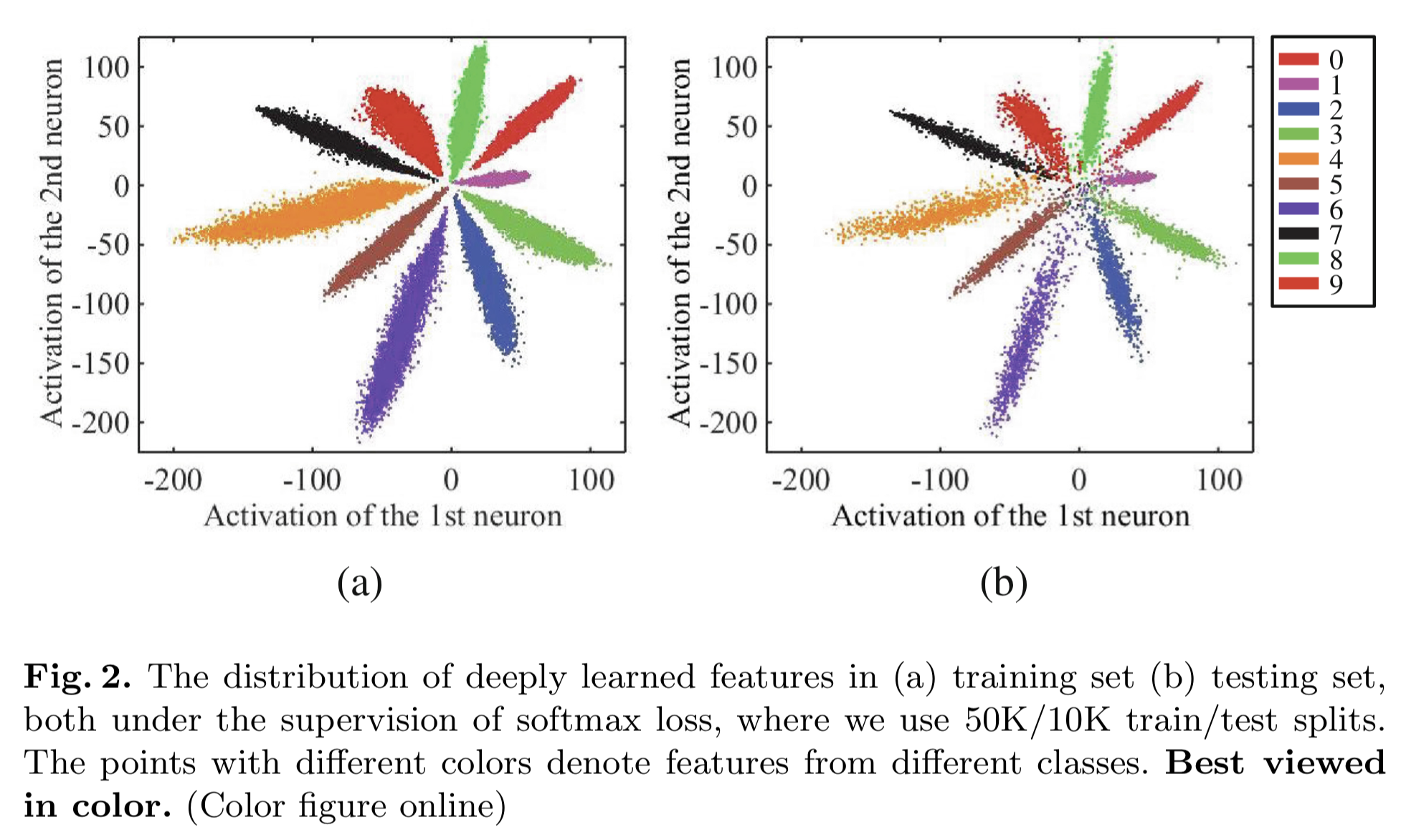

效果变化:

一开始只使用softmax loss时:

加入center loss后:

效果比contrastive loss好