1.概述

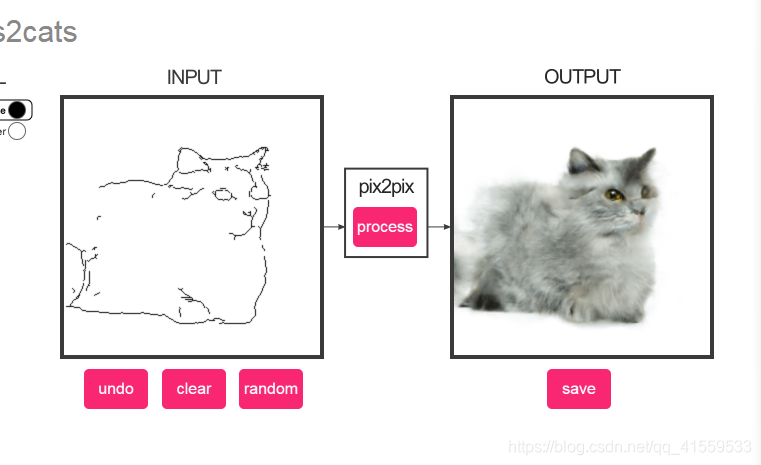

pix2pix 是对抗生成网络的一种变体,它的结构类似于CGAN,但又有别于CGAN。先来说一下它能做哪些事情,顾名思义就是将一张图片转成另一张图片(千万不要理解成像素变像素啊),或者说将一个场景转换成另一场景。pix2pix 能做的事情有很多,比如说将素描画轮廓转换成图片,将黑夜场景转换成白天场景,自动上色,超分辨率等等。具体的可以在pix2pix的在线演示体验。下面列几个应用例子。

也可以按照自己的意愿直接画图,然后生成图片,先点击图片中的clear, 然后自己画图, 点击process 稍等片刻就能生成对应得实物图。

2.理解pix2pix

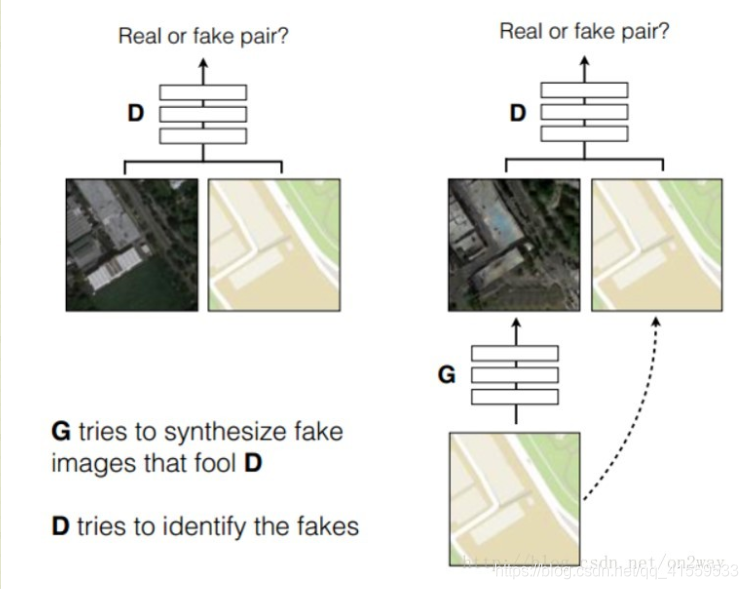

还是通过该模型的两个输入网络来直观理解pix2pix.

pix2pix 同样是由两个网路组成,生成网络G, 判别网络D, 假设我们现在要将A类型的图片转换成B类型的图片,两个网络的输入输出分别是:

G: 输入图片a(A类型), 输出生成的图片G(a)

D: 输入图片b, 和一个A类型的图片a, 在a和b项对应得条件下,判断b图片是否是真正的B类型的图片。

要记着D的最终目的就是判断生成的图片是否是B类型的图片(前提是a, b是对应着的,比如画一个男生的素描轮廓(a), 得到一个男生的实物图(B),这就是对应的含义)。

下面是pix2pix 结构图。

先写这么多,希望大家能对pix2pix有个直观的理解,具体的细节请参考原论文。