转自: http://blog.csdn.net/dragon_fire/article/details/7587226

下载完之后,命令行输入:tar -xzvf tar -xzvf hadoop-0.20.203.0rc1.tar.gz进行解压

重命名为hadoop

cd hadoop

cd conf/core-site

修改 conf/core-site.xml:

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

gedit conf/hdfs-site.xml

修改conf/hdfs-site.xml:

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

gedit conf/mapred-site.xml

修改conf/mapred-site.xml:

<configuration>

<property>

<name>mapred.job.tracker</name>

<value>localhost:9001</value>

</property>

</configuration>

hadoop运行需要JDK支持,因此需要配置Java的安装路径

gedit conf/hadoop-env.sh

加入下面一行(由JDK具体安装的路径决定):

export JAVA_HOME=/usr/local/jdk1.6.0_25

创建一个新的分布式文件系统:

bin/hadoop namenode -format

bin/start-all.sh启动hadoop

结果没启动成功,看了下日志,发现出现了connect to host localhost port 22,原来是ssh没有装

apt-get install openssh-server 安装ssh

建立 SSH KEY:

$ ssh-keygen -t rsa -P “” (注意不要多加空格或缺少空格)

中途需要安装者选择保存密钥的文件,按回车使用默认的文件就可以了:

Enter file in which to save the key (/root/.ssh/id_rsa):(按回车)

启用SSH KEY:

$ cat /root/.ssh/id_rsa.pub >> /root/.ssh/authorized_keys

/etc/init.d/ssh reload

reload ssh

ssh localhost

再次运行hadoop

bin/start-all.sh

发现如下错误 Unrecognized option: -jvm

再次bin/start-all.sh

如果启动不起来 请先 bin/hadoop -namenode format

再bin/stop-all.sh,再bn/start-all.sh

接着访问http://localhost:50030,http://localhost:50070,如果成功打开了,说明安装成功了

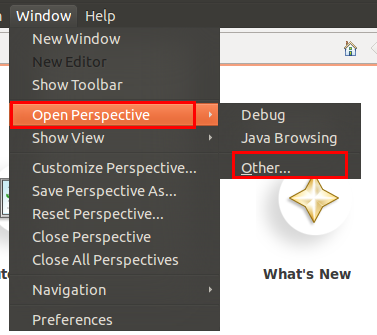

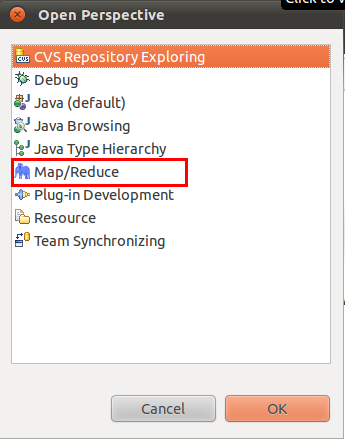

接着安装eclipse

输入命令 apt-get install eclipse

安装完成之后

输入cp /usr/local/hadoop/contrib/eclipse-plugin/hadoop-eclipse-plugin-0.20.203.0.jar /usr/lib/eclipse/plugins

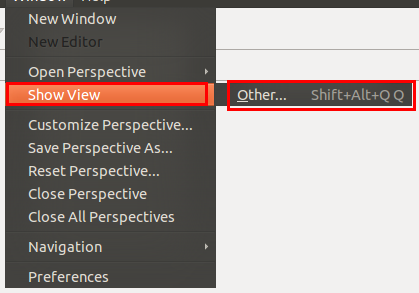

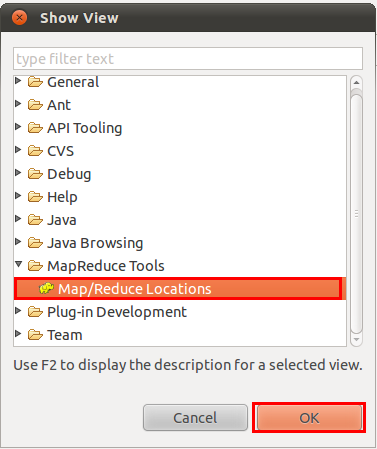

找到/usr/lib/eclipse 打开eclipse

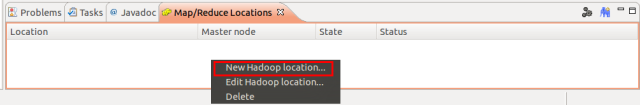

windows->preferences

选择hadoop安装路径,选择好之后点击确定

配置后结果发现出错

发现没配置好

在终端中输入

$ gedit /etc/profile

修改运行环境,在文件最尾添加如下内容:

export HADOOP_HOME=/usr/local/hadoop (此处即为hadoop的安装目录)

export PATH=$PATH:#HADOOP_HOME/bin

接下来又会报出另外一个错误,请参照这个链接