卷积与卷积神经网络

卷积

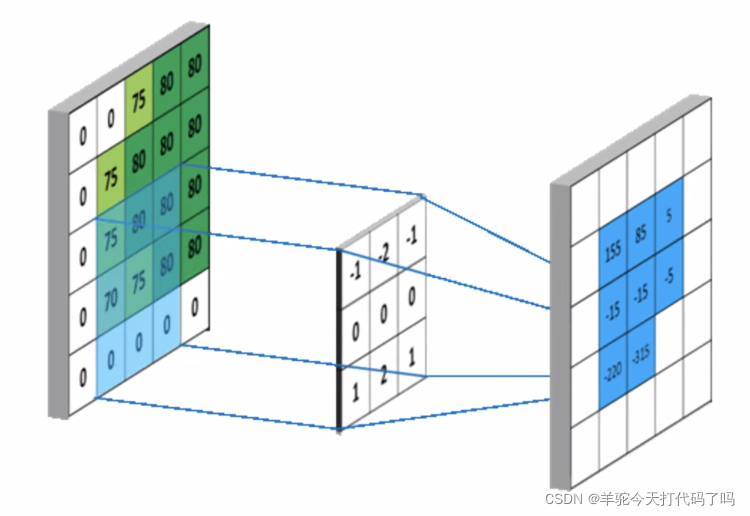

给定一个卷积核Kernel,将其覆盖在输入图像的矩阵中,将输入图像每一个单元格的数值和对应的卷积核数值相乘并相加,写入到output单元格中,给定步长依次滑动,填满output矩阵。使用padding防止边缘特征被忽略掉。

基本结构

早在1998年,LeNet5中就奠定了基本结构,卷积、池化、卷积、池化、全连接、全连接、输出。卷积层用来提取图像的底层特征,池化层用来防止过拟合,并且将数据维度减小,全连接层用于汇总之前卷积层和池化层得到的特征和信息,最后进行输出(softMax/sigmod)

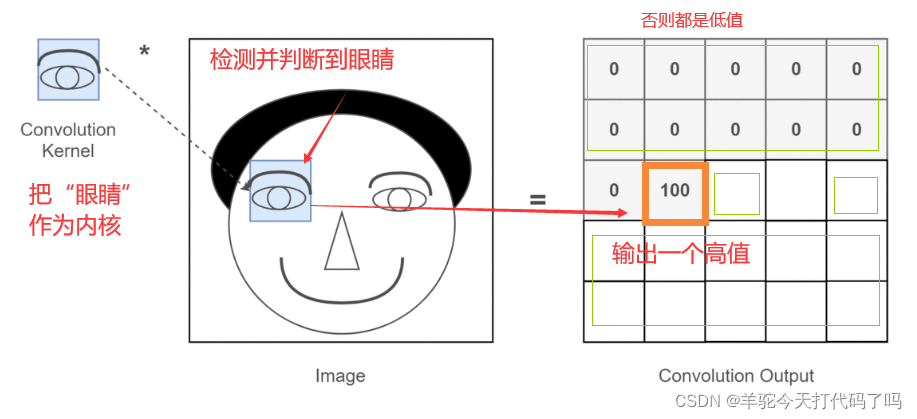

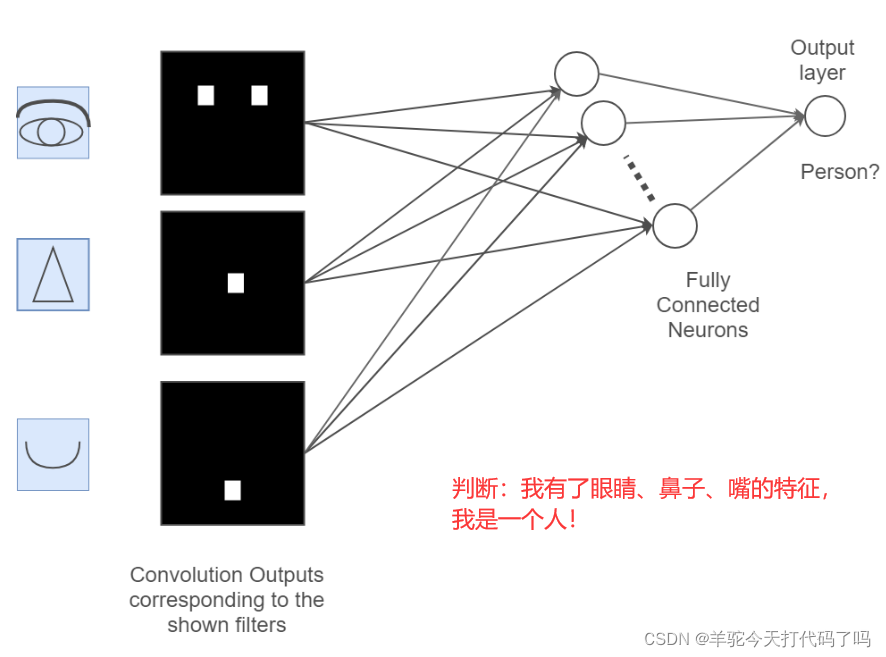

一个卷积层由许多内核组成。卷积层中存在的这些内核(有时称为卷积过滤器)学习图像中存在的局部特征(例如,人的眼睛看起来如何)。卷积层学习到的这种局部特征称为特征图。然后这些特征在图像上进行卷积。这种卷积操作将产生一个矩阵(有时称为激活图)。如果卷积滤波器中表示的特征存在于输入的该位置,则激活图会在给定位置产生高值。

池化层与全连接层

池化层使 CNN 在卷积输出方面具有一点平移不变性(例如,如果眼睛在两张图像中出现轻微平移,则CNN 仍会将其识别为眼睛)。有两种不同的池化机制(最大池化和平均池化)。一般地,最大池化(max Pooling)称为池化,因为与平均池化相比,最大池化被广泛使用。更准确地说,池化操作(max Pooling)在给定位置输出输入的最大值,该最大值落在内核中。

池化的作用:

- 减少参数量

- 防止过拟合

把池化层拉平成一个长向量flatten最后喂给全连接神经网络。全连接神经网络,每一层都是和上一层所有的神经元相连的最后变成一个密集的连接,所以叫全连接。

参考

卷积神经网络直观指南