之前的两篇文章讲解了如何实现一个框架雏形,但是scrapy框架的强大功能一个都没有实现,接下来一个一个实现

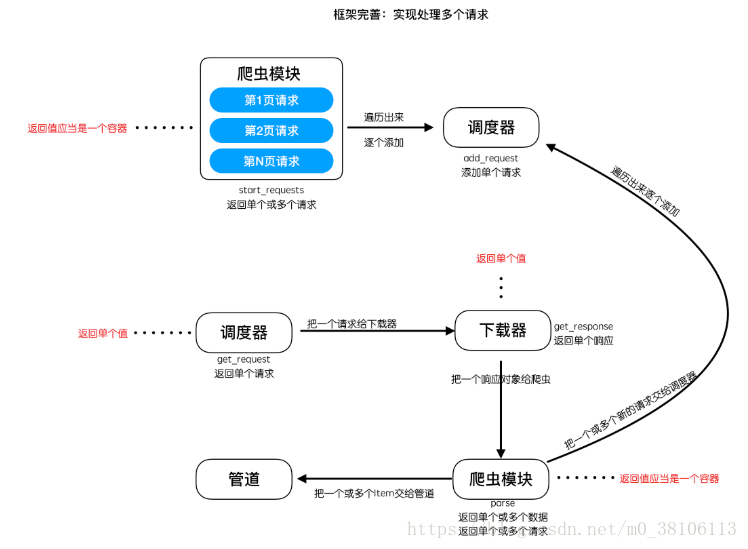

一、多爬虫实现之一 – 多请求实现

在爬虫的时候通常都是多个请求同时进行

1、多请求实现分析:

2、 项目中实现爬虫文件

在main.py同级目录下建立spiders.py,存放定义的爬虫类

# project_dir/spiders.py

from scrapy_plus.core.spider import Spider

# 继承框架的爬虫基类

class BaiduSpider(Spider):

start_url = 'http://www.baidu.com' # 设置初始请求url修改main.py

# project_dir/main.py

from scrapy_plus.core.engine import Engine # 导入引擎

from spiders import BaiduSpider

if __name__ == '__main__':

spider = BaiduSpider() # 实例化爬虫对象

engine = Engine(spider) # 传入爬虫对象

engine.start() # 启动引擎修改engine.py,设置为接收外部传入的爬虫对象

# scrapy_plus/core/engine.py

...

class Engine(object):

def __init__(self, spider): # 接收外部传入的爬虫对象

self.spider = spider # 爬虫对象

...3 实现发起多个请求

- 3.1 修改框架的爬虫组件文件 spider.py

- 设置为初始请求url为多个

- 修改start_requests方法,将返回多个请求对象

- 利用生成器方式实现start_requests,提高程序的资源消耗

# scrapy_plus/core/spider.py

'''爬虫组件封装'''

from scrapy_plus.item import Item # 导入Item对象

from scrapy_plus.http.request import Request # 导入Request对象

class Spider(object):

'''

1. 构建请求信息(初始的),也就是生成请求对象(Request)

2. 解析响应对象,返回数据对象(Item)或者新的请求对象(Request)

'''

start_urls = [] # 默认初始请求地址

# def start_requests(self):

# '''构建初始请求对象并返回'''

# request_list = []

# for url in self.start_urls:

# request_list.append(Request(url))

# return request_list

# 利用生成器方式实现,提高程序的资源消耗

def start_requests(self):

'''构建初始请求对象并返回'''

for url in self.start_urls:

yield Request(url)

def parse(self, response):

'''解析请求

并返回新的请求对象、或者数据对象

返回值应当是一个容器,如start_requests返回值方法一样,改为生成器即可

'''

yield Item(response.body) # 返回item对象 改为生成器即可3.2 修改引擎 engine.py

流程:

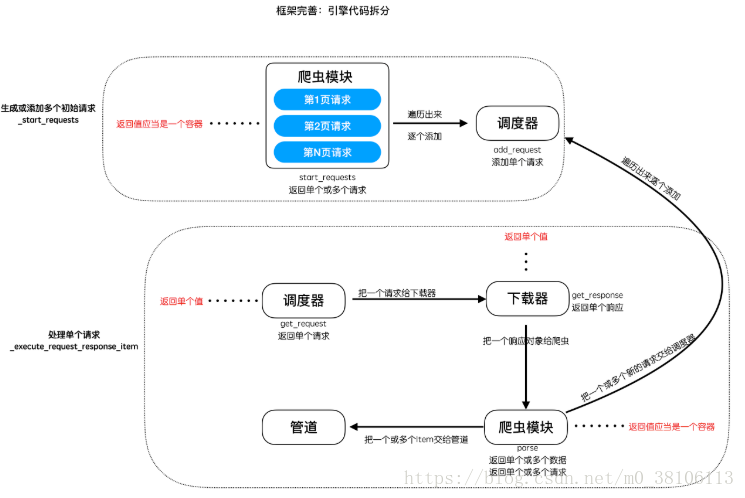

将代码拆分为两个方法,便于维护,提高代码可读性

统计总共完成的响应数

设置程序退出条件:当总响应数等于总请求数时,退出

实现处理start_requests方法返回多个请求的功能

实现处理parse解析函数返回多个对象的功能

# scheduler/core/engine.py

'''引擎

a. 对外提供整个的程序的入口

b. 依次调用其他组件对外提供的接口,实现整个框架的运作(驱动)

'''

import time # 此处新增

from datetime import datetime

from .downloader import Downloader

from .pipeline import Pipeline

from .scheduler import Scheduler

from .spider import Spider

from scrapy_plus.http.request import Request

from scrapy_plus.middlewares.downloader_middlewares import DownloaderMiddleware

from scrapy_plus.middlewares.spider_middlewares import SpiderMiddleware

from scrapy_plus.utils.log import logger

class Engine:

'''完成对引擎模块的封装'''

def __init__(self,spider):

'''

实例化其他的组件,在引起中能够通过调用组件的方法实现功能

'''

# self.spider = Spider()

self.spider = spider

self.downloader = Downloader()

self.pipeline = Pipeline()

self.scheduler = Scheduler()

self.spider_mid = SpiderMiddleware()

self.downloader_mid = DownloaderMiddleware()

# 此处新增

self.total_request_nums = 0

self.total_response_nums = 0

def start(self):

'''

提供引擎启动的入口

:return:

'''

# 此处新增+修改

start_time = datetime.now() # 起始时间

logger.info("开始运行时间:%s" % start_time) # 使用日志记录起始运行时间

self._start_engine()

stop = datetime.now() # 结束时间

end_time = datetime.now()

logger.info("爬虫结束:{}".format(end_time))

logger.info("爬虫一共运行:{}秒".format((end_time-start_time).total_seconds()))

logger.info("总的请求数量:{}".format(self.total_request_nums))

logger.info("总的响应数量:{}".format(self.total_response_nums))

# 此处新增

def _start_request(self):

for start_request in self.spider.start_requests():

#1. 对start_request进过爬虫中间件进行处理

start_request = self.spider_mid.process_request(start_request)

#2. 调用调度器的add_request方法,添加request对象到调度器中

self.scheduler.add_request(start_request)

#请求数+1

self.total_request_nums += 1

# 此处新增

def _execute_request_response_item(self):

#3. 调用调度器的get_request方法,获取request对象

request = self.scheduler.get_request()

if request is None: #如果没有获取到请求对象,直接返回

return

#request对象经过下载器中间件的process_request进行处理

request = self.downloader_mid.process_request(request)

#4. 调用下载器的get_response方法,获取响应

response = self.downloader.get_response(request)

#response对象经过下载器中间件的process_response进行处理

response = self.downloader_mid.process_response(response)

#response对象经过下爬虫中间件的process_response进行处理

response = self.spider_mid.process_response(response)

#5. 调用爬虫的parse方法,处理响应

for result in self.spider.parse(response):

#6.判断结果的类型,如果是request,重新调用调度器的add_request方法

if isinstance(result,Request):

#在解析函数得到request对象之后,使用process_request进行处理

result = self.spider_mid.process_request(result)

self.scheduler.add_request(result)

self.total_request_nums += 1

#7如果不是,调用pipeline的process_item方法处理结果

else:

self.pipeline.process_item(result)

self.total_response_nums += 1

# 此处修改

def _start_engine(self):

'''

具体的实现引擎的细节

:return:

'''

self._start_request()

while True:

time.sleep(0.001)

self._execute_request_response_item()

# 程序退出条件

if self.total_response_nums>= self.total_request_nums:

break上面为什么要设置这个退出条件

3.3 修改调度器 scheduler.py

将从队列获取请求对象设置为非阻塞,否则会造成程序无法退出

统计请求总数,用于判断程序退出

# scrapy_plus/core/scheduler.py

'''调度器模块封装'''

# 利用six模块实现py2和py3兼容

from six.moves.queue import Queue

class Scheduler(object):

'''

1. 缓存请求对象(Request),并为下载器提供请求对象,实现请求的调度

2. 对请求对象进行去重判断

'''

def __init__(self):

self.queue = Queue()

# 记录总共的请求数

self.total_request_number = 0 # 此处新增

def add_request(self, request):

'''添加请求对象'''

self.queue.put(request)

# 统计请求总数

self.total_request_number += 1 # 此处新增

# 此处修改

def get_request(self):

'''获取一个请求对象并返回'''

try:

# 设置为非阻塞

request = self.queue.get(False)

except:

return None

else:

return request

def _filter_request(self):

'''请求去重'''

pass这里队列的get()设置为block=False,解释一下:如果队列为空且block为True,get()就使调用线程暂停,直至有项目可用。如果队列为空且block为False,队列将引发Empty异常

这里设置为False不阻塞,即使队列空了直接返回None,不阻碍其他方法的运行

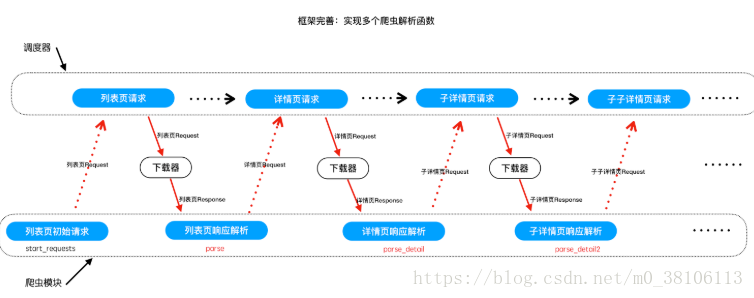

二、多爬虫实现之二 – 爬虫实现多个解析函数

1 爬虫实现多个解析函数的意义

2 响应对象的解析方法封装

为response对象封装xpath、正则、json、等方法和属性,以支持对数据的解析和提取

# scrapy_plus/http/response.py

import re # 此处新增

import json # 此处新增

from lxml import etree # 此处修改requirments.txt文件 # 此处新增

class Response(object):

'''框架内置Response对象'''

def __init__(self, url, body, headers, status_code):

self.url = url # 响应url

self.status_code = status_code # 响应状态码

self.headers = headers # 响应头

self.body = body # 响应体

# 此处新增

def xpath(self, rule):

'''提供xpath方法'''

html = etree.HTML(self.body)

return html.xpath(rule)

# 此处新增

@property

def json(self):

'''提供json解析

如果content是json字符串,是才有效

'''

return json.loads(self.body)

# 此处新增

def re_findall(self, rule, data=None):

'''封装正则的findall方法'''

if data is None:

data = self.body

return re.findall(rule, data)3 增加爬虫:豆瓣电影top250

3.1 修改项目中的spiders.py

# project_dir/spiders.py

from scrapy_plus.core.spider import Spider

from scrapy_plus.http.request import Request

from scrapy_plus.item import Item

# 继承框架的爬虫基类

class BaiduSpider(Spider):

start_urls = ['http://www.baidu.com'] # 设置初始请求url

class DoubanSpider(Spider):

start_urls = [] # 重写start_requests方法后,这个属性就没有设置的必要了

def start_requests(self):

# 重写start_requests方法,返回多个请求

base_url = 'http://movie.douban.com/top250?start='

for i in range(0, 250, 25): # 逐个返回第1-10页的请求属相

url = base_url + str(i)

yield Request(url)

def parse(self, response):

'''解析豆瓣电影top250列表页'''

title_list = [] # 存储所有的

for li in response.xpath("//ol[@class='grid_view']/li"): # 遍历每一个li标签

title = li.xpath(".//span[@class='title'][1]/text()") # 提取该li标下的 标题

title_list.append(title[0])

yield Item(title_list) # 返回标题3.2 修改框架中的main.py,运行查看效果

from scrapy_plus.core.engine import Engine # 导入引 擎

from spiders import BaiduSpider, DoubanSpider

if __name__ == '__main__':

# spider = BaiduSpider() # 实例化爬虫对象

spider = DoubanSpider()

engine = Engine(spider) # 传入爬虫对象

engine.start() # 启动引擎运行结果:

这是爬虫中间件:process_request方法

这是爬虫中间件:process_request方法

这是爬虫中间件:process_request方法

这是爬虫中间件:process_request方法

这是爬虫中间件:process_request方法

这是下载器中间件:process_request方法

这是下载器中间件:process_response方法

这是爬虫中间件:process_response方法成功实现发送多个解析

4 实现多个解析函数

由于现在不同的请求对应不同的解析函数,因此需要为请求对象指明它的解析函数,因此为请求对象增加一个属性

# scrapy_plus/http/request.py

class Request(object):

'''框架内置请求对象,设置请求信息'''

# 此处修改,加入了meta参数和parse参数

def __init__(self, url, method='GET', headers=None, params=None, data=None, parse='parse', meta={}):

self.url = url # 请求地址

self.method = method # 请求方法

self.headers = headers # 请求头

self.params = params # 请求参数

self.data = data # 请求体

# 此处新增

self.parse = parse # 指明它的解析函数, 默认是parse方法

self.meta = meta修改response.py

# scrapy_plus/http/response.py

......

class Response:

'''完成对响应对象的封装'''

# 此处修改

def __init__(self, url, body, headers, status_code, meta={}):

'''

初始化resposne对象

:param url: 响应的url地址

:param body: 响应体

:param headers: 响应头

:param status_code: 状态码

'''

self.url = url

self.headers = headers

self.status_code = status_code

self.body = body

# 此处新增

self.meta = meta5 在引擎中需要动态的判断和获取对应的解析函数

利用getattr()函数

注意meta的传递时机

# scrapy_plus/core/engine.py

class Engine(object):

......

def _execute_request_response_item(self):

'''根据请求、发起请求获取响应、解析响应、处理响应结果'''

......

#request对象经过下载器中间件的process_request进行处理

request = self.downloader_mid.process_request(request)

#4. 调用下载器的get_response方法,获取响应

response = self.downloader.get_response(request)

# 此处新增

response.meta = request.meta

#response对象经过下载器中间件的process_response进行处理

response = self.downloader_mid.process_response(response)

#response对象经过下爬虫中间件的process_response进行处理

response = self.spider_mid.process_response(response)

# 此处新增

# parse方法

parse = getattr(self.spider, request.parse) # getattr(类, 类中方法名的字符串) = 类方法对象

#5. 调用爬虫的parse方法,处理响应

for result in parse(response): # 此处修改

#6.判断结果的类型,如果是request,重新调用调度器的add_request方法

if isinstance(result,Request):

#在解析函数得到request对象之后,使用process_request进行处理

result = self.spider_mid.process_request(result)

self.scheduler.add_request(result)

self.total_request_nums += 1

#7如果不是,调用pipeline的process_item方法处理结果

else:

self.pipeline.process_item(result)

self.total_response_nums += 1

......6 修改豆瓣爬虫,发起详情页的请求

# project_dir/spiders.py

......

class DoubanSpider(Spider):

start_urls = [] # 重写start_requests方法后,这个属性就没有设置的必要了

def start_requests(self):

# 重写start_requests方法,返回多个请求

base_url = 'http://movie.douban.com/top250?start='

for i in range(0, 250, 25): # 逐个返回第1-10页的请求属相

url = base_url + str(i)

yield Request(url)

def parse(self, response):

'''解析豆瓣电影top250列表页'''

# title_list = [] # 存储所有的

for li in response.xpath("//ol[@class='grid_view']/li"): # 遍历每一个li标签

item = {}

item["title"] = li.xpath(".//span[@class='title'][1]/text()")[0] # 提取该li标下的 标题

# title_list.append(title[0])

detail_url = li.xpath(".//div[@class='info']/div[@class='hd']/a/@href")[0]

yield Request(detail_url, parse="parse_detail",meta={"item":item}) # 发起详情页的请求,并指定解析函数是parse_detail方法

# yield Item(title_list) # 返回标题

def parse_detail(self, response):

'''解析详情页'''

item = response.meta["item"]

item["url"] = response.url

print('item:', item) # 打印一下响应的url

return [] # 由于必须返回一个容器,这里返回一个空列表

# yield Item(item) #或者yield Item对象运行项目中main.py查看效果

7 相应的去修改框架和项目中的strat_urls和start_requests()俩个名字

注意:此处报类型异常 是因为/scrapy_plus/core/spider模块中的start_urls和start_requests()!注意最后多了个s!